1、结构

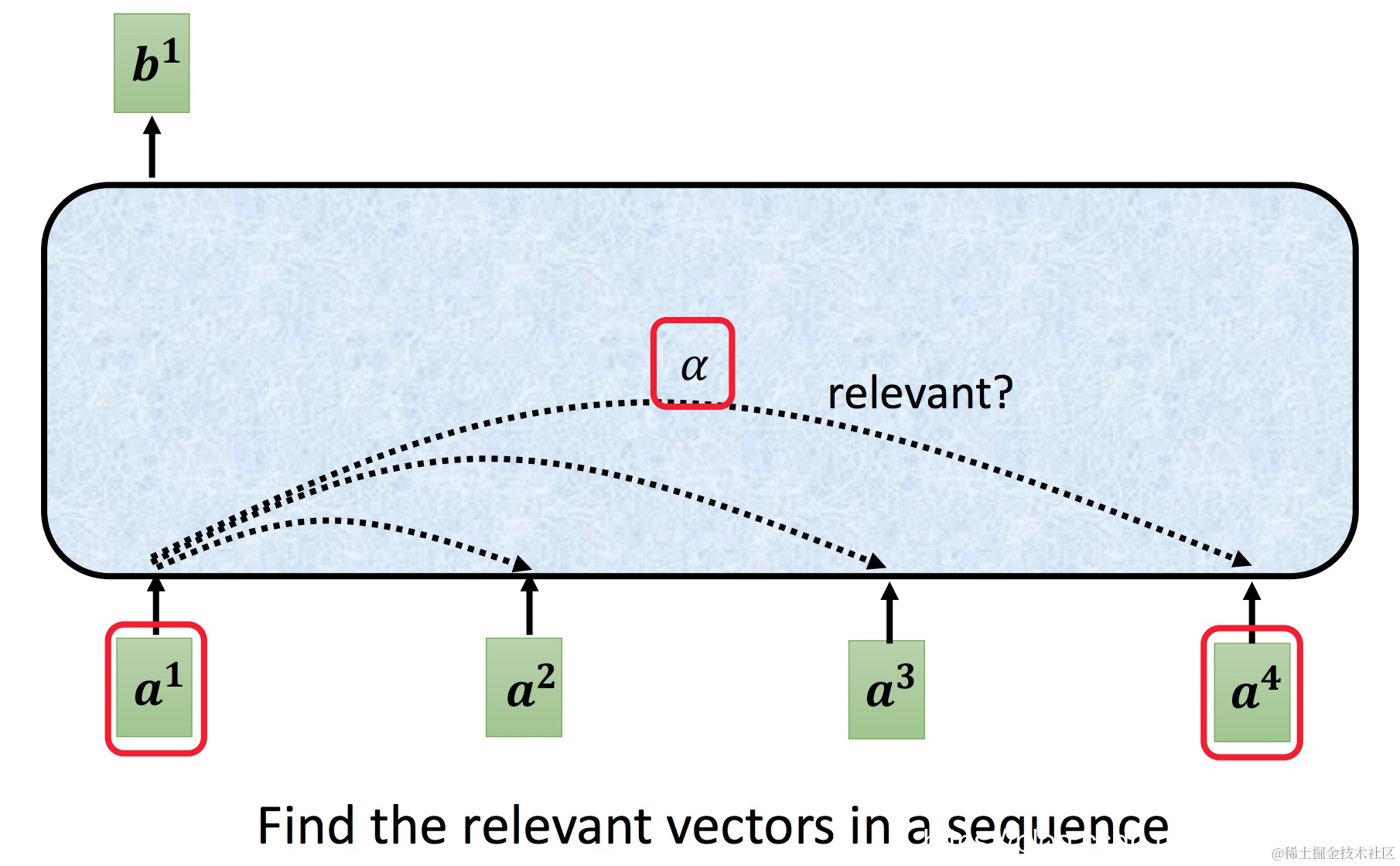

self-attention其实就是一种结构,并且具备自己独特的参数计算方法,下面是self-attention的结构图,a1到a4其实可以认为是输入或者是隐含层某一层的输入,其实就是通过attention后输出维度相同的b1到b4,只是输出会考虑到a1到a4的关联关系。

如下,b1是由a1到a4综合后算出来的,那么如何去计算关联及如何得到b1呢?

2、计算方法

2、计算方法

计算方法其实不固定,可以相乘一个矩阵后相乘,也可以相乘再相加再tanh,但是一般会选第一种。

3、并行计算

下面这些参数是可以并行计算得到的。