每天进步一点点呀,要慢慢积累,加油。

1、阅读了论文《Multinomial Distribution Learning for Effective Neural Architecture Search》。论文提出的Performance ranking hypothesis,从想法到写作技巧都值得学习。

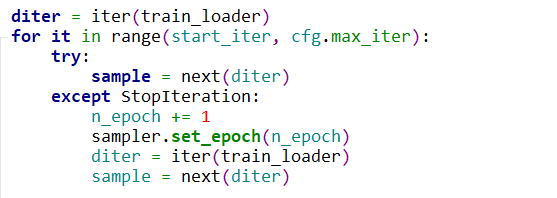

2、python的iter()的用法,感觉很方便的样子。

train_loader里是采样得到的几批数据,用iter()函数将train_loader里的数据按批次生成迭代器。

3、pytorch训练模型时的关键几步:

# 首先将上一步求导得到的梯度值清空。

optimizer.zero_grad()

# 获得当前模型的输出logits。

logits = model(im)

# 计算loss。

loss = criterion(logits, lb)

# 用计算得到的loss,对各个参数进行求导。

loss.backward()

# 在已知各个参数的导数值后,用优化器进行优化。

optimizer.step()