基本形式

给定由 d 个属性描述的示例,其中

是 x 在第 i 个属性上的取值,线性模型试图学得一个通过属性的线性组合来进行预测的函数,即

一般用向量形式写成

线性回归

给定数据集 , 其中

线性回归试图学得

通过让均方误差最小化来确定 和

,基于均方误差最小化来进行模型求解的方法称为最小二乘法。

我们可将分别对

和

求导,得到

分别令上式为零可得 和

的最优闭式解

更一般地,我们试图学得

把 和

吸收入向量形式

,相应的,把数据集

表示为一个

大小的矩阵

,其中每行对应一个示例,即

再把标记写成向量形式 ,有

令,对

求导得到

令上式为零可得 最优的闭式解,则

当 为满秩矩阵或正定矩阵时,可得

当 不可逆时,可引入正则化项

对数几率回归(逻辑回归)

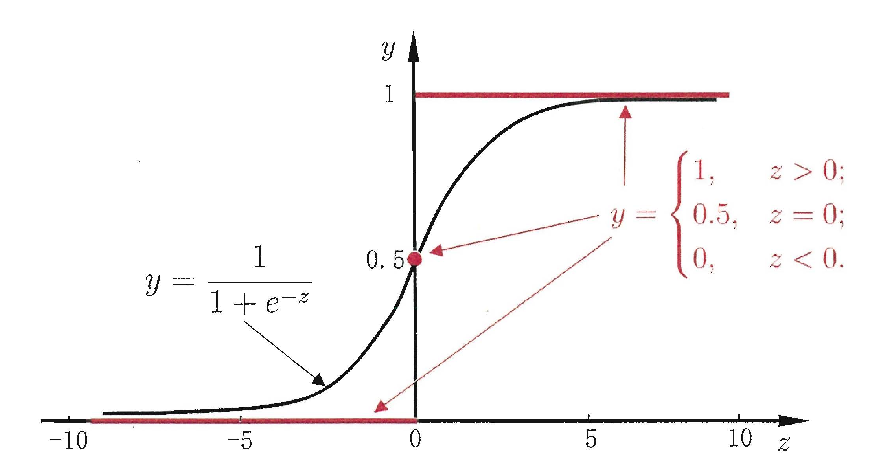

上一节讨论的是如何使用线性模型进行回归学习,这一节将讨论使用线性模型进行分类任务。首先简单介绍一下对数几率函数

对数几率函数是一种“Sigmoid函数”,它将 z 值转化成一个接近 0 或 1 的 y 值,并且其输出值在 z = 0 附近变化很陡。将对数几率函数代入得到

则

若将 y 视为样本 x 作为正例的可能性,则1 - y 是其反例的可能性,两者的比值 称为“几率”,対几率取对数

得到“对数几率”

若将 y 视为类后验概率估计 ,则上式可重写为

有

逻辑回归模型学习时,对于给定的训练数据集 ,其中,

,可以应用极大似然估计法估计模型参数,从而得到逻辑斯蒂回归模型。

设:

似然函数为

令 , 则

可简写成

, 对数似然函数为

对上式求极大值,可得到 的估计值。常采用的方法是梯度下降法及拟牛顿法

类别不平衡问题

类别不平衡是指分类任务中不同类别的训练样例数目差别很大的情况。不失一般性,我们假定正类样例较少,反类样例较多。

解决方法:

-

欠采样。即去除一些反例使得正反例数目接近,然后再进行学习

-

过采样。即增加一些正例使得正反例数目接近,再进行学习。

-

阈值移动。直接基于原始数据集进行学习,但在用训练好的分类器进行预测时,将

嵌入决策过程中