为什么需要softmax?

我们知道max,假如说我有两个数,a和b,并且a>b,如果取max,那么就直接取a,没有第二种可能

但有的时候我不想这样,因为这样会造成分值小的无法取到。所以我希望分值大的那一项经常取到,分值小的那一项也偶尔可以取到,那么我用softmax就可以了 现在还是a和b,a>b,如果我们取按照softmax来计算取a和b的概率,那a的softmax值大于b的,所以a会经常取到,而b也会偶尔取到,概率跟它们本来的大小有关。

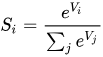

概率要求值必须在0~1之间,并且所有的概率加起来应该等于1;故可以用下面的公式表示

假设我们有一个数组,V,Vi表示V中的第i个元素,那么这个元素的Softmax值就是

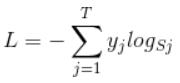

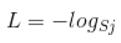

弄懂了softmax,就要来说说softmax loss了。 那softmax loss是什么意思呢?如下:

理清了softmax loss,就可以来看看cross entropy了。

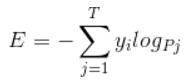

corss entropy是交叉熵的意思,它的公式如下: