译者注:本文编译自伯克利大学2017年春季学期课程CS294介绍页面。该课程主题选择深度增强学习,即紧跟当前人工智能研究的热点,又可作为深度学习的后续方向,值得推荐。

课程时间

2017年1月18日至5月3日。

课程前置要求

学习该课程,会假设学员对于增强学习,最优化方法和机器学习这些知识背景比较熟悉。要是学员对于这些内容不太了解,就需要根据提供的参考资料补习以下的知识点:

- 增强学习和马尔科夫决策过程(MDPs)

- MDPs的定义

- 具体算法:策略迭代和价值迭代

- 搜索算法

- 数值最优化方法

- 梯度下降和随机梯度下降

- 反向传播算法

- 机器学习

- 分类和回归问题:用什么样的损失函数,如何拟合线性或非线性模型

- 训练/测试误差,过拟合

译者注:在2016年跟着专栏翻译的CS231n课程笔记学习的知友可以发现,缺少的知识点只有增强学习和马尔科夫决策过程,学习这门课的难度降低。

对于增强学习和MDPs的介绍材料有:

- CS188 EdX course,从马尔科夫决策过程第一部分开始。

- Sutton & Barto的著作,学习第3章和第4章。

译者注:该著作重要,建议中文母语学习者打印该书,方便查阅、学习与装逼:)

- 对MDPs的简洁介绍,可以参考吴恩达这篇论文的第1章和第2章。

译者注:不想看大部头的著作就看这篇,简明扼要方便理解。

- David Silver的课程,下文有链接。

译者注:要是看完并基本掌握了David Silver的课程,这门课也就是看看了。

对于机器学习和神经网络的介绍材料有:

译者注:也就是CS231n了,算成是AK的也不太妥当,毕竟老板是李大姐,讲师还有Justin 。

译者注:拜拜亨大爷总是安心些。

译者注:本人没有看过这个课程,有学习过的知友可以在评论中简单谈谈感受。

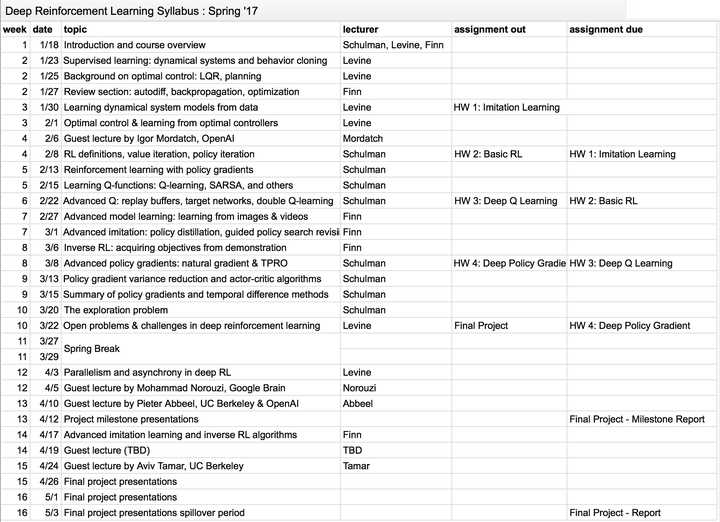

课程安排

如下图所示,课件和参考材料会随着课程进度发布。这篇翻译的内容也会同步更新。

课程视频

原文展示了2015年的4个课程视频,在Youtube上,清晰度很低,这里就不放出了,感兴趣的知友自行查看原文。随着课程进展,本部分也更新2017年的课程视频链接。

相关课程

译者注:重要。

译者注:没必要,看吴恩达的课程。

译者注:去年我们一直在推荐,不赘述了。

相关书籍

译者注:重要,系统学习的话就打印吧。

- Szepesvari, Algorithms for Reinforcement Learning

- Bertsekas, Dynamic Programming and Optimal Control, Vols I and II

- Puterman, Markov Decision Processes: Discrete Stochastic Dynamic Programming

- Powell, Approximate Dynamic Programming

泛读链接

译者注:收藏了你也不会看的,但是可以装逼:)

之前课程

2015年秋季开过同名课程,介绍链接点击这里。

课程简介翻译完毕。

学习建议

想要学习深度增强学习的知友,在我个人的看来,可能是以下几种情况:

- 看到了深度增强学习的前景,想要提前布局,提高自身价值;

- 学完了深度学习,想要继续学习人工智能领域其他内容;

- 大公司或者拿了投资的创业公司的项目组想要搞相关应用,比如BetaGo或者GammaGo:)

都挺好的,学吧!专栏成立的初心之一,就是促进这个领域的学习和交流。个人也会以这次课程为抓手,再系统性地把深度增强学习给学扎实。后续会以该课程学习为主题,在专栏进行相关内容的写作,也欢迎大家针对课程学习内容进行讨论。

如果是因为近几年人工智能突然火热起来想要学习的知友,需要知道人工智能领域历史上起起落落好几次,入坑前想好自己是不是真的感兴趣。

如果上文中的课程前置要求中三方面知识点都不太熟悉,也不建议直接学习该课程。建议先看吴恩达或者Hinton的课程,然后看CS231n,然后再来学习这门课程。

最后照例打鸡血:虽说人工智能起起落落好几次,但是这次确实是解决了之前没有解决的问题,突破了之前没有突破的水平,不是吗?相较于“呵呵,根据历史规律,人工智能也就还能火几年,步子太大要扯到蛋”的态度,我个人更倾向:

I am looking at the future with concern, but with good hope. -Albert Schweitzer

----------------------------------------------------------------------------------------

PS:我们开通了智能单元微信公众号,搜索“智能单元”就能找到,内容上会和专栏差异化。可以的话请大家关注支持一个,算是对我的鼓励,先谢过啦:)