调度系统作为数据管道的核心引擎,正在经历一场从“定时触发”到“智能编排”的深刻变革。传统的基于时间的调度模式已难以满足现代数据处理对实时性、灵活性及规模化的复杂需求,事件驱动、云原生和智能化已成为行业公认的新发展方向。

作为本系列专栏 《深入理解 Apache DolphinScheduler:从调度原理到 DataOps 实战》的第 10 篇收官之作,本文将立足于 Apache DolphinScheduler 现有的分布式可视化 DAG 架构基础,深度探讨其在 Serverless 自动扩缩容、流批一体原生管理及 AI 辅助设计等前沿领域的演进逻辑,为您揭示下一代云原生调度平台的进化蓝图。

一、事件驱动调度 vs 时间驱动调度

时间驱动调度的局限性

当前 DolphinScheduler 主要采用基于 Quartz 的分布式调度器,通过 cron 表达式实现定时调度。这种时间驱动模式在批处理场景下表现良好,但在实时性要求高的场景中存在明显局限:

- 延迟问题:必须等待预定时间点触发,无法响应外部事件的即时变化

- 资源浪费:即使没有数据到达,也会按计划执行任务

- 缺乏灵活性:难以处理依赖外部系统状态的复杂场景

事件驱动调度的可能性

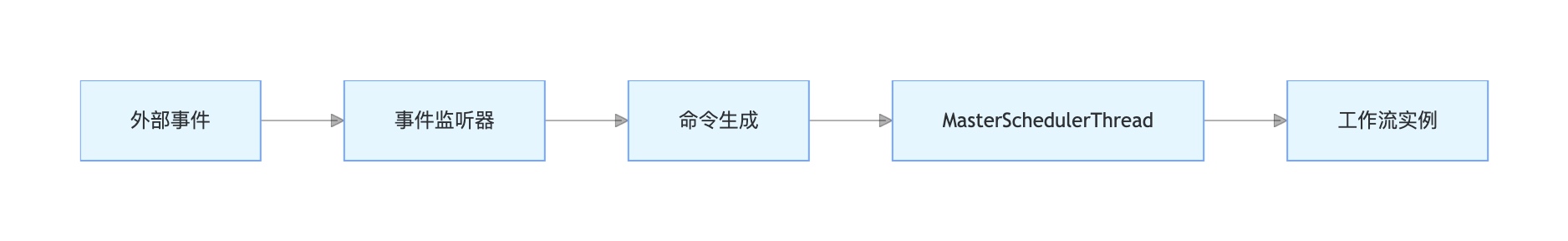

DolphinScheduler 的架构实际上已经具备了向事件驱动演进的基础。其命令机制(Command Pattern)支持多种命令类型,包括启动工作流、从当前节点开始执行、恢复被容错的工作流等。这种设计可以扩展为事件驱动的触发机制:

从架构设计来看,DolphinScheduler 的 MasterServer 采用分布式去中心化设计,Master 和 Worker 注册到 ZooKeeper 中,通过 slot 处理各自的 Command,通过 selector 分发任务给 worker。这种架构天然支持事件驱动的任务分发。

混合调度模式

未来的调度系统很可能采用时间驱动与事件驱动相结合的混合模式:

- 时间驱动:适用于定期的批处理任务,如日报生成、数据归档

- 事件驱动:适用于实时响应场景,如数据到达触发、文件变更触发

- 条件驱动:基于业务规则或数据状态的智能触发

DolphinScheduler 的依赖机制已经支持跨流程的自定义任务依赖,这为构建更复杂的事件驱动工作流提供了基础。

二、云原生与 Kubernetes 对调度的影响

云原生架构的深度融合

DolphinScheduler 已经提供了完整的 Kubernetes 部署方案,通过 Helm Chart 可以在 Kubernetes 集群中快速部署。这标志着调度系统正在从传统的虚拟机部署向云原生架构转型。

云原生对调度系统的影响主要体现在以下几个方面:

1. 弹性伸缩

DolphinScheduler 已经集成了 KEDA(Kubernetes Event-driven Autoscaling)来实现 Worker 的自动扩缩容。当没有任务运行时,Worker 数量可以缩容到零,显著节约资源成本。

worker:

keda:

enabled: true

minReplicaCount: 0

maxReplicaCount: 3

pollingInterval: 5

cooldownPeriod: 30

这种基于任务状态的弹性伸缩是云原生调度的重要特征,它使调度系统能够根据实际负载动态调整资源。

2. 声明式部署

Kubernetes 的声明式 API 使得调度系统的部署和配置更加标准化和可重复。DolphinScheduler 的 Helm Chart 提供了丰富的配置选项,包括 Master、Worker、API、Alert 等各个组件的详细配置 。

3. 服务网格集成

随着服务网格(Service Mesh)的普及,调度系统可以更好地与微服务架构集成。DolphinScheduler 的 API Server 提供 RESTful API 服务,这为与服务网格的集成提供了标准接口。

Kubernetes 作为执行引擎

除了部署层面的云原生化,Kubernetes 本身也可以作为任务执行引擎。DolphinScheduler 的支持矩阵显示,虽然 Spark-Kubernetes 和 Flink-Kubernetes 等任务类型目前标记为"尚不"支持,但这显然是未来的发展方向。

将 Kubernetes 作为统一执行引擎的优势包括:

- 资源隔离:每个任务在独立的 Pod 中运行,互不干扰

- 资源调度:利用 Kubernetes 的调度能力实现更精细的资源分配

- 可观测性:集成 Kubernetes 的监控和日志体系

- 多云支持:跨云部署和迁移更加便捷

三、AI 与智能运维的可能性

智能故障诊断与自愈

DolphinScheduler 已经具备完善的容错机制,包括 Master 容错和 Worker 容错。基于 ZooKeeper 的 Watcher 机制,当 Master 监听到其他 Master 或 Worker 的 remove 事件时,会根据业务逻辑进行流程实例或任务实例的容错。

AI 技术可以进一步增强这种容错能力:

- 故障预测:基于历史数据和系统指标,预测可能的故障点

- 智能决策:在故障发生时,选择最优的恢复策略

- 根因分析:自动分析故障原因,生成诊断报告

智能调度优化

DolphinScheduler 支持流程实例和任务实例的优先级设置。AI 技术可以基于以下因素进行智能调度优化:

- 历史执行时间:预测任务执行时长,优化资源分配

- 依赖关系分析:识别关键路径,优化并行度

- 资源利用率:基于实时资源状态动态调整调度策略

- 业务优先级:结合业务价值自动调整任务优先级

参数智能推荐

DolphinScheduler 支持多种任务类型,包括 SHELL、SQL、SPARK、PYTHON 等。AI 可以基于历史执行数据为这些任务推荐最优参数:

- 内存配置:根据数据规模推荐合适的内存设置

- 并行度:基于集群状态推荐最优并行度

- 超时设置:根据历史执行时间动态调整超时阈值

四、DolphinScheduler 的长期演进方向

核心演进方向概览

| 维度 | 现状 (Status Quo) | 未来演进方向 (Future Direction) |

|---|---|---|

| Serverless | 已实现基于 KEDA 的 Worker 自动扩缩容,支持缩容至 0。 | 优化 Worker 冷启动速度;实现更细粒度的多租户资源配额管理。 |

| 流批一体 | 已有 FLINK_STREAM 插件,支持基础生命周期管理。 | 深度集成 Flink-Native-K8s;实现流批统一的调度逻辑与数据对齐。 |

| 注册中心 | 已支持 ZooKeeper、JDBC 和 Etcd 三种实现。 | 增强与 Kubernetes 服务发现的集成;支持注册中心的多实例高可用切换。 |

| 通信协议 | 已从 gRPC 切换为基于 Netty 的高性能通信。 | 探索 QUIC 协议以提升跨地域传输效率;集成 Service Mesh。 |

1. 架构演进:从自动化到 Serverless

- 现状:目前在 Kubernetes 部署环境下,通过集成 KEDA 已经实现了 Worker 的自动扩缩容。当系统中没有运行任务时,Worker 实例数可以自动降为零以节省资源。

- 未来方向:

- 冷启动优化:目前 Worker 启动仍依赖完整的 JVM 加载,未来需减少启动耗时以实现秒级响应。

- 强租户隔离:在 Serverless 环境下提供更严格的资源配额(Quota)管理和计算资源隔离。

2. 实时流批一体:从“插件化”到“原生化”

- 现状:

- 已提供

FLINK_STREAM任务类型。 - 对 Flink-Native-K8s 等原生模式的支持尚不完善。

- 已提供

- 未来方向:

- 原生管理:实现对 Flink/Spark 在 K8s 上的原生生命周期管理,摆脱对复杂环境变量脚本的依赖。

- 逻辑统一:用户只需定义一套业务逻辑,由调度系统根据数据源自动切换流/批模式。

3. 技术栈演进:注册中心与通信

- 现状:

- 注册中心:已不再局限于 ZooKeeper,JDBC 和 Etcd 插件已经成熟并可用于生产环境。JDBC 模式特别适合不希望维护额外中间件的用户。

- 通信协议:系统内部通信和日志访问已广泛采用 Netty 框架。

- 未来方向:

- 云原生注册中心:直接利用 Kubernetes 的

ConfigMap或API Server进行服务发现。 - 协议升级:在跨数据中心(Multi-Region)场景下,引入 QUIC 协议以应对网络抖动。

- 云原生注册中心:直接利用 Kubernetes 的

4. 功能演进:数据血缘与低代码

- 现状:系统已具备基础的工作流血缘分析能力

WorkflowLineageService。 - 未来方向:

- 自动血缘发现:通过解析 SQL 任务(如 Hive/Spark SQL)自动提取表级、字段级血缘。

- AI 辅助:利用大模型辅助用户通过自然语言生成 DAG 结构或调试任务参数。

五、挑战与机遇

技术挑战

在从单一调度工具向全栈云原生编排平台演进的过程中,DolphinScheduler 面临着深层次的工程挑战:

- 复杂性管理:随着功能增多,系统复杂度呈指数级增长,需要更好的架构治理

- 性能优化:在大规模场景下,需要持续优化调度性能和资源利用率

- 兼容性:在演进过程中保持向后兼容,降低用户迁移成本

生态机遇

DolphinScheduler 的发展受益于开源协同与技术趋势的深度融合:

- 开源社区:Apache 开源社区为项目发展提供了强大的动力

- 云原生生态:与 Kubernetes、Service Mesh 等云原生技术的深度集成

- AI 赋能:AI 技术为调度系统的智能化提供了新的可能性

六、写在最后

调度系统正在从单一的时间驱动工具演变为融合事件驱动、云原生、智能化的综合数据编排平台。DolphinScheduler 凭借其去中心化的架构设计、插件化的扩展机制和云原生的部署支持,已经为这场演进奠定了坚实基础。

未来,调度系统将不仅仅是任务的执行者,更是数据智能的使能者。它将能够理解业务意图,预测系统状态,自动优化决策,成为企业数据基础设施的大脑。DolphinScheduler 的演进之路,正是这场变革的缩影。

系列文章回顾

《深入理解 Apache DolphinScheduler:从调度原理到 DataOps 实战》系列文章: