完全本地、完全开源:Mano-P 端侧 GUI Agent 模型正式发布

引言

在 AI Agent 快速发展的今天,GUI 自动化(Computer Use Agent)正在成为一个重要的技术方向。然而,现有方案大多依赖云端 API 调用——每一次屏幕截图都需要上传到远程服务器进行推理,这在数据安全和隐私保护方面带来了不可忽视的风险。

今天,我们正式开源 Mano-P 本地模型及配套的 Cider 推理加速 SDK,将 GUI Agent 的完整推理能力带到端侧设备上。所有截图和任务数据不出设备,真正实现私有化部署。

Mano-P 是什么

Mano-P 是明略科技开源的面向端侧设备的 GUI-VLA(Vision-Language-Action)智能体模型。Mano 是西班牙语中"手"的意思,P 代表 Private。我们相信,个体和组织都能够拥有属于自己的私有 AI。

Mano-P 基于完整的 Mano 技术体系(详见 Mano Technical Report),采用三阶段渐进式训练(SFT → 离线强化学习 → 在线强化学习)和"思考-行动-验证"循环推理机制,实现了高精度的 GUI 理解和操作能力。

本次发布属于 Mano-P 开源计划的第二阶段,主要面向对数据安全有较高要求的开发者,核心发布内容包括:

- Mano-P 1.0-4B 本地模型

- Cider 推理加速 SDK

- Mano-AFK 端到端应用构建工具

Mano-P 1.0-4B 本地模型

Mano-P 1.0-4B 是一个可直接运行在 Apple Silicon 设备上的视觉语言动作模型,无需联网、无需云端 API。

硬件要求:

- Apple M4 芯片及以上(Mac mini / MacBook)

- 32GB 及以上统一内存

- 或通过 USB 4.0 连接的 Mano-P 算力棒

性能表现(Apple M5 Pro, 64GB RAM):

- W8A16 量化:Prefill 2.839s,Decode ~80 tokens/s

- W8A8 量化(Cider 加速):Prefill 2.519s,Decode ~79.5 tokens/s

- W8A8 相对 W8A16 baseline,Prefill 加速约 12.7%

数据隐私:

本地模式下,Mano-P 基于 MLX 框架直接在设备上推理,所有截图与任务描述完全不经过任何网络调用。对于处理敏感信息和有高安全要求的场景尤为适用。

模型下载:

- 🤗 HuggingFace:huggingface.co/Mininglamp-…

- 🪄 ModelScope:modelscope.cn/models/Mini…

Cider 推理加速 SDK

Cider 是明略科技开源的面向 macOS 的推理加速 SDK,基于 Apple MLX 构建。

为什么需要 Cider

Apple MLX 框架的量化方案属于仅权重量化(Weight-Only Quantization),即 QuantizedLinear 将权重反量化为 FP16 后执行 FP16 GEMM。MLX 并未提供真正的激活量化推理路径——这正是 Cider 要解决的问题。

Cider 通过自定义 Metal Kernel 实现了 fused quantize-matmul-dequant 原语,以 MLX 自定义原语的形式对外暴露,支持完整的 lazy evaluation。

支持的量化模式

- W8A8:INT8 权重 + INT8 per-token 激活量化,通过 TensorOps matmul2d 计算

- W4A8:INT4 packed 权重 + INT8 per-token 激活量化

这两种模式是 MLX 原生不支持的,Cider 补齐了这一生态空白。

性能数据(Apple M5 Pro)

端到端 VLM 加速效果(Mano-P 1.0-4B):

Cider W8A8 相对 MLX 原生 W4A16 实现 1.4x–2.2x 的 prefill 加速,同时保持 decode 速度基本不变。

兼容性: Cider 可用于任意 MLX 模型,并非 Mano-P 专属。同时提供对 mlx_vlm 的非侵入式兼容补丁,修复了 Qwen3-VL 多图推理中的若干问题。

条件编译: INT8 TensorOps 扩展仅在 Apple M5 及以上芯片完整构建;M4 设备安装后以纯 Python 模式运行。

Cider: github.com/Mininglamp-…

Mano-AFK:端到端应用构建

Mano-AFK 是基于 Mano-P 的端到端自动化应用构建工具。从一句自然语言描述出发,自主完成需求澄清、架构设计、代码生成、部署、测试与修复,最终交付可运行的应用。

其中 E2E 测试环节默认以 Mano-P 为本地视觉模型后端,驱动真实浏览器完成 GUI 自动化测试。测试失败时自动定位缺陷、修复代码并重新验证,形成完整的"构建—测试—修复"闭环。

CUA Benchmark 数据

测试环境:Mano-P 4B 运行于 MacBook Pro M5(16GB 统一内存),100 条任务覆盖 5 个由 Mano-AFK 自动构建的 Web 应用。

- W8A16:58.0% 准确率,平均 6.1 步,Prefill ~1,253 tok/s

- W8A8(Cider):54.0% 准确率,平均 6.93 步,Prefill ~1,453 tok/s

注:在 16GB 设备上,W8A8 需同时保留原始权重与 INT8 权重,内存压力可能影响整体表现。建议预留模型体积之外 4GB 以上空闲内存以发挥 W8A8 完整优势。

开源地址: github.com/Mininglamp-…

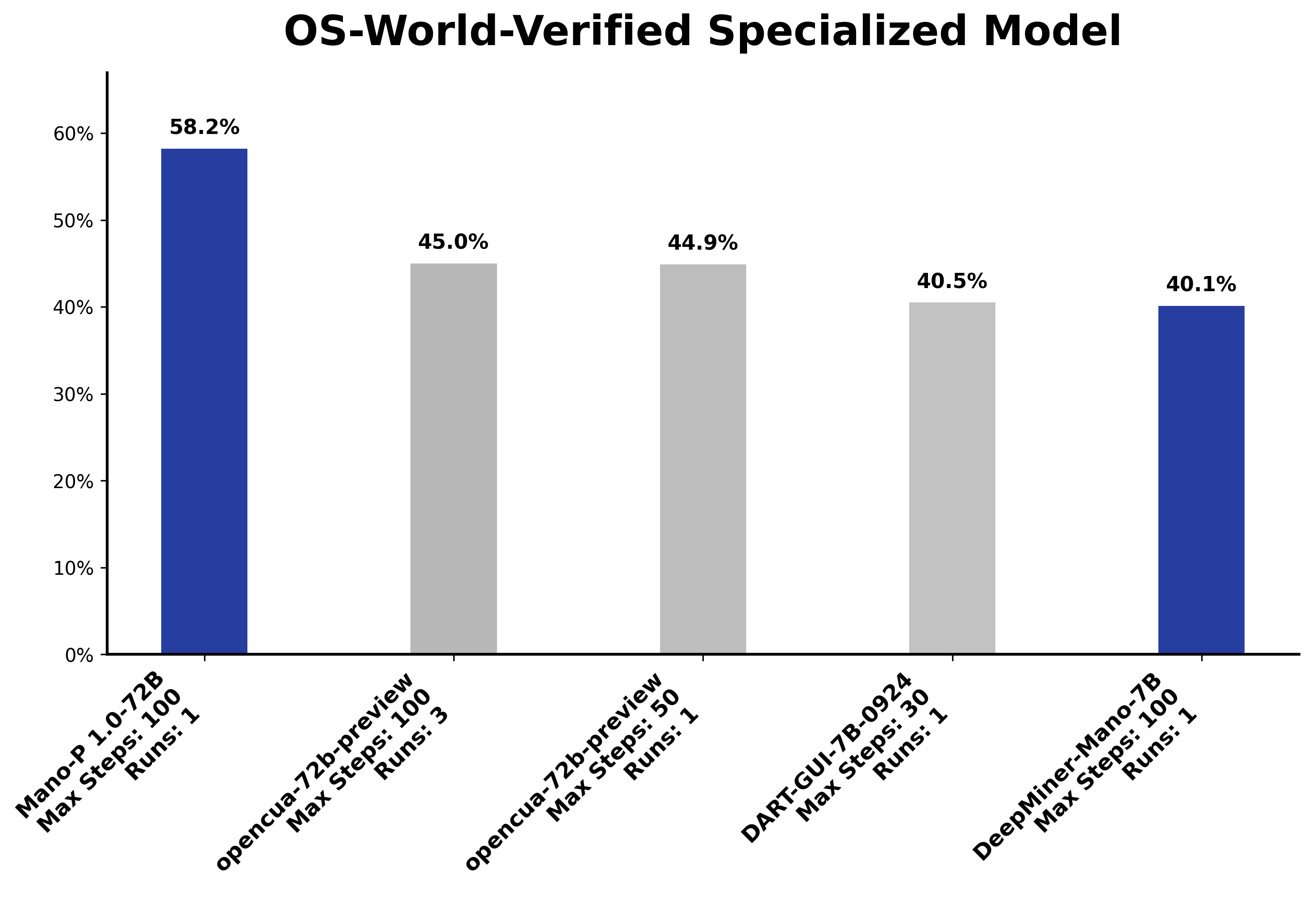

Mano-P 整体基准测试成绩

Mano-P 系列模型在多项权威基准测试中取得了优异表现:

- OSWorld(专用 GUI Agent 模型排名):Mano-P 1.0-72B 取得 58.2% 成功率,在所有专用 GUI Agent 模型中排名第一

- WebRetriever Protocol I:Mano-P 1.0 取得 41.7 NavEval 分数,表现优于同类方案

注:以上数据来自 Mano-P 1.0-72B 模型。本次开源的本地模型为 4B 参数版本,专为端侧部署优化。

快速开始

# 安装 CLI 工具

brew tap Mininglamp-AI/tap

brew install mano-cua

# 环境检查与本地模型安装

mano-cua check

mano-cua install-sdk

mano-cua install-model

# 以本地模式运行任务

mano-cua run "打开 Safari 并搜索 Python" --local

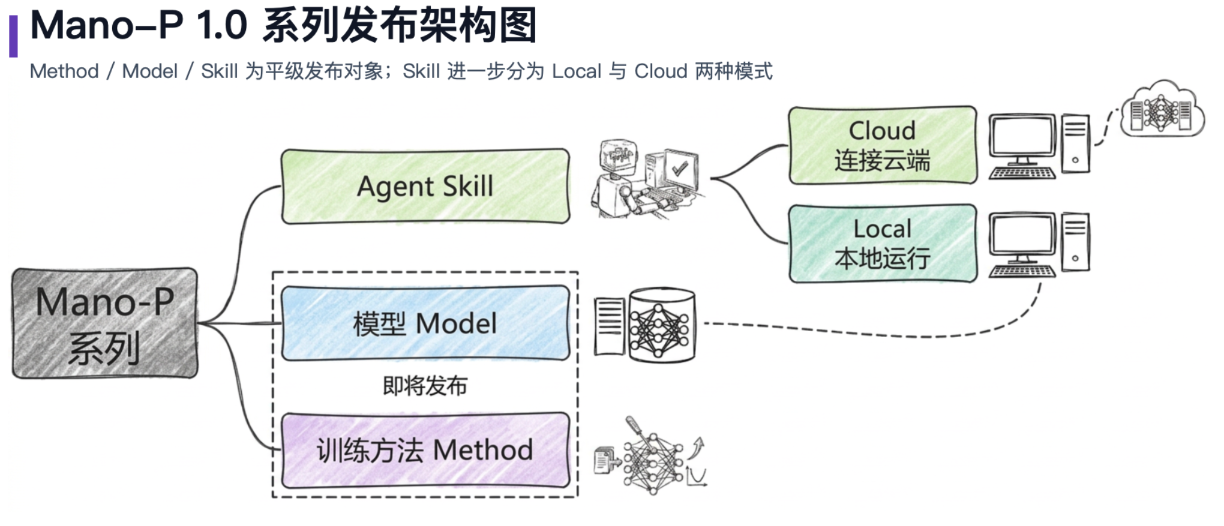

开源计划全景

Mano-P 采用分阶段开源策略,面向不同开发者群体:

- 第一阶段(已发布):Mano-CUA Skills,面向 Agent 爱好者

- 第二阶段(本次发布):本地模型 + Cider SDK,面向高安全需求开发者

- 第三阶段(即将发布):训练方法、剪枝和量化技术,面向有定制化模型需求的开发者

相关链接

- GitHub 主仓库:github.com/Mininglamp-…

- Cider SDK:github.com/Mininglamp-…

- Mano-AFK:github.com/Mininglamp-…

- 技术论文:arxiv.org/abs/2509.17…

- HuggingFace 模型:huggingface.co/Mininglamp-…

- ModelScope 模型:modelscope.cn/models/Mini…

- 许可证:Apache 2.0

欢迎体验 Mano-P 本地模型,点亮⭐,也欢迎通过 GitHub Issue 和 Discussion 与我们交流。