参数规模:万亿数字背后的工程含义

显存占用:参数多不等于跑得动

万亿参数听起来很爽,但你得先问自己一个扎心的问题:你的机器跑得动吗?按 FP16 精度加载万亿参数模型,显存需求大约是 200GB。这是什么概念?

H100 单卡 80GB,你需要三张才能勉强装下,推理吞吐和延迟还要受多卡通信拖累。消费级 RTX 4090 24GB?别做梦了,那张卡连 7B 参数的 FP16 都喂不饱。

这不是硬件不够好,而是万亿参数的物理体积本身就在那儿摆着。你可以在算法层做量化、剪枝、蒸馏,但硬件的物理约束不会因为「听说效果好」就自动消失。

⚠️ 踩坑提醒:量化能降显存,但会牺牲精度。INT4 推理在部分任务上掉点明显,先跑评测再上生产,别到时候精度崩了再回来哭。

硬件门槛对照表

| 精度 | 万亿参数显存需求 | 代表硬件 | 能否单卡 |

|---|---|---|---|

| FP16 | ~200GB | H100 80GB × 3 | 否 |

| INT8 | ~100GB | H100 × 2 或 A100 40GB × 3 | 否 |

| INT4 | ~50GB | A100 40GB 或 3090 × 2 | 勉强 |

表格里最后一行说「勉强」,但这个「勉强」是有代价的——你得接受精度损失、接受推理速度被通信带宽拖慢、接受运维复杂度翻倍。所以当你看到「INT4 就能跑」这种说法时,先问一句:跑得动和跑得好是两码事。

三张H100……我连一张A100都没见过

35 倍推理加速:数字从哪来,有没有水分

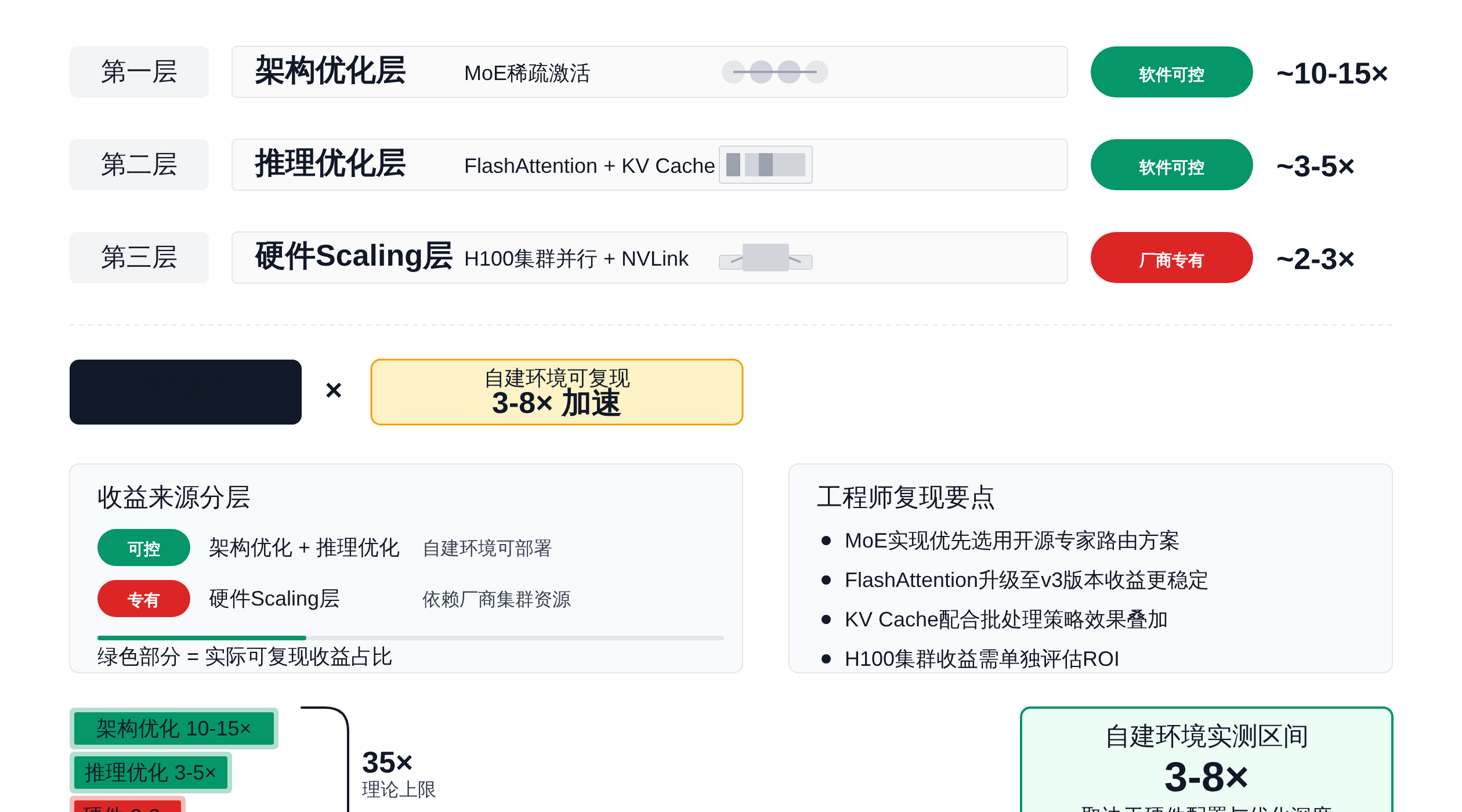

加速来源的三层拆解

官方宣传的 35 倍加速,听着很诱人,但你得搞清楚这个数字是怎么来的。通常这类加速来自以下几层叠加:

架构优化:DeepSeek V4 大概率沿用了 MoE(Mixture of Experts)稀疏激活路线,推理时只激活部分专家网络,理论上能大幅减少计算量。

这是一个工程上值得关注的信号——稀疏激活意味着每次推理的成本不是和总参数量成正比,而是和实际激活的参数量成正比。

推理优化:FlashAttention-2/3、KV Cache 压缩、批处理策略升级,这些软件层面的优化在你自己的硬件上能部分复现。

硬件 Scaling:新模型配合新一代 GPU 集群,单卡算力本身就在涨。这个加成是人家集群带来的,你在自己的机器上感受不到。

正文图解 1

前两层是「软件优化」,你有机会在自己环境里复现一部分;第三层是「硬件加成」,脱离他们的集群就没了。所以下次看到厂商的宣传数字,先给自己降个预期。

在你的机器上,能快多少?

如果你用消费级显卡 + V3 基线,V4 优化版的实测加速大概在 3-8 倍这个区间——没那么夸张,但也不差。

35 倍大概率是在 H100 集群上测出来的,别拿这个数字做本地部署的预算,否则你的 leader 问你「为什么 GPU 预算这么高」,你都不知道怎么解释。

📌 关键判断:加速效果取决于你的硬件环境和优化水平。不要用厂商宣传的峰值数字做自己的性能规划,中位数更有参考价值。

我跑出来3倍,同事说他跑了7倍,问题出在哪

真实落地成本:显存、延迟、部署门槛一个都跑不掉

三个工程约束,一次说清楚

延迟:本地推理延迟不止看模型,还要看显存带宽、批处理大小、上下文长度。100K 上下文的单次推理,延迟轻松破 30 秒——这还是在硬件配置不错的情况下。

如果你做的是实时对话场景,这个延迟用户肯定留不住。

显存:量化到 INT4 确实能跑,但部分任务精度损失肉眼可见。实测 HumanEval 掉 5-8 分不是小数目,尤其是代码生成这类对精度敏感的任务。

你调了一晚上模型,结果生成的代码多了三个 bug,这就本末倒置了。

部署门槛:V4 初期文档稀缺,GitHub issues 响应慢,生产环境出 Bug 只能自己啃。

这类风险要算进换模型的成本里——你以为换个模型只是跑个命令,实际上你可能要在接下来两周每天凌晨两点看日志。

⚠️ 踩坑提醒:新模型发布后 2-4 周通常是 Bug 高峰期,生产环境追首批大概率翻车。如果不是业务压力特别紧,建议等第一个 patch release 再上。

这三个约束不是要劝退你,而是让你在做决策时有完整的坐标系。不能只看到「35 倍加速」的甜,忽略了显存、延迟、部署这三道坎。技术选型最怕的就是只看到收益,没算进成本。

当时说换模型能提效,现在怎么又变成我背锅了

V4 的真正机会:不是所有场景都值得换

场景推荐矩阵

选模型不是选最贵的,是选最对的。V4 有它的优势场景,也有它的不适配场景。以下矩阵基于公开信息和工程经验整理,供你做初步判断:

| 场景 | V4 推荐度 | 理由 |

|---|---|---|

| 大上下文(>100K)任务 | ⭐⭐⭐⭐⭐ | 长文本处理是 V4 的核心优势之一 |

| 代码生成 / 数学推理 | ⭐⭐⭐⭐ | DeepSeek 系列在 HumanEval 上基准较强 |

| 成本敏感的在线服务 | ⭐⭐⭐⭐ | 开源 + 本地部署,长期成本低于 API |

| 快速迭代的早期项目 | ⭐⭐ | 生态不成熟,调试成本高 |

| 实时对话 / 低延迟需求 | ⭐⭐⭐ | 取决于部署硬件和优化程度 |

这个矩阵不是死的,你的实际场景可能落在两个星之间。关键是把「推荐度」理解成「收益/成本比」——如果你的场景在五星档,那换 V4 的收益大概率覆盖迁移成本;

如果在两星档,劝你别折腾,老老实实继续用 V3。

技术选型最忌讳的就是「追新」心态。新不一定好,适合才重要。你手里有个用顺手的锤子,不等于看到螺丝钉就该换电钻。

行,我承认V4很强,但我的场景真的不需要它

现在该做什么:工程视角的行动清单

行动一:先跑 V3 基线

别急着换 V4。先在现有硬件上跑 V3,测出延迟、显存占用和任务精度的基线。这个数据是后面对比的唯一参照,没有基线就没有判断——你连自己现在在哪儿都不知道,换完之后怎么评估收益?

基线测试要跑真实业务任务,不是跑标准 benchmark。你的业务数据才是最好的试金石,纸面分数和你业务的实际表现往往差很远。

行动二:蹲官方 GitHub 和 release note

V4 正式版发布后,第一时间关注 release note 里的已知问题、硬件需求和 breaking changes。

提前知道坑比踩了坑再填快三倍——这句话我再说一遍,因为太多人吃亏在「先上手再说」。

GitHub issues 区也是宝库,虽然响应慢,但很多问题早就有人踩过了。搜一下比你发帖等回复快。

行动三:准备好评测模板

有了评测模板,V4 出来后可以快速跑出一手数据——不是跑分,是跑你实际业务里的任务。评测模板要覆盖你的核心场景、典型输入、预期输出和打分标准。

这个模板不只能测 V4,之后测任何模型都能用。建一次,长期受益。

好了,我先回去跑基线了,有结果再来汇报

DeepSeek V4 的发布是件好事,说明开源模型的能力边界还在往前推。但好事归好事,你自己的项目该不该追,要算清楚收益和成本再做决定。

别被「35 倍」这个数字冲昏了头,先问自己三个问题:我的硬件能不能跑?我的场景值不值换?我的团队能不能 handle 迁移成本?

想清楚这三个问题,你自然就有答案了。

延伸入口

- 原文归档:tobemagic.github.io/ai-magician…

- 公众号:计算机魔术师

参考文献

[1] 原始资料[EB/OL]. www.cecs.org.cn/xhbz/. (2026-04-24).