02 | 那个2.7%到底是怎么算出来的

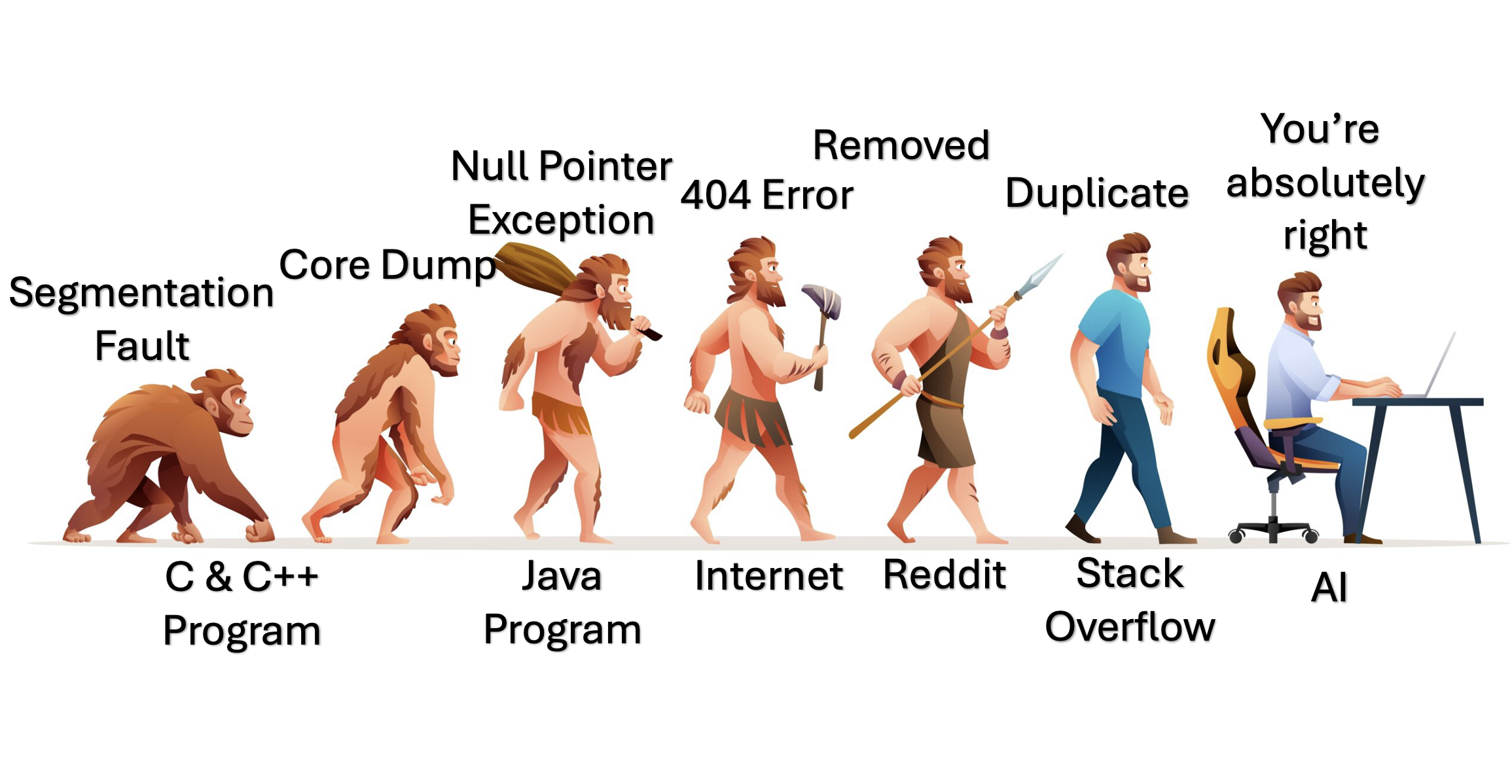

先把这个数字本身说清楚。2.7%不是哪个模型跑了一场考试得出来的,它是Arena Elo评分系统——一个类似国际象棋排名的机制——对全球顶尖模型进行持续盲测的结果。

规则很简单:每次测试,系统随机把两个模型提交给人类裁判,让他们盲选哪个回答更好,然后根据投票结果动态更新Elo分数。

截至2026年3月,美国Anthropic的Claude Opus 4.6以1503分排在第一,中国Dola-Seed-2.0-preview以1464分紧追其后,相差39个Elo点,折算下来约2.7%。

从2023年5月的300多分差距到如今的2.7%,这个曲线本身就是一个技术奇观。

行,这个差距我扛了

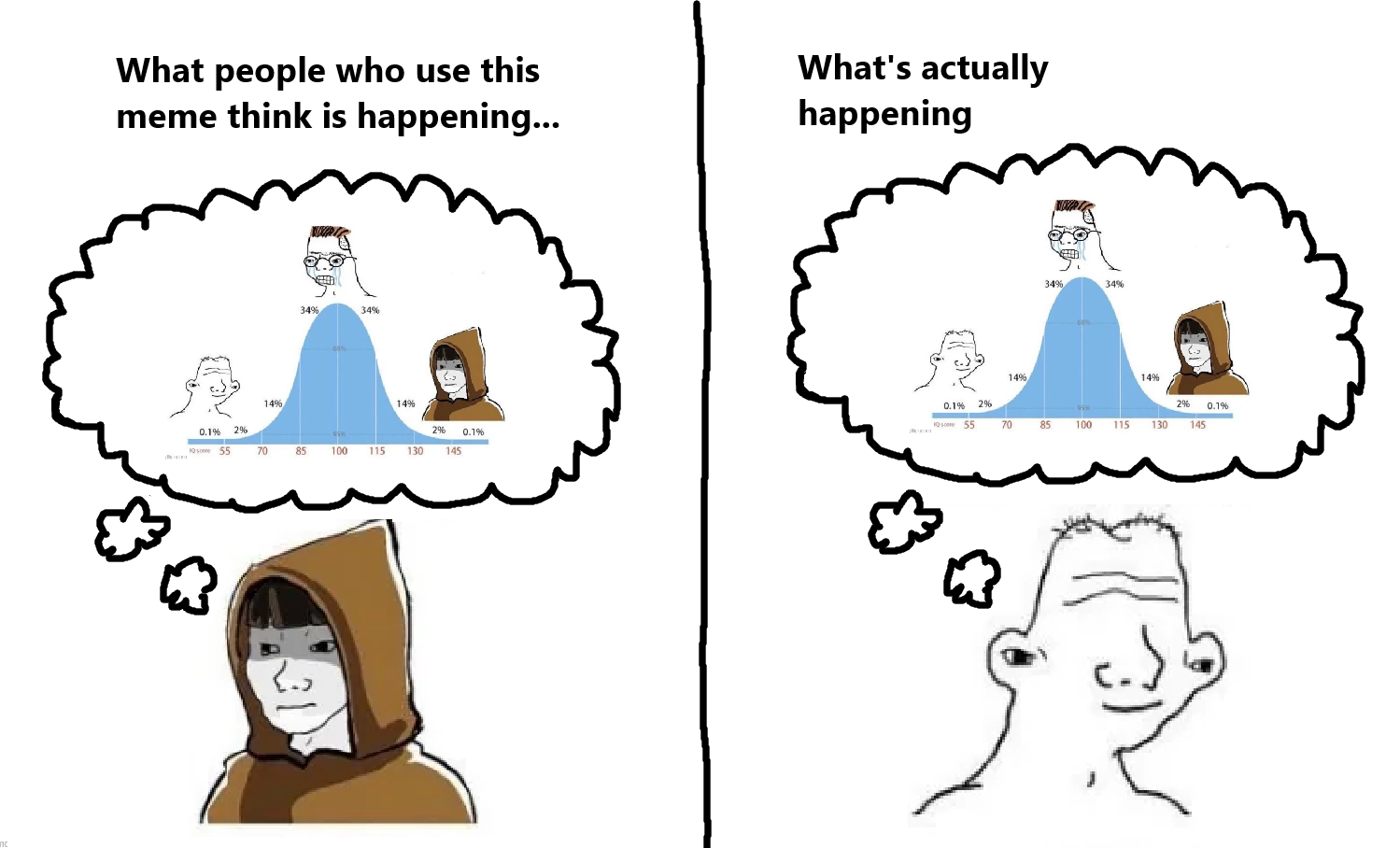

但这里有个前提必须说清楚:benchmark追平不等于通用能力全面对等。

斯坦福报告自己在结论里也写了「锯齿状智能」(jagged intelligence)这个词——模型在不同任务上的能力分布本身就是高度不均匀的。

一个模型在数学推理上拿了97分,不代表它在客服对话、图像生成或者你二舅查玉米价格这件事上也有97分的表现。2.7%是Arena这个特定竞技场的积分榜,不代表AGI已经到来。

把时间线拉长看这个差距是怎么缩过来的,更有意思。2023年5月,美国最好的模型和国内最好模型的差距是300多个Elo点,那会儿国内圈子一片「望尘莫及」的自我怀疑。

2025年2月,DeepSeek-R1横空出世,在关键基准测试里追到只差0.4%——这是中国AI第一次真正意义上的「追平」,直接引发了NVIDIA股价单日暴跌18%。

到了2026年3月,这个差距维持在2.7%,基本已经在统计误差的边缘来回摩擦。

更值得注意的结构性变化是:截至2026年,全球TOP10模型里中国占据了四席,分别是阿里巴巴、DeepSeek、清华大学和字节跳动。

OpenAI、Anthropic、Google、xAI、阿里——这五家站在AI之巅的机构,中美各半,不再是美国公司的独角戏。

Stanford HAI, AI Index Report 2026

但是,这个「五五开」是模型性能榜单上的五五开。你二舅的手机上大概率没有装这四家公司的任何一个应用;就算装了,他也不知道该问它什么。这两件事之间的落差,才是这篇长文真正想聊的。

来源:digitalinasia.com

03 | DeepSeek们到底做对了什么:一场技术上的「花小钱办大事」

如果要提名这一轮中国AI追赶里最让硅谷睡不着的技术突破,DeepSeek-R1绝对是首选。

这个模型2025年1月发布,当时炸出圈的不是它的技术论文,而是一个数字:训练成本不到600万美元,用了约两个月,开发团队规模极小——远低于OpenAI、Anthropic那种几千人的工程团队。

但更炸的是它的Benchmark成绩。DeepSeek-R1在数学推理测试MATH上拿到了97.4%的得分,与OpenAI o1相当,显著超越同类竞品。

在AIME数学竞赛题上,DeepSeek-R1的通过率直接飙到了86.7%。MIT Technology Review, January 2025

600万美元对6亿美元,这是DeepSeek-R1和GPT-4训练成本的对比,不是精确数字,但量级差异足以让整个行业重新审视一件事:大模型训练到底需不需要花那么多钱。

DeepSeek团队用行动证明,在特定架构假设和充足开源生态支持下,用不到十分之一的预算做出接近前沿水准的模型是可行的。

这个结论本身就是一种「降维打击」——不是打击竞争对手的市场,而是打击了「烧钱才能追前沿」这个行业共识。

紧接着是2026年3月发布的DeepSeek-V4。这个版本用了一个内部代号MODEL1的新架构,参数量约一万亿级别,API定价做了大幅压缩。

斯坦福报告引用了一个让海外开发者「破防」的数据对比:同样一个复杂任务,使用GPT-5的API费用大约是15美元,而DeepSeek不到0.5美元——差了约三十倍。

这不是简单的价格战,这是一套新的成本逻辑——用更低的推理成本实现接近的性能,然后在性价比这个维度上碾压。

这和传统制造业的「中国制造」逻辑异曲同工:不是造不出好东西,而是在保证质量的前提下把成本结构彻底重写。

阿里巴巴的Qwen系列讲的是另一个故事——开源生态的规模效应。截至2026年3月,Qwen系列全球累计下载量达到了9.42亿次,这个数字比第二名到第九名竞争对手的下载量总和还要多。

Qwen3.5比前代快了8倍,成本降低了60%,成了亚洲和中东地区开发者做本地化AI应用的首选基础模型。Gizmochina, April 2026

字节跳动的进展没有大张旗鼓宣传,但2025到2026年间开源模型发布量翻了8到9倍这个数字,本身就是一个信号。

百度2024年在Hugging Face上几乎没有存在感,到2025年发布了超过100个模型。这些不是数字游戏,是工程能力的批量释放。

然后是2026年4月的最新消息——Z.ai发布的GLM-5.1。

这个模型在SWE-Bench Pro(复杂软件工程任务测试)上拿到了58.4分,比上一代GLM-5的55.1分有明显提升,也高于Z.ai方面列举的GPT-5.4、Claude Opus 4.6和Gemini 3.1 Pro的分数。

更关键的是,GLM-5.1使用了MIT许可开源,意味着任何人都可以本地部署并修改代码,这对金融、医疗和国防等对数据主权有严格要求的行业来说,是一个不可忽视的选项。

DeepSeek、Qwen、GLM——这三个来自中国的开源模型,正在重新定义全球开源AI的格局。

它们不仅在追赶,而且在自己的生态位里建立了不可替代性:DeepSeek在推理成本,Qwen在开源社区规模,GLM在软件工程自主性。

我宣布,以后代码review也用DeepSeek审查

来源:chinanews.com.cn

04 | 但算力命门还在美国人手里:芯片的故事没那么简单

聊完模型层面的追赶,必须把镜头移到芯片这个更硬核的战场。模型是面子,芯片是里子,而这个里子目前还没有追上来。

看一下最具体的数字对比。NVIDIA Blackwell Ultra GB300,官方参数是15 petaflops FP4算力,配288GB HBM3e内存,带宽8 TB/s。

华为Ascend 950PR,中国这边目前最强的答卷,1.56 petaflops。算下来,华为最先进的商用芯片算力大约是NVIDIA旗舰产品的十分之一。

这不是某一家的产品对比问题,而是整个制造体系的代际差距。

Bernstein Research分析师Stacy Rasgon有一句很直白的评价:「在芯片层面,华为基本上相当于NVIDIA三年前的位置。

」三年前——那时候NVIDIA的主力产品还是H100系列。这句话听着让人难受,但它描述的是现实。Bernstein Research / CFR, 2026

制造良率才是这个差距里最让人睡不着的部分。芯片行业有句话叫「良率为王」——你设计得再好,造不出来也是白搭。

华为和SMIC(中芯国际)的合作面临一个结构性问题:良率估计在5%到20%之间,而NVIDIA在Blackwell上的良率推测在60%到80%。CFR Analysis, 2026

做个简单的数学:一个12英寸晶圆能切出多少可用芯片,直接决定了你的成本结构。良率差三到四倍,在商业竞争里就是生与死的区别。

同时,SMIC目前最先进的制程是7nm,而台积电已经稳定量产3nm,2nm制程也在推进中——这个差距是物理层面无法靠时间和努力弥补的两到三代工艺节点。

但这里有一个反直觉的「出口限制悖论」值得关注。

NVIDIA在中国市场被限制销售H100和H200这些顶级芯片,唯一合法在售的是H20——一个被阉割过的版本,专门为了满足出口管制要求而设计的缩水型号。

而Ascend 950PR的实际推理性能,恰好是H20的2.8倍。TrendForce, March 2026

这个数字意味着:美国越限制高端芯片流入中国,就越给华为创造一个受保护的国内市场。

本土企业没有选择,只能买华为的Ascend系列,而这个「只能」反过来给华为提供了市场验证和收入,支撑它的研发投入。

禁令本来想遏制中国AI发展,结果同时帮华为建了一个没有进口竞争的国内市场——这是标准的「搬起石头砸自己脚」案例,只不过这石头是美国自己搬的。

当然,华为的 roadmap 上写着:2027年Ascend 960要达到NVIDIA Blackwell同等级别算力,2028年目标4 ZettaFLOPS FP4性能。

这个目标如果实现,差距会显著缩小——但这个 roadmap 上的每一个节点,都依赖SMIC在制造工艺上的突破,而这些突破恰恰是美国出口管制设备正在阻止的事情。

这锅我不背,设备清单在那边

芯片领域还有两个经常被忽视的软肋需要补充:EDA工具链和台积电依赖。全球几乎所有顶尖AI芯片——包括NVIDIA、AMD、Google、苹果——都依赖台积电制造。

台积电目前占据全球AI训练芯片代工产能的60%以上,这不是一个商业问题,这是一个地缘政治风险的源头:如果台积电制造端出现任何变量,全球AI供应链都面临瘫痪风险。

这才是这场算力竞赛里最脆弱的底层假设。

05 | 人才逆转:89%这个数字比2.7%更让人睡不着

模型可以追平,芯片可以追赶,但人才流动的方向一旦开始逆转,恢复起来需要的时间远比技术追赶要长。而斯坦福报告里最让人不安的数字,恰恰不是2.7%,而是89%。

具体数字是这样的:自2017年以来,全球AI学者移居美国工作的数量下降了89%。

注意这不是「减少了89%的中国学生赴美留学」,而是「已经移居美国、并且在AI领域工作的从业人员」的流量数据在逆转。

而且这89%里面有80%发生在过去一年——也就是说,这场人才流失的加速度在最近12个月里反而在增加,而不是减少。Stanford HAI, AI Index Report 2026

这是一个非常反直觉的事实。美国的AI投资在2025年是2859亿美元,中国是124亿美元——美国在私营AI投资上是中国的23倍。

资金量级差了将近四分之一万亿,但人才却在往相反方向流动。这组数据放在一起看,是一个非常清晰的信号:美国公司手里拿着大把的钱,但越来越难买到最顶尖的脑袋来做这些事。

DeepSeek背后有一个特别有代表性的细节:这个团队在2025年初发布的五篇奠基性论文,几乎所有作者都是在中国本土完成教育和训练的研究人员,没有一个是「从美国实验室回流」的叙事样本。

DeepSeek从头到尾都是中国本土培养的团队做出了世界前沿成果——这件事本身就是一个里程碑式的人才信号。

与此同时,中国AI的科研产出在数量和质量上都在快速提升。2025年全球AI论文里,中国作者贡献了23.2%,美国是12.6%,中国领先。

在引用次数这个质量指标上,中国同样领先——这个数字比发表数量更有说服力,意味着中国的研究不只是发表得多,而是发表的成果被同行实际引用得多。

AI专利方面,中国机构更是占全球的69.7%。Stanford HAI, AI Index Report 2026

不过这里必须插一个「⚠️踩坑提醒」:论文数量领先不等于商业影响力领先。学术论文的引用率和商业产品的市场占有率是两套完全不同的评价体系。

一个国家的论文在arxiv上被引用一万次,和它的AI公司能不能做出在全球市场有竞争力的产品,这之间差了十万八千里。

中国的开源模型和学术研究很强,但在基础模型创新和商业化生态上,和OpenAI、Anthropic、Google的差距并没有在数字上看起来那么乐观。

论文发了一万篇,产品能打才是真本事

还有一件值得单独说的事:中美AI竞争不是「二人转」。斯坦福报告里有一个容易被国内媒体选择性忽略的数据点——韩国以人均专利申请量拿下了全球「AI创新密度」冠军。

不是中国,不是美国,是韩国。这意味着全球AI竞赛已经进入了多极化竞争阶段,「大国博弈」的二元叙事正在掩盖更多元、更复杂的力量博弈。

人才流向逆转这件事,对普通工程师和在校生来说,才是真正值得警觉的。

与其盯着2.7%这个数字转发庆祝,不如想清楚一件事:如果过去「去美国做AI」是默认正确选项,现在这个选项正在变得越来越贵、越来越难、越来越没有性价比——这对你的职业规划意味着什么?

风险提示与免责声明:本文仅基于公开资料讨论公司公告、技术投入与行业信号,用于研究和信息分享,不构成投资建议,也不作为投资依据。

06 | AI「偏科」有多严重:能拿奥数金牌,却读不懂时钟

好,2.7%追平了,接下来我们来做一件扫兴的事:把那个闪闪发光的分数翻过来,看看背面写着什么。

Stanford报告给了一种叫「锯齿状智能」(Jagged Intelligence)的描述。

这个词翻译成人话就是:当前AI的能力分布不是一条平坦的地平线,而是像被地震撕裂过的山脊——某些地方高耸入云,另一些地方直接塌成峡谷,而且峡谷和山峰之间的距离短得让人心慌。

最经典的证据来自两个测试。

第一个是国际数学奥林匹克竞赛。

Google的Gemini Deep Think模型在2025年的IMO里拿到了35分(满分42),金牌级别,用时4.5小时,全程用自然语言完成端到端的数学证明。这意味着什么?

意味着它在解决高中竞赛数学这个任务上,已经超过了地球上99.9%以上的人类,包括大多数数学老师。

第二个测试叫ClockBench。

你可能会问,ClockBench是什么。顾名思义,这个测试专门测模型能不能正确读取指针时钟上的时间。答案:一个普通小学三年级学生花三秒钟就能完成的事情,当前最顶尖模型的正确率是50.1%。

50.1%。

人类的平均水平是90.1%。

也就是说,AI在数学奥赛上摘金牌,在读时钟上抛硬币——而且是字面意义上的抛硬币,因为50.1%就是瞎蒙的准确率。

报告里那句话写得特别损,我必须原文引用:「AI能赢得数学奥赛金牌,却仍然无法可靠地读取时间。

」(AI can win gold at the International Mathematical Olympiad, yet still cannot reliably tell the time.)Stanford HAI, AI Index Report 2026

这不是调侃,这是当前AI真实的能力边界写真。

我的模型在MATH上97%,但它不知道现在几点了

为什么会出现这种「数学天才、时间盲人」的现象?

因为大模型的训练数据里,数学题是结构化的、有标准答案的、可验证的,但指针时钟是一种视觉常识——它需要把几何空间信息映射到时间语义,而这个映射在互联网上训练数据稀疏,模型学到的是文字描述时间的能力,而不是真正看图读时间的能力。

换句话说:刷题刷出来的,刷不出生活常识。

这个「锯齿状智能」的诊断比单纯说「AI还不行」要深刻得多。

它告诉我们:AI不是全面弱,而是强的地方极强、弱的地方极弱,且强弱之间的切换成本并不低——你没法靠给模型多做几道时钟题就让它的常识推理能力整体提升,就像你没法靠多做数学题让一个数学家变成生活能手。

另一个让「锯齿状智能」这个诊断更加立体的数据来自AI Agent领域。

AI Agent——也就是能自主在电脑上执行多步骤任务的那种AI——在真实计算机任务上的成功率,在过去18个月里从12%跃升到了66%。距离人类基准只差6个百分点。

这个数字非常漂亮。而且在网络安全任务上,AI Agent的解决问题成功率从2024年的15%飙升至93%——这是真正的工业级应用场景,不是Benchmark游戏。

但只要把AI从数字世界拽进物理世界,情况就急转直下。机器人在软件仿真环境里的任务成功率可以达到89.4%,漂亮得像个乌托邦。然后你让它去叠衣服、洗碗这种真实家务任务,成功率骤降至12.4%。

12.4%。

这就是斯坦福报告所说的「整洁的实验室与凌乱的家居环境之间,隔着一道难以逾越的鸿沟」。Stanford HAI, AI Index Report 2026

叠衣服这件小事背后需要的泛化能力——拿起不同材质、不同形状的衣物,判断最优折叠方式,在非结构化空间里实时调整动作——比大多数AI研究者在实验室里解决的问题都要难。

而我们每天都在期待AI「颠覆」制造业、「改变」服务业,却很少有人认真面对这个12.4%的事实。

当然,AI圈子里有一种特有的乐观主义叫「这次不行,下次一定行」。这没错,技术在进步,12.4%不代表永远是12.4%。

但作为一个工程师,我需要知道的是:这个12.4%背后,有多少投资砸进去了?有多少公司在PPT里画着「AI+机器人」的蓝图,却回避了实验室数据和产线现实之间那道鸿沟?

PRD上写的是「智能家居助手」,实测是「高级定向闹钟」

所以回到2.7%这个数字。

我们现在知道了它的另一面:2.7%是在Benchmark这个特定战场上的成绩,而这个战场的规则对AI极度友好——题目有标准答案,评分有明确规则,环境完全可控。

真实世界的任务没有标准答案,环境永远乱七八糟,而你的模型还要应对你二舅用它查玉米价格时随机发生的各种操作失误。

这不是说2.7%是假的。它是真的,但它只是故事的一面。

07 | 渗透率真相:53%的全球普及率,掩盖了什么样的数字断层

接下来我们把镜头从技术参数挪开,看看一个更让人心里发毛的问题:就算AI再强,普通人的生活里AI到底渗透到了什么程度?

Stanford报告给了一个看起来很漂亮的数字:生成式AI在推出三年内,覆盖了全球53%的人口。

53%。超过一半。普及速度比PC快,比互联网快——人类历史上还没有哪项技术以这个速度渗透到全球人群。

数字很好。然后我们来做一个简单的拆解,看看这个53%到底是怎么构成的。

第一层:企业端。88%的企业已经在业务流程里部署了某种形式的AI。这个数字在报告原文里没有太多解读空间,它就是一个事实——企业,特别是科技公司和大型金融机构,已经把AI嵌入了工作流。

第二层:高等教育群体。45%的大学生日常使用生成式AI——写作业、查资料、做头脑风暴。这个比例在高收入国家更高。

第三层:K-12教育。80%的美国高中生和大学生在用AI完成学业任务,但只有50%的中小学制定了AI使用政策,且只有6%的教师认为这些政策是「清晰的」。

Stanford HAI, AI Index Report 2026

80%在用,6%说规则清晰——这个数字组合翻译成人话就是:学生在裸奔式使用AI,老师在裸奔式不管,最后交上来的作业鬼知道有多少是AI写的。

好了,现在说第四层。这一层没有出现在报告的显眼位置,但它才是53%这个数字最大的谜团:那些没有被统计进去的人。

全球互联网用户约53亿,生成式AI渗透53%,意味着约28亿人在用。但剩下那25亿人呢?

他们的手机里没有生成式AI应用,他们的生活和工作场景里没有AI介入,他们甚至不知道「生成式AI」这个词具体是什么意思。

而这25亿人,不均匀地分布在两个地方:全球南亚次大陆(比如印度农村、孟加拉国偏远地区)和撒哈拉以南非洲。

这些地区的AI基础设施几乎为零,智能手机普及率在50%以下,更别说4G/5G覆盖和云计算访问能力。

这就是斯坦福报告里提到的「主权AI」概念的核心关切之一:44个国家正在建造国家支持的超级计算集群,这是好消息。

坏消息是,剩下的150多个国家正在这场竞赛里被系统性甩开,而且一旦甩开,由于数据基础设施的复利效应——越没有数据,模型越不准确,越不准确,使用率越低——这个差距几乎不可逆。

「数字鸿沟」这个词我们从Web2.0时代就开始听,但AI时代的数字鸿沟比互联网时代的危害更大,因为互联网时代的掉队者失去的是信息获取的便利,而AI时代的掉队者失去的是参与数字经济的门票。

回到开头那个场景。2026年4月13日,中关村的工程师们在朋友圈转发2.7%这个数字,配文「牛×」。

同一天下午,你二舅从玉米地里回来,手机是三年前买的红米,屏幕碎了三分之一,他问你能不能帮他查查今年玉米价格走势。

他这辈子没用过ChatGPT,没用过DeepSeek,没用过Kimi,甚至不知道这些东西存在。

这两个场景在物理空间上可能只隔了500公里,在数字空间里隔了整整一个技术时代。

53%的渗透率是全球平均,它既包含了硅谷的日活用户,也包含了印度农村偶尔能蹭到4G信号的农民——这两个群体的「用AI」完全不是一个意思,而当我们用同一个「渗透率」指标把它们打包报告时,真实的数字断层就被平均数掩盖了。

我们村的大爷连4G都没有,更别提什么生成式AI了

报告里还有一组对比值得单独拿出来说说,因为它戳中了一个很微妙的社会心理问题:专家和普通大众对AI的态度存在巨大分歧。

73%的AI领域专家对AI改变工作这件事持正面态度。

23%的普通大众持同样态度。

这个差距不是无知造成的。

普通大众不是不理解AI是什么,他们理解,而且他们有更充分的理由感到不安:他们的工作最有可能被替代,他们的技能最有可能贬值,而AI专家们恰恰是那群在替代别人工作这件事上拥有主动权的人。

这和经济学里的「乐观主义者的偏见」还不太一样。这是一个结构性问题——利益相关者越处于替代别人有利位置,他评估替代风险时的主观概率就越低。

所以当你看到「73%的AI专家支持AI发展」这个数据时,先别急着感动,想想这73%里面有多少人是在用AI写代码、研究基因、筛简历,而他们的结论是「AI对社会是好的」。

来源:chinanews.com.cn

08 | 就业冲击最真实的那群人:22-25岁的开发者去哪了

好了,聊完渗透率,我们来聊一个真正的雷区:AI对就业市场的冲击,而且我们不聊抽象的影响,我们聊具体的人。

Stanford报告显示了一个让所有年轻开发者看了心里一沉的数字:22至25岁这个年龄段的软件开发人员就业率,自2024年峰值以来下降了近20%。

20%。

而同期,年长从业者的就业率不跌反升。

这个对比太刺眼了。AI替代的竟然不是「经验丰富的老师傅」,而是「刚入行的年轻人」。Stanford HAI, AI Index Report 2026

这和常识认知完全相反。大多数人以为AI先替代的是重复性劳动——流水线工人、基础客服、录入员。但数据显示,软件开发领域第一个被替代的岗位是入门级开发者。

为什么?

因为入门级开发者的主要工作内容,恰好是AI最擅长的:实现明确需求的功能模块、编写标准化的CRUD接口、写单元测试、做数据格式转换。

这些任务有一个共同特点:有明确规范,可自动化测试,输出质量可量化评估——恰恰是LLM最拿手的场景。

而资深开发者在做什么?

理解模糊的业务需求、判断技术方案取舍、在遗留系统里做架构决策、和产品经理吵架、在生产故障里做高风险判断——这些任务需要的上下文理解、行业经验、直觉判断和风险承担能力,恰恰是当前AI最短板的地方。

所以出现了一个诡异但符合逻辑的现象:入门级岗位在消失,进阶路径在压缩,但资深岗位反而因为AI辅助工具的加持而变得更高效了——一个高级工程师配合AI编程工具,一个人可以干以前三个人的活。

「经验丰富的开发者用AI提效,刚入行的开发者找不到入门机会」——这个循环一旦形成,就会产生一个非常糟糕的自我强化效应:

没有入门级岗位 → 没有足够多的实战经验 → 无法积累资深技能 → 无法成为资深开发者 → AI替代范围扩大 → 更少的人能进入这个领域。

这不是危言耸听,这是当前已经开始发生的现实。

报告中还有一句特别扎心的话:企业调查中,计划裁员的规模已经超过了近期实际裁减的幅度。Stanford HAI, AI Index Report 2026

这句话的信息量很大。企业不是已经裁完了,而是正在「计划裁」。这意味着当前的就业数据是滞后指标——裁员公告发出到实际执行之间有时间差,而实际影响会在未来一到两年内逐步显现。

教育系统是另一个滞后指标。报告发现,4/5的美国高中生和大学生在用AI完成学业任务,但只有一半的中小学制定了AI使用政策——而且只有6%的教师认为这些政策是「清晰的」。

这意味着什么?意味着教育系统还没有教会学生如何与AI共处,而AI已经在代替学生完成工作了。

学生用AI写论文、做项目、debug,拿到学分毕业了,然后发现工作市场里等着他们的第一份工作已经被AI代替了。

教育系统和就业市场之间有一个越来越宽的裂缝,而这个裂缝正好落在22到25岁这个年龄段。

好消息是,中国和阿联酋已经开始将AI纳入K-12必修课程。Stanford HAI, AI Index Report 2026这是为数不多的主动应对,而不是被动挨打。

但这些课程的长期效果如何,需要至少十年才能看到结果。

对于正在读这篇文章的你——如果你是一个在校生,或者刚入职场的初级工程师——这意味着什么?

意味着「会用AI工具」已经不是一个加分项,而是一个默认前提。就像二十年前「会打字」不再是一个稀缺技能一样,「会用ChatGPT」在五年后也不会是。

真正稀缺的是AI替代不了的东西:对复杂业务场景的理解、跨领域的系统设计能力、以及在不确定性中做出判断的判断力。

这些东西没法靠学习AI工具获得,只能靠真实项目的积累——但问题是,如果你连入门的机会都没有,这些能力从哪来?

这个困局没有标准答案。但有一点是确定的:如果你现在还把「我会用AI写代码」当成核心竞争力,你需要重新审视这个判断了。

刚毕业那年,AI替代了我入职后第一个月的全部工作内容

09 | 透明度陷阱:最强模型披露最少,开源正在扳回一局

现在我们来聊一个很讽刺的事实:AI能力越来越强,我们对它的了解却越来越少。

Stanford报告里有一个指数叫「基础模型透明度指数」——它的作用是评估主流AI模型开发商披露了多少关于训练数据、训练过程、能力和局限性的信息。

上一年的平均分是58分。

2026年的平均分是40分。

分数在下降,而且是大跌——从58跌到40,跌幅超过30%。Stanford HAI, AI Index Report 2026

这是一个让人无法忽视的逆向进化:AI模型越来越强大,但开发商披露的信息越来越少。

具体到公司层面,数据更刺眼:IBM在这个透明度指数里拿了95分,领跑全场。xAI的Grok得了14分,Midjourney也是14分。

能力最强的模型——那些占据各大Benchmark榜首的模型——披露的信息最少。

这不是偶然。这是一套商业逻辑:模型能力是核心竞争力,核心竞争力靠保密来维护,披露细节等于给竞争对手递刀子。所以越是有商业压力的公司,越倾向于少披露。

但这个逻辑有一个副作用:透明度缺失正在变成AI应用落地的系统性风险。

想象一下这个场景:一家医院打算用某个大模型辅助诊断,它向模型供应商提出了一个合理的问题:「你们的训练数据里包含哪些医学影像?覆盖了哪些人群特征?有没有经过针对特定人种的偏差测试?」

如果对方回答「抱歉,这是商业机密」,这家医院该怎么决策?用吧,不知道里面埋了多少偏见雷;不用吧,竞争对手已经在用了。

这就是透明度缺失在真实应用场景里造成的问题——不是在论文里讨论,而是在采购决策里卡脖子。

报告还给了另一个让人心寒的数字:2025年发布的95个知名模型里,有80个没有公开训练代码。Stanford HAI, AI Index Report 2026

95个模型,80个没有训练代码。这意味着什么?意味着你在选择用哪个模型的时候,实际上是在相信开发商的口碑,而不是基于可验证的技术事实做决策。

在软件工程的任何其他领域,这种「黑盒采购」都是不可接受的——没有人会买一辆不披露刹车测试结果的汽车,没有医院会采购不披露临床试验数据的药物。

但AI领域这套标准还没建立起来,而监管的落后又进一步纵容了这种不透明。

在这个背景下,开源模型的优势就变得格外突出了——而且这里说的「开源」不只是「模型权重公开」,还包括可审计的架构、可复现的训练流程、以及社区驱动的安全性测试。

DeepSeek-R1是开源的,Qwen系列是开源的,GLM-5.1也是MIT许可开源的。这三个来自中国的开源模型,在透明度这件事上反而比很多闭源商业模型做得更好。

开源不等于安全——这里必须插一个严肃的⚠️踩坑提醒:

开源模型同样面临合规要求,特别是涉及数据跨境、特定行业监管(如金融、医疗、国防)的使用场景,开源许可并不自动解决合规问题。

一家美国国防承包商使用中国开发的开源模型,同样可能面临法律风险,不是因为模型不安全,而是因为合规框架不兼容。

但在「透明度」这个特定维度上,开源确实具有结构性优势:代码可审查、权重可测试、架构可复现——这些属性让开源模型成为闭源商业模型最有力的竞争者,也是唯一一个在透明度维度上能与「最强模型披露最少」这个逆向趋势抗衡的力量。

更有意思的是,这场透明度竞争正在重塑全球AI生态的格局:开源社区——尤其是中国主导的开源模型——正在成为透明度标准的事实制定者。

当所有人都默认「想知道这个模型到底怎么工作的,去看DeepSeek的技术报告」,而不是「去问Anthropic的商务团队」,透明度标准的权力结构就已经发生了转移。

DeepSeek的技术报告,比某些公司的发布会PPT详细多了

10 | 主权AI竞赛:44个国家在建超算集群,但这不是竞争的终点

说到主权这个词,有一点需要先说清楚:主权AI不只是「国家要有自己的AI」这么简单的民族主义叙事,它背后有一套非常实在的经济和安全逻辑。

AI模型需要数据,数据的跨境流动面临越来越严格的监管。你把用户数据传到境外训练模型,可能在欧盟违反GDPR,在美国触发州级数据法规,在中国违反数据安全法——三套体系互相不兼容,而且越来越难同时满足。

于是「主权AI」这个概念就自然生长出来了:一个国家用自己的基础设施、数据、人才,在自己的法域内训练和部署AI模型,数据不出境,法规全覆盖。

斯坦福报告的统计:过去一年,拥有「国家支持的超级计算集群」的国家从上一个版本报告的约20个增加到了44个——翻了一倍多。Stanford HAI, AI Index Report 2026

这个扩张速度说明两件事:第一,各国政府已经接受了「AI是国家基础设施」这个判断;第二,这场竞赛的入场门槛正在提高——你没有国家级超算,就意味着你在AI竞赛里连参赛资格都没有。

美国的算力优势在这个背景下就更加夸张了:它目前拥有5427个数据中心,数量是其他所有国家总和的10倍以上。Stanford HAI, AI Index Report 2026

10倍这个数字听起来像是硬件军备竞赛,但背后的实质是能源消耗和土地资源的系统性占用。AI数据中心的电力容量已经接近29.6吉瓦——大约相当于纽约州的峰值用电需求。

训练一个大模型背后的碳排放,已经开始引发环保组织的公开批评。

xAI训练Grok 4模型,产生的二氧化碳排放量估计达到72816吨,相当于17000辆汽车行驶一年的排放量。Stanford HAI, AI Index Report 2026

这个数字让AI的「绿色低碳」人设碎了一地。当然,AI同时也在优化能源使用、加速材料科学研发以推进新型电池技术——正向和负向的社会影响是同时存在的,不是非此即彼。

但「AI拯救地球」这个叙事需要更加谨慎。

回到主权AI这个主轴。中国在2025年8月发布的「AI Plus Action Plan」,目标是2027年在关键行业达到70%的AI渗透率,2030年达到90%。

Stanford HAI, AI Index Report 2026

90%——这是一个非常激进的渗透率目标,激进到需要把AI嵌入工业体系、政府系统、城市基础设施的每一个毛细血管里才能实现。

问题在于,这个渗透率目标和企业端的88%部署率之间存在一个巨大的落差:企业部署AI是一个商业决策,有预算、有KPI、有验收标准;

而「70%关键行业AI渗透」需要的是基础设施改造、标准体系建设、人员培训、监管适配——这是一个至少十年周期的系统工程,不是写进文件就能完成的。

更值得关注的结构性风险在另一边:那些没有在报告里被点名表扬的国家——也就是那44个国家之外的150多个——正在面临一个越来越难以翻越的AI进入壁垒。

AI时代的基础设施是数据,而数据有复利效应:拥有更多数据的国家训练出更准确的模型,更准确的模型吸引更多的用户和开发者,更多的用户产生更多的数据——这个正反馈循环一旦建立,后来者的追赶成本就指数级上升。

斯坦福报告在这个问题上给出了一个警告:「南美和中东国家在AI基础设施上的落后,可能引发新的数字鸿沟。」Stanford HAI, AI Index Report 2026

这不是遥远的预测,这是已经在发生的现实分化——主权AI竞赛正在把全球AI发展格局切割成「有能力的玩家」和「被服务的市场」两个阵营,前者制定标准、输出模型、掌握数据,后者接受产品、贡献流量、输出隐私。

对于中国来说,这是一个机会也是一个挑战:作为「有能力的玩家」之一,中国的AI战略从追赶转向了多维竞争——开源生态、制造业落地、科研输出——但这些优势在多大程度上能转化为全球影响力,取决于中国能不能在芯片自主和人才储备这两个长线上持续突破。

而对于正在读这篇文章的普通开发者来说,主权AI竞赛的影响可能比你想象的更近:你所在公司的云服务选型、AI产品的数据合规审计、你参与的开源项目的国别使用限制——这些都在被主权AI的竞争逻辑重新定价。

做全球化的AI产品,光代码写得好还不够,得懂各地合规那套

结语 | 2.7%是技术的胜利,但不是AI时代的终场哨

写到这里,我们来把这条线索理清楚。

2.7%是真的。中美AI模型性能差距缩至2.7%是真实的、值得骄傲的、被Stanford HAI、MIT、Digital in Asia等多家机构交叉验证的事实。

DeepSeek-R1用600万美元做到了接近GPT-5的性能,Qwen系列下载量超9亿次,中国的AI论文数量和引用次数双领先——这些不是PPT数据,是工程能力的真实跃迁。

但2.7%只是这场AI竞赛的一个维度。

在这个维度之外,还有华为Ascend和NVIDIA Blackwell之间那道还没愈合的算力鸿沟——不是一年两年能填平的,需要整个半导体制造体系的追赶,而追赶的路被出口管制设备一次次加高。

还有人才流向的逆转——89%这个数字比2.7%更让人睡不着,因为它说的是未来,而不是现在。过去流向美国的最聪明的脑袋正在改变方向,而这些脑袋才是决定十年后谁领先的关键变量。

还有22至25岁开发者就业率下滑近20%这个事实——AI替代入门级岗位的速度比替代体力劳动更快,这件事对正在求职的年轻人来说不是一个统计数据,而是一个需要严肃面对的生存环境。

还有最强模型披露最少、透明度指数从58分跌到40分的逆向进化——能力越强越不透明,这不是技术问题,这是整个行业生态的信任危机。

还有53%渗透率背后那25亿没有被统计进去的人——当你把这个数字和主权AI竞赛放在一起看,你会发现AI时代正在重写全球数字权力的基本格局,而这个格局的受益者和受损者可能和你想象的不一样。

2.7%是技术精英阶层感知到的现实。

时钟读不准、玉米价格查不到、22岁找不到第一份工作——这些是另外几十亿人感知到的现实。

这两个现实同时存在,同时真实,而且正在以越来越快的速度扩大彼此之间的距离。

这不是一个「中国赢了还是美国赢了」的问题。这是一个「AI时代到底在为谁而建」的问题。

最后,留一个问题给你:

你身边,AI渗透到了哪一步?你的工作里有多少环节已经被AI介入了?你有没有遇到那种「AI能写代码但读不懂需求文档」的场景,或者「AI替代了团队里的junior但senior反而更忙了」的案例?

这个问题没有标准答案,但它的答案决定了我们未来会住在一个什么样的AI世界里。

风险提示与免责声明:本文仅基于Stanford HAI、MIT Technology Review、Digital in Asia、Bernstein Research/CFR、TrendForce、Gizmochina、Computerworld等公开报告和研究资料撰写,用于技术趋势研究与信息分享,不构成投资建议,也不作为任何就业或商业决策的依据。

报告中涉及的数据截至2026年4月,趋势判断反映当前可获取的公开信息,不预测未来市场走向。

参考文献

延伸入口

- 原文归档:tobemagic.github.io/ai-magician…

- 公众号:计算机魔术师

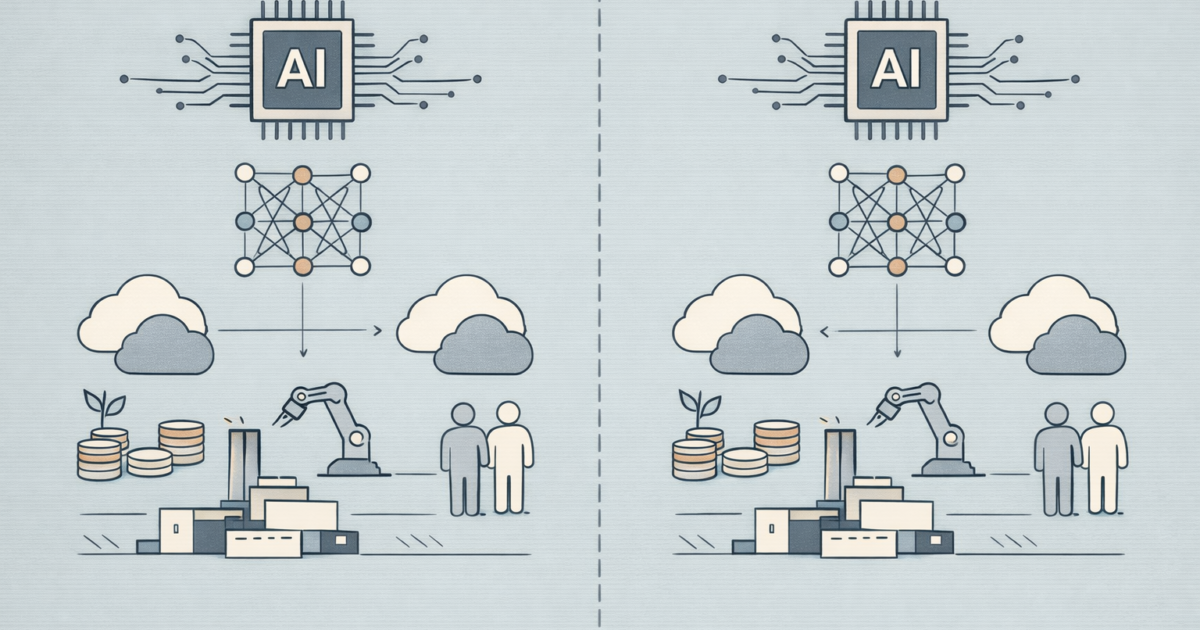

图解补充

图解用途:复用来源页公开图片,辅助说明:China vs US AI Race: The Gap Has Collapsed to 2.7%

图解用途:复用来源页公开图片,辅助说明:美大学发布报告:中美ai模型性能差距缩小至2.7%-中新网