Google 这次没有发布一个“更快一点”的芯片。

它做的,是另一件更值得警惕的事:

第一次把“Agent”写进了芯片的叙事中心。

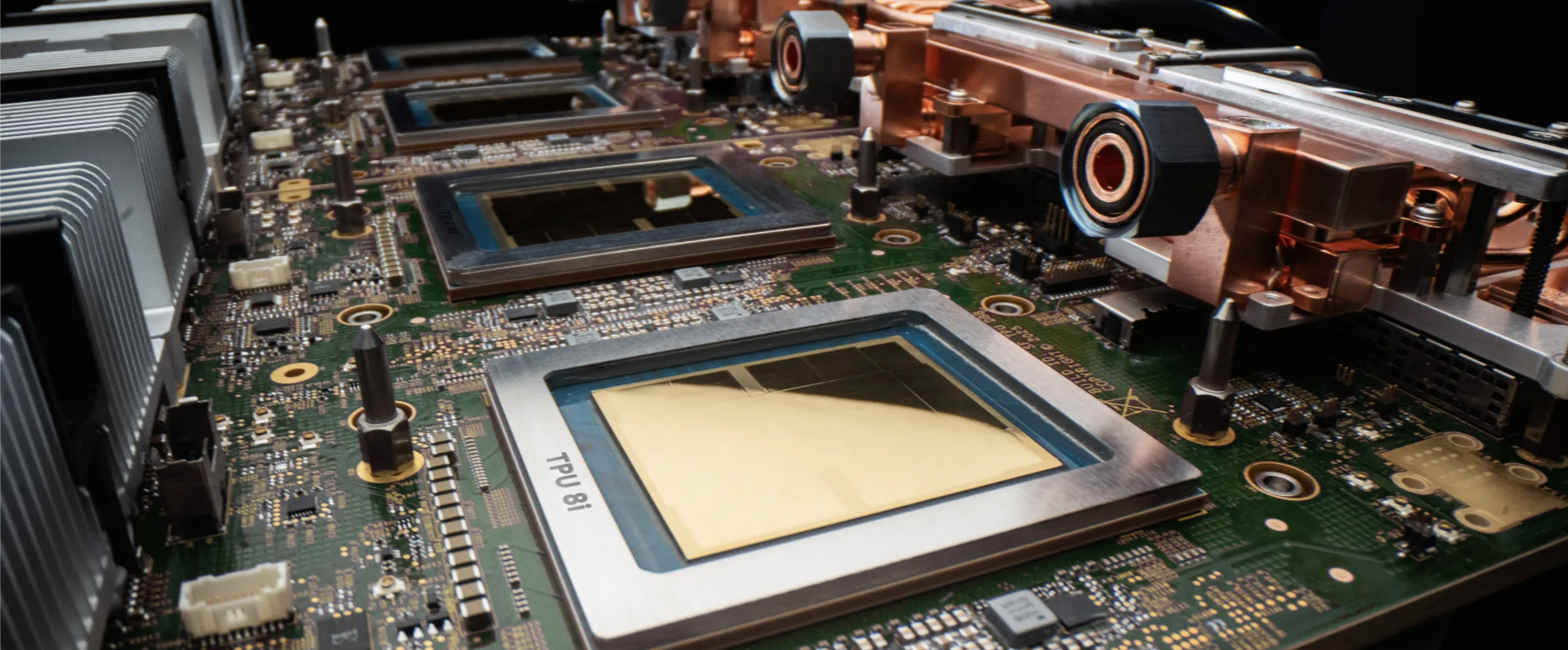

第八代 TPU 来了,而且不是一款,而是两条线:

- TPU 8t:面向训练

- TPU 8i:面向推理

表面看,这是一次常规硬件升级。

但如果你把它和大模型行业最近一年的变化放在一起看,会发现这件事没那么简单。

Google 正在押注一个判断:下一代 AI 竞争,不再只是“谁能训出更大的模型”,而是谁能支撑更大规模、更低成本、更高吞吐的 Agent 运行。

这才是这次发布真正危险的地方。

01 Google 这次不是在发芯片,而是在重写游戏规则

先看几个关键数字。

Google 公开的信息里,第八代 TPU 在超级 Pod 规模、共享内存、芯片互联和整体算力上都继续往上推。

其中最具冲击力的一点是:

TPU 8t 的超级 Pod 规模进一步拉高,整套系统已经明显不是“单芯片升级”,而是在朝“超大规模 AI 基础设施单元”演进。

这意味着什么?

过去我们谈训练,常常是在说:

- 模型有多大

- 卡有多少张

- 集群能不能撑住

- 通信是不是瓶颈

而 Google 这次释放出的信号是:

它想把“超大模型训练”这件事,直接提升到基础设施设计层。

不是给你一块更强的卡。

而是给你一整套更适合大模型时代的训练底座。

这和传统半导体叙事不太一样。

以前大家比的是单卡性能。

现在 Google 更像是在说:

别再只盯着单卡了,未来拼的是系统级组织能力。

02 最重要的变化:训练和推理,开始走向“两种芯片逻辑”

这次最值得注意的,不是“第八代”这几个字。

而是 Google 明确把 TPU 分成了两条路线:

- 8t 做训练

- 8i 做推理

这件事背后的意味很大。

过去 GPU 世界里,一个很强的默认假设是:

一套通用计算平台,可以同时覆盖训练和推理

但 Google 现在越来越明确地在说:

不,训练和推理已经是两种越来越不同的工作负载。

为什么?

因为今天的大模型应用已经变了。

传统推理更像一次性问答:

- 你输入一句话

- 模型生成一段回答

- 一轮结束

但 Agent 不是这样。

Agent 的真实工作方式是:

- 连续规划

- 连续调用工具

- 连续读写上下文

- 连续修正步骤

- 一个任务跑很多轮

也就是说,Agent 不是“答一次”,而是“跑一段”。

这会让推理侧的压力完全变形。

所以 Google 的做法,本质上是在承认一件事:

AI 基础设施的竞争,已经从“通用算力时代”进入“工作负载分化时代”。

03 为什么 Google 要把“Agent”写进芯片故事里?

因为 Agent 需要的,不只是更多算力。

它需要的是另一种算力。

很多人对 Agent 的理解,还停留在“会调工具的大模型”。

但从基础设施角度看,Agent 带来的变化要深得多:

第一,任务变长了

不是一问一答,而是连续循环。

一次任务可能包含多轮推理、多次工具调用、多次上下文更新。

第二,吞吐和延迟变得同样重要

单次峰值性能很重要,但 Agent 更怕“每一步都慢一点”。

因为一慢,就是整条链路都慢。

第三,推理成本会被放大

Agent 不是多花一点 token,

而是可能把推理成本直接拉到传统对话式交互的数倍、数十倍。

第四,训练侧也被反向拉高

Agent 想做得更好,就要求模型:

- 更长上下文

- 更强规划能力

- 更稳定工具调用

- 更强多模态理解

- 更高复杂任务完成率

这些都要求训练侧继续上强度。

所以你会发现:

Agent 不是“大模型的一个小应用”,而是会反过来重塑训练和推理基础设施的需求结构。

Google 现在把这个判断直接写进芯片叙事,本身就说明它不是在看一个功能点,而是在看下一代 AI 计算范式。

04 这件事为什么对 Google 特别有利?

因为 Google 不是只有芯片。

它手里同时有:

- 芯片

- 数据中心

- 网络

- 模型

- 云平台

- 应用入口

也就是说,它不是单点玩家,而是全栈玩家。

这就带来一个其他公司很难复制的优势:

它可以从模型需求倒推芯片设计,再从芯片能力反推云资源组织方式。

换句话说,Google 并不是在做一块“更好的加速器”。

它做的是:

从 Gemini 和 Agent 的运行需求出发,重做底层计算基础设施。

这就是垂直整合最可怕的地方。

因为很多公司只能做其中一层:

- NVIDIA 强在芯片和生态

- OpenAI 强在模型和产品

- 云厂商强在基础设施租赁

但 Google 是少数几个可以把这些层连起来看的玩家。

而一旦竞争进入“训练 + 推理 + Agent + 云服务”一体化阶段,

全栈能力的价值会迅速放大。

05 开发者真正有价值的争议,不是参数,而是 Google 的路线问题

很多人追问:

Google 有了这么强的基础设施,它到底会不会把这种优势转化成开发者真正能稳定使用的能力?

争议主要集中在三点。

1. 模型生命周期太短

一些开发者最不满的,不是 Google 不强,

而是 Google 太喜欢快速迭代、快速替换、快速废弃旧版本。

对于开发者来说,最怕的从来不是技术不先进,

而是:

- 今天能用

- 明天要迁移

- 后天接口变了

- 再后天老版本退场

如果底层芯片、模型、云平台都在你手里,理论上你本该更容易提供长期稳定支持。

但这恰恰是很多开发者对 Google 最没信心的地方。

2. Google 会不会把 Agent 优势真正释放给市场?

另一个争议点是,Google 明明拥有极强的基础设施优势,但在很多开发者体感里,Gemini 并没有表现出一种“我有最多算力,所以我愿意大胆砸推理成本”的进攻姿态。

这就让外界产生疑问:

Google 到底是在为 Agent 时代提前修路,

还是在给自己的大规模内部系统做定制底座?

这个差异很大。

因为前者意味着开放平台红利,

后者意味着“Google 强,但不一定轮得到你充分用”。

3. 全栈控制既是优势,也是束缚

Google 的全栈能力确实强。

但问题是,一旦你从模型、芯片、云到部署都越来越绑定在同一生态里,

你的技术路线会越来越依附平台。

所以这不是单纯的技术判断。

它也是一个商业判断:

你到底是在用一个更强的平台,还是在被一个更强的平台锁定?

06 这次发布对行业真正意味着什么?

短期看,它不会立刻改写 NVIDIA 的统治地位。

因为 NVIDIA 最强的,不只是卡。

而是:

- CUDA 生态

- 开发者习惯

- 框架兼容

- 第三方工具链

- 企业采购惯性

这些不是一代 TPU 就能颠覆的。

但长期看,这次发布至少释放了三个非常清晰的信号。

信号一:训练和推理的硬件分层会越来越明显

未来不一定还是“一套通用芯片打天下”。

随着 Agent、长上下文、多模态、实时系统越来越普及,

训练和推理的硬件差异会越来越大。

信号二:AI 基础设施竞争开始从“单芯片性能”转向“系统级设计”

谁的网络更强、内存池更大、调度更优、成本更低、系统吞吐更高,

这些指标会越来越重要。

信号三:Agent 可能会重塑推理市场

如果未来主流应用不再是一次性问答,

而是持续运行、反复调用、自动完成任务的 Agent,

那么推理成本和推理架构的地位会迅速上升。

到那时,真正掌握优势的,不一定是“模型参数最大”的公司,

而是:

能把 Agent 跑得更快、更稳、更便宜的公司。

07 为什么说“芯片战争的下半场开始了”?

因为上半场,行业拼的是训练。

谁能堆更多卡,

谁能更快训出更强的模型,

谁就掌握话语权。

但下半场,事情开始变了。

未来真正决定开发者和企业买单的,可能不是“谁先发新模型”,

而是:

- 谁的推理成本更低

- 谁的 Agent 吞吐更高

- 谁的系统更稳定

- 谁的延迟更低

- 谁更适合承载复杂任务循环

换句话说:

模型战争会继续,但模型战争已经不再是全部。

从这一点看,Google 这次亮出的,不是一张产品卡。

而是一种态度:

下一代 AI 竞争,不只在模型层,也在芯片层、系统层和运行层。

而且,它已经开始为那个时代修基础设施了。

08 总结

Google 这次最值得关注的,不是几个性能数字。

真正值得警惕的是:

它第一次明确告诉市场——Agent 不只是应用形态,而是芯片设计的出发点。

这句话的分量非常重。

因为一旦芯片开始围绕 Agent 设计,

就意味着整个行业都默认了一件事:

未来最重要的 AI,不是“会回答问题的模型”,

而是“能持续执行任务的系统”。

TPU 8t 和 8i,表面上是两款芯片。

但更深一层看,它们其实是在宣告一件事:

AI 基础设施的竞争逻辑,已经开始切换。

训练是上半场。

推理是下半场。

而 Agent,很可能就是下半场最先把格局拉开的那股力量。

你可以记住这一个判断

Google 这次不是在升级 TPU。

它是在提前下注:谁能撑起 Agent 时代的推理基础设施,谁就更有机会拿下下一轮 AI 定价权。

参考来源

- Google Cloud Blog: Our eighth generation TPUs

- Google Cloud Technical Deep Dive: TPU 8t and TPU 8i Architecture

- Hacker News Discussion