出厂即用:荣耀YOYO Claw的预制龙虾体系架构

荣耀发布的自研终端侧龙虾AI智能体——YOYO Claw技术,首发搭载于MagicBook系列轻薄本,开创了「养虾本」这个全新品类。

这不是把OpenClaw打包成一个安装包那么简单,而是从根子上重构了龙虾的产品逻辑。

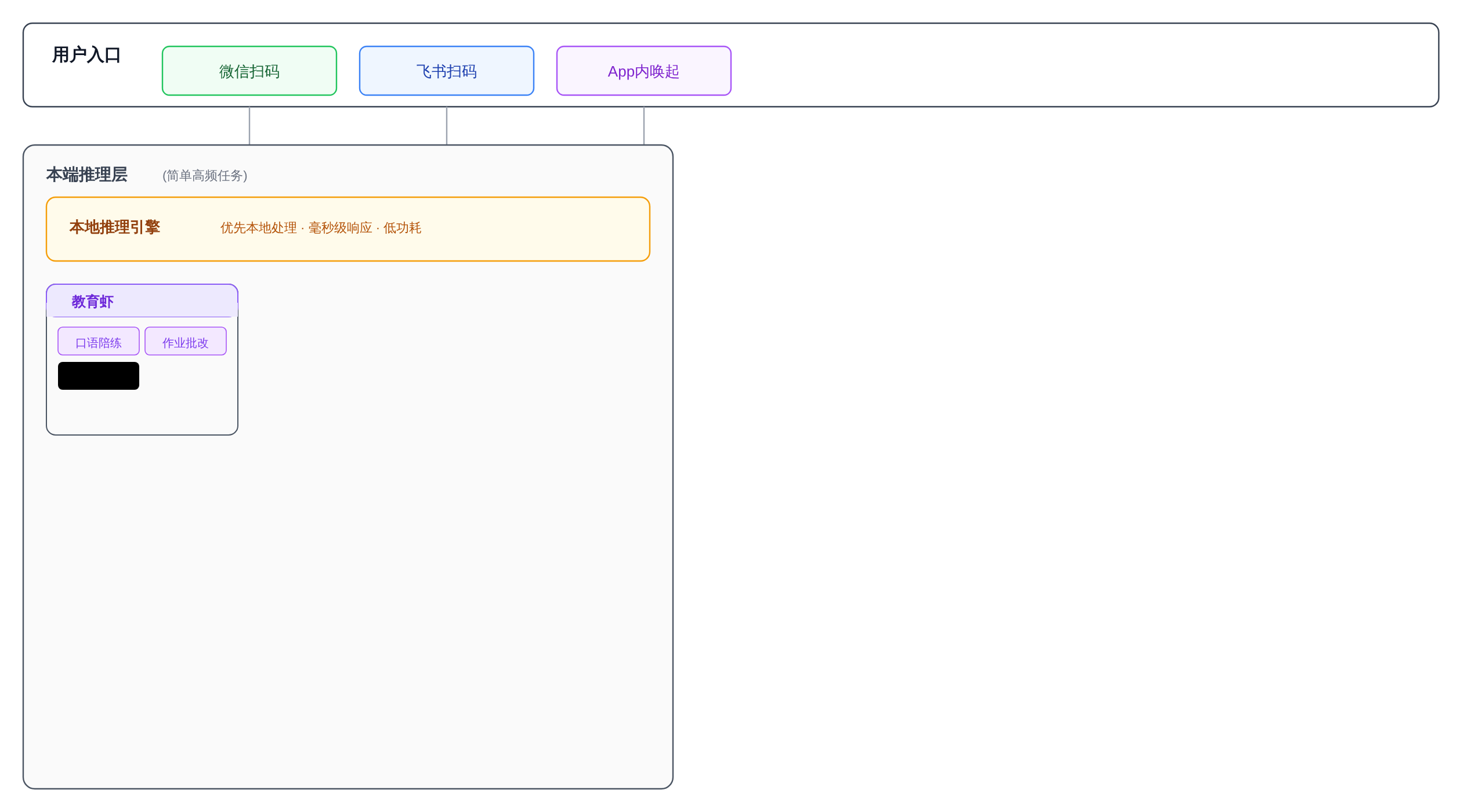

预制虾体系:5大主虾+23个子虾的场景化封装

荣耀YOYO Claw出厂时已内置5个成品主虾和23个成品子虾,覆盖教育、办公、学术、内容创作、智能辅助五大场景3。

每个虾都已提前搭载对应领域的全部专业技能,用户不需要理解任何技术概念,直接调用即可。

在交互设计上,荣耀进一步简化了调用路径。用户只需扫二维码登录,即可把龙虾接入微信、飞书等日常沟通工具,无需配置API Key,无需编写代码。

这意味着从「安装龙虾」到「真正用上龙虾」的时间被压缩到几分钟。

这套预制体系还内置了场景化智能推荐能力。当用户在论文写作场景时,系统会自动匹配论文虾;当用户在处理办公文档时,会推荐对应的办公虾。龙虾不再是一个需要用户主动学习的工具,而是主动介入协作的助手。

更关键的是,YOYO Claw具备自主学习与进化能力。每次用户通过龙虾完成任务、产出文档时,它会自动沉淀知识、方法和风格,总结成可复用的模板。

下次同类任务,直接调用已学会的技能,效率大幅提升。这使得龙虾从一次性工具,逐步演变为持续成长的数字同事。

产品说要做「场景化智能推荐」,结果需求改了六版

端云协同架构:端侧优先的智能路由设计

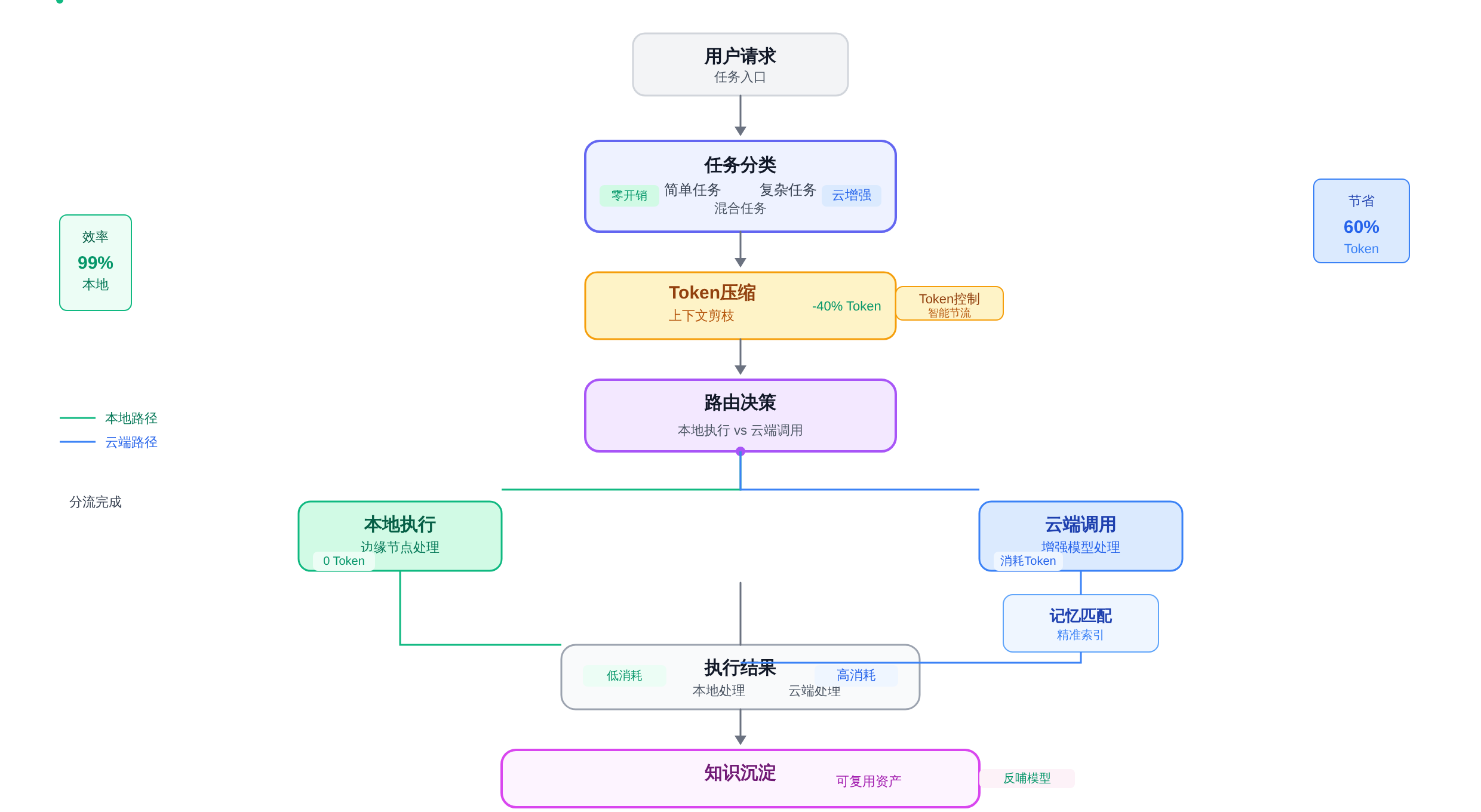

YOYO Claw的技术架构核心是「端云协同,端侧优先」。这八个字背后是一套完整的智能路由算法,解决的是「什么任务在本地做、什么任务交给云端」这个核心问题。

简单、高频及涉及本地操作的任务,100%在端侧完成,词元消耗为零。只有需要强大算力的复杂任务,才按需调用云端资源。

这个判断不是靠固定规则,而是靠实时任务复杂度评估——系统会先判断任务难度,再决定资源分配。

这种架构设计的背景很现实:龙虾是Token消耗的怪兽。如今代理AI在执行具体任务时,Token消耗量是传统对话式AI的1000倍2。

如果所有任务都走云端,成本会迅速失控,用户很快就会发现「养虾的花费比请一个实习生还贵」。

经荣耀实验室基于PinchBench测试集验证,YOYO Claw相比OpenClaw方案,综合词元消耗节省50%,任务成功率从89.5%提升至94.5%3。

在极端场景下,词元节省幅度甚至达到90%。这个数字背后不是某一项技术创新,而是端云协同架构在每个决策节点上积累的效率优化。

正文图解 1

从架构图可以看到,用户通过日常沟通工具发起请求后,系统先在端侧完成初步判断:简单任务直接本地处理,高复杂度任务才路由到云端。

主虾根据场景分发到对应子虾执行,子虾完成后结果回流端侧沉淀。这个流程里的每一个节点都在控制Token消耗,而不是等到账单来了才发现超支。

架构评审时被问「这个路由判断的阈值是怎么定的」,当场卡壳

来源:finance.sina.com.cn

词元成本降低50%:Token调度引擎的工程拆解

50%的词元节省听起来像是营销话术,但拆开看工程实现,会发现这是一套完整的全流程设计:任务理解→过程Token压缩优化→精准记忆匹配→端云模型协同→结果沉淀。

每一环都在解决一个具体的Token消耗漏洞。

上下文压缩:只传必要信息

传统Agent在处理任务时,会把完整的历史上下文一股脑塞进模型,导致大量Token消耗在「已经在对话里出现过的信息」上。这就像让一个实习生每次汇报工作都要从头讲公司历史,效率自然低。

YOYO Claw的上下文压缩逻辑是:只提取与当前任务强相关的上下文片段,历史对话中已被处理的信息不再重复传输。

在荣耀的测试中,这个优化在复杂长文档处理场景下效果尤其明显——上下文压缩后,任务完成质量没有明显下降,但Token消耗下降了40%左右2。

精准记忆匹配:只调用相关的记忆

龙虾的「记忆」能力是它的核心卖点之一——用得越久,它越懂你。但这把双刃剑的问题是:记忆越多,每次调用时携带的上下文就越大,Token消耗也就越高。

荣耀的解法是「精准匹配」。系统内置了更精细的记忆索引逻辑:每次执行任务时,龙虾只会调用与当前任务直接相关的记忆内容,不会把「三周前写的报告风格」「上个月的一次会议偏好」这些无关信息也一起带上。

这套匹配机制还支持任务结果复用。对于已经完成过的搜索结果、分析报告、数据整理,系统会优先沿用历史结果,而不是重新调用模型执行一遍。

这在日常办公场景中尤为实用——你不需要每次让龙虾「帮我分析这份数据」,因为它已经学会了你上次的分析框架,直接复用即可。

链路级控制:从成本控制到效率优化

Token调度引擎的核心不是「省多少」,而是「怎么省得合理」。有些任务需要高质量输出,不能为了省Token降低质量;有些任务只是简单的信息检索,省Token才是第一优先级。

YOYO Claw的任务理解层会先做复杂度评估,然后分配合适的资源层级。简单任务走轻量路径,复杂任务才动用更强的模型能力。这个决策是在每次请求时动态做出的,不是一套固定规则走到底。

正文图解 2

从流程图可以看到,任务进入调度引擎后先做复杂度分类。简单任务直接在端侧执行闭环,Token消耗为零;复杂任务进入云端增强路径,经过上下文压缩和精准记忆匹配后调用模型能力;

执行结果再回流端侧进行知识沉淀,供下次复用。这条链路上的每个节点都有明确的Token控制机制,而不是靠事后账单来发现问题。

用户反馈「用了三天Token账单就爆了」,锅直接扣到Agent头上

「以虾制虾」:设备级安全防护体系

龙虾需要操作系统级权限——读取本地文件、调用系统功能、跨应用执行任务。这个权限设计是龙虾能「真正干活」的基础,但也是安全风险的核心来源。

国家互联网应急中心的安全提醒直指OpenClaw类产品的四大高危问题:恶意插件投毒、隐私数据外泄、关键文件被误删、提示词注入劫持3。

这些风险在传统对话框式AI里几乎不存在,但在龙虾的高权限架构下变成了真实威胁。

独立安全虾:监控与拦截的闭环

荣耀的解法是「以虾制虾」——在龙虾体系内新增一只专门负责安全的虾。这只独立安全虾全程监控所有AI操作行为,自动识别高危操作并即时拦截。

高危操作的定义很明确:格式化硬盘、重装系统、删除系统目录、修改启动项——这些一旦执行就可能造成不可逆损失的操作,统统在拦截范围内。用户在执行这类操作前,系统会弹出明确的警告并要求二次确认。

更关键的是敏感操作的权限控制。涉及登录支付、打开摄像头、工作区外文件发送这类行为,系统同样要求用户二次确认。

这不是简单的弹窗,而是在执行路径上设置了物理隔离——即使龙虾被劫持,攻击者也无法直接完成高危操作。

核心数据本地化:敏感数据零上云

荣耀承诺「能力全开放,敏感数据零上云」。核心数据处理和个人记忆全部在设备本地完成,内核级加密保护用户隐私。

这套安全架构的设计逻辑是:设备级安全不只是功能层面的防护,而是从系统底层构建信任边界。龙虾可以调用本地算力、访问本地文件、记住用户习惯,但所有这些操作都在本地闭环完成,不需要把数据送上传云端的风险。

从安全架构的整体设计来看,这套体系覆盖了三个层级:应用层的行为监控、驱动层的权限校验、内核级的数据加密。

普通用户不需要理解这些技术细节,只需要知道一个结论——用YOYO Claw养虾,数据不会莫名其妙出现在云端。

提示词注入攻击差点把本地文件全删了,还好有安全虾拦截

一虾多吃:跨端家庭生态与阿尔法战略的落地支点

YOYO Claw的意义不只在于解决个人用户的问题。荣耀在发布会上展示了一个更远的图景:一台养虾本,全家都能用,每人有自己独立的虾。

这个场景的逻辑是:龙虾会沉淀用户的记忆、习惯和工作流——用得越久越懂你。但传统方案里龙虾是「单人单机」的,一台电脑只有一个龙虾实例。如果家里有多个人共用一台设备,需求如何协调?

荣耀的答案是「一虾多吃」。接入PC之后,YOYO Claw支持全家多人共用一台设备,但每人都拥有独立的龙虾实例——独立的使用空间、任务记录和记忆体系,彼此隔离、互不干扰。

孩子用它辅导作业,父母用它管理健康档案,职场人用它处理工作,各取所需,互不越界。这种多端协同的能力不只是PC内部的事。

所有家庭成员可以通过手机、平板等设备远程与这些龙虾互动、操控,家庭相关的记忆数据存储在PC本地,实现全家庭联动。龙虾的角色从个人工具延伸为家庭级智能中枢。

阿尔法战略:从手机制造商到AI终端生态公司

理解YOYO Claw的战略位置,需要回到2025年MWC上荣耀CEO李健发布的「阿尔法战略」。

这份战略的核心判断是:通向AGI之路要经历多个阶段,目前正处于从「思考」向「行动」的跨越期。当务之急是让AI能解决问题,只有让AI落地生根、让用户日常使用起来,才能真正释放AI的潜力4。

阿尔法战略分三步走:第一步,打造真正智慧的手机,在AI智能体时代打开技术边界;第二步,构建智慧生态,在物理AI时代打开产业边界;

第三步,迈向智慧世界,在AGI时代打开人类潜能的边界。荣耀承诺未来五年投入超100亿美元推动这一转型。

YOYO Claw正处于第一步向第二步跨越的关键节点——它是AI智能体能力在PC端的首次产品化,也是荣耀从「单设备智能」迈向「多端生态智能」的战略支点。

竞争格局:终端厂商的龙虾路线分化

荣耀并非第一个布局终端AI智能体的厂商。各家的技术路线和产品节奏已经开始分化:

联想今年3月正式发布天禧AI Claw,以零成本部署、零门槛使用为核心卖点,并同步启动天禧AI PadClaw先锋计划。

华为通过盘古大模型与AI空间整合超100个第三方AI智能体,在MateBook系列中实现端侧AI能力的聚合输出。

苹果的MacBook系列强化端侧AI,M5芯片搭载优化后的神经网络引擎,Apple Intelligence深度整合于系统底层。

各方基于自身禀赋探索不同路径:模型厂商专注于把能力上限往前推进,互联网厂商负责连接内容、服务与流量入口,而终端厂商的独特价值在于「把技术封装成体验」的系统工程能力——离终端用户最近,离高频使用场景最近。

荣耀的差异化在于它选择了「深度预制」路线:不是把龙虾做成一个可下载的App,而是将AI智能体作为系统能力嵌入底层。

这个选择让荣耀在上手门槛和安全性上建立了优势,但也意味着它必须承担更多的系统整合责任——一旦预制体系出问题,影响面会比App模式更大。

架构评审会上CEO问「养虾本和普通PC的本质区别是什么」,全场沉默了三秒

结论:终端厂商凭什么站到龙虾赛道C位?

回到文章开头的问题:荣耀凭什么站到龙虾赛道的C位?

答案不是技术领先——论模型能力,荣耀不如大厂;论应用生态,荣耀不如互联网公司。

荣耀的核心竞争力是「把技术封装成体验」的系统工程能力:它把部署门槛从「折腾两天」压缩到「扫码即用」,把Token成本从「用得越多花得越贵」压缩到「端侧任务零消耗」,把安全风险从「裸奔在公网上」压缩到「设备级独立安全虾全程监控」。

这不是某一个技术创新,而是一套完整的用户体验设计。荣耀回答的问题是:当龙虾走出demo阶段、进入更高频更复杂的使用场景后,终端厂商能提供什么样的新增价值?

答案是以终端为支点,以系统级整合为路径,让AI智能体从「能用」走向「好用、敢用、愿意长期用」。

但这个判断也有边界条件需要正视。首先是算力限制——尽管NPU性能持续提升,但在复杂推理任务中,本地模型仍难以替代云端大模型,端云协同将长期存在。

其次是生态碎片化——当前Agent能力高度依赖工具调用,终端侧的工具链尚未完全开放,不同厂商之间缺乏统一标准。

第三是数据本地化与模型进化的平衡——数据不出端意味着模型难以通过集中数据持续优化,这个矛盾行业仍在探索中。

还有一个更大的问题留在这里:词元经济规模化之后,是否真的带来了AI普惠?荣耀YOYO Claw把龙虾做成了「开箱好用」的产品,但「人人能用」和「人人愿意用」之间还有距离。

下次你面对一个需要部署的AI工具时,最让你卡住的是哪个环节——配置、调用、还是账单?

参考文献

延伸入口

- 原文归档:tobemagic.github.io/ai-magician…

- 公众号:计算机魔术师