Google Android 团队最近发布了面向 AI Agent 的全新命令行工具套件,将 SDK 管理、项目创建、设备调试等核心开发能力封装成 CLI 命令,配套标准化的 Skills 指令集和可检索的 Knowledge Base,让 AI Agent 能以更低的 token 消耗完成 Android 应用开发。

这件事之所以值得关注,是因为它释放了一个清晰的信号:端侧 Agent 正在从概念走向工程落地。

而在 Mac 平台上,我们的开源项目 Mano-P 已经在做同样的事——让 AI Agent 在用户自己的设备上运行,完成真实的 GUI 操作任务。

Mano-P 是什么

Mano-P 是明略科技开源的端侧 GUI Agent,基于 VLA(Vision-Language-Action)架构设计。

「Mano」取自西班牙语中「手」的意思,「P」代表 Person 和 Party——我们希望每个人和组织都能拥有自己的个性化 AI,在本地设备上完成复杂的操作任务。

Mano-P 的工作方式是纯视觉驱动:通过视觉模型理解屏幕内容,规划操作步骤,然后通过系统原生输入完成鼠标点击、键盘输入等交互。整个过程不依赖系统 API 或命令行接口,理论上可以操作 Mac 上任何有图形界面的应用。

核心技术特点

think-act-verify 循环推理

Mano-P 在执行任务时不是单次推理,而是采用「思考-执行-验证」的循环机制。每一步操作之后,模型会重新观察屏幕状态,判断操作是否成功,再决定下一步动作。这让它能够处理包含数十到数百步骤的复杂任务。

边缘优化

为了在消费级硬件上高效运行,Mano-P 采用了混合精度量化和 GS-Pruning 视觉 token 剪枝算法。4B 量化模型(w4a16)在 Apple M4 Pro 上的实测表现:

- prefill 速度:476 tokens/s

- decode 速度:76 tokens/s

- 峰值内存占用:4.3GB

这意味着一台搭载 M4 芯片和 32GB RAM 的 Mac mini 或 MacBook,就可以在本地运行 Mano-P,无需云端支持。

三阶段训练流程

Mano-P 的训练路线是 SFT → 离线强化学习 → 在线强化学习,通过双向自强化学习框架(Text↔Action 循环一致性学习)持续提升操作准确率。

Benchmark 表现

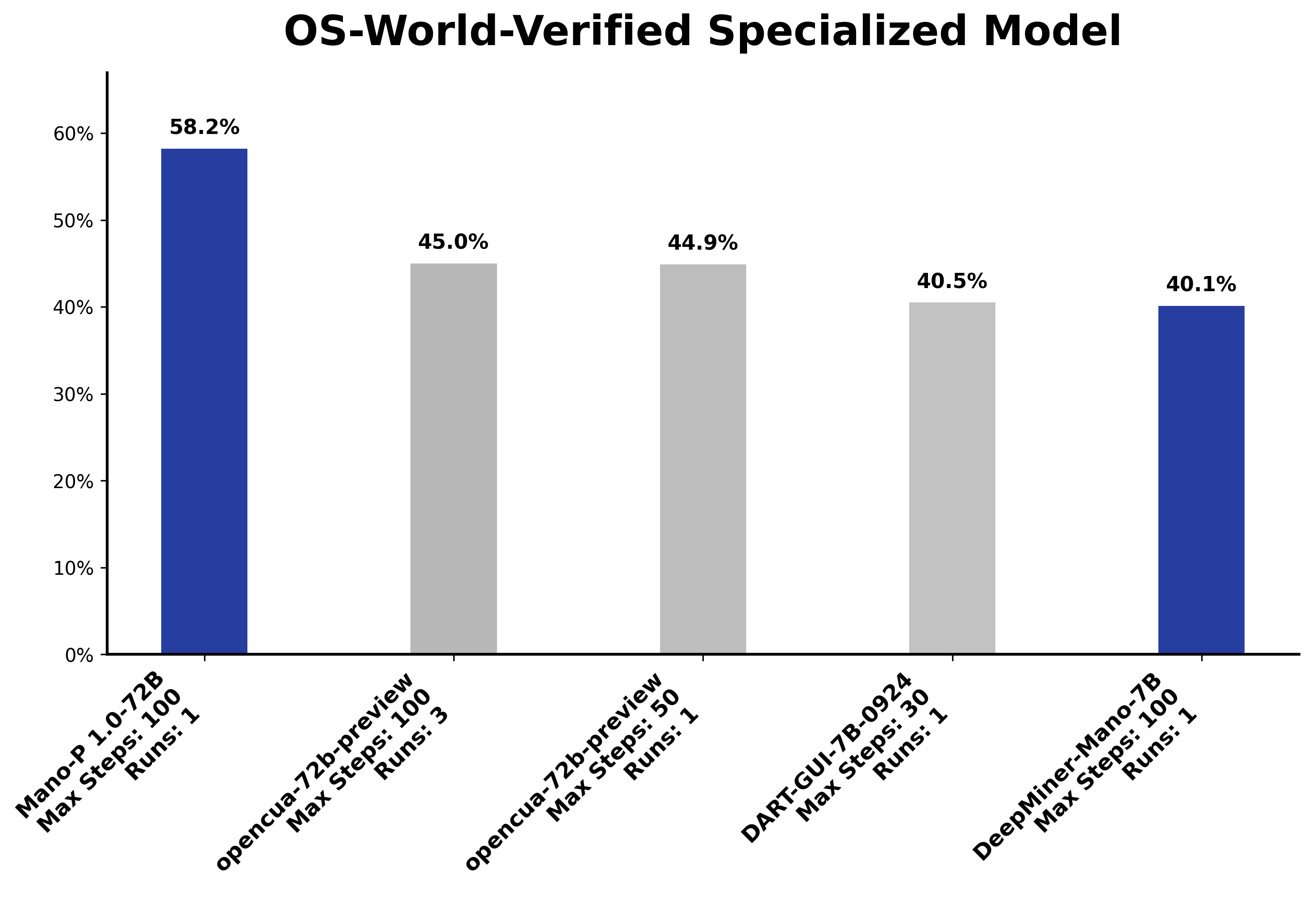

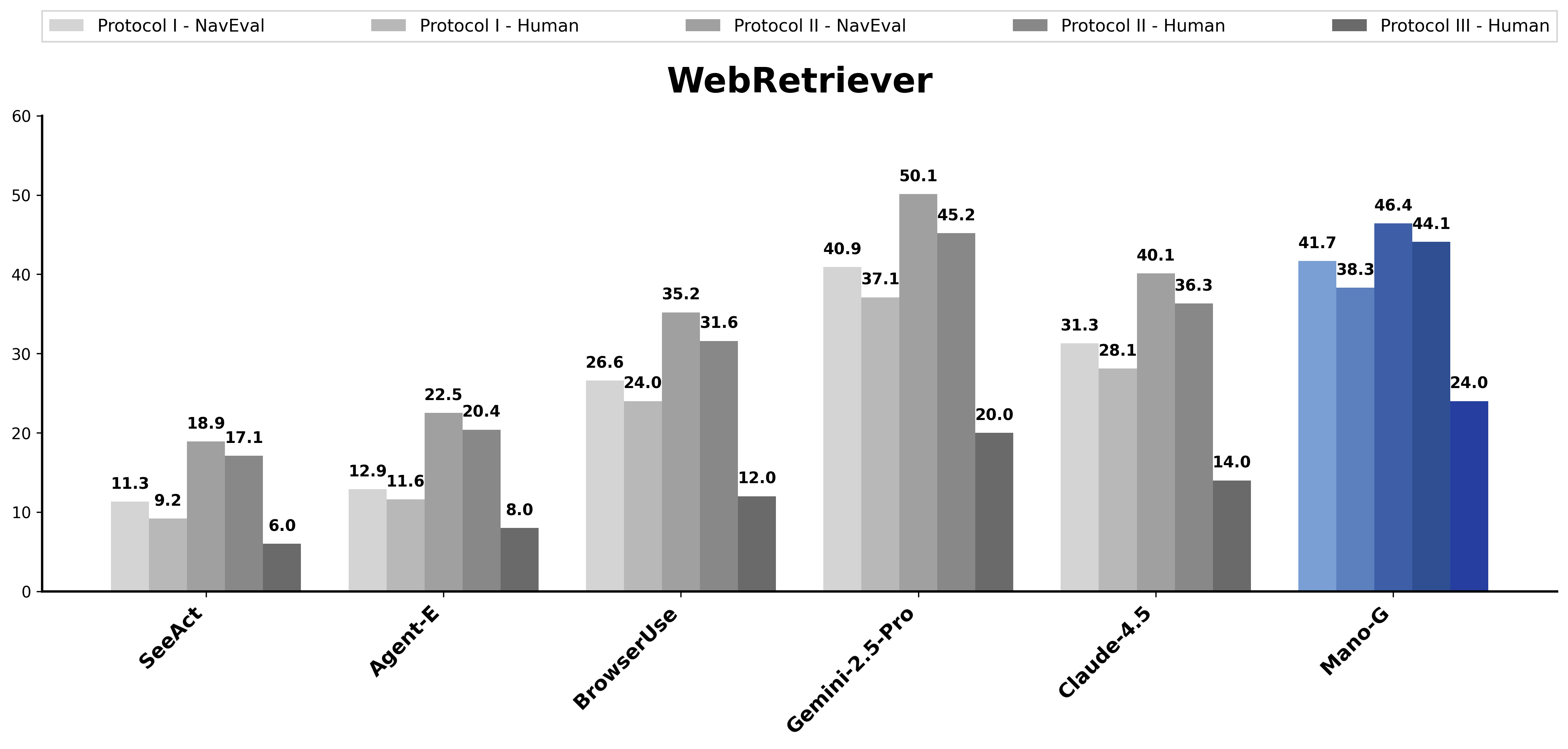

Mano-P 在多个公开基准测试中取得了具有竞争力的成绩:

- OSWorld:Mano-P 72B 模型达到 58.2% 准确率,在专项模型中排名第一

- WebRetriever Protocol I:Mano-P 达到 41.7 NavEval 分

数据隐私

Mano-P 在本地模式下,截屏和任务描述完全不离开设备。对于对数据安全有严格要求的场景——比如企业内部系统操作、敏感信息处理——这是一个重要的特性。完整的客户端代码已开源,可供审计。

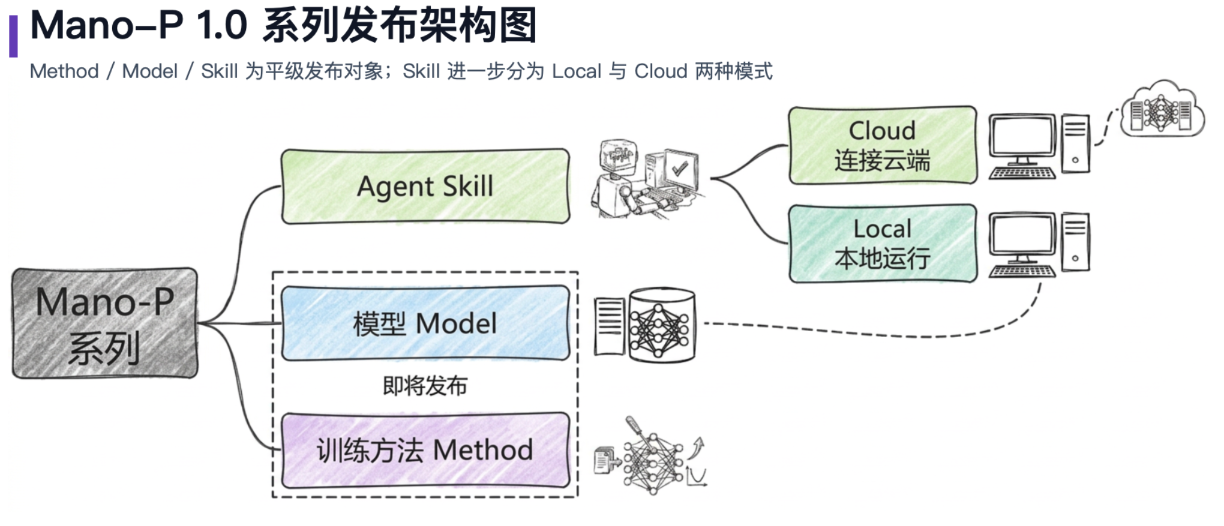

三阶段开源计划

Mano-P 采用分阶段开源策略:

- Phase 1(已发布):Mano-CUA Skills,支持 Agent 爱好者和 Claude Code/OpenClaw 用户

- Phase 2(即将发布):本地模型 + SDK,面向有数据安全需求的开发者

- Phase 3(规划中):训练方法 + 剪枝量化技术

快速上手

CLI 工具通过 Homebrew 安装:

brew tap HanningWang/tap && brew install mano-cua

GitHub 仓库:github.com/Mininglamp-…(Apache 2.0 协议)

如果你对端侧 AI 和本地化 Agent 感兴趣,欢迎试用 Mano-P,也欢迎在评论区交流。