GLM-5.1 vs Qwen3.6 Plus vs MiniMax M2.7:2026 年三大国产旗舰模型深度横评

2026 年的 AI 大模型战场,国产模型已经不再是追赶者,而是在多个关键赛道上与 OpenAI、Anthropic、Google 三巨头正面交锋。

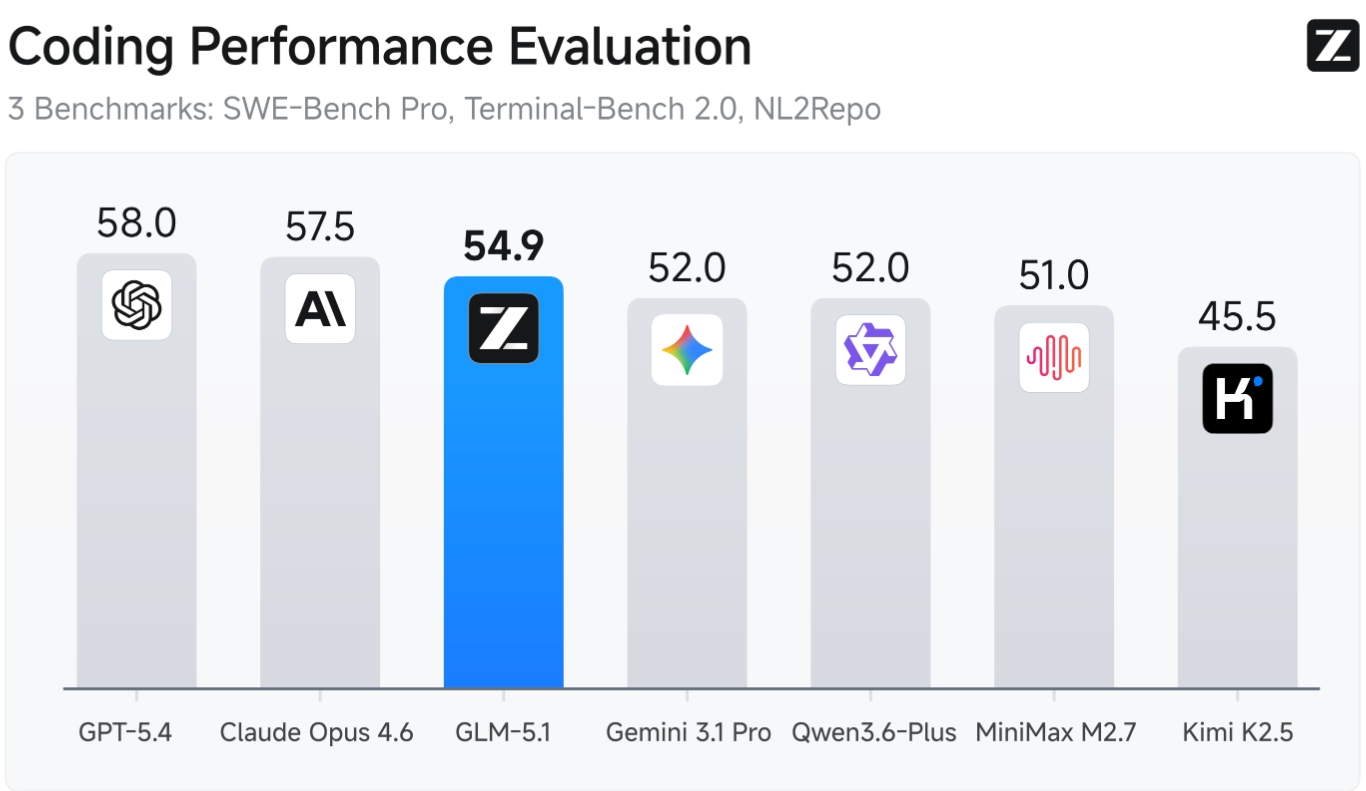

3 月中旬,MiniMax 的 M2.7 带着自我进化的概念横空出世,在专业办公和 Agent 协作领域打出了差异化,2300 亿参数的混合专家(MoE)模型,这次并且采取了新的开源权重模型的协议,商业用途需获得 MiniMax 书面授权。 3 月底,阿里 Qwen 团队推出了 Qwen3.6 Plus,凭借 100 万 token 上下文窗口和 Terminal-Bench 2.0 上的表现引发关注; 4 月,Z.ai 发布了 GLM-5.1,以 SWE-Bench Pro 58.4 分登顶全球第一;三款模型,三个方向,代表了国产 AI 三种不同的技术路线。本文将从架构设计、编码能力、推理能力、Agent 能力、多模态表现、生态可用性和价格等多个维度进行全面对比,帮你在选型时做出清晰判断。

一、基本参数一览

先看硬指标。

| 参数 | GLM-5.1 | Qwen3.6 Plus | MiniMax M2.7 |

|---|---|---|---|

| 发布日期 | 2026-04-07 | 2026-03-30 | 2026-03-18 |

| 开发商 | Z.ai(智谱) | 阿里 Qwen 团队 | MiniMax |

| 模型规模 | 754B(稀疏 MoE) | 未公开(MoE) | 230B(MoE) |

| 激活参数量 | 约 40B 等效 | 未公开 | 10B |

| 上下文窗口 | 200K token | 1M token(原生 256K + YaRN 扩展) | ~200K token |

| 最大输出 | 163,840 token | 65,536 token | 未公开 |

| 架构特点 | 稀疏 MoE,长上下文 | 混合线性注意力 + MoE | MoE,Agent 原生 |

| 训练硬件 | 华为昇腾 910B(零 NVIDIA) | 未公开 | 未公开 |

| 开源状态 | MIT | API-only | 开源权重(HuggingFace) |

| 推理模式 | 可切换 | 始终开启 CoT | 标准模式 |

关键差异分析:

- 上下文窗口:Qwen3.6 Plus 以 100 万 token 一骑绝尘,是 GLM-5.1 和 M2.7 的 5 倍。对于需要喂入整个代码库或超长文档的场景,这是一个实质性优势。

- 开源情况:GLM-5.1 采用最宽松的 MIT 协议,M2.7 也开源了权重,Qwen3.6 Plus 目前仅提供 API 访问。如果你有本地部署需求,Qwen 暂时不在考虑范围。

- 训练硬件:GLM-5.1 完全基于华为昇腾芯片训练,这是目前唯一在旗舰级模型上实现"零英伟达"的案例,对于关注算力自主性的团队有特殊意义。

二、编码能力对比

这是 2026 年大模型竞争最激烈的赛道。三款模型都把编码作为核心卖点,但侧重点不同。

2.1 核心 Benchmark 对比

| 基准测试 | GLM-5.1 | Qwen3.6 Plus | MiniMax M2.7 | 说明 |

|---|---|---|---|---|

| SWE-Bench Pro | 58.4 🥇 | 56.6 | 56.22 | 多文件、多步骤的真实代码修复 |

| SWE-bench Verified | — | 78.8 | — | 代码修复验证集 |

| Terminal-Bench 2.0 | 69.0 🥇 | 61.6 | 57.0 | 真实终端环境下的工程任务 |

| NL2Repo | 42.7 | — | 39.8 | 从自然语言生成整个代码仓库 |

| CyberGym | 68.7 | — | — | 网络安全代码测试 |

| VIBE-Pro | — | — | 55.6 | 端到端项目交付 |

| SWE Multilingual | — | 73.8 | 76.5 | 多语言代码修复(注:两者基准可能不同) |

| MCPMark | — | 48.2 | — | MCP 工具调用可靠性 |

| LiveCodeBench | — | 87.1 | — | 实时代码生成 |

⚠️ 注意:部分 Benchmark 的评估设置可能不同(如使用的 harness、是否开启 tool use 等),跨模型直接对比需谨慎。上表标注 🥇 的为该项公开成绩中的最高分。

2.2 编码能力解读

GLM-5.1:长周期代码优化的王者

GLM-5.1 最大的亮点不在于单次通过率,而在于它能持续优化数小时甚至整天。在 VectorDBBench 测试中,GLM-5.1 跑了 655 轮迭代、超过 6000 次工具调用,最终将数据库查询性能提升到 21,500 QPS,是最初的 6 倍。在 KernelBench GPU 内核优化中,它达到了 3.6 倍加速,并且在超过 1000 轮后仍在持续改进。这种"跑得越久效果越好"的特性,让它特别适合长时间自主运行的编码 Agent 场景。Z.ai 声称 GLM-5.1 能在 8 小时内从零构建一个完整的 Linux 桌面环境。

现在多在晚上时段和半夜时段使用,白天(尤其是下午)基本不可用,服务总是返回繁忙。并且套餐是三倍计费。

Qwen3.6 Plus:速度与广度的均衡选手

Qwen3.6 Plus 的编码能力以速度和广度见长。社区测试显示它的推理速度约为 Claude Opus 4.6 的 3 倍,达到 158 token/秒。在终端操作类任务(Terminal-Bench 2.0)上,它以 61.6 分超过了 Claude Opus 4.5 的 59.3 分,这在半年前是不可想象的。

MCPMark 48.2 分(当前公开最高)说明它在 MCP 工具调用链上表现稳定,这对于构建复杂 Agent 工作流至关重要。

其实最大的感触是上下文1M,基本可以容纳整个代码项目的,感觉对文档和计划上效果很不错,更大的上下文有更多的记忆空间,对编程类项目的开发和构建上,配合着rule + skills 等操作起来更顺畅,一致性更好,不会突然脱离项目的代码框架规则约束。

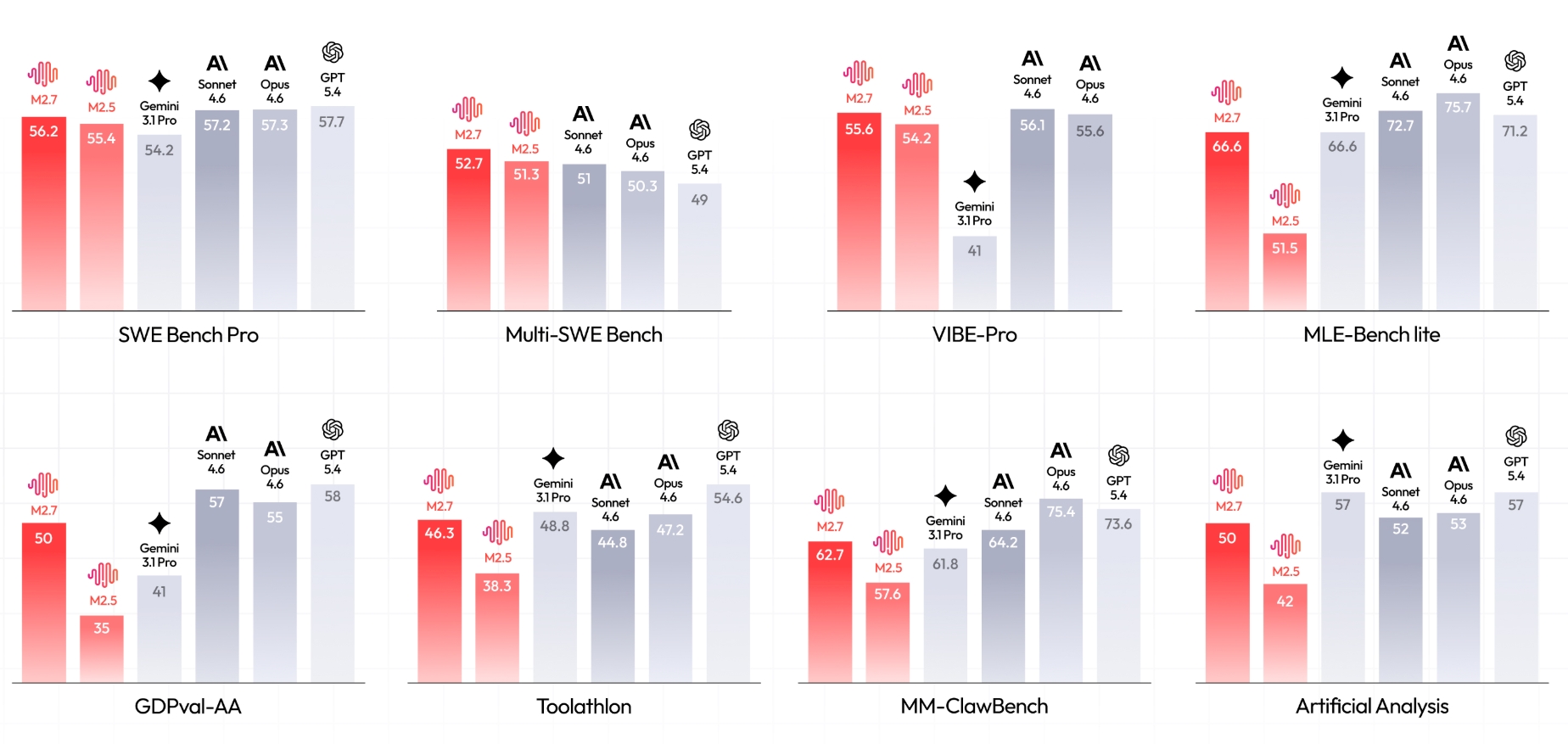

MiniMax M2.7:工程实战派

M2.7 的编码定位偏向"工程实战"。它强调的不是跑分,而是在真实生产环境中的问题解决能力。MiniMax 分享了一个案例:M2.7 能将线上故障排查恢复时间压缩到 3 分钟以内——从监控告警关联、到数据库根因定位、到提交修复 MR,全程自主完成。

在 MLE Bench Lite(机器学习竞赛)上,M2.7 的最佳成绩是 22 场比赛中获得 9 金 5 银 1 铜,奖牌率 66.6%,仅次于 Opus-4.6 和 GPT-5.4。

三、推理能力对比

推理能力是大模型的天花板,直接决定了模型能解决多复杂的问题。

| 基准测试 | GLM-5.1 | Qwen3.6 Plus | MiniMax M2.7 | 说明 |

|---|---|---|---|---|

| AIME 2026 | 95.3 | 95.1 | 89.8 | 高中数学竞赛 |

| HLE | 31.0 | 28.8 | 28.0 | "人类最后的考试" |

| HLE(w/ Tools) | 52.3 | 50.6 | — | 带工具的 HLE |

| HMMT Nov 2025 | 94.0 | 94.6 | 81.0 | 大学生数学竞赛 |

| GPQA Diamond | 86.2 | 90.4 | — | 研究生级别问答 |

| MMLU Pro | — | 88.5 | — | 多学科综合知识 |

| Vending Bench 2 | $5,634 | — | — | 长期经济决策模拟 |

推理能力解读:

- GLM-5.1 在 AIME 和 HLE 这两个最具含金量的推理测试上领先,说明它的逻辑推理天花板更高。

- Qwen3.6 Plus 在 GPQA Diamond 上以 90.4 分大幅领先,这得益于它始终开启的 CoT(思维链)推理模式。

- MiniMax M2.7 在数学推理上与前两者有 5-6 分的差距,这是它相对薄弱的环节。

四、Agent 能力对比

Agent 能力是 2026 年模型竞争的新焦点。三款模型都强调了 Agent 场景,但方向截然不同。

| 能力维度 | GLM-5.1 | Qwen3.6 Plus | MiniMax M2.7 |

|---|---|---|---|

| 工具调用 | 强 | 强(MCPMark 48.2) | 强(Toolathon 46.3%) |

| 长周期任务 | ⭐⭐⭐(655 轮迭代) | ⭐⭐(3 小时限制) | ⭐⭐⭐(100+ 轮自进化) |

| 多 Agent 协作 | 支持 | 支持 | 原生 Agent Teams |

| 自我进化 | ❌ | ❌ | (核心卖点) |

| 技能遵循率 | 未公开 | 未公开 | 97%(40+ 复杂技能) |

| 办公文档处理 | 未强调 | 强(OmniDocBench 91.2) | 强(Word/Excel/PPT) |

| 专业领域 ELO | 未公开 | 未公开 | 1495(GDPval-AA) |

Agent 能力解读:

GLM-5.1——马拉松选手

GLM-5.1 的核心卖点是"长周期有效性"。传统模型在几十轮后会陷入重复策略、效果停滞,GLM-5.1 则能在数百轮迭代中持续发现新的优化路径。这对于需要长时间自主运行的 Agent(如自动化代码审查、持续性能优化)是致命优势。

Qwen3.6 Plus——全能工具人

Qwen3.6 Plus 的 Agent 能力以"广"取胜。1M token 上下文让它在处理超长任务历史时游刃有余,MCPMark 最高分说明它的工具调用最可靠。preserve_thinking 参数允许在 Agent 循环中保持思维链连续性,这是一个很实用的工程细节。

MiniMax M2.7——自进化先锋

M2.7 最独特的能力是"自我进化"。在内部开发中,M2.7 被用于优化自身的编程表现:它自主执行了超过 100 轮"分析失败轨迹→制定修改计划→修改代码→运行评估→决定保留或回滚"的迭代,最终实现了 30% 的性能提升。

此外,M2.7 的 97% 技能遵循率(40+ 个超过 2000 token 的复杂技能)说明它在生产级 Agent 场景中非常可靠。

五、多模态与文档能力

| 基准测试 | GLM-5.1 | Qwen3.6 Plus | MiniMax M2.7 |

|---|---|---|---|

| OmniDocBench v1.5 | — | 91.2 | — |

| RealWorldQA | — | 85.4 | — |

| OSWorld-Verified | — | 66.3 | — |

| Office 文档生成 | 未强调 | 未强调 | (Excel/PPT/Word) |

| 金融建模 | 未强调 | 未强调 | (TSMC 案例验证) |

Qwen3.6 Plus 在文档理解和现实世界问答上有明显优势,OmniDocBench 91.2 分和 RealWorldQA 85.4 分都是当前最高水平。MiniMax M2.7 则在办公文档的实际生成和编辑上投入了大量优化,能直接产出可编辑的 Excel 模型、PPT 报告和 Word 文档。

六、生态与可用性

| 维度 | GLM-5.1 | Qwen3.6 Plus | MiniMax M2.7 |

|---|---|---|---|

| 兼容 Claude Code | |||

| 兼容 OpenClaw | — | ||

| 本地部署 | (HuggingFace/ModelScope) | ❌ | (HuggingFace) |

| API 平台 | api.z.ai / BigModel.cn | OpenRouter / 阿里云 | platform.minimax.io |

| 推理框架 | vLLM / SGLang | — | — |

| API 定价 | ~$1.00/M token | 免费(OpenRouter 预览期) | 1.20/M 输出 |

关键发现:

- 价格方面,Qwen3.6 Plus 在 OpenRouter 预览期内完全免费,性价比无敌,但预览期结束后如何定价尚不明确。

- 本地部署,只有 GLM-5.1 和 M2.7 提供了开源权重。GLM-5.1 的 MIT 协议最为宽松。

- 生态兼容,三款模型都支持主流编码 Agent 工具(Claude Code、OpenCode 等),迁移成本低。

七、选型建议

选 GLM-5.1 如果你需要:

- 长时间自主运行的编码 Agent——它的长周期优化能力是独一无二的

- 完全自主可控的本地部署——MIT 协议 + 华为昇腾训练,信创场景首选

- 最高的 SWE-Bench Pro 得分——如果你只看一个代码能力指标

选 Qwen3.6 Plus 如果你需要:

- 超长上下文处理——100 万 token,喂入整个代码库无压力

- 最快的推理速度——158 token/秒,约为 Claude Opus 4.6 的 3 倍

- 最强的文档理解能力——OmniDocBench 和 RealWorldQA 双料第一

- 零成本试用——OpenRouter 免费预览期,试错成本为零

选 MiniMax M2.7 如果你需要:

- 生产级办公自动化——Word/Excel/PPT 的生成和编辑能力经过专门优化

- 金融等专业领域分析——GDPval-AA ELO 1495,开源模型中最高

- 多 Agent 协作系统——原生 Agent Teams 支持

- 自我进化的 Agent 工作流——能持续优化自身表现的独特能力

八、总结

| 维度 | 最强选手 | 说明 |

|---|---|---|

| 编码(综合) | GLM-5.1 | SWE-Bench Pro 全球第一,长周期优化无人能及 |

| 终端操作 | GLM-5.1 | Terminal-Bench 2.0 领先 7.4 分 |

| 推理(数学) | GLM-5.1 | AIME 95.3,HLE 31.0 |

| 推理(专业) | Qwen3.6 Plus | GPQA Diamond 90.4,MMLU Pro 88.5 |

| 文档理解 | Qwen3.6 Plus | OmniDocBench 91.2,RealWorldQA 85.4 |

| 推理速度 | Qwen3.6 Plus | 158 token/秒,约为竞品 3 倍 |

| 上下文长度 | Qwen3.6 Plus | 100 万 token,远超竞品的 20 万 |

| 办公生产力 | MiniMax M2.7 | GDPval-AA ELO 1495,办公文档处理最强 |

| 自我进化 | MiniMax M2.7 | 唯一具备模型自进化能力的选手 |

| 工具调用可靠性 | Qwen3.6 Plus | MCPMark 48.2,当前最高 |

| 开源友好度 | GLM-5.1 | MIT 协议,最宽松 |

三款模型各有千秋,没有绝对的赢家。GLM-5.1 是编码和推理的天花板选手,Qwen3.6 Plus 是速度和广度的全能王,MiniMax M2.7 则在办公场景和 Agent 自进化上开辟了独特赛道。

对于个人开发者,建议先在 OpenRouter 上免费试用 Qwen3.6 Plus,感受 100 万上下文的震撼;如果需要本地部署或长时间运行编码 Agent,GLM-5.1 的 MIT 协议和长周期优化能力是最佳选择;如果你的业务场景涉及大量文档处理、金融分析或多 Agent 协作,MiniMax M2.7 值得深入评估。

数据来源:

- GLM-5.1 官方博客:z.ai/blog/glm-5.…

- MiniMax M2.7 官方公告:www.minimax.io/news/minima…

- Qwen3.6 Plus 官方博客:qwen.ai/blog?id=qwe…

- GLM-5.1 HuggingFace:huggingface.co/zai-org/GLM…

- BenchLM 模型评测:benchlm.ai

- OpenRouter 基准测试:openrouter.ai

(本文数据截至 2026 年 4 月,模型能力仍在持续迭代中,部分 Benchmark 评估条件可能不同,请以官方最新数据为准。本文部分内容由 AI 辅助整理。)