核心观点

AI比你家3岁侄子还"笨"。

它不会思考,没有直觉,甚至不知道自己在学什么。

它能下围棋、写文章,靠的只是一套简单的机制:试错学习。

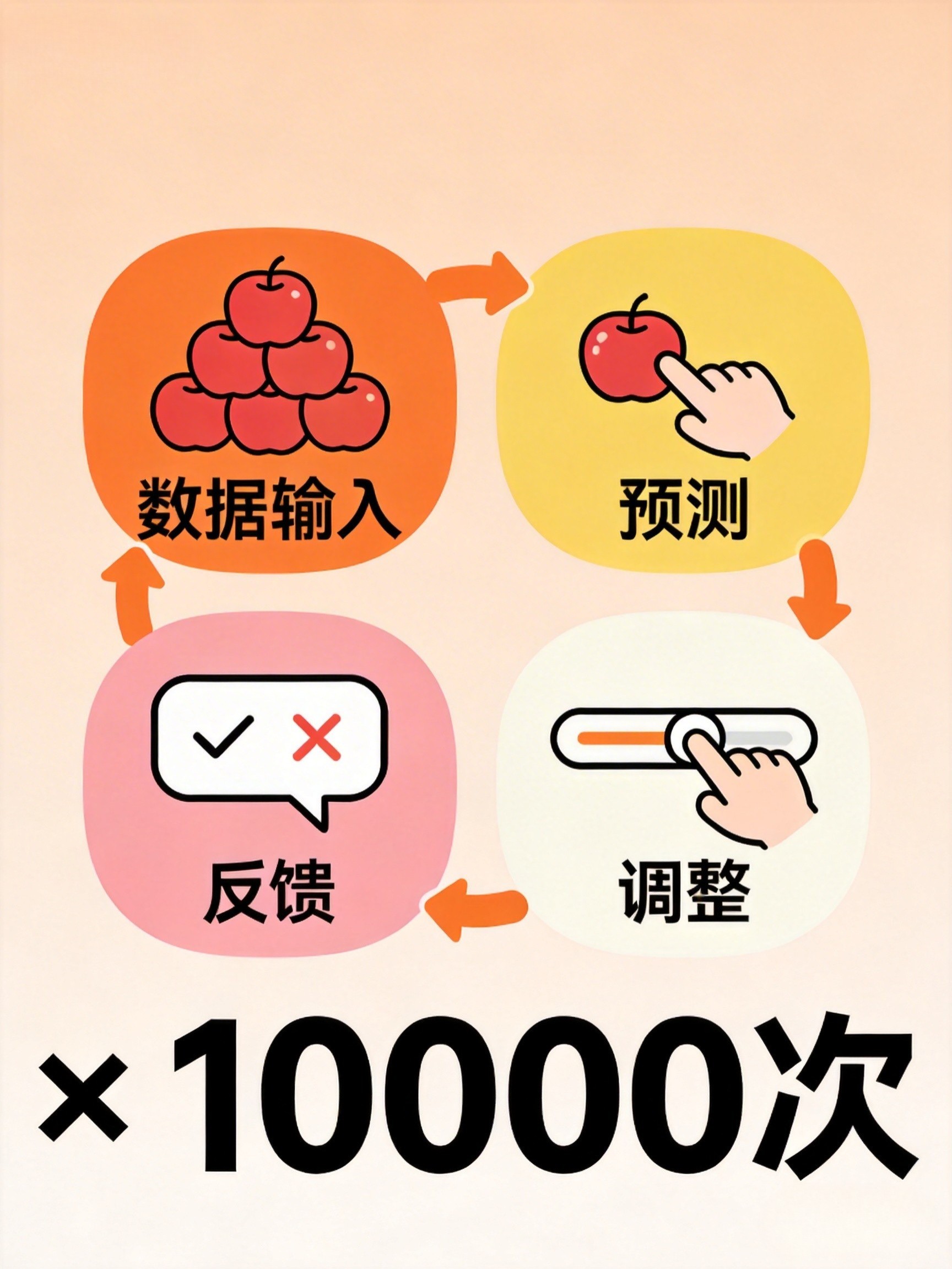

类比:教小孩认水果

教3岁小孩认识苹果的过程:

- 数据输入:给看红苹果、青苹果、切开的苹果

- 预测:让他指"哪个是苹果"

- 反馈:告诉他对错

- 调整:他根据反馈修正认知

这就是监督学习的本质。

AI训练的四步循环

| 步骤 | 对应ML术语 | 作用 |

|---|---|---|

| 数据输入 | Dataset / DataLoader | 提供训练样本 |

| 预测 | Forward Propagation | 模型输出预测结果 |

| 反馈 | Loss Function | 量化预测与真实的差距 |

| 调整 | Backward Propagation + Optimizer | 更新模型参数 |

循环次数:通常是成千上万次(epochs)。

💡 AI没有顿悟,只有loss逐渐收敛。

关键:为什么必须"纠错"?

无标签数据 = AI无法学习。

监督学习的核心是有标签数据(Labeled Data)。

Loss Function告诉AI"你错了多少",Optimizer告诉AI"怎么改"。

核心真相:AI是数据的镜子

GIGO原则:Garbage In, Garbage Out

- 高质量数据 → 高质量模型

- 错误标注数据 → 错误行为模型

💡 AI没有价值观,它只是数据的统计反射。

快速测试

| 问题 | 答案 |

|---|---|

| AI学习需要什么? | 数据 + 标签 + 迭代 |

| 模型预测错误的原因? | 通常是数据问题 |

| 人类相比AI的优势? | 判断力和创造力 |

💡 AI擅长执行,人类擅长决策。

结语

理解AI的本质,才能更好地使用AI。

下一篇将深入LLM的训练机制。

💡 记住:别怕AI替代你,它连自己在干什么都不知道。