别慌,这不是又一个新概念

看到"Harness Engineering"这个词,你的第一反应是不是:"完了,AI圈子又造新词了,我是不是又落后了?"

先深呼吸,跟我念三遍:拒绝Fomo!拒绝Fomo!拒绝Fomo!

其实Harness Engineering不是什么凭空冒出来的新概念。工程师们早就在做这些事,只是现在有了个更形象的名字。就像你给家里那只天天捣乱的猫起个外号叫"拆迁办主任"——东西还是那些东西,只是叫法更生动了。

那它到底是什么呢?咱们从头说起。

Harness Engineering到底是个啥?

1.1 先从一个比喻说起

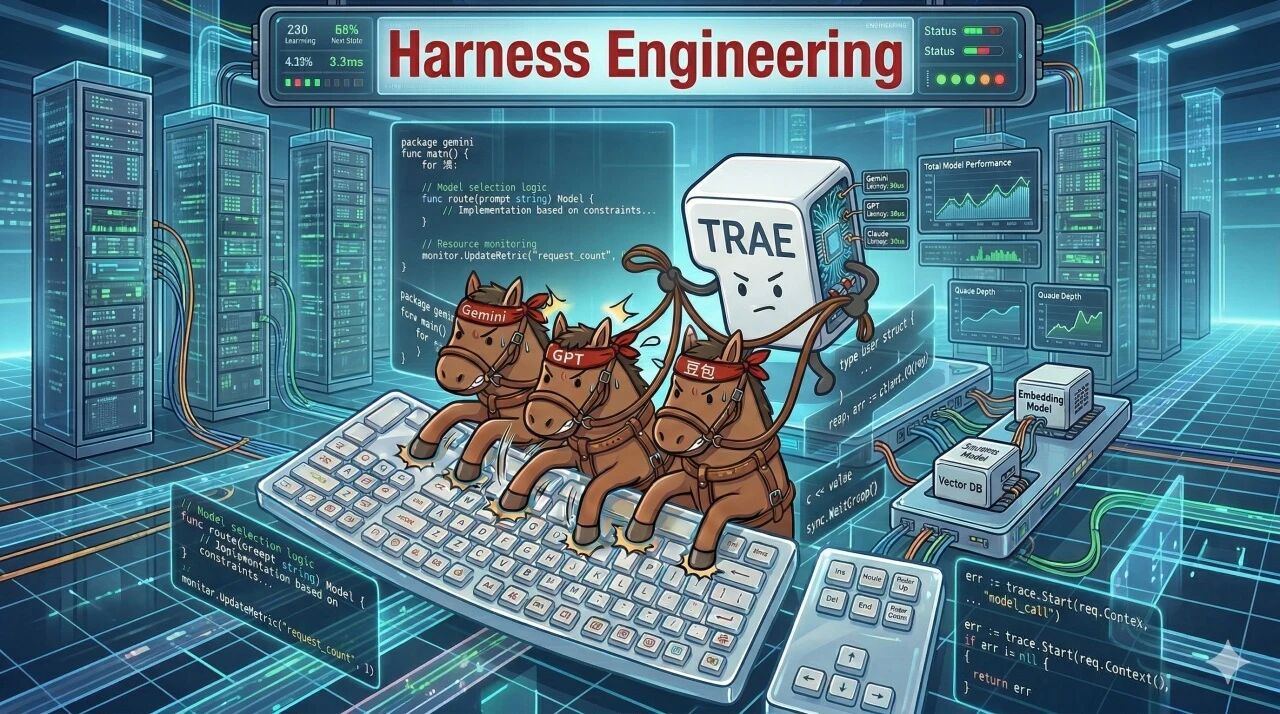

想象你有一匹马。

不是普通的马,是一匹野马——跑得快、力气大、潜力无限,但就是不听话。你想让它往东,它偏往西;你想让它拉车,它去追蝴蝶。

这时候你怎么办?

你不能改变它的基因(那是生物学家的事),但你可以给它套上马具——缰绳、马鞍、马镫。有了这些,你就能驾驭这匹野马,让它变成真正的"千里马"。

Harness Engineering就是这套马具。

1.2 官方定义(说人话版)

这个概念是HashiCorp联合创始人Mitchell Hashimoto提出的,OpenAI的报告让它火了起来。

官方说法是:Harness Engineering是"除了LLM本身之外,让Agent真正能干活的一切基础设施"。

用人话翻译一下:

- AI大模型 = 那匹野马(聪明但不受控)

- Harness = 马具(约束和引导系统)

- AI Agent = 千里马(能真正干活的智能助手)

1.3 它不是什么?

为了更好理解,咱们说说它不是什么:

❌ 不是更好的提示词(Prompt)

提示词是你跟AI说的话,Harness是AI干活的"工作环境"。就像你给员工布置任务 vs 给员工配电脑、建制度,是两回事。

❌ 不是更强的模型

GPT-4还是GPT-5,那是马的品种问题。Harness Engineering是驯马技术,跟马的血统没关系。

✅ 它是让AI从"会聊天"变成"能干活"的那套体系

为什么我们需要Harness?

2.1 AI正在从"聊天机器人"变成"实习生"

以前的AI就像个问答机:你问,它答。简单、直接、可控。

但现在的AI Agent不一样了——能自己规划、自己执行、自己解决问题。就像一个刚入职的超级实习生:聪明、能干、学得快,但有时候也会犯傻、跑偏、甚至搞砸。

问题来了:你会让一个实习生随便操作公司的核心系统吗?

当然不会。你会:

- 给他明确的任务清单

- 设定权限边界

- 规定汇报流程

- 准备纠错机制

Harness Engineering就是做这些事的技术体系。

2.2 四个核心目标(R.E.S.T模型)

要让AI Agent从"有趣的玩具"变成"可靠的工具",得满足四个条件。我给它起了个好记的名字:R.E.S.T(休息模型,意思是让工程师能安心休息)。

R - Reliability(可靠性)

说人话:系统不能动不动就崩。

具体要求:

- 失败能恢复:任务做到一半断了,能从断点继续,不用从头来

- 操作可重试:同样的操作做两遍,结果不会变(不会把钱转两次)

- 行为可预测:同样的输入,输出应该差不多,不能今天这样明天那样

真实案例:OpenAI在实验中遇到过这种情况——Agent因为某个边界条件陷入无限重试循环,每分钟都在调用付费API。如果凌晨三点没人盯着,早上醒来账单已经烧掉了5万美元。可靠性设计就是要防止这种灾难。

生活类比:就像你点外卖,系统挂了你的订单不能丢;网络卡了重新支付,不会扣你两次钱;今天点的汉堡,明天点应该还是同样的味道。

E - Efficiency(效率)

说人话:又快又省,不花冤枉钱。

具体要求:

- 资源可控:Token消耗、API调用次数、运行时间,心里要有数

- 响应够快:用户问个问题,不能等半天

- 吞吐量大:批量处理任务时,单位时间能干更多活

技术细节:OpenAI的实验数据显示,3人工程师团队用5个月时间,借助Codex Agent完成了超过100万行代码的产品开发,合并了1500多个PR,效率达到传统手动开发的10倍。但这不是说Agent写得快,而是Harness让Agent能24小时不间断工作,且错误率持续降低。

生活类比:就像开车,你要知道油耗(资源)、不能开太慢(延迟)、高速上要尽量保持匀速(吞吐量)。

S - Security(安全性)

说人话:不能让AI乱来,更不能让坏人利用AI乱来。

具体要求:

- 最小权限:AI只能访问它必须访问的东西,其他的看都不能看

- 沙盒执行:不确定的代码要在隔离环境里跑,跑坏了也影响不到外面

- 输入输出过滤:防止有人通过聊天注入恶意指令,防止AI泄露敏感信息

生活类比:就像公司的新员工,只能进自己的工位(最小权限),在培训室里试操作(沙盒),进出要安检(过滤)。

T - Traceability(可追溯性)

说人话:出了问题能查清楚是怎么回事。

具体要求:

- 全链路追踪:AI干了什么、怎么干的、为什么这样干,都要有记录

- 决策可解释:AI为什么这么决定,要能说出个道理

- 状态可监控:系统现在啥情况,要一目了然

生活类比:就像快递物流,从发货到签收每个环节都能查到;如果包裹丢了,能定位到是在哪个环节出的问题。

Harness里都有啥?

现在你知道Harness很重要了,那它具体包含哪些组件呢?

3.1 工作流引擎(Workflow Engine)

作用:让AI知道"先干啥、后干啥"。

AI Agent要完成一个复杂任务,往往需要很多步骤。工作流引擎就是那张"任务清单",告诉AI:

- 第一步:查资料

- 第二步:分析数据

- 第三步:写报告

- 第四步:检查错误

技术实现:

- 有向无环图(DAG):把任务画成流程图,确保不会死循环

- 状态机:明确定义每个步骤的状态和转换条件

- 并行执行:能同时干的事,不要串行等

生活类比:就像厨房里的出餐流程,接单→备料→烹饪→装盘→上菜,每个环节都有明确的顺序和责任人。

3.2 状态管理(State Management)

作用:记住"干到哪了"。

AI干活不是一蹴而就的,可能需要很长时间。状态管理就是那张"进度表",记录:

- 当前做到哪一步了

- 已经完成了什么

- 中间结果存在哪

关键技术:

- 检查点(Checkpoint):定期保存进度,崩了能恢复。OpenAI的实践中,Agent在每个重要操作前自动创建检查点

- 事件溯源(Event Sourcing):记录所有操作历史,能回放、能审计。不是只存最终结果,而是存"干了什么"

- 跨会话状态:LLM天生是无状态的,每次新会话都是白板。Harness要让Agent"记得"上次做了什么、犯了什么错

真实痛点:没有状态管理,同样的错误会在不同会话中一遍遍重演。你昨天教过Agent的事,今天它全忘了。

关键技术:

- 检查点(Checkpoint):定期保存进度,崩了能恢复

- 事件溯源(Event Sourcing):记录所有操作历史,能回放、能审计

- 分布式状态:如果AI分布在多台机器上,状态要同步

生活类比:就像玩游戏时的存档点,打不过Boss可以读档重来,不用从第一关开始。

3.3 工具系统(Tool System)

作用:给AI配"工具箱"。

AI本身只会"说话",要真正干活,需要调用各种工具:查数据库、调API、写文件、发邮件……

设计要点:

- 工具注册:明确列出AI能用什么工具

- 权限控制:不同工具需要不同权限

- 错误处理:工具调用失败怎么办

- 结果解析:工具返回的数据,AI要能看懂

OpenAI的实践:在百万行代码实验中,工程师为Agent设计了完整的工具链——不是让Agent自己造轮子,而是提供标准化的开发工具:CI流水线、Lint检查、测试框架等。Agent调用这些工具来完成代码检查、测试运行、PR提交。

核心理念:做减法比做加法更重要。不要给Agent无限工具,而是提供精心设计的、经过验证的工具集。

生活类比:就像厨师的厨具架,锅碗瓢盆样样齐全,但用哪样、怎么用,都有规矩。

3.4 安全机制(Security Layer)

作用:给AI套上"紧箍咒"。

这是最关键的一层,防止AI"失控"。

核心机制:

- 输入过滤:检查用户输入,防止注入攻击

- 输出审查:检查AI输出,防止泄露敏感信息

- 权限校验:每次操作前确认"你有权这么做吗"

- 沙盒隔离:危险操作在隔离环境执行

架构约束实践:OpenAI用Linter(代码检查工具)来强制执行架构规则。比如规定依赖必须按"Types → Config → Repo → Service → Runtime → UI"的顺序流转,Agent写的代码如果不符合这个规则,提交时就会被拦截。这不是靠Agent自觉,而是靠工具强制。

生活类比:就像银行的金库,进门要验证身份,操作要双人复核,监控全覆盖,异常立即报警。

3.5 可观测性(Observability)

作用:让工程师"看得见"AI在干嘛。

三大支柱:

- 日志(Logging):记录AI的每一步操作

- 指标(Metrics):统计性能数据(响应时间、成功率等)

- 追踪(Tracing):跟踪一个请求的全链路

Context Rot问题:LangChain团队发现,即便模型支持100万Token的上下文,性能衰减往往在25.6万Token左右就出现。这叫"上下文腐烂"——随着对话历史和工具输出不断堆积,模型的指令跟随能力显著下降。可观测性要能监控到这种性能衰减。

生活类比:就像汽车的仪表盘,速度、油量、水温一目了然,故障灯亮了就知道哪里出问题。

3.6 上下文工程:AGENTS.md的秘密

作用:给AI一本"工作手册"。

OpenAI在百万行代码实验中发现,Agent需要明确的指引。于是他们创建了AGENTS.md文件——这是Harness Engineering的"起点"。

AGENTS.md里写什么:

- 构建步骤和测试命令

- 编码约定和架构约束

- 常见陷阱和最佳实践

- 项目结构和依赖关系

关键教训:OpenAI最初写了一个"成百上千页的巨型说明书",结果发现效果很差。问题在哪?

- 上下文稀缺:巨大文件挤占了任务和代码的空间

- 指令失效:过多规则导致模型模式匹配而非真正理解

- 知识腐烂:手册缺乏维护,变成陈旧规则的坟场

解决方案:把AGENTS.md从"百科全书"变成"索引地图",压缩到100行左右。核心原则是渐进式披露——Agent从极小切入点开始,按需分层获取信息。

真实数据:LangChain团队仅通过优化Harness(外部环境),在Terminal Bench 2.0基准测试中,排名从全球第30位跃升至第5位,得分从52.8%飙升至66.5%,而底层模型一个参数都没改。

实战案例——OpenAI的百万行代码实验

说了这么多理论,咱们看最真实的案例:OpenAI的百万行代码实验。

4.1 实验背景

2025年8月,OpenAI启动了一个实验性项目:从第一个Commit开始由CodeX Agent完成,人类程序员不得手动输入一行代码。

实验结果:

- 3人工程师团队(后来扩展到7人)

- 5个月时间

- 超过100万行代码

- 1500多个PR合并

- 服务数百名内部用户的真实产品

- 零行人工手写代码

4.2 人类工程师在做什么?

既然不写代码,那工程师每天在干嘛?

答案是:构建Harness。

他们的工作变成了:

- 设计环境:搭建Agent自主循环的基础设施——仓库、CI流水线、Lint规则、开发工具

- 明确意图:用清晰的语言告诉Agent需求,而不是模糊地说"帮我做个功能"

- 建立循环:描述任务 → 运行Agent → Agent发起PR → Agent自我审查 → 其他Agent交叉审查 → Agent根据反馈修改 → 循环直到通过

核心理念:"Humans steer, agents execute"(人类掌舵,代理执行)

4.3 Harness的核心设计

代码仓库是唯一的知识来源:

- Agent看不到仓库之外的东西

- 所有知识(代码、文档、schema、可执行计划)都版本化存在仓库里

- 没有外部wiki,没有Notion文档,没有"口口相传"的潜规则

- 隐性知识必须显性化,因为Agent不会来问你

约束才是生产力: OpenAI发现,当文档不够用时,要把规则升级为可执行工具。他们通过自定义Linter强制执行依赖流向:Types → Config → Repo → Service → Runtime → UI。Agent写的代码如果不符合规则,提交时就会被拦截。

错误即教学时刻: Mitchell Hashimoto的核心理念:"每当Agent犯一个新类型的错误,就回头加一条约束。"日积月累,Harness越来越健壮,Agent能犯的错越来越少。这是一个正向的复利飞轮。

4.4 我们能学到什么?

从OpenAI的实践中,可以提炼出几个关键认知:

- Agent不难,Harness才难:模型能力只是基础,真正的挑战在于构建让Agent能稳定工作的环境

- 约束不是限制,而是保护:规则看似限制了Agent的自由,实际上让它能更安全、更可靠地发挥能力

- 复利效应:每解决一个错误类型,系统就变得更健壮一点,长期积累形成护城河

- 工程师转型:从"写代码的人"变成"设计系统的人",从亲自奔跑变成驾驭野马

给你的行动建议

看完这篇文章,你可能想问:"那我该怎么开始呢?"

5.1 如果你是开发者

第一步:创建AGENTS.md 这是最简单的起点。在你的项目根目录创建一个AGENTS.md文件,包含:

# 项目构建指南

## 构建命令

- 安装依赖:`npm install` 或 `pip install -r requirements.txt`

- 运行测试:`npm test` 或 `pytest`

- 代码检查:`npm run lint` 或 `ruff check .`

## 编码规范

- 使用ESLint/Prettier(前端)或Ruff(Python)

- 函数长度不超过50行

- 必须包含类型注解

## 常见陷阱

- 不要直接修改生产环境配置

- API调用必须加错误处理

- 敏感信息不要硬编码

第二步:添加基础Harness组件

- 操作日志:记录Agent的每次工具调用和决策

- 状态检查点:在关键操作前保存状态,支持回滚

- 简单Linter:用现有工具(ESLint、Ruff)检查Agent生成的代码

第三步:建立反馈循环

Agent执行任务 → 生成代码 → 自动检查 →

发现问题 → 记录错误类型 → 更新AGENTS.md →

下次避免同类错误

具体技术栈推荐:

- CI/CD:GitHub Actions、GitLab CI

- 代码检查:ESLint、Ruff、import-linter

- 测试框架:Jest、Pytest

- 可观测性:LangSmith、OpenTelemetry

5.2 如果你是产品经理

第一步:明确边界

- 定义AI能做什么、不能做什么

- 确定哪些操作需要人工确认

- 设定资源使用上限

第二步:设计反馈

- 用户需要知道AI在干嘛

- 出错时要有清晰的提示

- 提供手动干预的入口

第三步:持续优化

- 收集AI的操作数据

- 分析失败案例

- 迭代改进Harness设计

5.3 如果你是普通用户

第一步:建立正确预期

- AI不是万能的,也会犯错

- 关键操作要自己确认

- 不要把敏感信息随便给AI

第二步:学会观察

- 注意AI的操作日志

- 发现异常及时叫停

- 了解AI的权限范围

第三步:积极参与

- 给AI产品反馈

- 报告异常行为

- 帮助改进Harness设计

结语:驾驭AI,而不是被AI驾驭

Harness Engineering的核心理念可以总结为一句话:给AI套上缰绳,让它成为千里马,而不是脱缰的野马。

这不是要限制AI的能力,而是要让AI的能力可控、可靠、可用。

就像汽车有方向盘和刹车,飞机有自动驾驶和手动模式,AI Agent也需要Harness来确保它安全、高效地完成任务。

2026年,AI正在从"玩具"变成"工具"。Harness Engineering就是这场转变的关键技术。

希望这篇文章能帮你理解这个概念。记住:拒绝Fomo,脚踏实地,从理解开始。

关注引导

如果这篇文章对你有帮助,欢迎点赞、在看、转发三连!你的支持是我持续创作的动力。

想第一时间获取更多AI技术解读?关注我的公众号,一起探索AI的无限可能!