现在打开任何一个AI相关的视频,几乎能听到:Agent、Prompt、Copilot、MCP、Skills、OpenClaw。博主说,厂商说,产品介绍页也说。但问题是,这些词到底是真有用,还是纯粹为了把人挡在门外?

这些词的来源大致分三类。

第一类是绕不开的基础行话。比如Token(AI处理文字的最小单位)、Prompt(你对AI说的话)。这些词从论文到教程到产品界面全是这么写的,你不用都不行。就像医生说CT、摄影师说ISO,学一次就够了,不会制造障碍。

第二类是厂商造的营销词。Copilot、Agent、AI Native,这些词的诞生往往伴随着产品发布或融资需求。厂商需要一个新概念来定义自己的差异化,于是造一个新词,然后通过各种渠道反复灌输,直到它成为"行业标准"。

第三类是技术社区的内行话。RAG(检索增强生成)、CoT(思维链)、Fine-tuning(微调),这些词本来只在技术圈子里流通,但随着AI破圈,它们被带到了大众面前。问题是,普通用户真的需要知道这些吗?

来看这段话:

"在Agentic Workflow下,通过Multi-Agent Orchestration实现RAG增强的CoT Reasoning,结合Fine-tuned的SLM在有限Context Window内完成Tool Use,最终交付一个端到端的AI Native应用。"

去掉黑话翻译一下:让几个AI排好队,一个接一个干活,干之前先查查资料,想清楚再动手,最后做出来一个软件。

意思不复杂,但黑话版本让人望而生畏。

谁在制造黑话

厂商是黑话的主要生产者。

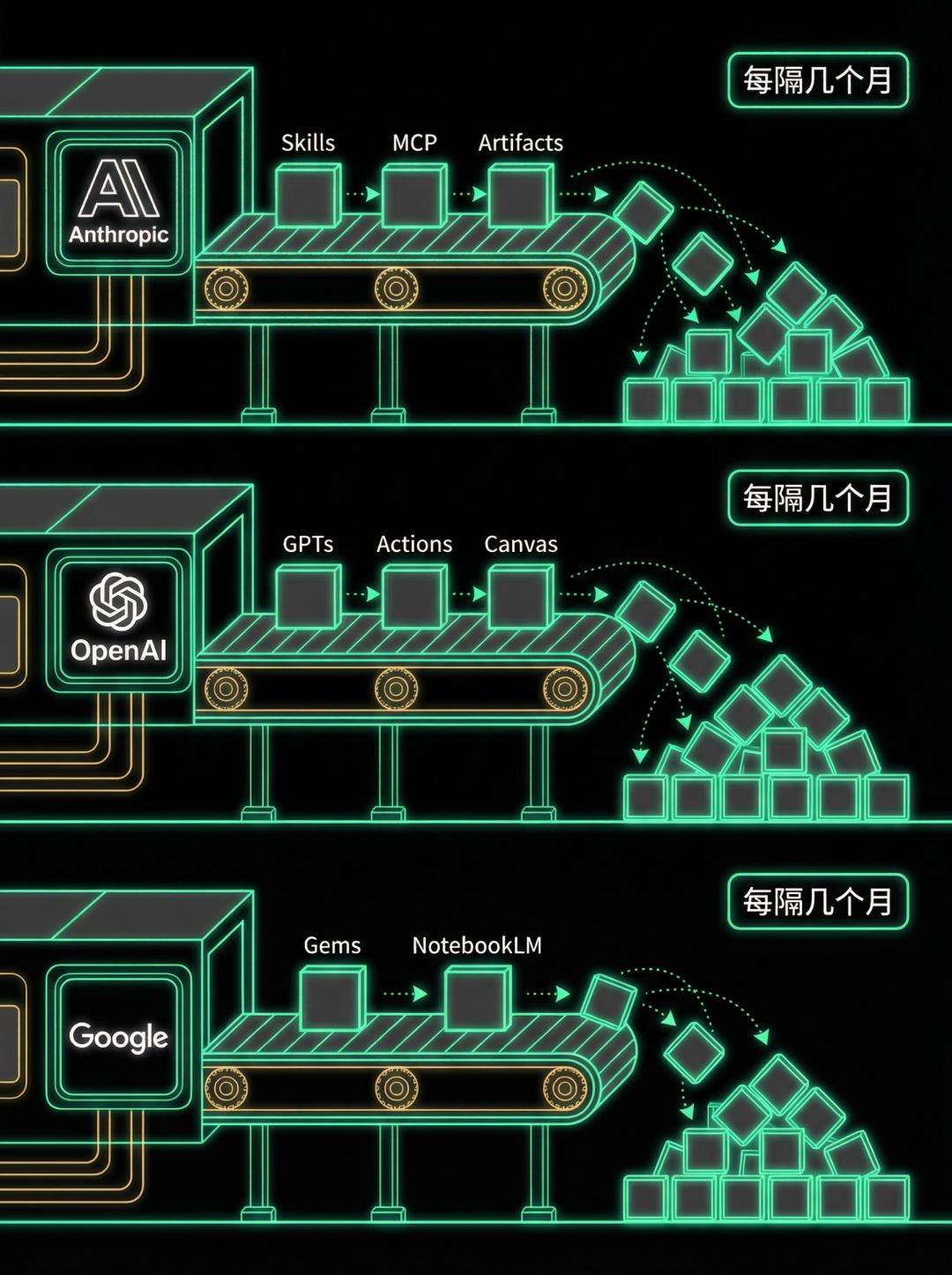

每家公司都想让自己的产品听起来与众不同。微软有Copilot,OpenAI有GPTs,Anthropic有Claude Code,Google有Gemini Extensions。功能其实差不多——让AI调用外部工具完成任务——但每家都要起个新名字,仿佛这是自己的独家发明。

自媒体和培训机构也在推波助澜。用黑话显得专业,能吸引更多关注和付费。一个"AI提示词工程师"课程,比"教你怎么跟AI聊天"听起来值钱多了。

更深层的问题是,黑话制造了一种虚假的门槛。好像不懂这些词,就不配谈AI;好像不会写复杂的Prompt,就用不好AI工具。这种焦虑被刻意放大,形成了"黑话-焦虑-付费学习-更多黑话"的循环。

哪些词真有用,哪些不用理

对于普通用户来说,大部分黑话其实不用学。

如果你只是用AI写个文案、查个资料、做个PPT,知道Prompt(怎么跟AI说话)和Token(AI怎么计费)就够了。RAG、CoT、Fine-tuning这些,是开发者和企业用户才需要关心的技术细节。

即使是开发者,也要警惕过度工程化。很多项目用简单的Prompt就能解决,非要套一个复杂的Agent框架,反而增加维护成本。OpenClaw创始人Peter Steinberger用Claude Code几乎没手动写一行业务代码就做出了整个项目,说明很多时候工具不是关键,想清楚需求才是。

真正需要关注的,是那些正在变成基础设施的概念。比如MCP(Model Context Protocol),这是Anthropic推动的开放标准,让AI能统一调用各种外部工具。如果它成为行业标准,会影响所有AI应用的开发方式。这种词值得了解,因为它改变了游戏规则。

黑话的代价

过度使用黑话,正在造成实际的损害。

提高了认知门槛。很多本来能用AI提升效率的人,被术语吓退,错过了工具红利。

掩盖了真实的价值。当所有产品都标榜自己是"AI Native"、"Agentic Workflow",用户反而分不清谁真有用、谁在炒概念。

制造了不必要的焦虑。很多人花大量时间学习黑话,而不是实际使用工具解决问题。 Prompt Engineering(提示词工程)曾经是个热门职业,但随着AI模型理解能力的提升,它的价值在快速贬值。

阻碍了有效沟通。技术团队和业务团队各说各话,一个说RAG一个说知识库,其实是一回事,但互相听不懂。

怎么破局

对于普通用户,建议是:先用起来,再慢慢学。

AI工具的价值在于解决实际问题,不在于掌握多少术语。从简单的场景开始——让AI写邮件、整理会议纪要、查资料——在使用过程中自然理解那些真正重要的概念。

对于从业者,建议是:说人话。

如果你在做AI产品,用用户能理解的语言描述功能。如果你在做培训,教的是解决问题的方法,而不是背黑话。如果你在写技术文档,先解释概念再堆术语。

对于行业,需要的是去魅。AI不是魔法,是一系列可理解、可掌握的技术和工具。黑话制造的神秘感,短期内能吸引关注,长期看会阻碍普及。