头发丝都能保住?这个视频抠图神器,效果真的有点离谱

做过视频抠像的人都知道,**真正难的从来不是“把人抠出来”**,而是——

做过视频抠像的人都知道,**真正难的从来不是“把人抠出来”**,而是——

头发丝能不能保住? 边缘会不会发白? 人物一动会不会穿帮? 复杂背景下会不会直接翻车?

很多工具乍一看好像能用,但只要你把画面稍微放大一点,问题马上就出来了:边缘锯齿、发丝丢失、轮廓生硬、细节糊成一片。

最近我试了一个项目,确实让我有点惊喜。 它就是 MatAnyone 2。

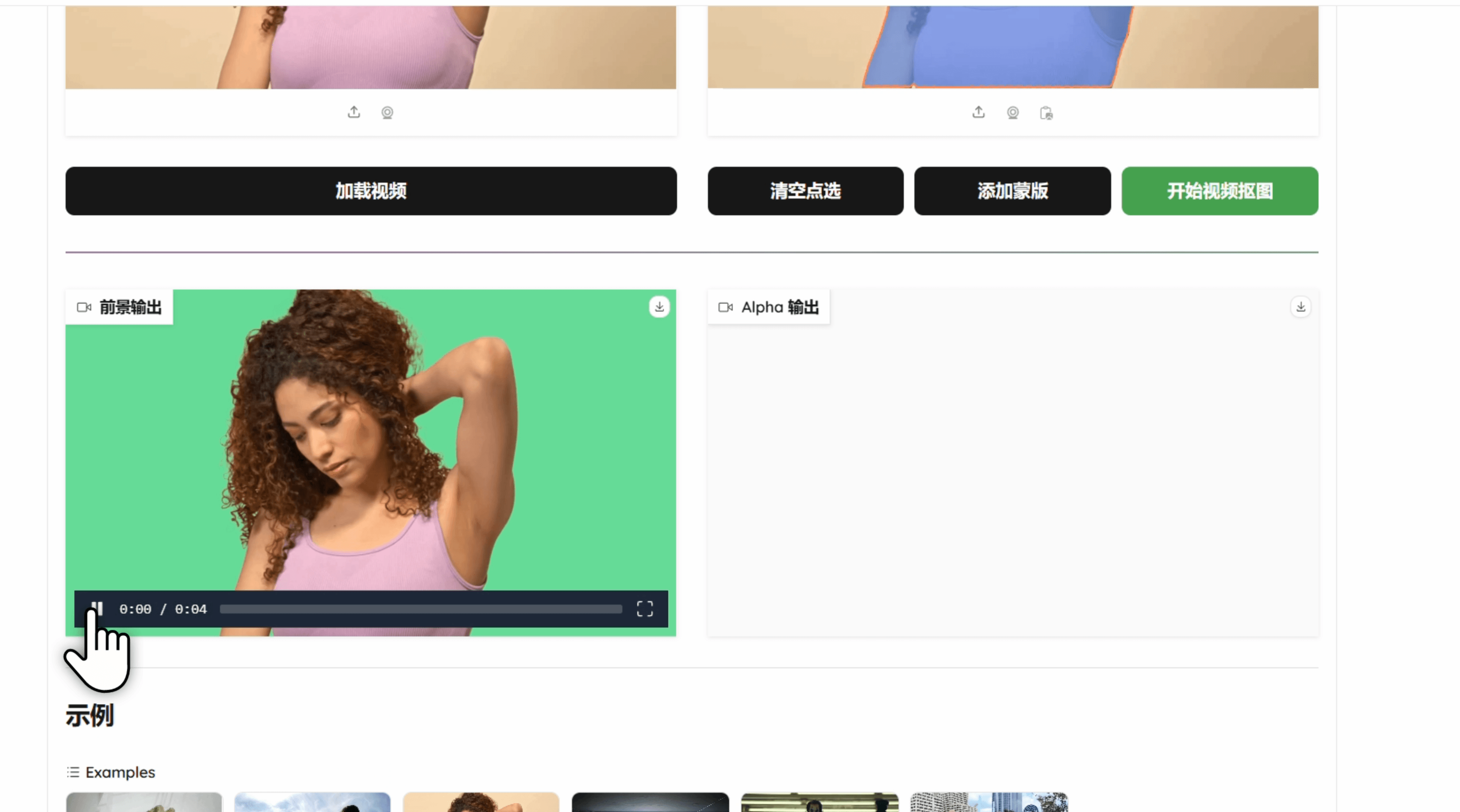

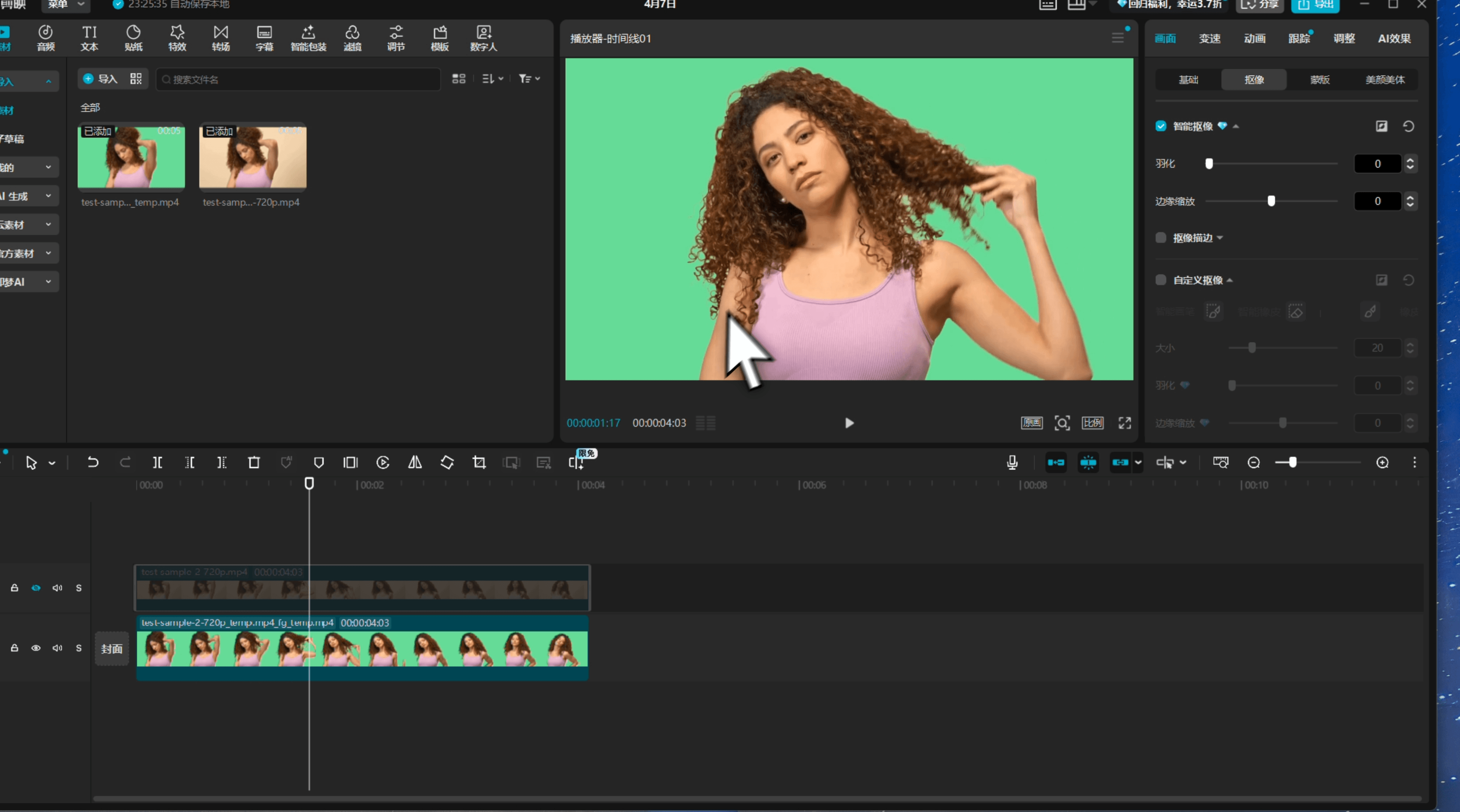

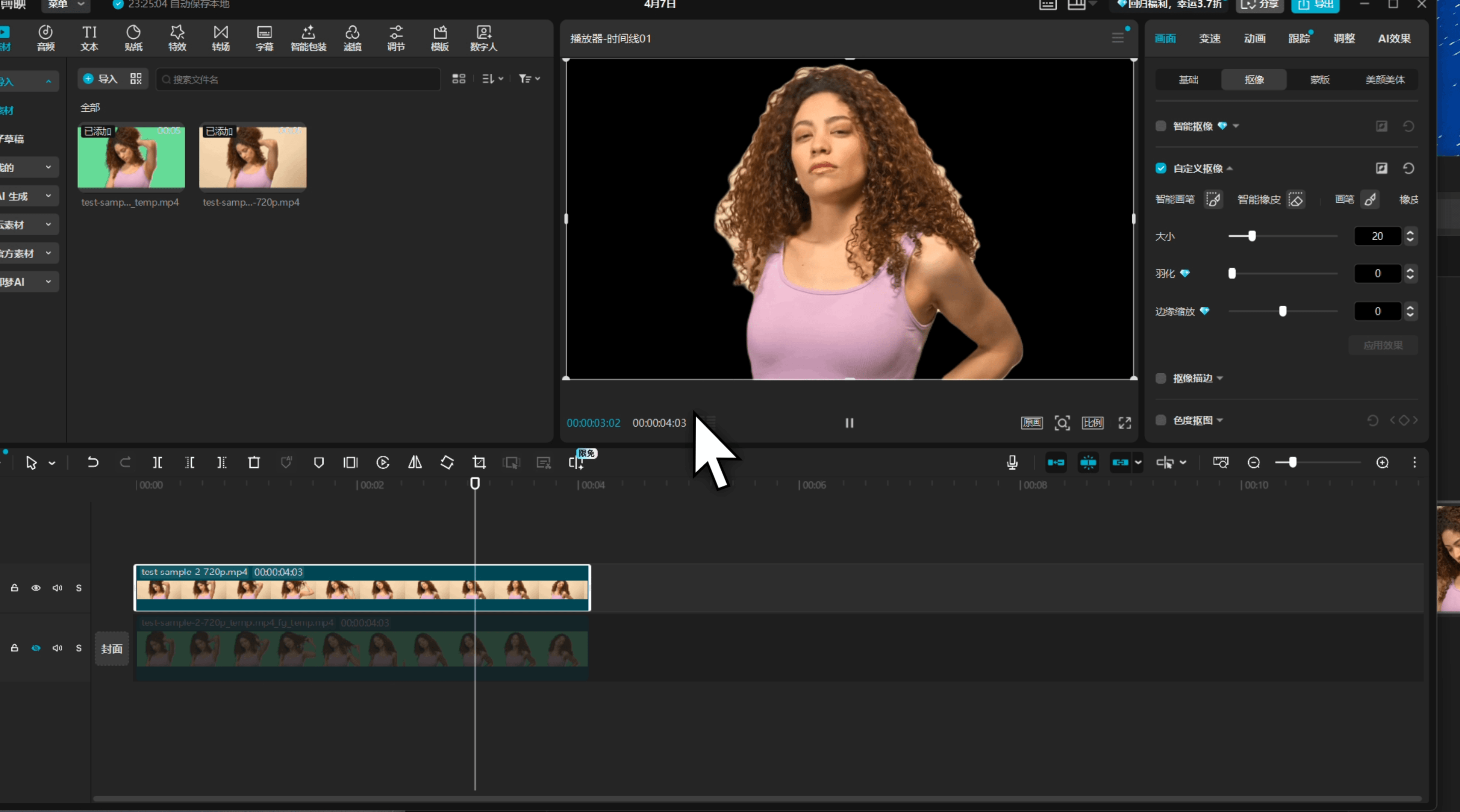

下面 VS 剪映抠人像

MatAnyone 2抠人像

剪映抠人像

官方把它定义为一个实用的人体视频抠图框架,核心思路不是那种“简单粗暴的分割”,而是尽量避免生硬的分割边界,在保留发丝、透明边缘、细节层次这方面做得更好,同时在复杂真实场景下也更稳。

说人话就是:

它不只是把人物“切出来”,而是尽可能把人物“完整留下来”。

为什么这个项目值得关注?

因为它解决的,恰恰是很多视频抠图工具最容易翻车的地方。

比如下面这些场景,很多传统方案都容易崩:

- 头发很多、发梢凌乱

- 背景复杂,不是纯色

- 人物在运动,边缘不断变化

- 光线变化明显

- 半透明区域、细碎边缘比较多

这些情况一出现,普通抠像工具就特别容易出现“分割感”—— 人物虽然被抠出来了,但一眼就能看出是后期抠的,质感非常假。

而 MatAnyone 2 给我的感觉是,它更像是在认真解决“视频级高质量抠图”这件事,而不是单纯做一个人像分割演示。

尤其是发丝细节、边缘过渡、人物轮廓自然度这几个地方,效果会比很多常见工具更让人舒服。

实测感受:这不是普通的“人像分割”

我最直观的感受就一句话:

细节保留得太狠了。

像一些常见的视频抠像工具,远看没问题,近看全是问题。 尤其是头发边缘,很多时候直接糊掉,或者被切得非常生硬。

但 MatAnyone 2 的表现更像是: 该透明的地方透明,该保留的地方保留,该柔和的地方柔和。

特别是人物头发区域,差别会非常明显。

有些工具抠完之后,头发像被“削平”了一样,层次直接没了。 而 MatAnyone 2 则更接近一种“发丝级细节保留”的观感。

如果你之前用过一些视频抠像工具,对头发、边缘、轮廓这些地方一直不满意,那这个项目真的建议你亲自试一下。

项目地址

GitHub: github.com/pq-yang/Mat…

本地安装其实也不复杂

如果你想自己在本地跑起来,可以直接按下面步骤来。

1、克隆仓库

git clone https://github.com/pq-yang/MatAnyone2

cd MatAnyone2

2、创建 Conda 环境并安装依赖

conda create -n matanyone2 python=3.10 -y

conda activate matanyone2

pip install -e .

3、进入 hugging_face 目录,安装界面依赖

cd hugging_face

pip3 install -r requirements.txt

这里需要 FFmpeg 支持。

4、启动 Demo

python app.py

启动后,就会出现交互式界面,直接就能体验。

不想折腾环境?2 分钟直接上云体验

说实话,很多人不是不会用,而是懒得配环境。

Conda、依赖、模型下载、FFmpeg、显卡、版本兼容…… 这些东西对技术用户来说不算大事,但对普通用户来说,确实很烦。

所以如果你只是想先看效果、先跑起来,那更建议直接用云端。

注册账号

www.xiangongyun.com/register/TG…

部署镜像

www.xiangongyun.com/image/detai…

这种方式最大的好处就是:

省时间。 不用自己配环境,不用自己处理依赖,也不用自己下载一堆东西,几分钟就能开始体验效果。

对很多人来说,这才是最省心的打开方式。

我已经把它做成了离线整合包,解压就能用

如果你连云端都不想折腾,只想要一种更直接的方式,那也可以。

我这边已经把这个项目整理成了离线整合包,处理好了环境和使用流程,基本上就是:

下载 → 解压 → 打开就用

这对于下面几类人会特别友好:

- 不想自己配环境的人* 想快速测试效果的人 很多项目本身很强,但就是卡在“安装门槛高”这一步。 而整合包最大的价值,就是帮你把这些前面的麻烦事尽量省掉。