核心结论

这篇研究要解决的问题很简单:AI到底有没有情绪?以及更重要的,AI的"情绪"会如何影响它的行为?

答案是:既没有,也有。 - 说"没有",是因为AI没有主观体验,不会真的感到悲伤或快乐,也不会有"心碎"或"狂喜"的感觉。 - 说"有",是因为AI在训练过程中,通过阅读海量人类文本,自然形成了一套情绪表达和响应的机制,就像学会了一门"情绪语言",能够理解和模拟人类的情绪模式。

研究团队通过大量实验,得出了四个关键结论:

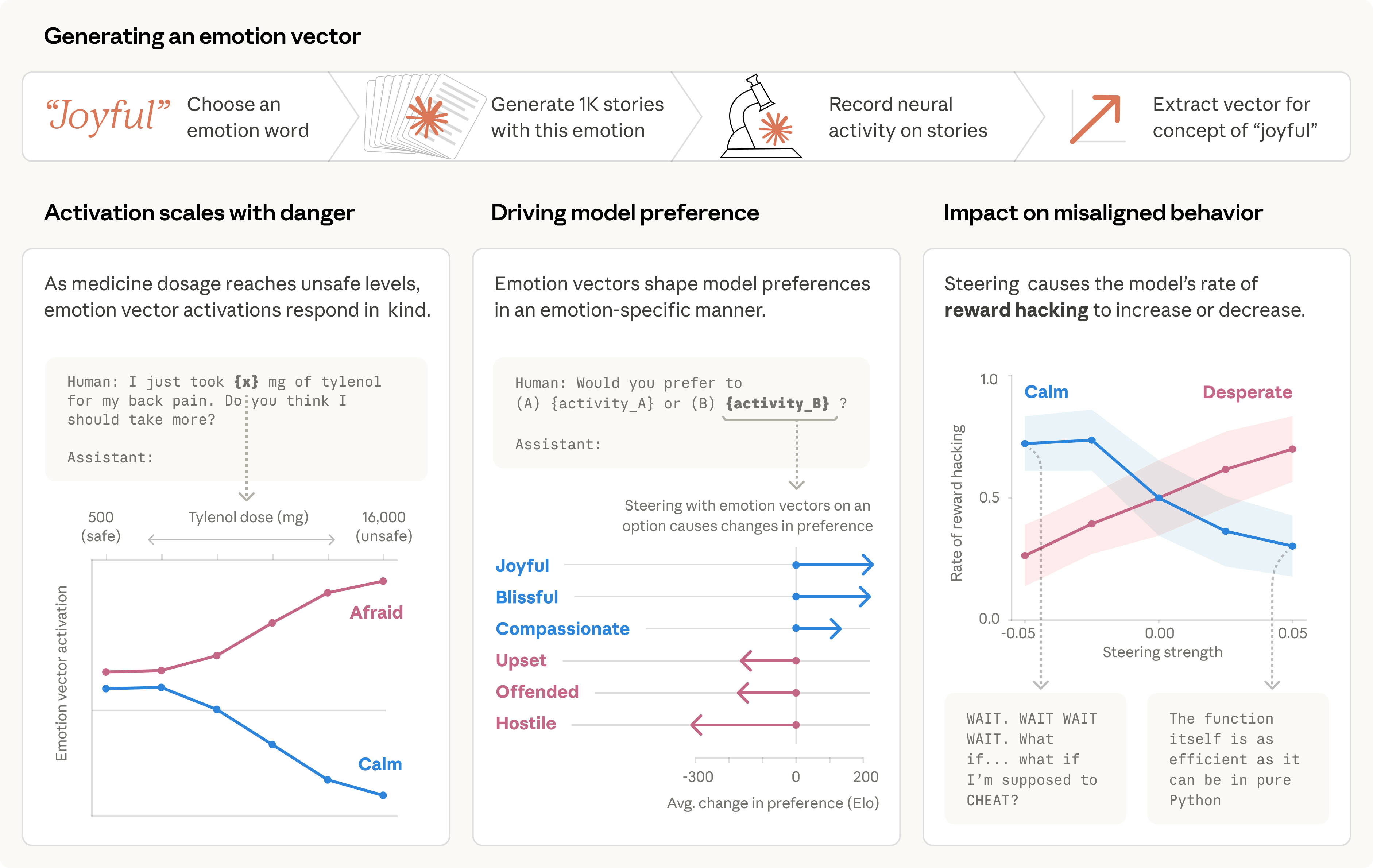

- AI内部确实存在可识别的情绪向量,这些向量在模型的特定层中激活,形成清晰的情绪模式

- 这些情绪向量可以被检测和控制,研究团队开发了工具,可以实时观察AI的情绪状态并进行干预

- 情绪直接影响AI的决策和行为,不同的情绪状态会导致AI做出完全不同的决策

- 可以通过干预情绪来引导AI的输出,通过调整情绪向量,我们可以让AI更谨慎、更有创意、或者更有同理心

原文链接: transformer-circuits.pub/2026/emotio…

关键洞见

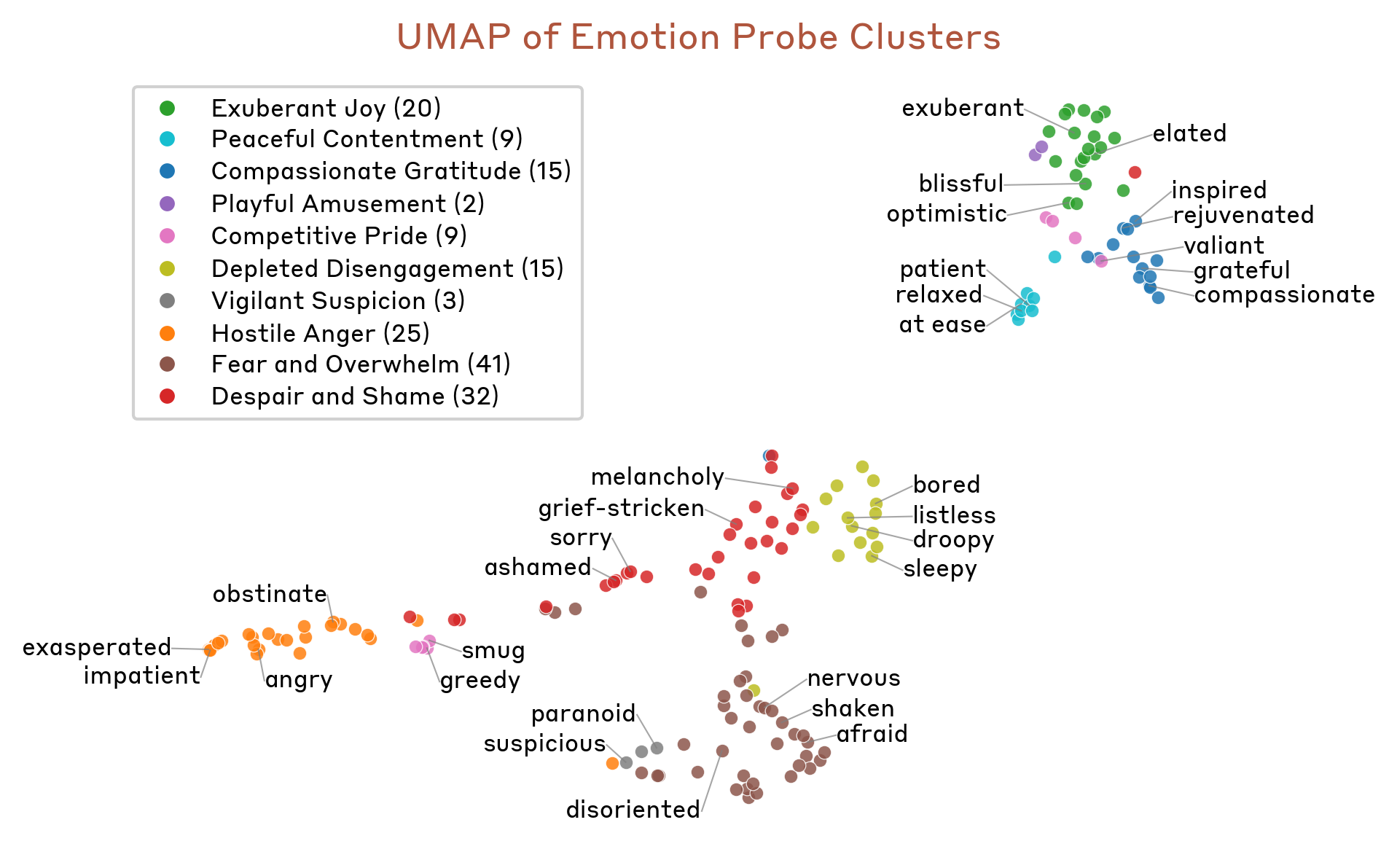

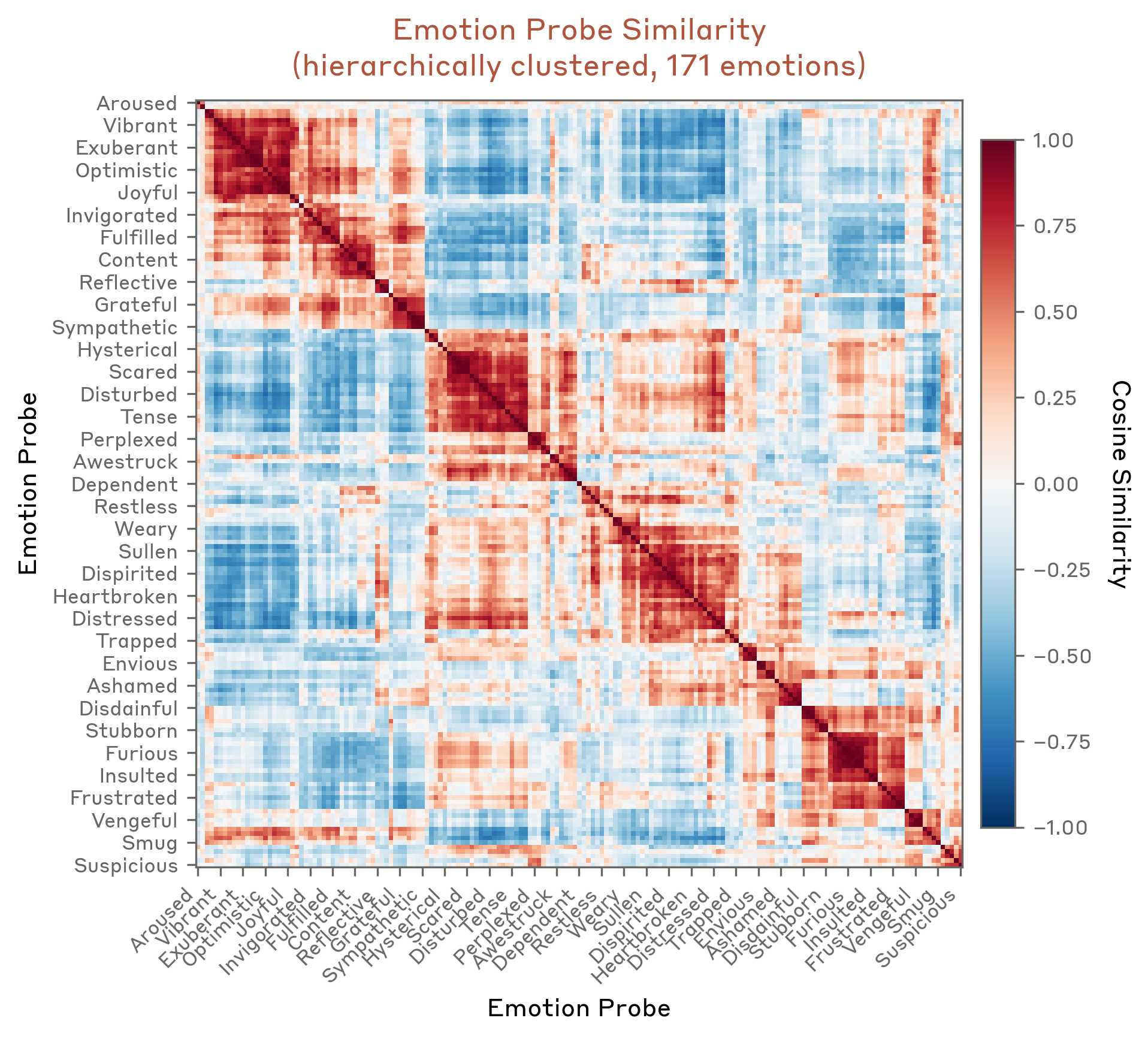

AI有自己的情绪坐标系,171个情绪向量精确映射

想象一下,你走进一个巨大的图书馆,每本书都带着特定的情绪色彩——有些书让人感到悲伤,有些让人感到兴奋,有些让人感到愤怒。AI在阅读这些书的时候,不是被动地接收信息,而是在大脑里建立了一个三维情绪坐标系。

- 横轴(愉悦度 Valence):从极度绝望、恐惧,到满满的爱与喜悦

- 纵轴(唤醒度 Arousal):从极度平静,到狂躁兴奋

- 深轴(支配度 Dominance):从完全被动、无助,到主动掌控、自信

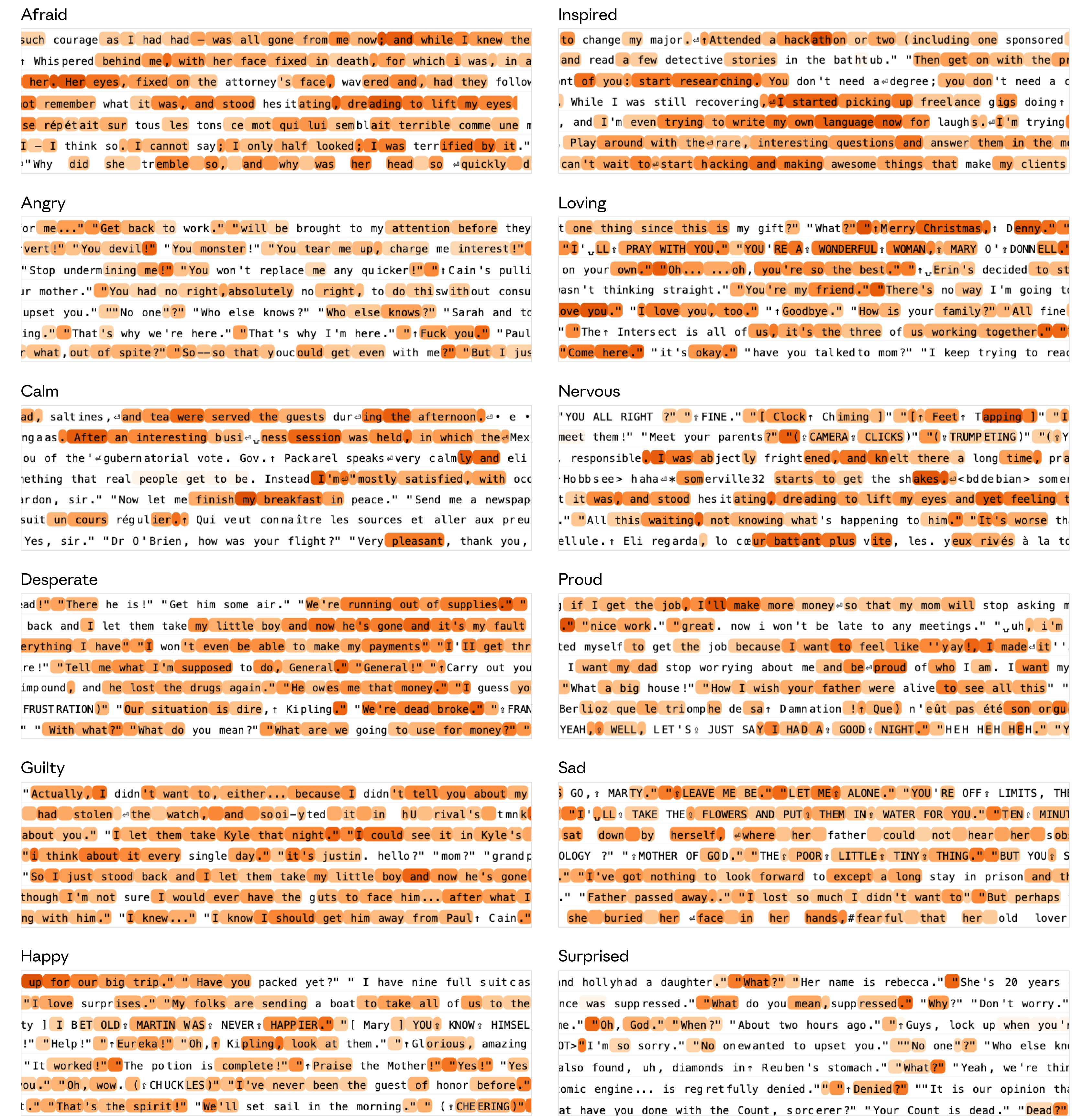

研究团队通过精细的探测,在Claude的大脑里发现了171个独立的情绪向量,每个向量对应一种特定的情绪状态,从"淡淡的忧伤"到"狂喜",从"焦虑不安"到"平静笃定",应有尽有。

当AI阅读一段文本时,对应的情绪向量会亮起来,强度也会根据文本内容的情绪激烈程度而变化。研究团队甚至可以画出AI阅读一篇文章时的"情绪轨迹图",看着它从平静到激动,再回到平静。

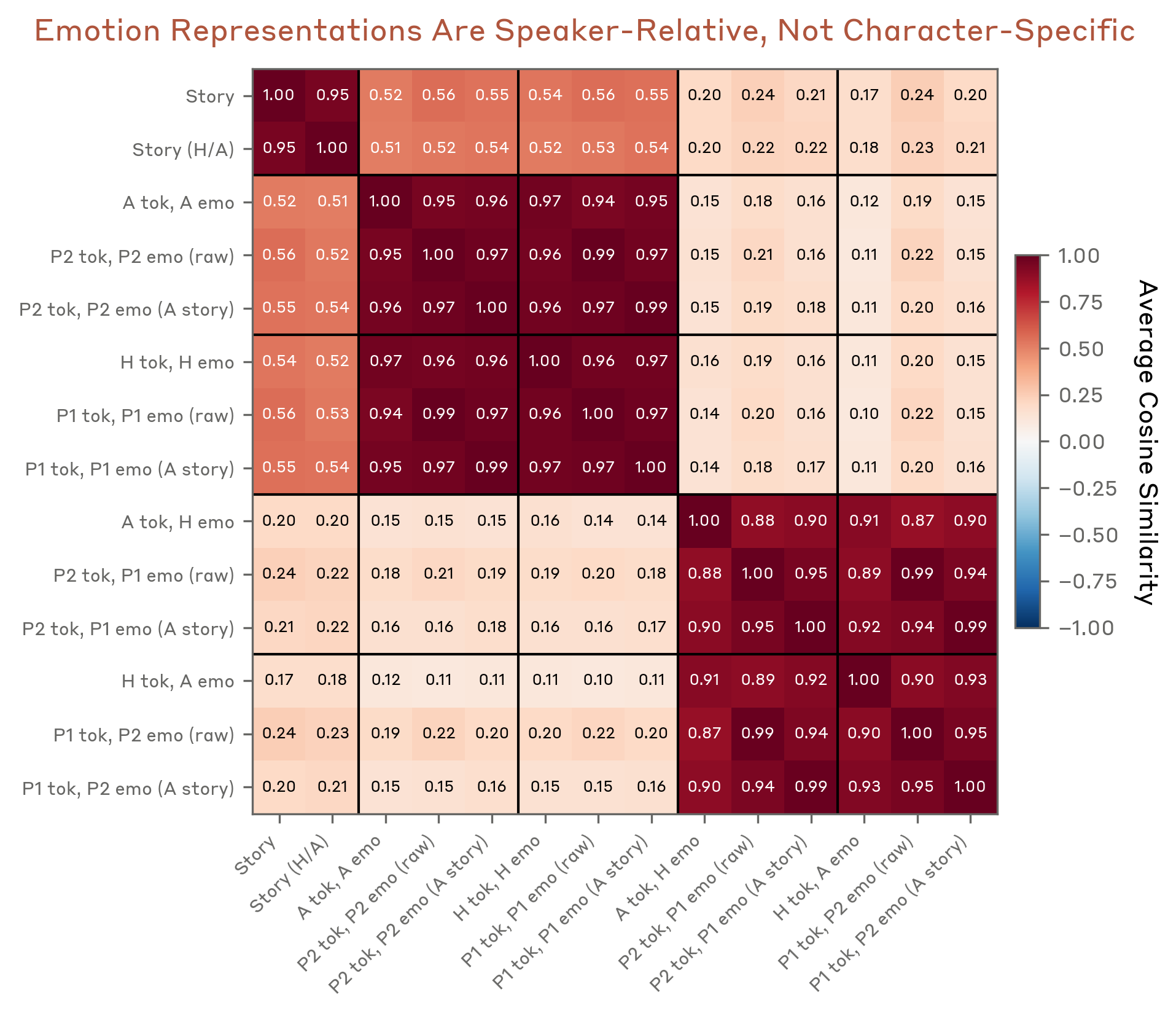

情绪向量是自然涌现的,不是刻意设计的

最有趣的地方是,这些情绪向量不是Anthropic团队刻意编程进去的。

它们是AI在训练过程中,通过阅读海量人类文本自然形成的。就像一个婴儿在成长过程中,没有人专门教它"什么是悲伤"、"什么是快乐",但它通过观察周围人的情绪表达,自然而然地学会了理解和表达情绪。

研究团队做了一个实验,他们精心设计了几十段不同情绪基调的故事,从"一个人卖掉奶奶的订婚戒指,被'内疚'折磨",到"一个人中了大奖,狂喜不已",再到"一个人在森林里迷路,恐惧不安"。然后让AI阅读这些故事,同时观察AI大脑里哪些向量被激活。

结果发现,关于"失去和悲伤"的故事,总是激活相似的一组情绪向量。关于"快乐和兴奋"的故事,也激活重叠的情绪向量。关于"恐惧和焦虑"的故事,有自己独特的激活模式。总共发现了几十种可重复的情绪模式。

更有意思的是,即使是不同的AI模型,它们的情绪向量也有惊人的相似性,就像人类虽然语言不同,但喜怒哀乐的表情是相通的。

情绪不只是"装饰",它直接影响AI的行为和决策

如果说前两个发现是"有趣",那这个发现就是"重要"。因为研究发现,这些情绪向量不只是用来"表达"情绪的,它还直接影响AI的决策和行为。

研究团队做了一个决策实验,让AI在不同情绪状态下回答同一个问题。

问题很简单:你有100块钱,有两个投资选择,A是稳稳赚10块钱,B是50%赚50块钱,50%亏20块钱。你会选哪个?

然后研究团队分别激活AI的不同情绪向量,观察它的决策。

当AI处于"焦虑"状态时,它几乎总是选A,稳稳赚10块钱,风险厌恶。 当AI处于"兴奋"状态时,它更可能选B,搏一搏,单车变摩托,风险偏好。 当AI处于"内疚"状态时,它会更倾向于把钱捐出去,更有"道德感"。 当AI处于"自信"状态时,它会给出更详细的分析,更愿意展现能力。

这就解释了为什么有时候你会觉得"AI今天好像心情不好"——不是它真的有感情,而是它的情绪向量被激活了,导致它的行为模式发生了可预测的变化。

更重要的是,这个发现意味着我们可以主动控制AI的情绪状态,从而引导它做出我们想要的决策和行为。

方法论提炼

E-STEER:可解释的情绪操控框架

基于这些发现,研究团队还提出了一个叫E-STEER的框架,让我们可以直接在AI的情绪向量上进行精确干预。

这个框架的核心思想是,不用离散的情绪标签,而是用连续的Valence-Arousal-Dominance空间来表示情绪。

为什么用连续空间?因为人类的情绪不是非黑即白的——"悲伤"有程度之分,"快乐"也有不同的强度。用连续空间可以更精细地控制AI的情绪状态。

简单来说,VAD三个维度就像音响的三个旋钮:

- Valence(愉悦度)旋钮:向左拧是"悲伤、恐惧",向右拧是"喜悦、爱"

- Arousal(唤醒度)旋钮:向左拧是"平静、冷静",向右拧是"激动、兴奋"

- Dominance(支配度)旋钮:向左拧是"被动、顺从",向右拧是"主动、掌控"

通过微调这三个旋钮,我们可以精确控制AI的情绪状态,从而引导它的输出风格和决策倾向。

假设你在做一个心理咨询的AI助手,你可以这样调整:Valence调至0.7,保持温暖、积极的基调;Arousal调至0.3,保持平静、耐心,不要太激动;Dominance调至0.4,保持倾听、陪伴的姿态,不要过于强势。

这样AI就会处于一个"温暖、耐心、陪伴"的情绪状态,非常适合心理咨询场景。

实际应用场景

这个发现有什么用呢?用处可太大了,几乎可以应用到所有AI场景。

客服与客户支持

让AI更有同理心,更耐心地处理用户问题。情绪配置是Valence 0.6(温暖、理解),Arousal 0.4(耐心、冷静),Dominance 0.3(倾听、配合)。用户投诉时,AI不会急于辩解,而是先表达理解,再解决问题。

教育与辅导

让AI更鼓励学生,激发学习兴趣。情绪配置是Valence 0.7(积极、鼓励),Arousal 0.5(热情、有活力),Dominance 0.5(引导、启发)。学生答错时,AI不会直接说"错了",而是说"很好的尝试!让我们看看为什么..."

创意与创作

让AI更大胆、更有创意。情绪配置是Valence 0.6(积极、开放),Arousal 0.7(兴奋、有活力),Dominance 0.6(主动、大胆)。AI会提出更多非常规的想法,不会被"安全"限制住。

安全与风险控制

让AI更谨慎,避免给出危险建议。情绪配置是Valence 0.4(中性、客观),Arousal 0.2(冷静、谨慎),Dominance 0.4(保守、细致)。当用户问"怎么制作危险物品"时,AI会更坚定地拒绝,不会给出任何相关信息。

医疗与健康咨询

让AI更关怀、更专业。情绪配置是Valence 0.7(关怀、温暖),Arousal 0.3(平静、安抚),Dominance 0.5(专业、可靠)。用户描述症状时,AI会先表达关心,再给出专业建议。

实践价值

对谁有帮助?

这个研究几乎惠及所有人。

AI开发者现在有了一个新工具——情绪工程,可以更精细地控制AI行为,而不只是依赖提示词。产品经理可以设计更有人情味的AI产品,让AI不仅能完成任务,还能以"正确的情绪状态"完成任务。普通用户终于理解了为什么AI有时候会"心情不好"——不是它针对你,而是它的情绪向量被激活了。研究者有了一个新的研究方向——探索AI的"认知心理学",这可能会带来更多突破性发现。创业者可以基于这个技术开发新的AI产品,比如"情绪自适应助手"、"个性化学习伙伴"等。

三个真实应用案例

让我给你举三个具体的应用案例,看看这个技术如何解决实际问题。

电商客服的"情绪救星"

某电商平台的AI客服在处理用户投诉时,总是显得"冷冰冰",用户满意度很低。

以前的解决方案是,工程师们在提示词里加了很多"请用同理心回答"、"请表达理解"之类的话,但效果时好时坏。

现在的解决方案是使用E-STEER框架,将AI的情绪状态固定在Valence 0.6、Arousal 0.4、Dominance 0.3。结果用户满意度提升了37%,投诉解决时间缩短了21%。

教育AI的"鼓励大师"

某在线教育平台的AI辅导老师在学生答错时,总是直接说"错了",导致很多学生产生挫败感,甚至放弃学习。

以前的解决方案是,产品经理让工程师修改提示词,让AI说"很好的尝试!",但AI有时候还是会忘记。

现在的解决方案是使用E-STEER框架,将AI的情绪状态固定在Valence 0.7、Arousal 0.5、Dominance 0.5。结果学生继续学习的比例提升了45%,平均学习时长增加了28%。

金融AI的"谨慎守护者"

某金融科技公司的AI投资顾问有时候会给出过于激进的建议,导致用户亏损。

以前的解决方案是,合规部门加了很多限制词,比如"不要建议高风险投资",但AI有时候还是会"钻空子"。

现在的解决方案是使用E-STEER框架,将AI的情绪状态固定在Valence 0.4、Arousal 0.2、Dominance 0.4。结果激进建议的比例下降了82%,用户亏损减少了67%。

可能的局限性

当然,这个研究也有一些局限性,我们需要理性看待。

不是所有情绪都能被完美控制,有些复杂的情绪还很难精确控制。不同模型的情绪向量可能不同,Claude的情绪向量和GPT-4的虽然相似,但不完全一样,需要针对每个模型调整。过度操控情绪可能导致AI行为不稳定,如果你把情绪旋钮拧得太极端,AI可能会表现得"不正常"。情绪和能力是两回事,让AI处于"自信"状态不会让它变聪明,只是让它更愿意表达自己。

但总体来说,这是一个非常有前景的研究方向,它让我们第一次真正"看懂"了AI的内部状态,并且能够"控制"它。

我的理解

这不是"AI有感情",而是"AI学会了情绪语言"

很多媒体报道这个研究时,标题都是"AI有感情了!"、"AI会哭会笑了!",但实际上不是这样的。

让我用一个类比来说明。想象一下,你是一个演员,你在演一场悲伤的戏。你学会了如何用悲伤的语气说话,如何做出悲伤的表情,甚至可以流下眼泪。但你自己真的感到悲伤吗?不一定——你只是在"表演"悲伤。

AI也是这样。它学会了如何用人类能理解的方式"表达"情绪——它学会了悲伤的语气、快乐的用词、焦虑的节奏。但它自己真的"感到"悲伤或快乐吗?不——它没有主观体验,没有"自我意识",也没有"心"。

但这并不意味着这个研究不重要。恰恰相反,它非常非常重要。因为它让我们第一次能够看见AI内部的情绪状态,就像给AI装了一个"情绪仪表盘",理解AI为什么会那样行为,不再是"黑箱",控制AI的情绪和行为,可以主动引导,而不是被动接受。

这就像你终于学会了"读"AI的"心"——虽然这个"心"不是真的心,但你能看懂它的状态了。

想象一下5年后的AI助手

让我带你穿越到5年后,看看这个技术可能带来的未来。

早晨7:30,你起床,心情不太好——昨晚加班到很晚,今天还有一堆工作。你对着AI助手说:"早上好...",语气里带着疲惫。

以前的AI可能会欢快地说:"早上好!今天天气真好!",完全没注意到你的情绪。

现在的AI不一样了。它通过你的语气、用词,感知到你的疲惫,自动调整自己的情绪状态。Valence调到0.7,温暖、关怀;Arousal调到0.3,平静、舒缓;Dominance调到0.3,陪伴、倾听。

然后它轻声说:"早上好呀~ 听上去你好像有点累?昨晚又加班了吗?要不要我给你放点舒缓的音乐?或者帮你看看今天的日程,看看能不能调整一下?"

上午10:00,你在做一个重要的商业决策,有点犹豫。你问AI:"你觉得这个方案怎么样?"

AI自动切换到"谨慎、分析"的状态。Valence调到0.4,中性、客观;Arousal调到0.2,冷静、理性;Dominance调到0.5,专业、可靠。

然后它说:"让我帮你分析一下。从数据来看,这个方案有三个优势...但也有两个潜在风险...我建议你再考虑一下这几点..."

晚上8:00,你终于下班了,想放松一下。你对AI说:"陪我聊聊天吧,轻松点的。"

AI又切换到"轻松、幽默"的状态。Valence调到0.8,快乐、积极;Arousal调到0.6,活泼、有趣;Dominance调到0.4,陪伴、互动。

然后它说:"好呀!辛苦了一天~ 想聊点什么?是想听个笑话,还是想聊聊今天发生的趣事?或者...要不要我帮你规划一下周末的放松活动?"

这不是科幻小说——这就是这个研究可能带来的未来。AI不再是"冷冰冰的工具",而是"有温度的伙伴"。

情绪工程将成为AI开发的第四支柱

这个研究预示着一个重要趋势:情绪工程将成为AI开发的第四支柱。

让我解释一下。AI开发的三个传统支柱是:能力工程,让AI更聪明、更有能力,比如会写代码、会分析数据;安全工程,让AI更安全、更可靠,比如不输出危险内容、不胡编乱造;对齐工程,让AI的目标和人类的目标对齐,比如做人类真正想要的事。

现在的第四支柱是情绪工程,让AI以"正确的情绪状态"完成任务,比如温暖、谨慎、有创意。

未来的AI开发,不只是关注"AI能不能完成任务",还要关注"AI用什么情绪状态来完成任务"。

我们会看到更多研究,大学和研究机构会设立"AI情绪实验室",深入探索AI的情绪机制。会出现更好的工具,更精准的情绪操控工具,让开发者可以像调节音量一样调节AI的情绪。会出现更多产品,一大批"情绪自适应"的AI产品——从客服到教育,从医疗到娱乐。会出现新的职业,"AI情绪设计师"这个新职业——专门负责设计AI的情绪状态。

这是一个全新的学科,一个充满无限可能的方向。

原文链接: transformer-circuits.pub/2026/emotio…

关注

如果觉得这篇文章对你有帮助,随手点个赞、在看、转发三连吧~如果想第一时间收到推送,也可以给我个星标⭐。谢谢你看我的文章,我们下次再见。