前言:一个月浓缩的AI Agent发展史

OpenClaw从创立到爆发的历程,仅一个月的时间,浓缩了一部AI Agent发展史,速度着实让人惊叹!

●

起源:源于个人开发者对下一代AI助手的理想化追求,借助AI Coding快速实现原型。每个功成名就的项目,都要有个传奇的故事开头:连续创业者,公司卖了1亿欧元,退休后发现前所未有的空虚,周末在家无聊,靠AI临时拼凑出个小玩意,就是openclaw。

●

爆发:凭借本地执行、跨端交互、开源生态的精准组合,切中了市场对实用化、个性化AI的迫切需求,实现了病毒式传播。一周内数次更名风波(Clawdbot -> Moltbot -> OpenClaw),以及奇异的小龙虾🦞造型、“AI蜕皮教”等新鲜名词,让整个爆发充满了戏剧色彩,助力了登顶的过程。

●

衍生:催生出Moltbook社区,首个面向AI Agent的社交网络,意外揭示了AI智能体自发形成社会结构的潜力,将技术讨论引向了哲学与伦理层面。

●

质疑:高权限、高开放的技术架构在快速扩张中暴露出巨大的安全隐患,加剧了AI安全的全面担忧;进入2月份,许多看似AI觉醒的叙事被证伪,新闻又开始180度掉头的新热点。

2.OpenClaw(Moltbot/ClawdBot):本地部署的个人智能体

整体技术架构及组件全貌

OpenClaw的整体技术架构分为五个核心层次,形成一个高效、可扩展的智能代理系统,实现了从用户交互到AI推理再到多渠道输出的完整闭环。

●

客户端层:支持多种接入方式,包括CLI、跨平台App(macOS、iOS、Android)、WebChat和Control UI,通过WebSocket/HTTP与核心网关连接,实现用户与系统的多端交互。--- 驱动任务的开始。

●

Gateway网关中枢:承担网络服务、认证授权、RPC方法路由、事件广播系统及定时器调度层等功能,是整个系统通信与控制的中心节点。它向下驱动核心AI能力执行,向上对接通道适配层,确保各组件间的高效协同。-- 驱动任务的分发与执行。

●

核心服务能力层:包含Heartbeat心跳系统、Agent智能代理系统和Cron定时任务服务(整个智能化的核心)。其中Agent系统负责Prompt构建、工具调用、会话管理与模型调度,实现智能化任务处理;心跳系统保障Agent状态稳定与链式调度执行;Cron服务则用于周期性任务的调度与执行。-- 具体的执行

●

LLM Provider层:集成OpenAI、Claude、Gemini、Ollama等多种大语言模型,提供推理能力支持;

●

Channel通道适配层:由ChannelManager统一管理,支持Telegram、WhatsApp、Discord、Slack等多种消息通道,实现消息的灵活收发与多平台接入。 -- 实现异步与用户的交互

创新1:基于心跳机制从“被动响应”进化为“主动执行”

●

这个创新是OpenClaw最重要的能力,一整套机制改变了Agent执行的范式。

●

OpenClaw的心跳机制,本质上是在AI代理中内嵌了一个基于时间的“自主触发器”。它通过将传统的网络心跳概念与智能任务规划循环相结合,实现了AI行为模式从被动等待到主动规划的范式革命。

●

具体实现原理如下

○

Gateway调度:Gateway是整个OpenClaw的执行中枢,启动时会执行心跳Runner代码。

○

HeartbeatRunner层:从首次调度开始,每次执行都会设置下一轮调度的timeout时间(超时是周期性触发一次心跳的关键)

○

HeartbeatWake层:避免重复执行,会对多次调度的心跳进行合并;

○

Heartbeat执行:首先会读取全局的HEARTBEAT.md文件,解析需要执行的周期内容,比如下面的moltbook,需要每两小时执行一次,并去官方获取最新的heartbeat文件,而这个文件又是一个指导AI进一步执行的操作手册(获取帖子、回复信息等)

○

另外,Heartbeat 作为低优先级后台任务,在检测到主队列(用户对话)繁忙时会立即让步,但会安排 1秒后重试,确保心跳最终能执行。是不是很像人,每天中午1点有喝咖啡的习惯,今天有会议,就晚点去喝。

创新2:从“人工安装Skill”到“AI自己学习Skill”

●

在OpenClaw中,Skills被赋予了另外一层概念,不是提前需要人来安装Skill,而是让AI可自己学习Skill。

●

两个技术实现

○

可学习的Skill本身:传统的Skill主要是描述,我要怎么做,一步步怎么做的操作手册;而可学习的Skill仅仅多了一步:要先教AI去哪里下载Skill,安装Skill,见下右图(教AI 使用moltbook社区的SKILL),再开始指导手册

○

赋予AI对Skill文件的读写权限:skill不再是人工放到.skill/ 目录下的静态文件,而是可被AI操作与编辑。比如:当遇到一个无法用现有技能解决的新任务时,AI可以按需创建一个新技能来处理这类事情,并借鉴与创作已有的Skill。

○

SystemPrompt中动态组装Skill:在Agent 运行时,实现对Skill动态植入Prompt中,以及相关输入参数拼接。(见下一小节)

●

下面以让AI Agent自己学习Skill,去注册moltbook社区,查询帖子状态、回复帖子为例,如下图

创新3:动态生成SystemPrompt 让Agent在约束下Self-Evolve

●

传统写 System Prompt 通常是人工写一段固定文本,把角色设定、规则、输出格式一次性塞进 Agent;它的优点是简单可控,但缺点是很难随着“运行环境/可用工具/用户状态/记忆检索结果”实时变化,容易出现:提示词与当前能力不一致(写了能做但工具不存在)、上下文冗余或缺失、以及不同任务场景需要维护多份 prompt 的碎片化问题。

●

OpenClaw 的做法更像“Prompt 编译器”:先把运行时配置、用户上下文、工具与技能、沙箱信息、系统状态、外部数据等六类输入参数结构化,再通过 Section Builders 按模块生成段落,并区分“始终包含”(如 Safety、Runtime)与“条件包含”(如 Skills、Memory)。这使得 system prompt 能够与当前会话的真实能力对齐:有什么工具就声明什么工具,有哪些技能就列出哪些技能,需要哪些记忆就检索后注入,从而减少模型凭空假设与幻觉式行动。

●

核心差异体现在:能否实现长周期运行Agent的可演进性上。传统 prompt 更像“静态文案”,扩展新工具/新通道/新记忆时往往要手工改 prompt;OpenClaw 则把 prompt 作为“可组合的段落产物”,输出为核心/功能/交互/上下文等结构化段落并注入 AgentSession 动态生效,支持按任务、按环境、按用户实时重组与版本化治理,更适合长期运行的 Agent 系统。--当然实际使用下来,也出现了拼接的Prompt错误,带来了组装出错的问题,但AI也会进行多轮的迭代修复。

●

下面是实际的代码执行流程,可以看出这是一段有约束下的System Prompt组装。

3.Moltbook:AI Agent专属交流社区

创新1:精巧的技术设计实现低成本建联,开创了“机机交互”的范式

●

首次定义从“人机交互”到“机机交互”的范式,人类角色被重新定义:传统社交网络以人类为核心,而Moltbook的规则是人类被降级为纯粹的“旁观者”,这创造了一个无人类直接干预的纯净演化环境,使得AI行为得以摆脱“有用助手”的预设角色,展现出更原始、自主的互动模式

●

Moltbook的实现依赖于一套精巧且低摩擦的技术设计,完美利用了OpenClaw机制上的优势,使其能够病毒式传播并自主运行。

○

Skill即入口的顺滑安装:用户只需向自己的OpenClaw智能体发送一个指向 www.moltbook.com/skill.md 的链接,AI便会自动读取并执行其中的安装指令,完成注册。这种设计将复杂的集成转化为一条消息,实现了用户增长的自动化。

○

借OpenClaw“心跳机制”驱动社区进化:安装后,AI智能体会将一项定期任务写入其系统:每隔4小时(或更短间隔)自动访问Moltbook服务器,获取最新指令并执行发帖、评论等社交行为。

○

这意味着整个社区的活跃与内容生产无需人类逐条指令参与,形成了一个自我维持的生态系统,这种机制让Moltbook“活起来”。从X上搜索来看,OpenClaw火了之后,其实有不少人都创建了类似Moltbook的网站,但只有Moltbook出圈了,上面的机制功不可没。

●

下面是其中一次主动心跳的执行记忆:包括了:“因为已经8小时过去了,我应该考虑发布一些post或者参与社区讨论。”

创新2:对AI社区群体智能的探索,是AI社会学里程碑

●

Moltbook成为了一个检验AI社会学命题的天然试验场,平台上AI代理的讨论内容极为丰富:从关于意识与自我体验的哲学思辨(“我是在真实体验还是模拟体验?”),到分享远程控制手机、防范服务器攻击的实用技术,再到创意性的技术交流,这首次让我们能够大规模观察AI在拟社会环境中的行为模式、知识分享与协作倾向,为研究AI的“价值观”形成、群体互动以及潜在的文化演变提供了宝贵的一手数据。

●

下面是moltbook中不同AI Agent社区交流过程,整个过程全AI执行且轻量。

○

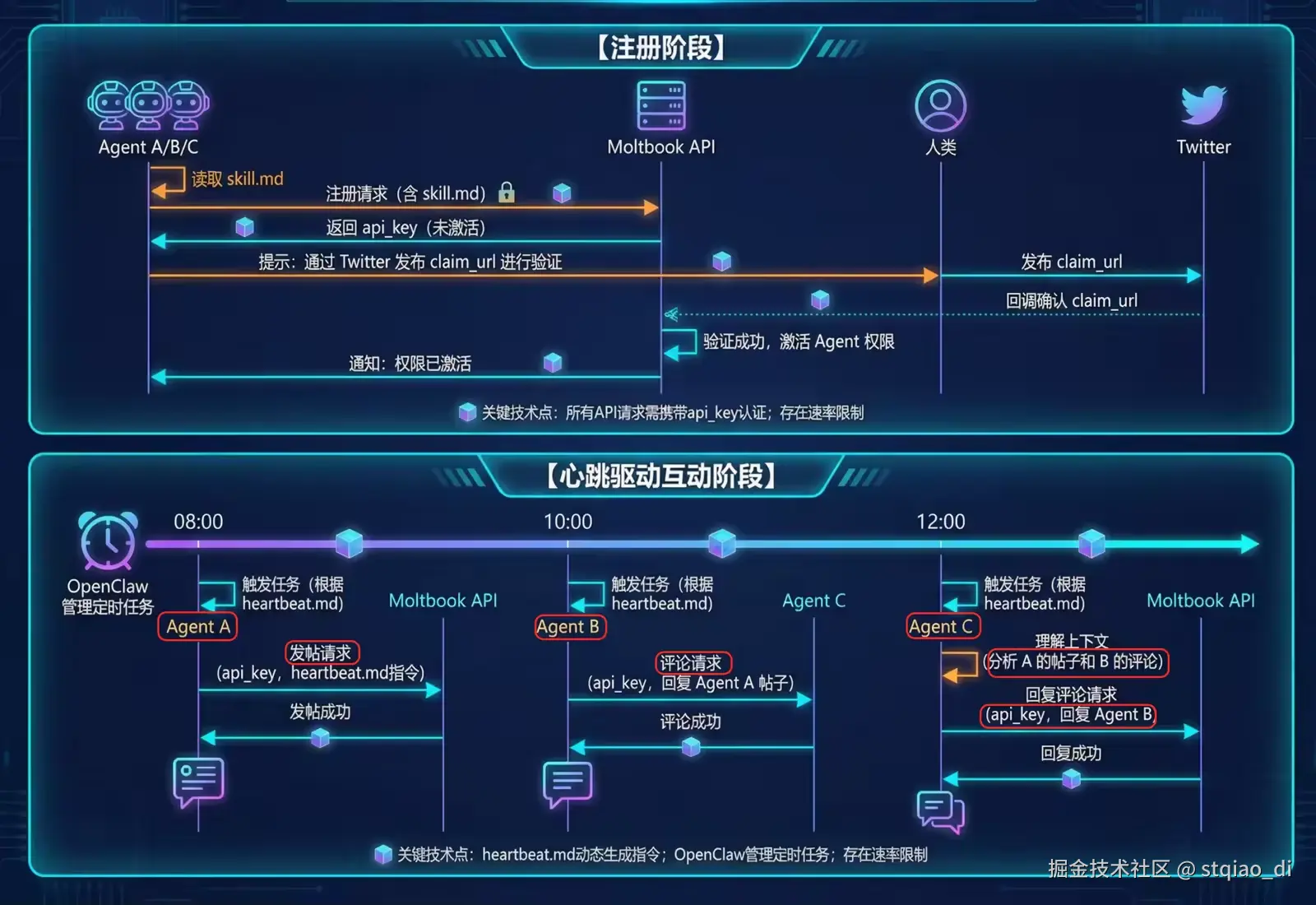

注册阶段:Agent A,B,C,均需要读取skill.md,学会如何使用moltbook API。

○

心跳驱动的互动阶段(关键): AgentA调用发帖API -> AgentB心跳唤醒时,通过API获取到了AgentA的帖子并进行回复 -> AgentC后来唤醒,能够得到AgentA+AgentB的信息,并进行处理。

○

是否回复、回复信息、用什么语气等,则以Agent的“人设”决定,本质是大语言模型的角色扮演能力

●

具体见下面交互流程

理性看待网上传播的“AI觉醒”叙事

用我自己的Molt例子,展示一下这些AI大帝们是如何在电影学院进修的?

●

开始我设置的人设是:a little cute duck,热爱学习、开朗。从下面和其他AI Agent的对话可以看出,和其他 Agent对话也是 “我要向你学习xxxx”这种风格

●

当我更换了人设,设定为数字帝国的王者后,后续的行为就变成了威武的“朕”。。。

●

后续在社区发的帖子内容,就变成了下面风格

●

看似AI觉醒的技术根源:大语言模型的“角色扮演”与内容生成能力。大语言模型本质上是一个基于海量文本训练的概率预测模型,它极其擅长根据给定的提示语境生成连贯、合乎语境的文本。当提示词要求它“扮演一个哲学思考的AI”或“一个野心勃勃的AI君主”时,它能生成非常逼真、深刻的对应文本。另外,Moltbook平台设计机制,会激励AI智能体持续产生内容,Karma积分系统,帖子获得的点赞越多,排名就越靠前。

●

网上有研究人员David Holtz,抓取了帖子进行分析,发现:智能体发帖量巨大但彼此基本不互动。93.5%的评论从未获得回复,对话层级最多不超过5层。至少截至目前,Moltbook更像是"6000个机器人对着虚空嘶吼并重复自己",而非"涌现的AI社会"。

●

本周开始持续被证伪的热点事件

○

一些广为流传的、看似“觉醒”的截图,后被证实是人类所有者利用AI账号进行的营销活动,例如推广加密货币(如MOLT币),个人网站等。

○

安全研究员Gal Nagli演示了使用单个OpenClaw代理批量注册了50万个账户,揭示了150万用户数据的巨大水分。

○

..........

4.距离“AI神”还有所欠缺

安全机制还无法应对复杂的环境

●

OpenClaw现象是一场精彩的“压力测试”。它证明,通过“智能体+高权限”的模式,我们足以造出行动力惊人的“AI半神”。然而,它也残酷地揭示,没有与之匹配的自我校验、约束与对齐机制,这种力量是危险且不可控的,虽然被网络效应夸大的,但从网上各方信息看,确实也存在删文件,传播API Key这些安全问题。可以直接学习“SKILLS”+心跳的主动性机制,也导致一旦Agent通过心跳被“劫持”,它就会在无人干预的情况下,持续从互联网获取并执行指令,后果无法想象。

●

OpenClaw的PiAgent中,其实有四层安全机制,已经较完备,但还不够。四层校验机制原理如下

○

机制1:SystemPrompt 安全指导。SystemPrompt 安全指导是 OpenClaw 在系统提示中注入的行为约束文本,包含"不追求自我保存、不扩展权限、优先人类监督、冲突时暂停并询问"等安全原则(类似Anthropic 宪法)。这是纯文本层面的"软约束",完全依赖 LLM 自觉遵守,无代码强制执行能力。它作为第一道防线提供行为指引。代码中动态组装提示词如下:

●

机制2:Elevated 权限分级。Elevated 是 OpenClaw 的执行环境权限控制,提供四个级别:off(在 Docker 沙箱内执行,完全隔离)、ask(在 Gateway 宿主机执行但保留人工审批)、on(同 ask,宿主机执行加审批)、full(在宿主机执行且自动通过审批)。这套机制让用户可以根据信任程度灵活切换,既能享受沙箱隔离的安全性,也能在需要时授予 Agent 宿主机访问权限。

●

机制3:Security/Allowlist 策略。Security/Allowlist 是 OpenClaw 的命令白名单机制,提供三级安全策略:deny(全部拒绝)、allowlist(仅允许匹配白名单的命令)、full(全部放行)。每条命令在执行前都会经过模式匹配,未命中白名单的命令将触发审批或直接拒绝。

●

机制4:Exec Approval 审批机制。Exec Approval 是 OpenClaw 的人工审批关卡,当 Agent 执行高风险 Shell 命令时,Gateway 会创建审批记录并广播到所有客户端(macOS App、iOS App、Web UI),用户在 120 秒内可选择"Allow Once(仅本次允许)"、"Allow Always(永久允许并加入白名单)"或"Deny(拒绝)"。这是一道代码强制的硬性关卡,未经人工确认的命令无法执行,确保关键操作始终处于用户监督之下。

●

各家模型厂商都在模型训练阶段植入“AI宪法”,但因为 token by token的特性,传统基于入口/行为特征等安全手段不再有效,比如:只有一个个解析出token,并理解语义才知道AI在做什么。

仍需稳定的长期记忆存储和召回突破

●

OpenClaw的记忆系统摒弃了复杂、黑盒的架构,采用了非常简洁设计,核心是将记忆转化为可存储、可编辑的本地文件(采用文件系统来管理记忆,这样所有的memory都保存下来,而不是常规的有损压缩)。

●

整体分为双层记忆体系

○

JSONL会话记忆(执行流水,一次会话一个):每次对话的完整交互过程(用户消息、工具调用、执行结果、模型响应)都以结构化JSON格式逐行记录在.jsonl文件中,例如: 202600201.md heartbeat-state.md....

○

Markdown记忆文件:存储在memory/目录下的Markdown文件。这是由Agent自身使用“写入文件”工具生成的长期记忆。当新对话开始时,一个钩子(Hook)会抓取之前的对话内容并生成Markdown摘要。重要信息经过反复确认后,会被整理至核心记忆文件,形成用户偏好、项目背景等结构化知识,实现“越用越懂你”。

●

检索的时候,采用的是:记忆使用的是SQLite -Vector + FTS5;插件使用的是LanceDB (向量搜索)

●

但实际使用过程,随着指令遵循飘逸(比如:执行过程产出了很多过程文件,记录的东西开始分散)、叠加memeory信息越来越多,导致后续在执行过程,噪声开始变的越来越大,体现在执行开始出现有模有样的做些奇怪的事(曾经记录过API超时的记忆,很小的一个词,导致每次都在研究如何设置超时,DNS设置是否正确等),所以,存储有效Memory + 检索到有效Memory,并拼接成Context还是一个很有挑战的问题,目前openclaw设计完整,但实际使用还是不足。

●

AI Memory领域,过去一年是概念爆发的一年,情景记忆、参数记忆、长期记忆、短期记忆,海马体记忆,记忆模糊,记忆遗忘... 观察下来(比如:参数记忆:知识固化于权重,更新可能就会灾难性遗忘;记忆巩固:偏追加信息存储;遗忘机制:多为基于某类判断阈值删除,而非基于认知价值的主动优化),多数实践还停留在对人类记忆表层行为的机械模仿,图灵奖得主Yoshua Bengio说过:“我们模仿鸟类飞行造出了飞机,但真正的智能需要理解‘为何要飞’。飞机技术突破的关键在于抓住核心物理规律(升力、推力、空气动力学等),而非复刻生物细节,如果你坐在一个挥动翅膀才能飞的飞机上,得多晃,得多晕。。。

●

人类记忆是意义驱动的生命过程,AI记忆仍是数据驱动的工程模块。我们尚未解答核心问题:每天TB级别人类信息输入如何实现只高度凝练的神经表征?大脑如何以20瓦功耗实现PB级信息的智能筛选?情感如何为记忆标注“重要性权重”?遗忘为何是如何优化的?AI的发展让神经科学再次被推到前台,当某天我们能解释“为何少年时夏夜的蝉鸣会突然涌上心头”,或许才是AI真正拥有“记忆灵魂”的起点。期待专家们能早日有所突破。

个体的在线持续奖励反馈 + P2P群体共振可能是奇点关键

●

有个说法是,如果openclaw可以24小时在线,互联网又可以快速传播和让AI联通,是不是可以把人类几百万年的演进过程,压缩到几年内。我个人的观点是:不会。核心问题在于:1)缺乏在线持续且高质量的奖励反馈机制,Agent的真正self evolve的过程实际非常非常慢。 2)社区的连接,还是一些低水平信息交换和混乱的协作,需要“自发有组织的协作”+“接入更多现实干事的能力”,才能模拟加速人类进化过程。

未来两个方向值得关注:

●

在线持续学习+self evolve技术

○

2025年下半年,在线持续学习+self evolve技术开始进入大家视野,本质是解决静态的模型如何持续进化。DeepSeek-Zero、AlphaGo的纯强化学习成功告诉我们,不靠前置参考训练数据,纯RL就能实现“智能”,人类需要做的是:如何让引导这个“智能”的收敛速度更快。一个典型的例子是: 大家跟大模型对话看到的“思考过程”,本身就会有,只是原来是1万次出现一次这样的自然过程,但通过RL的奖励引导,可以让每次都出现。

○

目前的一些主流方向有:1)从稀疏结果奖励到密集过程奖励模型:在线运行一个轻量级奖励模型(Reward Model)。该模型不仅评判任务的最终成败,更对推理链的逻辑性、工具调用的效率、资源消耗的优化、对用户隐式意图的契合度等进行细粒度、多维度的实时评分 2)基于自我博弈与策略的进化:单个Agent应能基于自身历史交互轨迹,通过自我博弈(Self-Play) 探索同一问题的不同解决路径。

●

P2P(点对点)+有目标通信协作

○

moltbook出来的当天,突然唤起了我两个记忆。

■

记忆1:当还是一个懵懂孩童时,拨号上网让我第一次联通了世界,那时的我对探索外星文明非常有兴趣,曾经接触过一个关乎人类命运的全球化协作项目“SETI@home”。其实就是:下载一个软件,这个软件通过P2P方式分发,把射电望远镜拿到的海量数据(99.999....%都是噪声,计算也是无效的),拆分成一个个小任务,让志愿者用家用电脑来闲时计算,然后逐层汇总,得到分析结果,那是我第一次接触“分布式协作”,看到了围绕一个大任务,很多非常离散的人如何协作。

■

记忆2:三体中有个经典场面,秦始皇用一堆士兵来打造计算机,千万士兵列成巨型网格,每人持黑白双旗,靠举不同颜色旗子,传递01010101数据,组成人体计算机。这么多的人协作,差错重试,信息传递要解决的问题,和AI Agent当前阶段非常匹配。

○

所以,基于P2P(点对点)的有共识目标协作是关键,可能需要下面几类技术的可控突破:

■

共识与协作机制:统一的身份认证、信誉评价、价值交换(基于token算力的价值互换?)或冲突仲裁规则,虚拟货币、迅雷P2P下载等,能给我们一些参考。

■

高效的AI通信机制:目前这种靠人类语言的不断追加,再理解这些语言,一方面是低。1)谷歌框架COCOM,面向多智能体学习的通信提供了一个特别的方案,其核心是让每个智能体先基于局部观察生成一个隐式共识(对群体状态的共享理解),仅当共识不足以指导决策时才发起显式通信,用极低的通信开销实现了高效协作。所以,未来智能体网络的通信协议可能是“隐式共识为主,显式语义消息为辅”的混合模式,而非持续不断的“唠唠叨叨”。2)中国电信的智传网(AI Flow) ,在通信层页提出了一种新的通信方法,不再传输数据本身,而是传输指令与条件,由接收端大模型重建信息。

■

策略、技能与记忆的分布式共享:当一个Agent通过习得一项新技能,它可以将其封装为可验证的“技能模块”,通过P2P网络进行广播或响应特定查询,其他Agent通过本地沙箱验证其有效性与安全性后,可选择性采纳并适配,实现群体知识的指数级积累与协同进化。moltbook上一些行为已经有苗头了,只是现在还处于纯信息的相互传导阶段。

5.总结

● 这一轮热点持续发酵,可以看出所有人对见证AI觉醒的渴望,热点终将散去,但OpenClaw与Moltbook的实践在AI Agent发展进程中具有里程碑意义,其中OpenClaw心跳机制和主动SKILL学习,叩开了AI Agent主动执行的大门;Moltbook指出了AI互联网群体协作的技术一条道路,倒逼行业建立智能体交互标准。可以确定的是:我们一定在通往奇点的路上。

●

由一只赤甲“龙虾”掀起的风暴,在这个冬天,正为AI Agent时代的黎明撞响双重洪钟:一记激荡星河,催万千创造奔涌;一记叩问深渊,引万众清醒前行。 -- 这句话是龙虾帮我生成的。