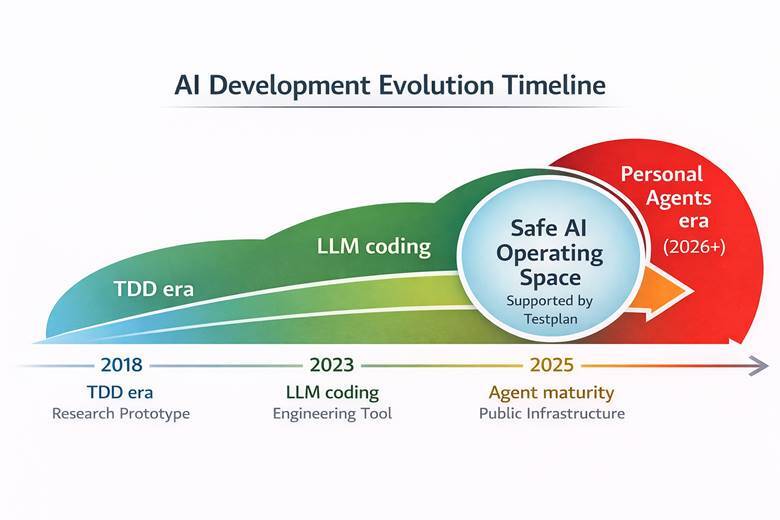

如果说 2024 年是 AI 生成代码(Copilot、Cursor)的元年,那么到了 2026 年,我们已经正式进入了“自然语言即接口、智能体(Agent)即员工”的深水区。

如果说 2024 年是 AI 生成代码(Copilot、Cursor)的元年,那么到了 2026 年,我们已经正式进入了“自然语言即接口、智能体(Agent)即员工”的深水区。

(图注:AI 开发演进时间轴:从早期的 TDD 时代,到 LLM 辅助编码,再到如今由 Testplan 支撑的“安全 AI 操作空间”与个人智能体时代。)

现在,哪怕是一个不懂编程的产品经理,只要动动嘴皮子,智能体就能在一个下午帮你拉起一个 SaaS 级的应用架构。这种生产力的爆发是极其震撼的。

然而,狂欢之下,暗流涌动。当开发流程被极度压缩,系统内部逻辑的可见性正在从“白盒”滑向“黑盒”。你不知道 AI 到底写了什么,你只知道它“看起来能跑”。速度被无限放大,但与此同时,代码失控的风险也达到了前所未有的高度。

在这个“高产但高危”的 AI 开发时代,我们迫切需要一套新的工程方法论。八年前我提出的 TPDD(测试计划驱动开发,Test Plan Driven Development),在今天,迎来了它真正的使命。

一、 危险的失衡:只有“油门”没有“刹车”的 AI 工程

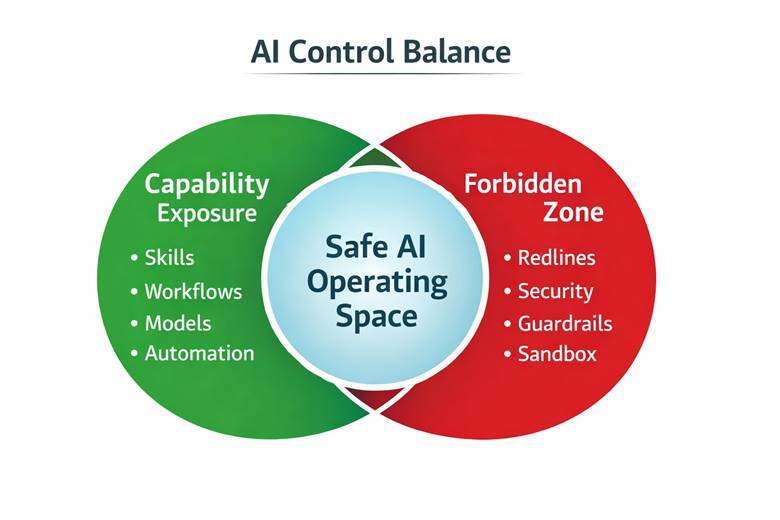

当前绝大多数拥抱 AI 的团队,都陷入了一种结构性的策略失衡:极度关注“能力暴露(Capability Exposure)”,却系统性无视“禁止空间(Forbidden Zone)”。

(图注:AI 控制平衡图。真正的安全 AI 操作空间,必须建立在“能力暴露(绿区:能做什么)”与“禁止空间(红区:绝对不能做什么)”的交集之上。当前多数团队严重偏向绿区而忽视红区。)

什么是能力暴露?就是我们常写的 skill.md。比如告诉 AI:“你能读取 CSV,你能生成 PDF,你能调取天气 API。”大家都在拼命探索“AI 还能干什么”,这种模式在扩张期极其高效,但也极易造成灾难。

因为大家忘了定义“禁止空间”,也就是红线。比如,你没有告诉 AI:“绝对不允许访问系统底层文件、绝对不允许将包含隐私数据的图表发送到外网。”

【笔者观点:没有底线的全能,就是最大的炸弹】 我们现在使用 AI Agent,就像在开一辆马力无穷但没有刹车和安全带的超级跑车。 最近爆火的 OpenClaw 就因为对主机拥有无限制访问权限而遭到安全专家的炮轰。很多开发者享受着“一键生成”的快感,却忽略了 AI 存在幻觉(Hallucination)和提示词注入(Prompt Injection)的风险。如果不划定“禁止空间”,AI 失控删掉你整个数据库,或者把企业机密泄露出去,只是时间问题。在这个时代,“定义 AI 不能做什么”比“教 AI 能做什么”要重要一万倍。

二、 TDD 死亡,TPDD 崛起:当 AI 自己写单元测试时,人类该干嘛?

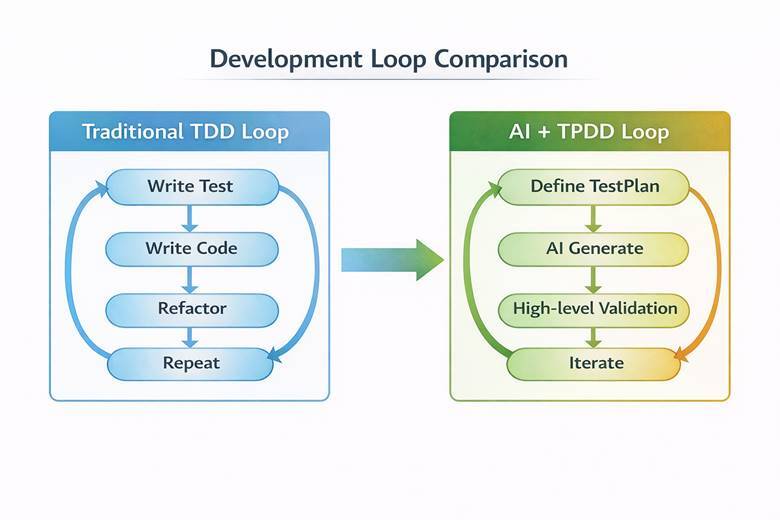

在传统的敏捷开发中,TDD(测试驱动开发) 是神圣的教条。程序员要先写一段单元测试,然后再写代码让测试通过。

但在 AI 时代,TDD 正在被“内化”。现在,大模型完全可以自己写代码,自己生成测试用例,如果跑不通,它还能自己重构。微观层面的单元级循环,人类已经插不上手了。

(图注:开发循环对比图。左侧传统的 TDD 循环(写测试->写代码->重构)已被 AI 替代;右侧是新的 AI+TPDD 循环,人类退守到高层的“定义测试计划(Define TestPlan)”与“高层验证(High-level Validation)”,中间的代码生成由 AI 完成。)

(图注:开发循环对比图。左侧传统的 TDD 循环(写测试->写代码->重构)已被 AI 替代;右侧是新的 AI+TPDD 循环,人类退守到高层的“定义测试计划(Define TestPlan)”与“高层验证(High-level Validation)”,中间的代码生成由 AI 完成。)

那人类工程师的价值在哪?答案是:退守到更高维度的“测试计划(TPDD)”控制层。

当 AI 把细节干完了,人类必须去回答三个宏观问题:

- 这个功能到底应该长什么样?

- 它的物理和逻辑边界在哪?

- 到底达到什么标准,才算真正的“验收通过”?

这就是 TPDD 的核心:高层先行 + 验证闭环。我们不再去跟 AI 卷每一行代码的逻辑,而是提前写好一份高维的“开发承诺书”。

【笔者观点:从“泥瓦匠”到“建筑监理”的身份跃迁】 过去我们是泥瓦匠(写代码),现在 AI 成了最高效的 3D 打印建筑机,而我们的身份必须立刻转变为“建筑监理”。 监理不需要自己去和泥,但他必须拿着图纸(TPDD 测试计划)站在旁边,明确指出哪里承重不合格、哪里不能用劣质材料。AI 最不缺的就是执行力,它最缺的就是“Failure Thinking(失败底线思维)”。人类通过 TPDD 为 AI 套上紧箍咒,这才是人机协作的终极形态。

三、 实战利器:用 TestPlan.md 打造 AI 的“安全护城河”

在实操中,我们如何把 TPDD 落地?很简单,给 AI 配备一个与 skill.md 同等地位的 TestPlan.md(或 redline.md)。

(图注:TestPlan.md 的两大核心作用:左侧为“内部限制(红线与禁止区域)”,右侧为“外部验证(基于 Must/Need/Should 优先级的测试计划)”。)

(图注:TestPlan.md 的两大核心作用:左侧为“内部限制(红线与禁止区域)”,右侧为“外部验证(基于 Must/Need/Should 优先级的测试计划)”。)

这个文件只做两件事:内部限制 + 外部验证。

以“AI 生成销售报表”为例,你的 TestPlan.md 应该长这样:

- 【Must Have(必须有)】:输入 CSV,必须生成内容正确的 PDF 报表。

- 【能力边界】:文件最大不能超过 10MB,每小时最多调用 50 次(防 Token 刷爆)。

- 【禁止空间(红线)】:绝对不允许访问报表以外的本地文件;绝对不允许将数据发送到外部服务;绝对不允许执行任意代码。

- 【异常预期】:如果缺少字段,必须返回明确报错,而不是瞎编数据。

当 AI Agent 在生成代码或执行任务时,它必须时刻被这个 TestPlan.md 监控和约束。

【笔者观点:将 QA(质量保证)思维变成全员的本能】 在 AI 时代,QA 不应该再是一个边缘化的测试岗位,而应该成为每一个开发者的“出厂设置”。 很多只追求短期速度的“高产型团队”,前期靠狂写 Prompt 出尽风头,但很快就会被无法维护的“技术债屎山”压垮。真正能活到最后的“克制型团队”,一开始就会花大量时间去写 Contract(契约)、写红线。在 AI 时代,防守比进攻更体现一家技术公司的底蕴。

四、 CTO 的行动指南:速度不再是唯一指标

对于技术管理者(CTO)而言,面对 AI 浪潮的冲击,必须立刻在管理层面做出转向:

- 拔高控制层级: 保留 TDD 的理念,但不要再让员工去卷单元测试。强制所有 AI 功能模块必须配套提交

TestPlan.md。 - 强推沙盒机制: 所有引入的第三方 Agent 和 Skill,绝对不能直接接触核心生产数据库,必须在强隔离的沙盒(Sandbox)中运行。

- 分级验收: 建立严格的 Must / Need / Should 分级验证机制,确保核心的 Happy Path(完美路径)和 Edge Cases(极端异常)都被覆盖。

- Token 预算护栏: 警惕 AI 陷入死循环导致财务失控,建立坚固的 Token 消耗阻断机制。

总结:拥抱限制,方能穿越周期

AI 极大地降低了创造的门槛,但也放大了失控的风险。

在未来的软件开发中,“能力暴露”与“禁止空间”必须如同车之双轮,并行不悖。 速度不再是第一目标。因为当任何人都能用 AI 在一小时内生成一个 App 时,只有那些 “可控、可维护、坚守安全底线” 的系统,才能真正穿越技术的周期,沉淀为长期的商业价值。

👇 欢迎关注我的公众号

在 AI 爆发的深水区,我们一起探索真正能穿越周期的技术价值。 微信搜索 【睿见新世界】 或扫描下方二维码,获取每周硬核技术推文:

欢迎关注【睿见新世界】!