为什么3分钟搞懂AI

- 现代人平均注意力仅 8 秒,3 分钟正好匹配大脑“黄金专注窗”,避免疲劳与遗忘。

- 微学习可将知识保留率提升 25%-80%,远超传统长课。

- 零基础读者能在碎片时间快速建立直觉,真正“懂”而非只是“看过”。

- 我们不仅知其然,还要知其所以然。

- 让你轻松坚持学完整个深度学习系列。

1. 问题引入

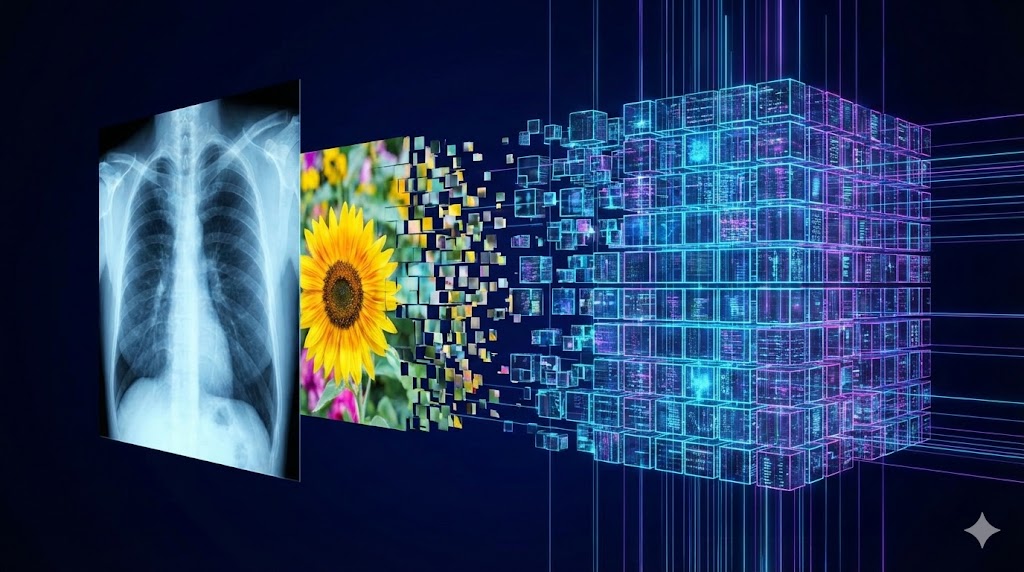

当我们在屏幕上查看一张普通的医疗胸透 X 光图或生活中的彩色照片时,它看起来仅仅是一个拥有“长度”和“宽度”的平面图像。 然而,当人工智能(AI)处理这些图像,或者阅读一篇长篇小说时,却总是将它们转换为极其复杂的“多维张量(Tensor)”,通常是一个庞大的 4 维数组。一张明明只有长宽的平面图,为什么到了 AI 眼里就必须变成多维的立体结构?难道二维的长和宽,还不足以让计算机理解这个世界吗?

2. 最直观解释(核心结论)

张量(Tensor)本质上是 AI 用来高效存储和处理海量数据的“超级收纳盒”。

在 AI 的世界里,单凭长和宽不足以完成复杂的学习任务。张量不仅记录图像的平面尺寸,还要记录色彩的丰富程度,更重要的是,它必须能够一次性打包大量的图片数据以提升硬件的处理速度。

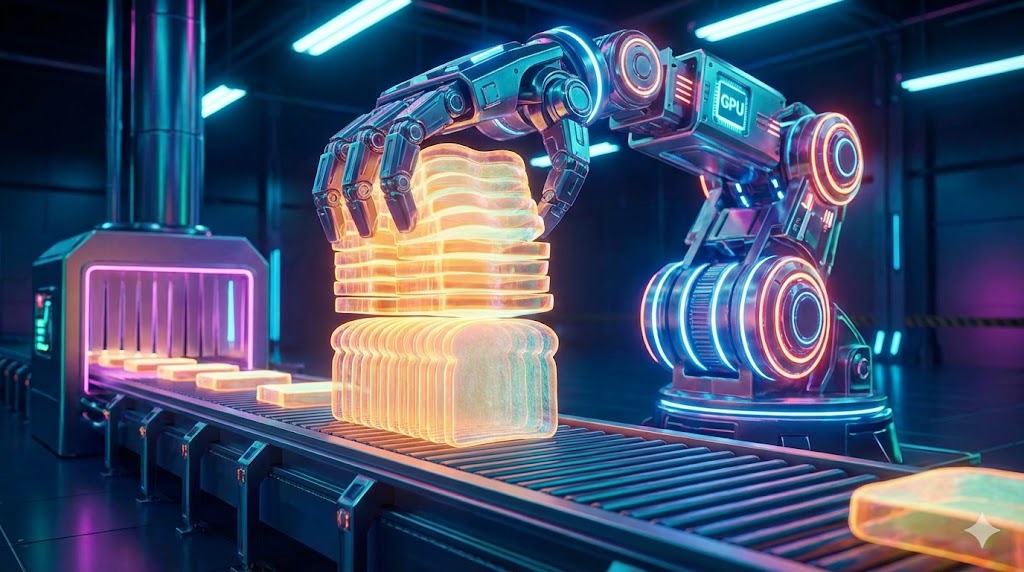

可以把张量想象成一整条刚出炉的“切片面包”。 它的长和宽代表单片面包的具体尺寸;而每片面包上涂抹的不同口味果酱(比如草莓酱、蓝莓酱),就是数据的“厚度”;一整条面包里包含的切片总数,就是 AI 一次性“吞下”的数据量。那些多出来的维度,正是为了装下这些决定运算效率和信息深度的额外信息。

3. 为什么它有用(价值解释)

这种多维度的设计是为了突破计算机处理速度的物理瓶颈,并保留现实世界的复杂细节。

如果 AI 每次只读取一张图像,就像超市收银员每次只能扫描一件商品,在面对成千万上亿的训练数据时,计算过程将极其缓慢。通过引入“批次(Batch)”这个维度,AI 的计算核心(GPU)可以利用其成千上万个计算核心,一次性“一口吃掉”几十甚至上百条数据,实现极速的并行计算。

同时,真实世界的信息是立体的。一张彩色照片并非简单的轮廓,它由红、绿、蓝三种颜色的光混合而成。引入“通道(Channel)”维度,正是为了保留这种数据的厚度。随着 AI 学习的深入,它还会自动提取出极其复杂的隐藏特征(如细微的边缘、复杂的纹理等),此时数据的“厚度”就会从最初的 3 层果酱暴增到 512 层果酱。没有这些额外的维度,AI 就无法“看懂”复杂的规律。

4. AI 是怎么用的(技术联系)

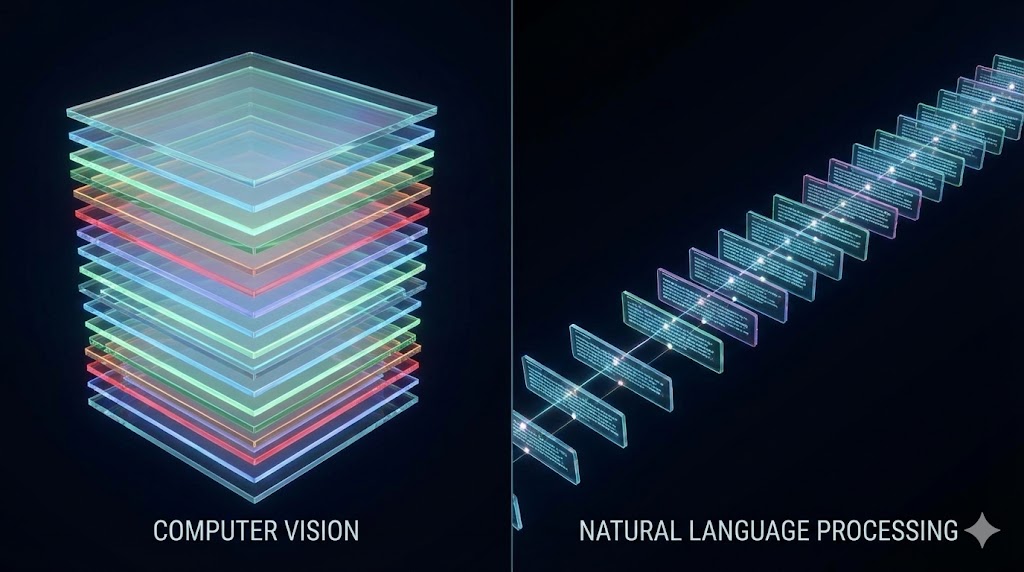

在实际的深度学习工程中,处理计算机视觉(CV)和自然语言处理(NLP)时,这个多维收纳盒的结构有着明确的语义区分。

对于图像处理(CV):最标准的结构是 [批次 Batch, 通道 Channel, 高度 Height, 宽度 Width]。这相当于一次性送进流水线的 32 片面包(Batch=32),每片面包涂了 3 层不同颜色的果酱(Channel=3,代表 RGB),且每层面包有着固定的长和宽尺寸。这对应着显卡同时处理 32 张彩色图片的任务。

对于文本语言处理(NLP):结构通常转变为 [批次 Batch, 序列 Sequence, 特征 Channel]。这里的“序列(Sequence)”反映了一句话里单词的先后排列顺序。例如一次性阅读 16 个长句子(Batch=16),每个句子包含 50 个单词(Sequence=50),而每个单词被 AI 翻译成 768 个不同维度的深层含义(Channel=768)。

AI 核心的工作,就是通过各种算法层不断重塑、切分和组合这种高维度的“面包”,最终提取出精准的预测结果。

5. 一句话总结 + 记忆钩子

一句话总结:张量是 AI 专用的多维数据容器,通过增加批次和通道维度,实现了大规模并行计算与高层次特征的提取。

直觉记忆钩子:张量 就像 一条涂满果酱的切片面包,Batch 是切片数量(决定处理多快),Channel 是果酱层数(决定信息多厚)。

6. 极简代码体验

Python

# 1. 生成一条包含 32 片、3层果酱、大小为 224x224 的“面包”数据

tensor = get_data(batch=32, channel=3, height=224, width=224)

# 2. 查看这个数据的具体维度尺寸 (输出将会是: 32, 3, 224, 224)

print(tensor.shape)

# 3. 改变维度顺序:将果酱层数挪到最后,变成 [批次, 高度, 宽度, 通道]

# 相当于换一种拿面包的姿势,以适配特定 AI 算法的输入要求

new_tensor = tensor.permute(0, 2, 3, 1)