今天接着逻辑回归。

5.简化的成本函数和梯度下降(整体讲解如何完整进行逻辑回归)

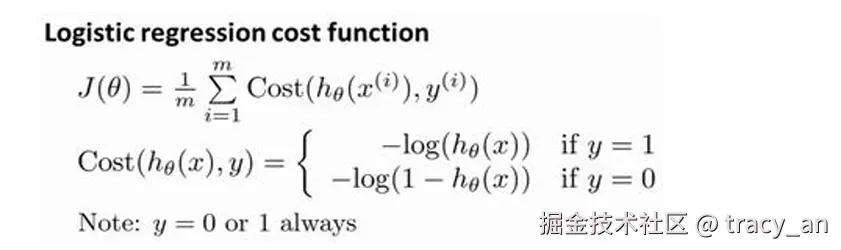

- 先确定逻辑回归的代价函数:

这个式子可以合并成:

Cost(hθ(x),y)=−y∗log(hθ(x))−(1−y)∗log(1−hθ(x))

即,逻辑回归的代价函数:

这个式子可以合并成:

Cost(hθ(x),y)=−y∗log(hθ(x))−(1−y)∗log(1−hθ(x))

即,逻辑回归的代价函数:

Cost(hθ(x),y)=−y∗log(hθ(x))−(1−y)∗log(1−hθ(x))=−m1i=1∑m[y(i)log(hθ(x(i)))+(1−y(i))log(1−hθ(x(i)))]

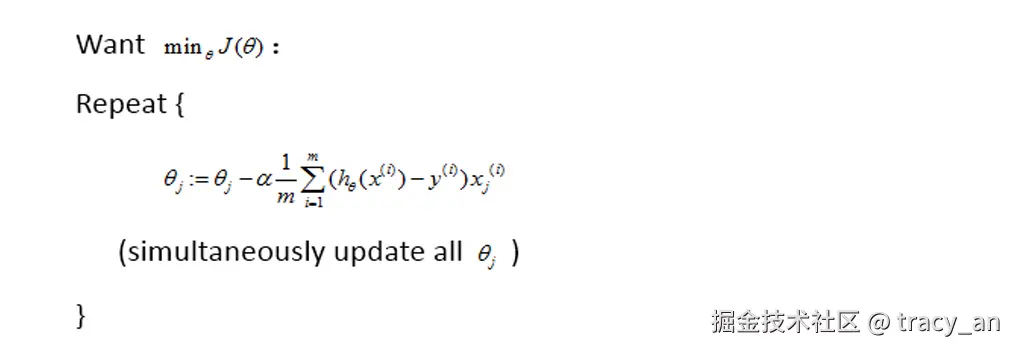

- 找出尽量让J(θ)取得最小值的参数θ

minJ(θ)

-

给出一个新的样本,假如某个特征x,可以用拟合训练样本的参数θ,来输出对假设的预测。

-

假设的输出,则是概率值:p(y=1∣x;θ),接下来就是思考如何最大限度地最小化代价函数J(θ),作为一个关于θ的函数,这样才能为训练集拟合出参数θ。

-

使用梯度下降法来最小化代价函数:

J(θ)=−m1∑i=1m[y(i)log(hθ(x(i)))+(1−y(i))log(1−hθ(x(i)))]

θj:=θj−a∂θj∂J(θ0,θ1)

求导后得到:

按照这个式子来同时更新所有θ的值,虽然更新参数的规则看起来和线性回归基本相同,但由于假设的定义不同,所以本质并不相同。

按照这个式子来同时更新所有θ的值,虽然更新参数的规则看起来和线性回归基本相同,但由于假设的定义不同,所以本质并不相同。

这个式子可以合并成:

即,逻辑回归的代价函数:

按照这个式子来同时更新所有的值,虽然更新参数的规则看起来和线性回归基本相同,但由于假设的定义不同,所以本质并不相同。