摘要(Abstract)

在 2026 年的 AI 技术周期中,Agent(智能体)已从概念验证阶段走向工程化与规模化应用。它不再是“能对话的模型封装”,而是一类具备目标感、执行力与自我调整能力的自主系统。 本文基于主流模型分级与工程实践视角,系统解析 Agent 的核心架构、其与传统自动化系统的本质差异,以及为什么 Agent 正在成为未来智能系统的“默认形态”。

01| 先说结论:什么才算“真正的 Agent”?

如果把 Chatbot 看作“知识丰富但只能应答的专家”,那么 Agent 更接近一个可以被托付任务的执行主体。

工程化定义可以归纳为:

Agent 是一种以大语言模型为认知核心,能够持续感知环境、围绕目标进行多步决策,并通过工具对外部世界产生真实影响的自主系统。

它完成的是一次关键跃迁: **从“响应输入” → “围绕目标持续行动”**。

02|Agent 的结构标准:不是插件,而是系统

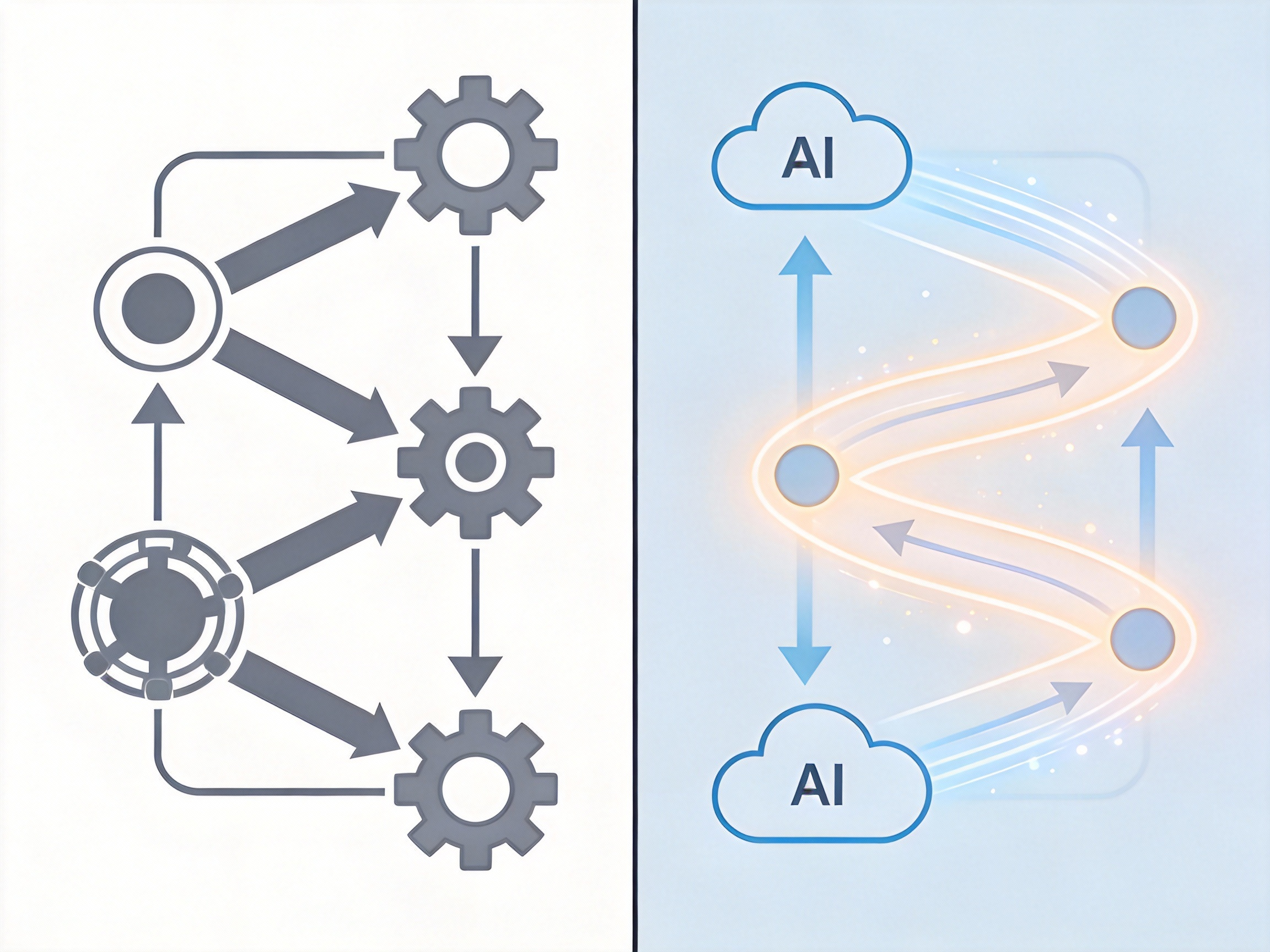

1. 智能体的经典闭环(The Agent Loop)

一个被业界普遍认可的 Agent,必须完整覆盖以下循环:

- 感知(Perception) 从文本、接口、日志、传感器等多源信号中获取环境状态

- 决策(Reasoning & Planning) 基于目标进行多步推理,生成可执行计划,而非单步回复

- 执行(Action) 调用工具、触发系统、产生结果,并接收反馈进入下一轮循环

这不是一次调用,而是一个持续运行的控制回路。

2. 2026 年通行的 Agent 架构表达式

在工程层面,Agent 可以被高度抽象为:

编辑

- LLM:负责理解、推理与语言接口

- Planning:将模糊目标拆解为阶段性行动

- Memory:保存上下文、历史经验与中间状态

- Tools:对真实系统施加影响的能力接口

缺失任一模块,都只能算“增强工具”,而非 Agent。

3. 本质区别:工具升级 vs 系统跃迁

传统 AI 的进化路径是:工具能力增强 Agent 带来的变化是:系统范式改变

它的核心价值不在于“答得更好”,而在于**真正完成问题闭环(Problem Solving)**。

03| 能力拆解:Agent 是如何“把事做完的”?

① 自主感知与环境建模

从读取输入 → 理解情境

- 传统系统:只处理预设格式的数据

- Agent:主动整合多模态、多来源信号,形成“环境假设”

示例: 运维 Agent 同时感知到流量异常、CPU 飙升、支付接口延迟,不是分别报警,而是判断是否构成一次系统性攻击或突发事故。

② 目标导向的决策与规划

从执行脚本 → 拆解目标

- 传统系统:If-Then 规则驱动

- Agent:面对模糊目标,自主生成可执行路径

示例: 目标是“降低用户流失率”,Agent 会自动演化出: 数据分析 → 风险分群 → 个性化干预 → 实验验证 → 策略调整

③ 持续反馈与自我修正

从一次性任务 → 持续进化

- 传统系统:出错即终止

- Agent:具备反思(Reflection)与自我修复能力

代码报错会读日志重试,信息不足会主动补充搜索,这才是真正意义上的闭环智能。

04| 关键对比:为什么 RPA 不等于 Agent?

| 维度 | 传统自动化(RPA / Workflow) | Agent |

|---|---|---|

| 驱动逻辑 | 规则驱动 | 目标驱动 |

| 行为方式 | 顺序执行 | 主动规划 |

| 环境假设 | 封闭、静态 | 开放、动态 |

| 任务边界 | 固定流程 | 跨域复杂问题 |

| 进化方式 | 人工改规则 | 基于反馈自我修正 |

形象理解:

- 传统自动化像“轨道列车”:稳定但无法应变

- Agent 更像“智能导航系统”:只给目的地,其余交给它处理

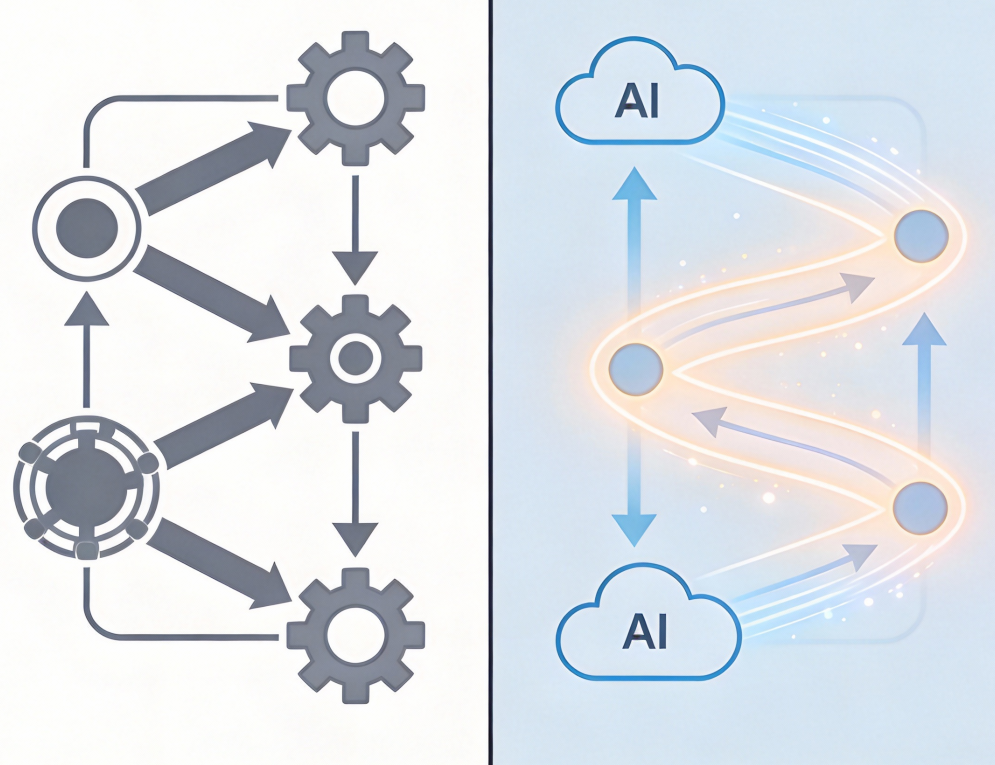

05|2026 展望:Agent 正在成为 AI 的“操作系统”

从工具到协作主体

编辑

过去:人适配工具 未来:Agent 主动协助、判断何时行动、何时停止

真正 Agent 的唯一检验标准

当环境发生变化时,它是否能够在无需人工改规则的情况下,持续逼近目标?

不能自我闭环的系统,终将被淘汰。

价值重心的转移

Agent 的价值不在“内容生成”,而在决策质量与执行效率。 这是 AI 从“辅助”走向“承担责任”的关键一步。

写给开发者与创作者

- 不要只描述“这个 Agent 能做什么功能”

- 要讲清楚: 它如何决策? 遇到不确定性怎么办? 失败后是否能自我修正?

判断标准很简单:

- API 失败会不会自动重试?

- 目标模糊会不会反问澄清?

- 结果不佳会不会调整策略?

如果答案是 Yes,你构建的才是真正的 Agent。

结语

2026 年已经到来, 问题不再是“要不要用 Agent”, 而是——你的系统是否已经具备 Agent 的思维方式?

欢迎分享你心目中的 Agent 形态。