线性回归

对于给定数据集D={(xi,yi)}i=1m,其中xi=(xi1,xi2,...,xid),yi∈R。线性回归的目的是找到一个函数

f(x)=wTx+b

使得线性模型的预测值f(x)与真实值y尽可能接近。通常选用均方误差来判断其接近程度,即

E(f;D)=m1i=1∑m(f(xi)−yi)2=m1i=1∑m(wTxi+b−yi)2

当均方误差最小时,即可求得最优线性回归模型。此时

(w∗,b∗)=argw,bminE(w,b)=argw,bmini=1∑m(f(xi)−yi)2=argw,bmini=1∑m(wTxi+b−yi)2

w∗,b∗表示w,b的解。我们只需要求得均方误差E在最小值时的w,b值,因此均方误差的常数项m1可忽略。

一元线性回归

当数据集中xi的维度为1时,即xi=(xi),此时x为标量,则对于给定数据集D={(xi,yi)}i=1m,线性回归给出的模型为

f(x)=wx+b

此时w也是标量。易证E(w,b)=∑i=1m(wxi+b−yi)2对w,b均为开口向上且恒大于0的二次函数,因此我们可以使用二次函数对称轴公式或求导来确定该函数的最小值。这里选择求导的方法。将E(w,b)分别对w,b求导:

∂w∂E(w,b)∂b∂E(w,b)=2i=1∑m(wxi+b−yi)xi=2[wi=1∑mxi2−i=1∑m(yi−b)xi]=2i=1∑m(wxi+b−yi)=2[mb−i=1∑m(yi−wxi)]

令上式等于0,得到

bw=m1i=1∑m(yi−wxi)=yˉ−wxˉ=∑i=1m(xi−xˉ)2∑i=1m(xi−xˉ)(yi−yˉ)=∑i=1mxi2−mxˉ2∑i=1m(xiyi)−mxˉyˉ

特别的,对于x=x0(x0是常数)这类直线,斜率w无法被表示,因此回归方程不存在。

特别的,对于x=x0(x0是常数)这类直线,斜率w无法被表示,因此回归方程不存在。

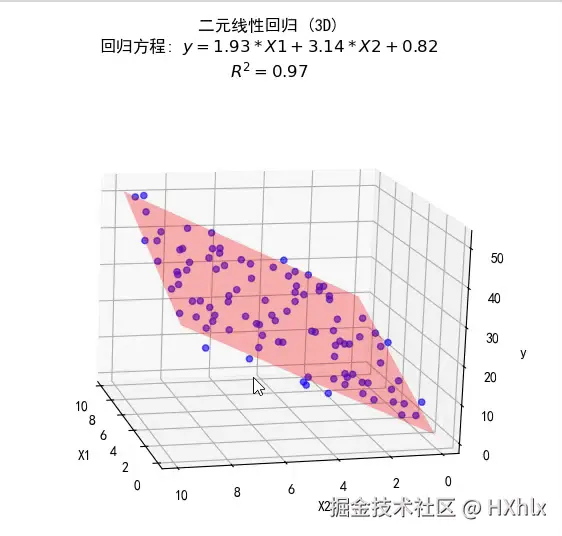

多元线性回归

最小二乘法

对概述中的式子,我们令

X=x11x21⋮xm1x12x22⋮xm2⋯⋯⋱⋯x1dx2d⋮xmd11⋮1=x1Tx2T⋮xmT11⋮1,y=y1y2⋮ym,w^=[wb]

则

f(x)w^∗=wTx+b=Xw^=argw^minE(w^)=argw^min(y−Xw^)T(y−Xw^)

将E对w^求导得

∂w^∂E(w^)=2XT(Xw^−y)

当XTX是满秩矩阵时,令上式等于0可得

w^=(XTX)−1XTy

将其代入一元线性回归,仍有效。

过拟合与正则化

在多元线性回归中,当特征维度d较大而样本量m相对不足时,最小二乘法容易出现过拟合(Overfitting)现象。过拟合是指模型在训练集上表现很好(均方误差很小),但在未知数据上泛化能力差。

造成过拟合的常见原因包括:

- 特征过多或特征之间高度相关:导致XTX接近奇异矩阵(不满秩),最小二乘解不稳定。

- 模型复杂度过高:参数过多使得模型倾向于拟合训练数据中的噪声。

为了缓解过拟合,常用手段是正则化(Regularization):在损失函数中增加一个关于模型参数的惩罚项,限制参数的大小,从而降低模型复杂度。一般化的正则化目标函数为:

w^∗=argw^min[(y−Xw^)2+λΩ(w^)]

其中λ≥0为正则化系数(超参数),Ω(w^)为惩罚项。λ越大,对参数的约束越强;λ=0时退化为普通最小二乘法。

根据惩罚项Ω(w^)的不同选取,可以得到不同的正则化方法。常见的有以下几种:

- L1正则化:Ω(w^)=∥w^∥1=∑j=1d∣w^j∣,对应LASSO回归。

- L2正则化:Ω(w^)=∥w^∥22=w^Tw^=∑j=1dw^j2,对应岭回归。

- 弹性网络(Elastic Net):同时结合L1和L2正则化:

Ω(w^)=α∥w^∥1+21−α∥w^∥22,α∈[0,1]

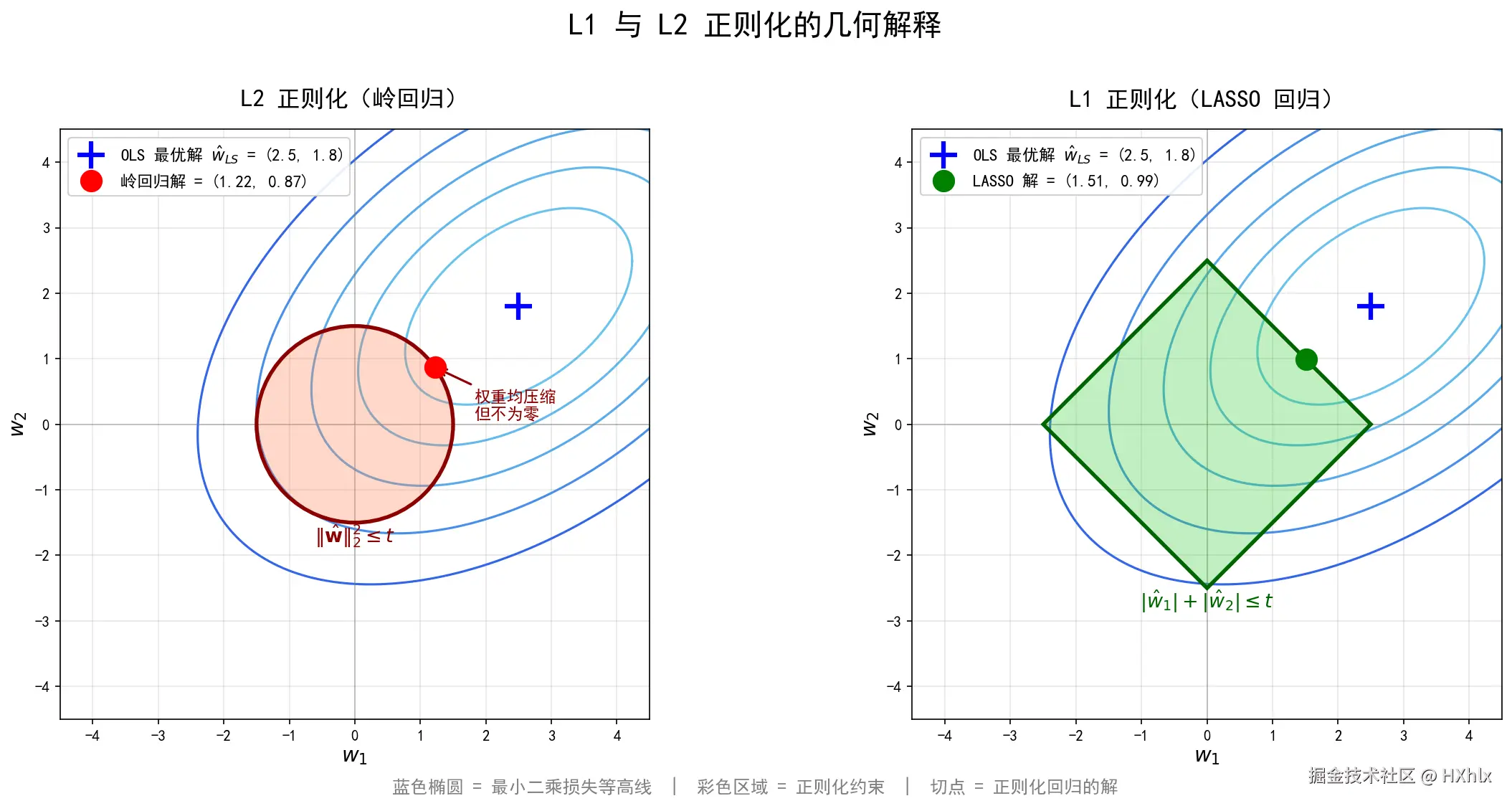

正则化的几何解释

正则化的效果可以通过约束形式(而非拉格朗日形式)直观理解。以二维权重(w1,w2)为例:

- 蓝色椭圆代表最小二乘损失的等高线,椭圆中心w^LS为无正则化时的最优解。

- 彩色区域代表正则化约束(限制w^的范围),正则化回归的解就是等高线与约束区域的切点。

λ越大,约束区域越小,正则化回归的解离OLS最优解越远:

λ越大,约束区域越小,正则化回归的解离OLS最优解越远:

如上图所示:

- L2正则化(圆形约束):切点通常不在坐标轴上,即w1=0且w2=0,权重被压缩但不会为零。

- L1正则化(菱形约束):由于菱形存在"尖角"(顶点在坐标轴上),等高线更容易在顶点处与菱形相切,使得某个权重恰好为零(图中w1=0),从而产生稀疏解。

LASSO回归

LASSO(Least Absolute Shrinkage and Selection Operator)回归在最小二乘损失的基础上增加L1正则化项,其目标函数为:

w^∗=argw^min21(y−Xw^)2+λ∥w^∥1

其中λ>0为正则化系数,∥w^∥1=∑j=0d∣w^j∣为权重向量的L1范数(包含偏置b=w^d+1或不包含均可,通常不对偏置做正则化)。

L1正则化的几何解释

L1正则化的等值线为菱形(如二维时为旋转45°的正方形)。当等值线与最小二乘损失的等高线(椭圆)相切时,切点更容易落在坐标轴上,这意味着某些特征的权重恰好为0。因此LASSO回归具有特征选择(Feature Selection)的能力——它能自动将不重要的特征权重压缩为零,从而得到稀疏模型。

L1正则化的特点

- 稀疏性:倾向于产生稀疏解,自动进行特征选择。

- 无可解析解:由于L1范数的绝对值函数在零点不可导,LASSO没有像最小二乘法那样的闭式解,通常需要使用坐标下降法(Coordinate Descent)或近端梯度下降法(Proximal Gradient Descent)等迭代算法求解。

- 适用场景:当特征维度很高、怀疑大部分特征与目标无关时,LASSO回归尤为适用。

坐标下降法求解

坐标下降法的基本思想是:每次固定除一个变量外的所有变量,对这一个变量进行一维优化,交替进行直至收敛。对于LASSO回归中的第j个权重w^j,更新公式为(省略偏置项的推导):

w^j←∑i=1mxij2S(∑i=1mxij(yi−∑k=jxikw^k),λ)

其中S(z,λ)为软阈值函数(Soft Thresholding):

S(z,λ)=sign(z)⋅max(∣z∣−λ,0)=⎩⎨⎧z−λ,0,z+λ,z>λ∣z∣≤λz<−λ

岭回归

岭回归(Ridge Regression)在最小二乘损失的基础上增加L2正则化项,其目标函数为:

w^∗=argw^min(y−Xw^)2+λ∥w^∥22

其中λ>0为正则化系数,∥w^∥22=w^Tw^=∑j=0dw^j2为权重向量的L2范数的平方。

闭式解

与LASSO不同,岭回归的目标函数是二次的、可微的,因此存在闭式解。将目标函数对w^求导并令其等于0:

∂w^∂[(y−Xw^)2+λw^Tw^]=−2XT(y−Xw^)+2λw^=0

整理得:

(XTX+λI)w^=XTy

因此岭回归的闭式解为:

w^∗=(XTX+λI)−1XTy

其中I为(d+1)×(d+1)的单位矩阵。在普通最小二乘法中,闭式解为w^∗=(XTX)−1XTy,要求XTX可逆。然而,当特征之间存在共线性(某些列线性相关),或特征维度d大于样本数m时,XTX将不满秩,即存在为零的特征值,导致矩阵不可逆(奇异)。岭回归通过在XTX的对角线上添加λI,对所有特征值进行了"抬升":设XTX的特征值为μ1,μ2,…,μd+1(均≥0),则XTX+λI的特征值为μ1+λ,μ2+λ,…,μd+1+λ。由于λ>0:

μj+λ>0,∀j=1,2,…,d+1

因此即使某些μj=0(矩阵奇异),加扰动后所有特征值都严格大于零,XTX+λI变为正定矩阵,逆矩阵始终存在。此外,当XTX接近奇异(某些μj≈0)时,(μj)−1极大,解的数值极不稳定;添加λ后,(μj+λ)−1被限制在λ1以内,显著提升了数值稳定性。这也是岭回归被称为"收缩方法"的原因——较大的特征值对应的权重受影响较小,而较小的特征值对应的权重被显著收缩。

L2正则化的几何解释

L2正则化的等值线为圆形(球面),当与最小二乘损失的等高线相切时,切点不会落在坐标轴上,因此权重不会恰好为零。L2正则化的作用是将所有权重均匀地向零收缩,但不会产生稀疏解。

L2正则化的特点

- 权重收缩:所有权重被均匀压缩,但不会变为零,因此不具备特征选择能力。

- 数值稳定性:通过λI保证XTX+λI可逆,解决了共线性问题(多重共线性下XTX的某些特征值接近0,导致解不稳定)。

- 有闭式解:计算高效,无需迭代。

- 适用场景:当特征之间存在较强的多重共线性,或希望保留所有特征而只控制模型复杂度时,岭回归是更好的选择。

弹性网络

弹性网络(Elastic Net)是LASSO回归和岭回归的结合,它同时在目标函数中加入L1和L2正则化项,其目标函数为:

w^∗=argw^min2m1(y−Xw^)2+λ[α∥w^∥1+21−α∥w^∥22]

其中:

- λ≥0为整体正则化强度,控制正则化项的总体大小。

- α∈[0,1]为L1与L2的混合比例:

- α=1时,退化为LASSO回归。

- α=0时,退化为岭回归。

- 0<α<1时,同时包含L1和L2正则化的效果。

与LASSO和岭回归的关系

弹性网络旨在克服LASSO回归的两个局限性:

- LASSO的样本选择局限:当特征数d大于样本数m时(d>m),LASSO最多只能选择m个特征。弹性网络不受此限制,能够选择超过m个特征。

- LASSO的共线性处理:当存在一组高度相关的特征时,LASSO倾向于从中随机选择一个而忽略其余。弹性网络则会倾向于同时保留整组相关特征(类似于岭回归的分组效应),同时仍保持一定的稀疏性。

求解方法

弹性网络同样没有闭式解,常用的求解方法为坐标下降法。对于第j个权重w^j,更新公式为:

w^j←∑i=1mxij2+λ(1−α)S(∑i=1mxij(yi−∑k=jxikw^k),λα)

其中S(z,⋅)仍为软阈值函数,与LASSO的区别在于分母增加了λ(1−α)项(来自L2正则化的贡献),使得权重更新更加稳定。

弹性网络的特点

- 兼具稀疏性与稳定性:L1正则化提供特征选择能力(稀疏性),L2正则化提供权重的稳定性(处理共线性)。

- 分组效应:对于高度相关的特征组,弹性网络倾向于同时保留或同时剔除,而非像LASSO那样随机选取一个。

- 超参数调优:需要同时调整λ和α两个超参数,通常通过交叉验证(如网格搜索)来选择最优组合。

- 适用场景:当特征维度高、特征之间存在分组相关性(多共线性),且同时希望进行特征选择时,弹性网络是理想的选择。

三种正则化方法的比较

正则化项特征选择闭式解求解方法共线性处理超参数适用场景LASSO回归λ∥w^∥1可以无坐标下降法随机选一个λ高维稀疏岭回归λ∥w^∥22不可以有矩阵求逆均匀收缩λ特征共线性弹性网络λ[α∥w^∥1+21−α∥w^∥22]可以无坐标下降法分组保留λ,α高维+共线性

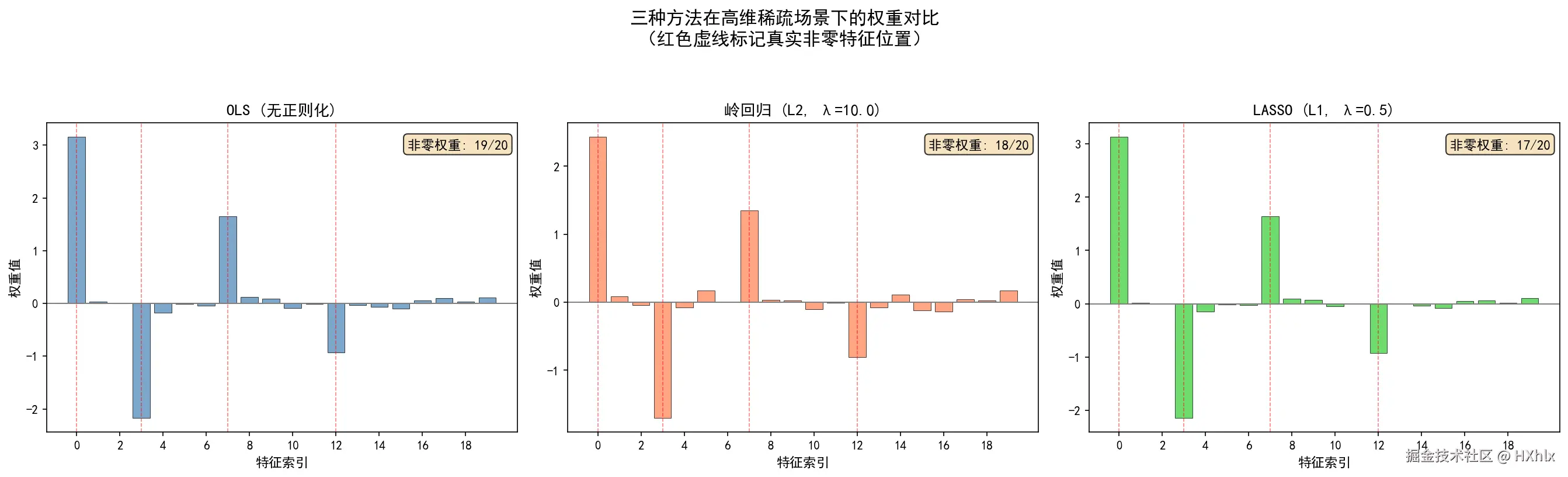

下面以20维特征、4个真实非零特征的模拟数据为例,对比三种方法的权重分布(红色虚线标记真实非零特征位置):

从图中可以直观看出:

- OLS:所有特征都分配了非零权重,存在过拟合风险。

- 岭回归:所有权重被压缩,但均不为零,不具备特征选择能力。

- LASSO:大部分权重被压缩为零,仅保留少数非零权重,实现了特征选择。

特别的,对于(是常数)这类直线,斜率无法被表示,因此回归方程不存在。

越大,约束区域越小,正则化回归的解离OLS最优解越远: