使用 docker 部署一个本地 dify

如何快速部署一个 dify 到本地

准备工作

下载 ollama ollama.com/ (这步如果使用 ai 的 api 可不用)

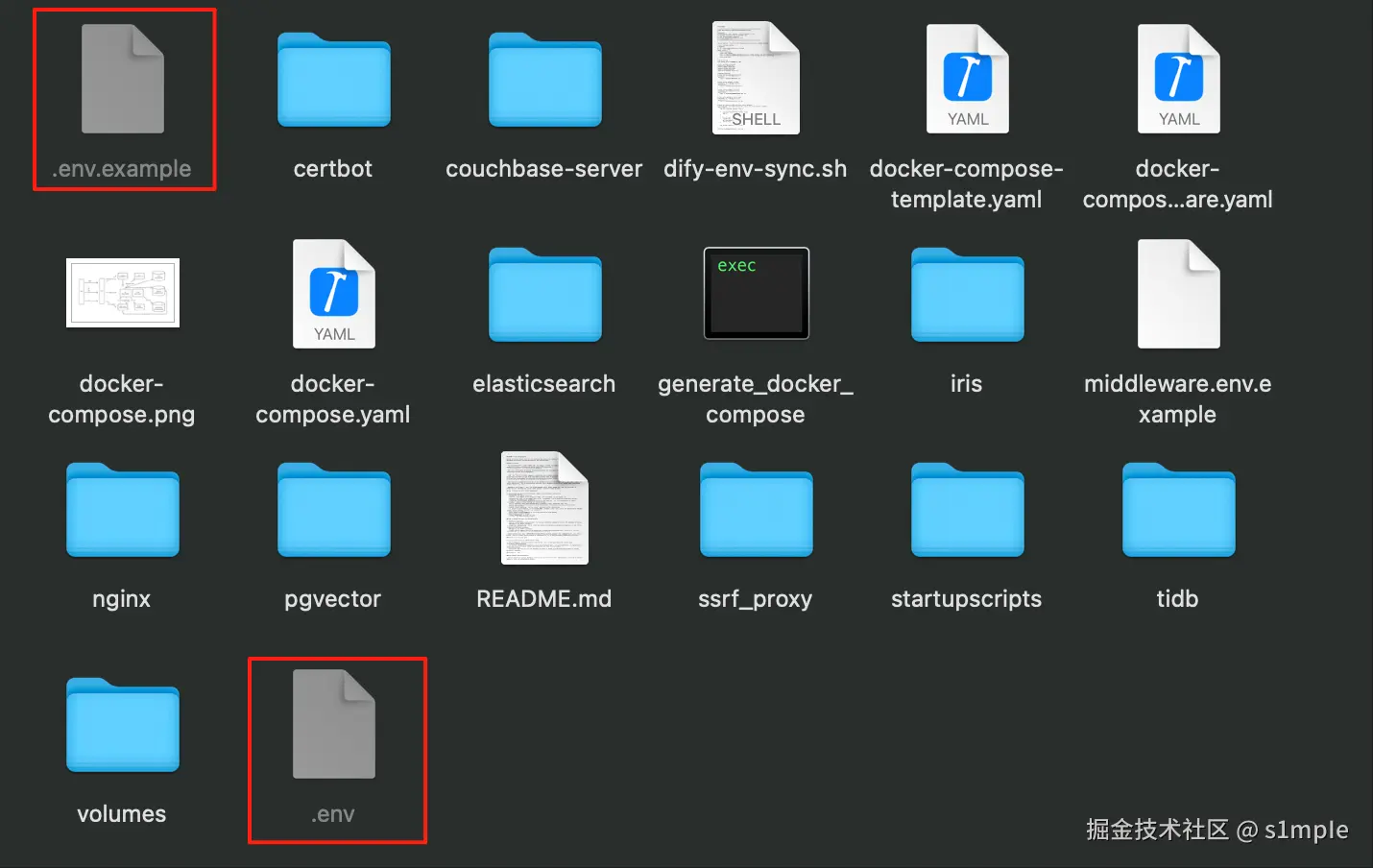

进入 dify 代码中的 docker 目录中,找到 .env.example 文件复制出一份命名为 .env

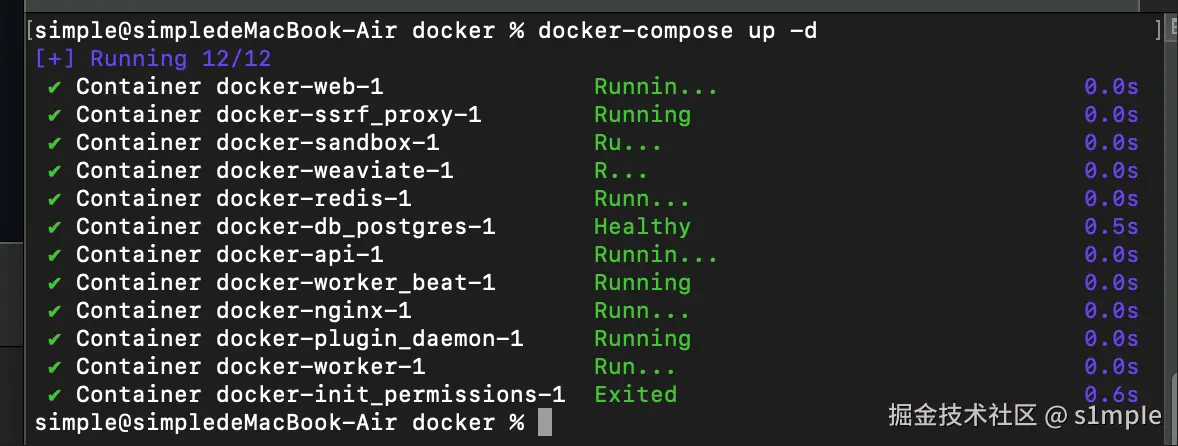

使用 cmd 进入 docker 目录中输入命令 docker-compose up -d (因为我使用的是 mac 所以安装 docker 可视化工具的时候已经有了 docker 的环境,但是 win 好像是不行的,好像需要另外配置一些东西的,具体可以网上搜一下,或者不使用可视化,自己配置一些 docker 环境)

第一次进入需要拉去一些镜像文件,有些可能拉取失败,可尝试使用魔法拉取

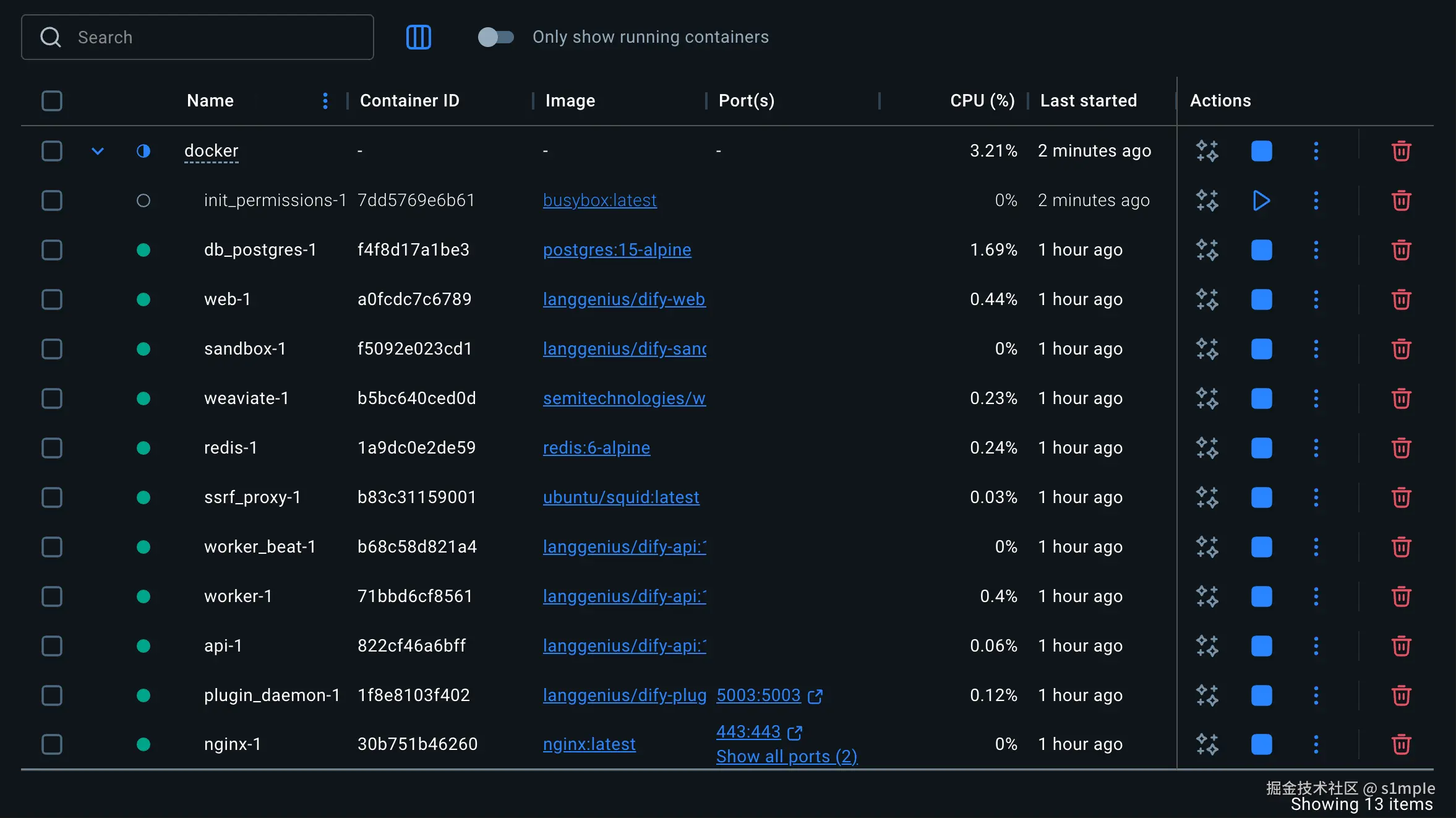

拉取完成后可以在 docker 可视化中查看

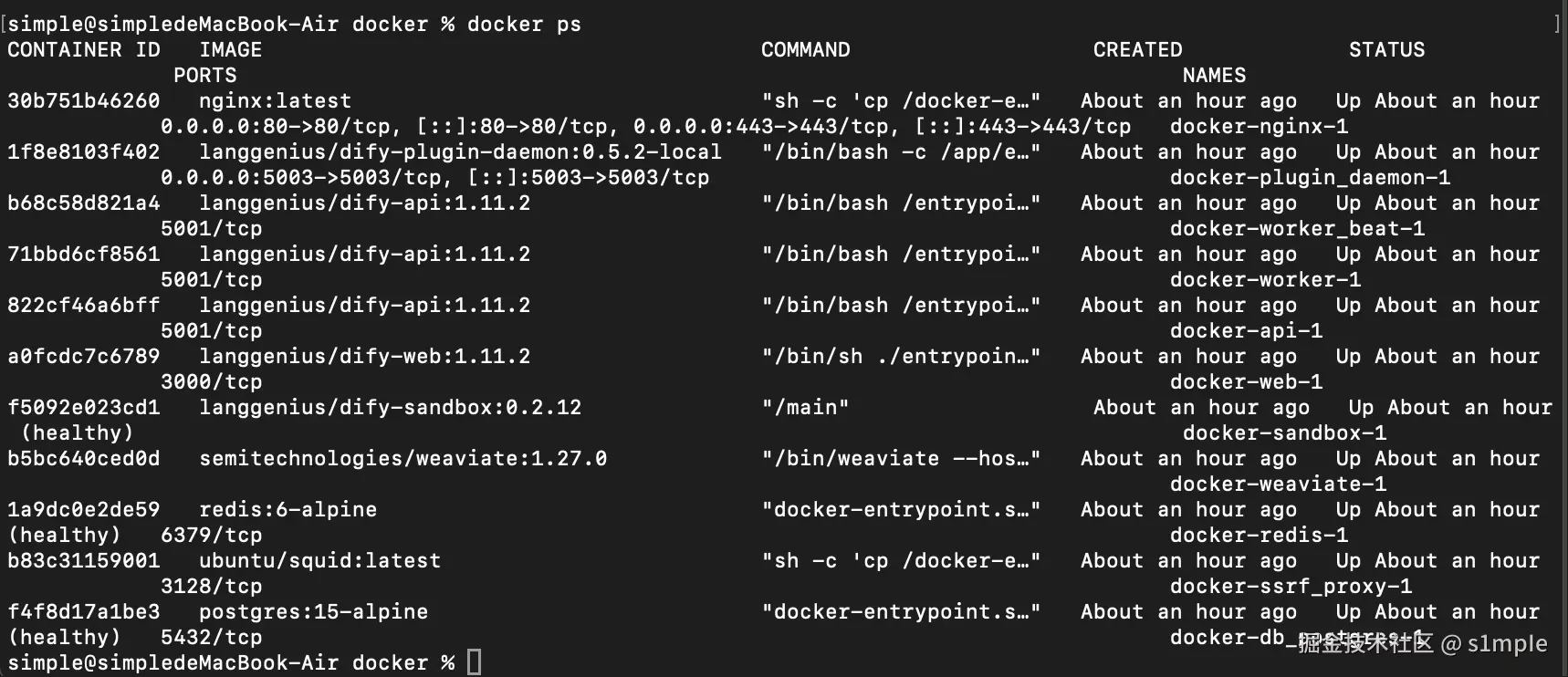

或者使用命令 docker ps 查看

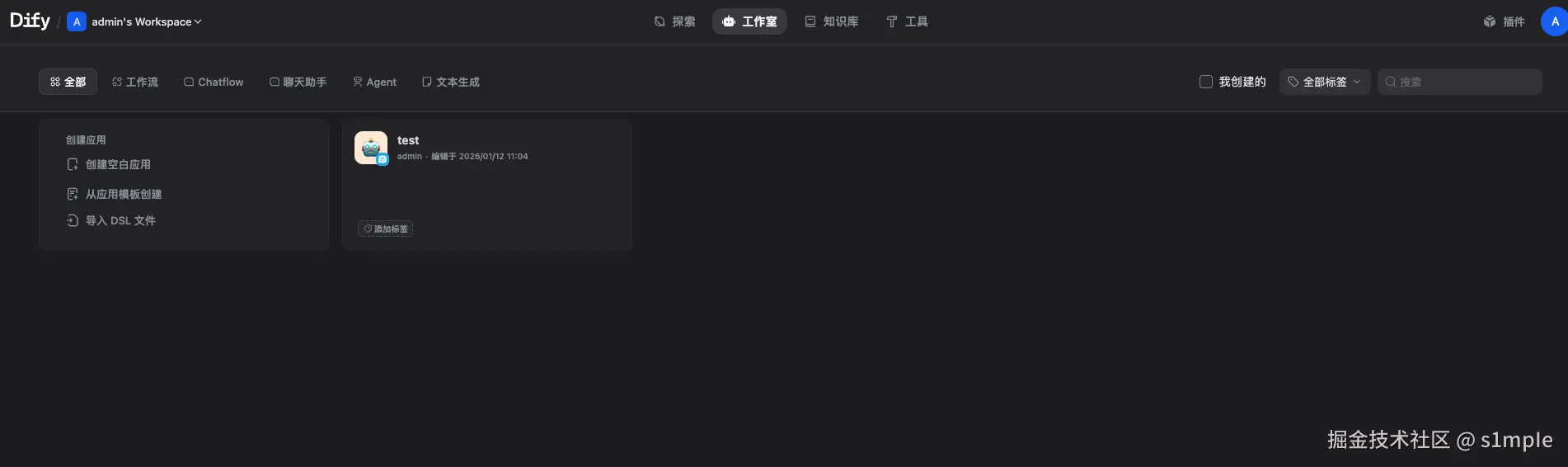

设置完成之后可直接登陆到这个页面

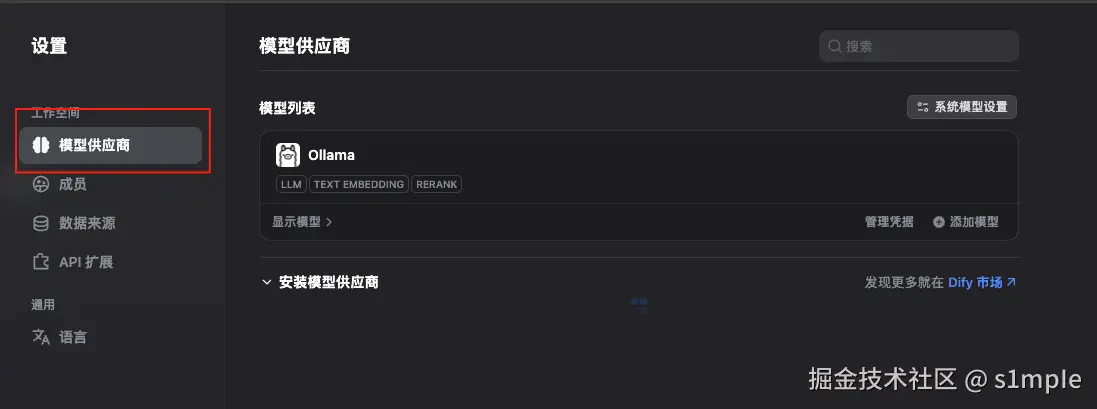

第一次进入我们需要去设置模型

这个页面会有很多模型,点击一个详情就会有具体操作文档

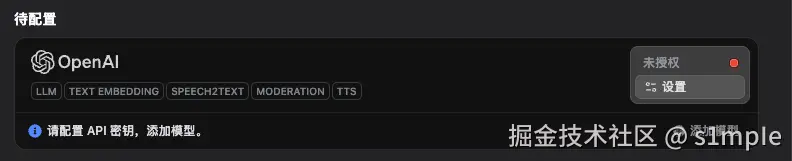

我们拿 OpenAI 来说

安装后

这里去配置你对于 api 的 key 就可以了

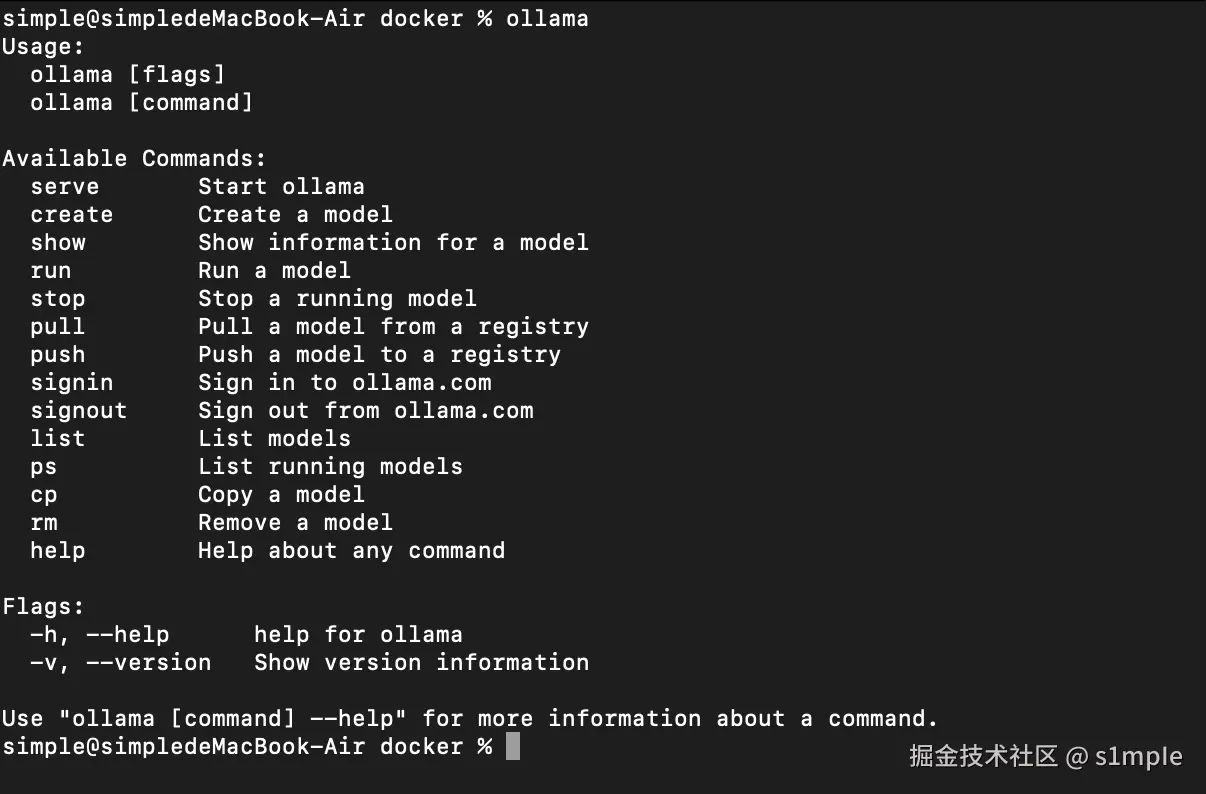

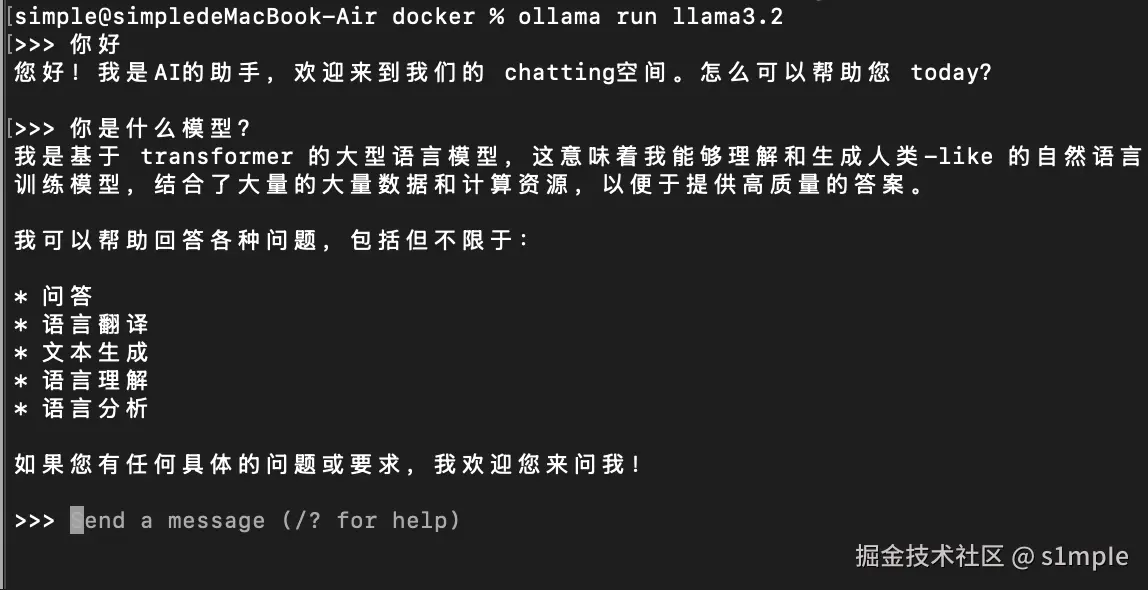

如果需要配置本地的模型的话就需要下载 ollama 下载完成后命令行输入 ollama

就说明安装成功了,这时候只需要通过命令去下载对于的模型就可以了比如(ollama run llama3.2)这时候就会去下载 llama3.2 这个模型,然后跑起来就可以了

浏览器输入 localhost:11434,就证明没问题了

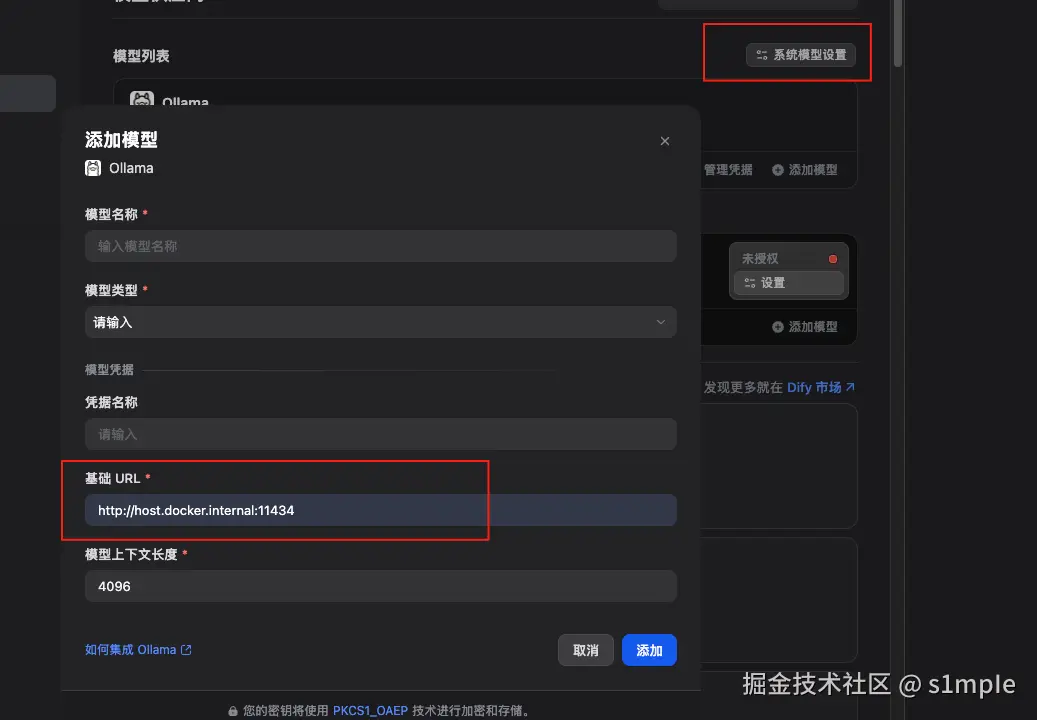

最后模型配置上就可以了,注意基础 url 填写 host.docker.internal:11434 这是 Docker 提供的一个特殊主机名。当在 Docker 容器内部使用时,它会解析为主机机器上 Docker 守护进程的 IP 地址。它允许容器与主机机器上运行的服务进行通信。

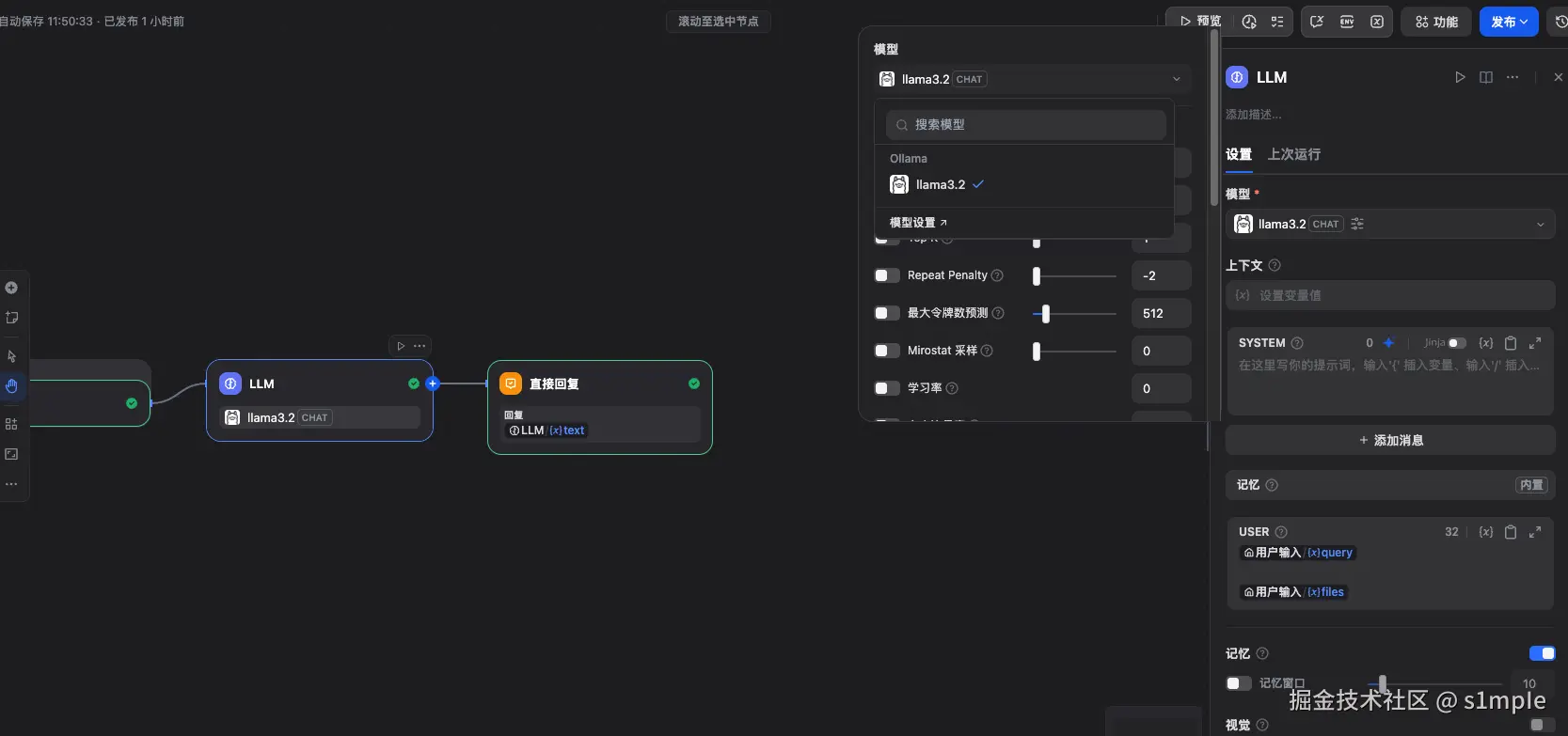

最后我们就可以创建应用,配置模型去发布使用了

最后至于一些训练和数据库就需要大家研究一下了