Python + Streamlit + Langchain + Ollama 实现一个网页版聊天机器人

一、python 安装 streamlit 和 Langchain-ollama

pip install streamlit

pip install langchain-ollama

二、完整代码

from langchain_ollama import ChatOllama

import streamlit as st

if "llm" not in st.session_state:

llm = ChatOllama(

model="deepseek-r1:1.5b",

temperature=0,

base_url='http://localhost:11434'

)

st.session_state['llm'] = llm

llm = st.session_state['llm']

if "messages" not in st.session_state:

st.session_state['messages'] = []

st.title("Streamlit + Langchain + Ollama 实现一个网页聊天机器人")

st.divider()

prompt = st.chat_input("请输入你的问题")

if prompt:

st.session_state['messages'].append({'role' : 'user' , 'content' : prompt})

for message in st.session_state['messages']:

st.chat_message(message['role']).markdown(message['content'])

with st.spinner("🤔思考中。。。。"):

response = llm.invoke(prompt)

print(response)

st.session_state['messages'].append({'role' : 'assistant' , 'content' : response.content})

st.chat_message('assistant').markdown(response.content)

三、启动命令

streamlit run streamlit_langchain_ollama_test.py

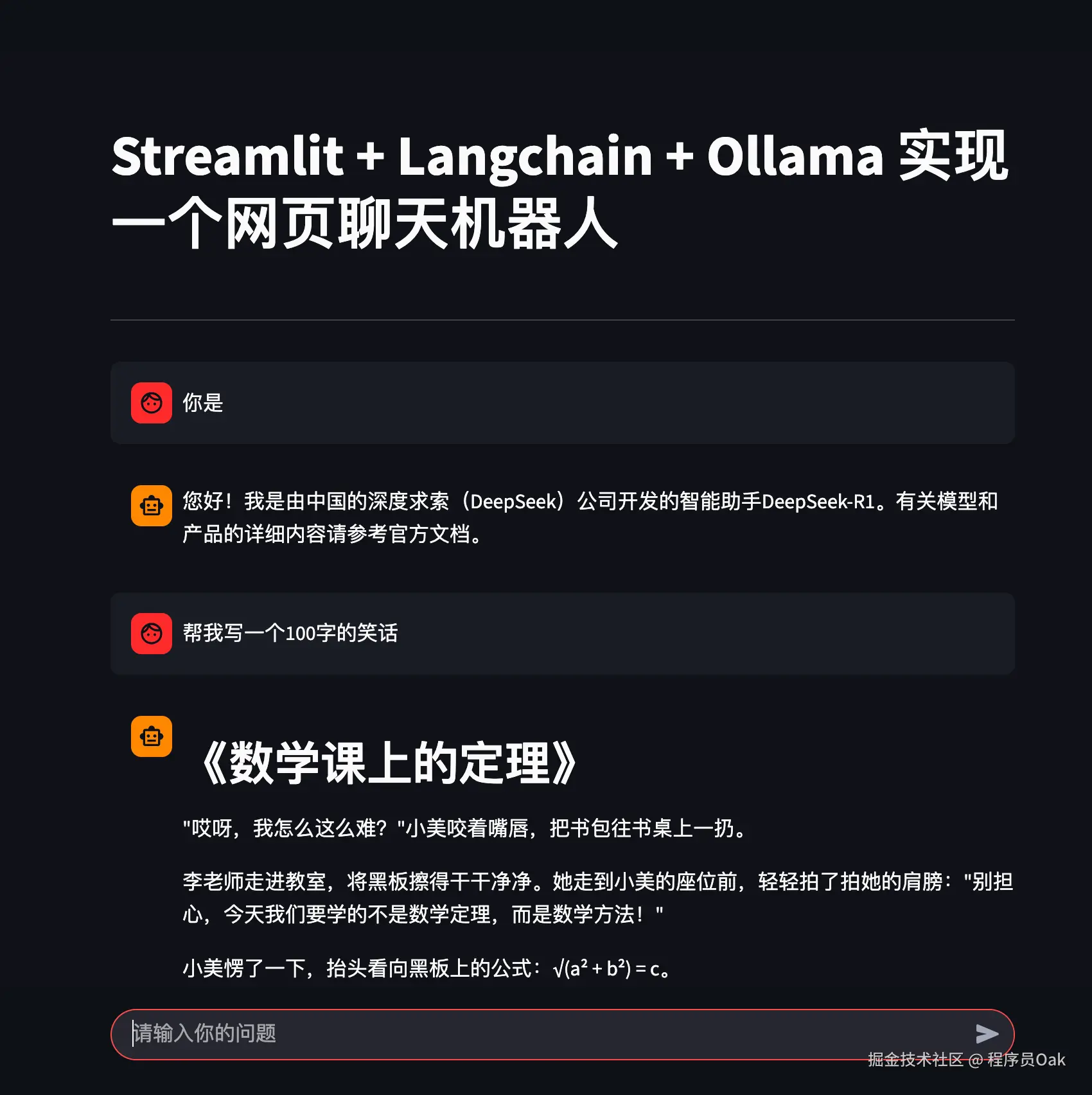

四、效果