自用华为ICT云赛道AI第二章知识点-深度学习概览

深度学习简介

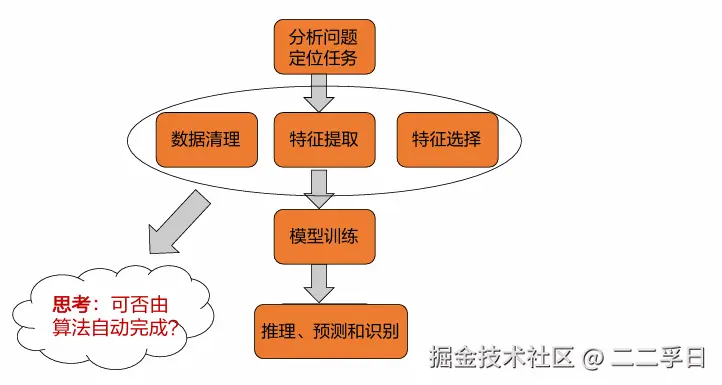

传统机器学习

- 分析问题定位任务:首先定位问题,将实际问题转化为机器学习问题,需要什么样的数据,然后进行数据的采集。包含数据探查、场景抽象、算法选择。比如逻辑回归可以决定我们是不是能喝咖啡;那另外朴素贝叶斯算法可以用来区分垃圾电子邮件和合法电子邮件。A系统不是直接检测,而是医生会提供给系统一些数据,比如说人体对咖啡因的耐受度,会不会睡不着

- 数据清理:数据清洗一一重新检查和验证数据的过程,旨在删除重复信息,纠正现有错误并提供数据一致性。采用(随即、系统、分层)、归一化、去除噪声、数据过滤

- 特征提取:特征抽象、特征重要性评估、特征衍生、特征降维。

- 特征选择

- 模型训练

- 推理,预测和识别

- 一般来说,机器学习中特征是由人工选定,而特征越多,给出的信息就越多,识别准确性会得到提升

- 但特征多,计算复杂度增加,搜索空间就打,训练数据会在全体特征向量中就会显得稀疏,影响相似性判断,即维度爆炸。

深度学习

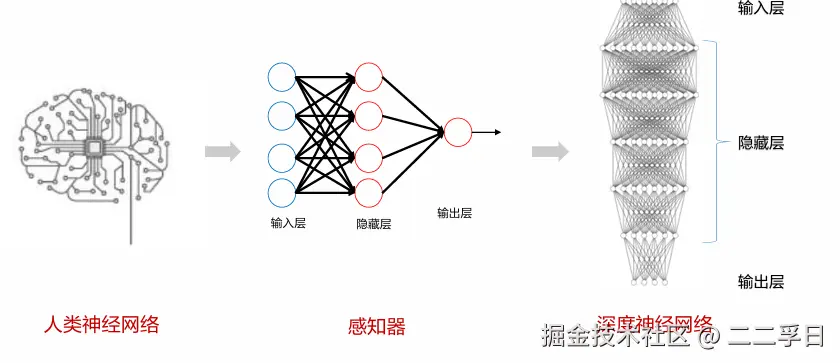

- 深度学习一般指深度神经网络,深度指神经网络的层数(多层)。

- 何为深度学习呢?在前面的课程我们已经了解,深度学习是机器学习的一个子集。

- 深度学习一般指深度神经网络,深度指神经网络的层数(多层)。

- 这是模拟人类的神经网络而构建的

- 在人工神经网络设计及应用研究中,通常需要考虑三个方面的内容,即神经元作用函数、神经元之间的连接形式和网络的学习(训练)。

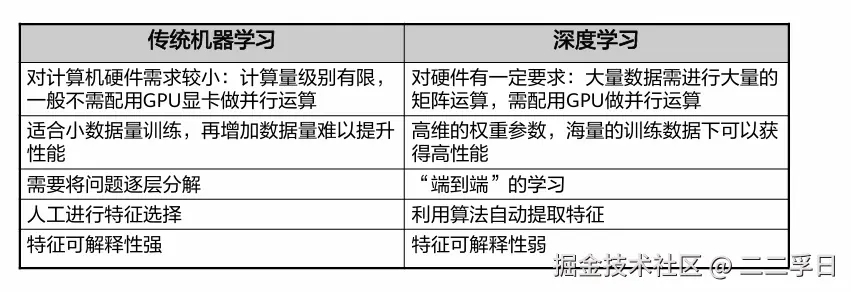

传统机器学习与深度学习

- 深度学习,是一种基于无监督特征学习和特征层次结构学习的模型,在计算机视觉,语音识别,自然语言处理等领域有着突出的优势。

- GPU之所以快的原因是因为高效的并行计算,对矩阵乘法和卷积具有极大的计算优势。

神经网络

- 目前,关于神经网络的定义尚不统一,按美国神经网络学家HechtNielsen的观点,神经网络的定义是:“神经网络是由多个非常简单的处理单元彼此按某种方式相互连接而形成的计算机系统,该系统靠其状态对外部输入信息的动态响应来处理信息”。

- 综合神经网络的来源、特点和各种解释,它可简单地表述为:人工神经网络是一种旨在模仿人脑结构及其功能的信息处理系统。

- 人工神经网络(简称神经网络):是由人工神经元互连组成的网络,它是从微观结构和功能上对人脑的抽象、简化,是模拟人类智能的一条重要途径,反映了人脑功能的若干基本特征,如并行信息处理、学习、联想、模式分类、记忆等。

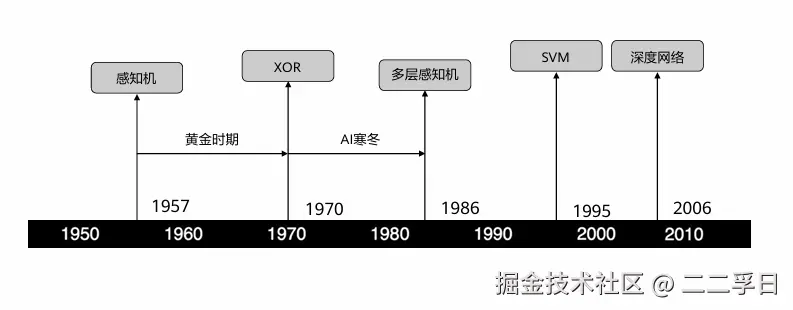

神经网络的发展历程

- 神经网络的发展历程(深度学习的里程碑):

- 1943年,神经科学家麦卡洛克(W.S.McCilloch)和数学家皮兹(W.Pitts)进行了一次合作,冀望探究并且模拟神经活动。时间来到1949年,加拿大著名心理学家唐纳德·赫布(DonaldOldingHebb)在《行为的组织》中提出了一种具有奠基意义的学习规则一一Hebb学习规则-这也为后面各种各样的学习算法莫定了基础。

- 萌芽的神经网络(1958~1969)

- 终于,在1957年,MP模型和Hebb学习规则迎来最强烈的碰撞—一基于两者的研究,美国科学家罗森布拉特(Rosenblatt)提出了一种类似于人类学习过程的算法,史称感知机。1969年美国人工智能先驱Minsky(马文·明斯基)质疑感知器只能处理线性分类问题,连最简单的XOR(亦或)问题都无法正确分类。大佬发话直接判了感知器死刑。

- 发展中的神经网络(1986~1998)

- 1986年,深度学习之父杰弗里·辛顿(GeoffreyHinton)改进了BP算法。1989年,RobertHecht-Nielsen成功证明了MLP的万能逼近定理,。好景不长,1991年,BP算法被指出存在梯度消失问题。并且在这段时间,符号学习大热,决策树、支持向量机(SVM)等算法被提出,在处理线性分类的问题上取得了当时最好的成绩。

- 崛起的神经网络(2006~?)

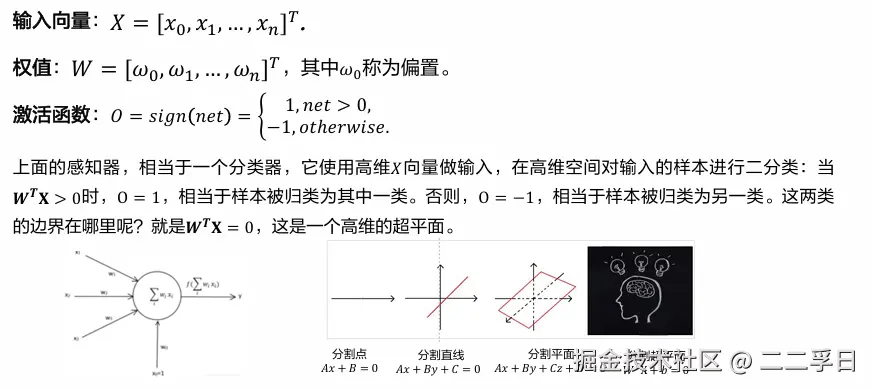

单层感知器

- 首先,我们一起来看一下,最简单的神经网络-单层感知器

- 感知器也称为感知机,它是接收多个信号,然后输出一个信号。

- 1957年Rosenblatt发明感知器(perceptron)算法。与机器学习共存10余年

- 1969年美国人工智能先驱Minsky质疑感知器只能处理线性分类问题,连最简单的XOR(亦或)问题都无法正确分类。大佬发话直接判了感知器死刑。

- 介绍一下,符号函数sign(x),也是激活函数:该函数的特点是当x>0时,输出值为1;当x=0时,输出值为0,;当x<0时,输出值为-1。

- 然后从三个维度去解释:1分割点,如果一个数是5,乘以一个权重w(正数),那么y就是1,-2-》-1;2分割线:一个点,二维平面;3三位平面,就是空间上x,y,z三个值的一个点;4超平面:数学概念,比如三位再加一个维度,四维。

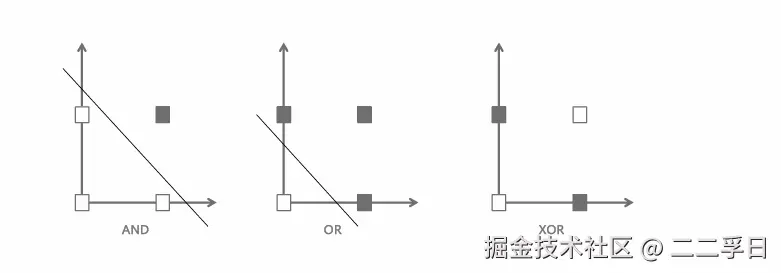

XOR问题

- 1969年,美国数学家及人工智能先驱Minsky在其著作中证明了感知器本质上是一种线性模型,只能处理线性分类问题,无法处理非线性数据。

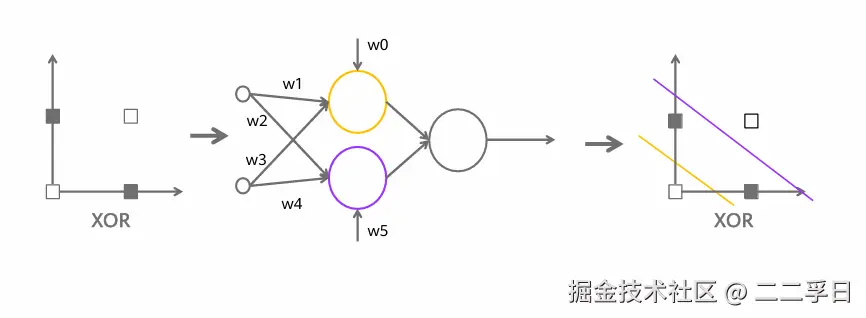

解决异或问题

前馈神经网络

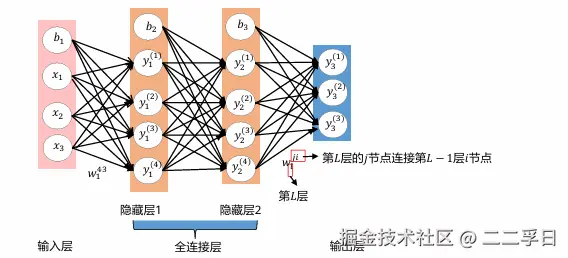

- 前馈神经网络(FeedforwardNeuralNetwork)是典型的深度学习模型。具有以下特点:

- 输入节点并无计算功能,只是为了表征输入矢量各元素值。

- 每个神经元只与前一层的神经元相连;接收前一层的输出,并输出给下一层。采用一种单向多层结构;整个网络中无反馈,信号从输入层向输出层单向传播,可用一个有向无环图表示。

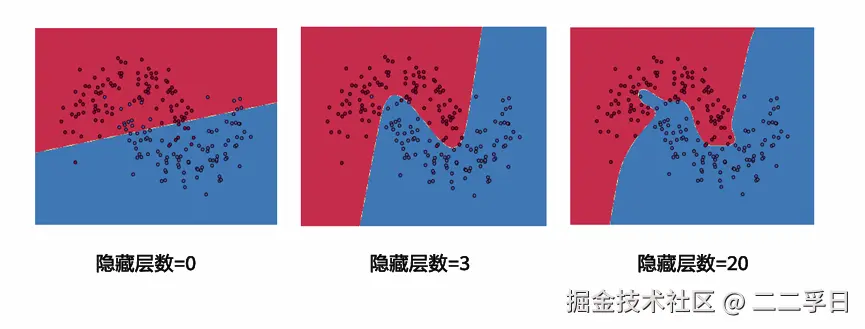

隐藏层数对神经网络的影响