1. 什么是魔搭?

魔搭 = Colab(画笔) + Hugging Face(颜料)

点击这里进入Colab的世界

想象一下,你想要画一幅画,但没有画笔和颜料——这就是“零基础小白”在NLP领域的困境!

- Colab 是你的“魔法画笔”:提供免费GPU算力和预装环境,让你无需本地配置。

- Hugging Face 是你的“颜料仓库”:提供海量预训练模型(如

google/owlvit-base-patch32),直接调用就能“上色”。

💡小贴士:魔搭=Colab + Hugging Face,就像“魔法城堡”里有画笔和颜料,你只需发挥想象力!

2. .ipynb文件的秘密

“边写边运行”就像做菜:一边加料(代码),一边尝味道(结果)。

.ipynb 是Jupyter Notebook的专属文件格式,它的核心特点是:

- 交互式体验:每一段代码(Cell)都能单独运行,实时看到结果(如图像、数据表)。

- 图文并茂:支持Markdown文本+代码混合,像写“电子实验报告”。

- 科学计算神器:专为机器学习设计,对比Word文档的“静态死板”,

.ipynb是“活的代码实验室”!

🔧避坑指南:保存时别乱改文件名,否则Colab可能会“忘记”你写的代码!

3. 微调:训练你的AI宠物

喂CNN数据 = 教它认猫狗🐶

文本NLP优势:让它学会“看懂”你的朋友圈文案。

微调(Finetuned) 是AI的“个性化训练”:

- CNN数据喂养:像教宠物狗坐下,给它看大量图片(如猫狗),它就能学会分类。

- 文本NLP的超能力:对文字任务(如情感分析、实体识别)效果更佳,因为NLP模型擅长“理解语义”。

- Hugging Face的魔法:提供一键微调工具,连OpenAI模型都能“调教”成你的专属AI!

🧠脑洞比喻:微调就像给AI“戴眼镜”,让它看清你想解决的问题!

4. 大模型:脑容量爆表的AI

参数多 = 记住10000000000个单词📚

Colab:给它提供“健身房”(GPU算力)。

大模型(Large Size Model) 是AI界的“学霸”:

- 参数数量:像记忆体里的“单词本”,参数越多,学得越深(但需要强大算力)。

- Colab的算力支持:免费提供GPU加速,否则你可能需要“等一整天才能训练完”!

🚀类比:大模型就像“全科状元”,而Colab是它的“补习班老师”——帮你高效利用资源!

5. 代码实战:从安装到检测

Step 1: 安装依赖

!pip install transformers # 招募“代码界的健身教练”💪

操作目的:安装 transformers 库,这是Hugging Face的核心工具包。

技术原理:pip 是Python的“快递员”,transformers 是“健身房教练”,帮你快速调用模型。

避坑指南:如果提示错误,试试重启内核(Kernel → Restart)!

Step 2: 请求图片

import requests # JS的fetch兄弟,但更“老实”

操作目的:引入 requests 模块,用于从网络加载图片。

技术原理:类似JavaScript的 fetch,但Python的 requests 更适合“批量运输”数据。

Step 3: 加载图片(数据可视化)

from PIL import Image # Python的“图像魔法师”🖼️

url = "https://d.musicapp.migu.cn/prod/playlist-service/playListimg/402bdb81-c298-4582-b208-543920fb8b08.jpg"

操作目的:引入图像处理库 PIL,并指定图片地址。

技术原理:PIL(Python Imaging Library)是图像处理的“瑞士军刀”,能轻松加载和操作图片。

避坑指南:确保URL正确,否则会像“快递员找不到地址”一样报错!

Step 4: 异步加载 vs 同步加载

stream=True= 快递员送货上门📦 vs 直接搬仓库到家。

result = requests.get(url, stream=True).raw # 懒人模式:只在需要时加载

im = Image.open(result) # 用PIL打开“魔法画布”

im

操作目的:通过 stream=True 实现“按需加载”,节省内存。

技术原理:异步加载像“快递员送货上门”,同步加载像“直接搬仓库到家”——Colab更推荐前者!

避坑指南:如果图片未显示,检查网络连接或尝试刷新页面!

Step 5: 模型检测(零样本识别)

from transformers import pipeline # 调用“AI火眼金睛”🔥

checkpoint = "google/owlvit-base-patch32"

detector = pipeline(model=checkpoint, task="zero-shot-object-detection")

操作目的:初始化预训练模型,用于图像识别。

技术原理:pipeline 是Hugging Face的“快捷键”,一键调用模型,无需手动调参。

避坑指南:第一次运行可能需要下载模型,耐心等待几秒!

Step 6: 零样本检测(实战演练)

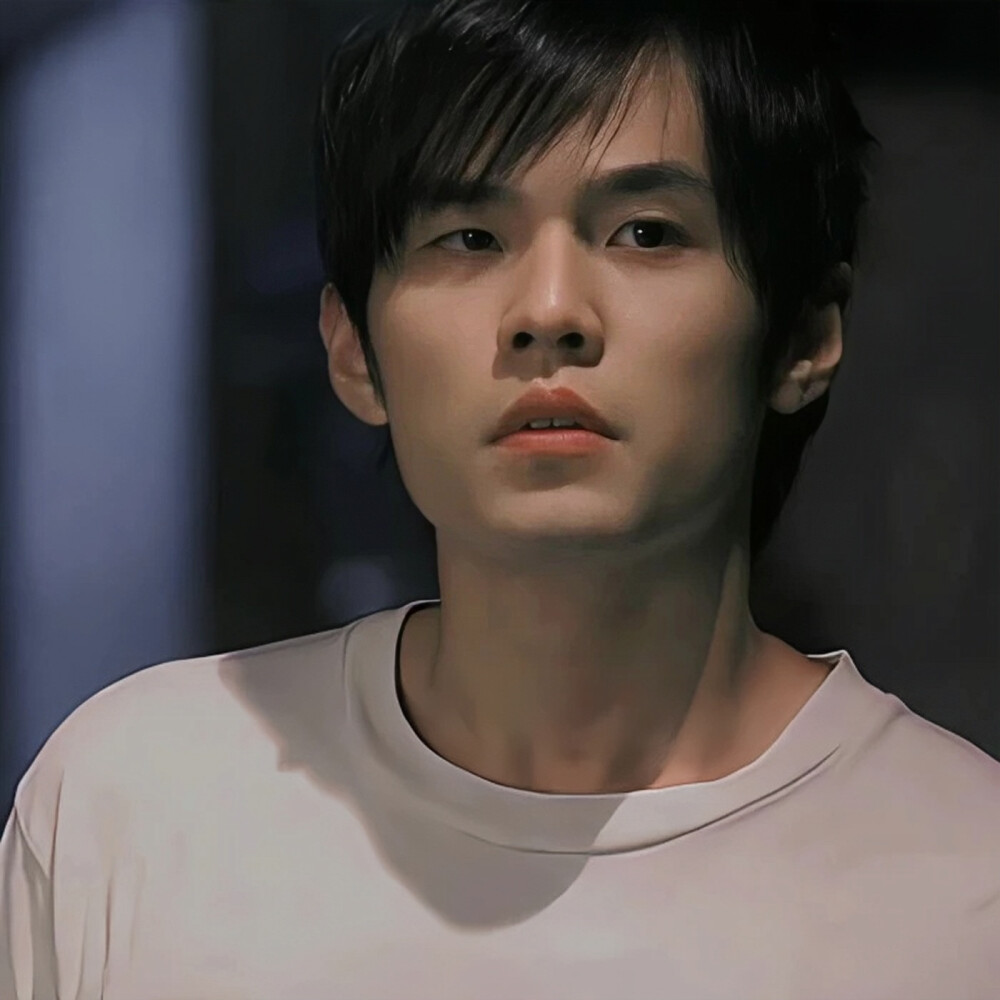

告诉AI:“这图里有男孩吗?”👦

它会回答:“不确定,但我觉得像!”

predictions = detector(im, candidate_labels=["boy"]) # 零样本检测魔法✨

操作目的:让模型检测图片中是否包含“男孩”标签。

技术原理:零样本检测(Zero-Shot)让AI“猜”出你没教过的内容,比如“这图有猫吗?”

避坑指南:如果结果不准确,可以尝试更换标签(如 ["person"])或调整模型参数!

6. 总结:小白也能成为Colab魔法师!

“魔法”= 技术(代码) + 工具(Colab) + 耐心(调试)

现在,去你的“魔法城堡”冒险吧!✨

三大行动指南:

- 大胆尝试:Colab不怕“试错”,代码报错是学习的一部分!

- 善用社区:Hugging Face的模型库就像“魔法道具箱”,总有一款适合你!

- 保持好奇:从“喂CNN数据”到“训练AI宠物”,每一步都是通往大师的阶梯!

🚀终极鼓励:别怕代码复杂,记住——你不是在写魔法,而是在“召唤”魔法!

🌟 附录:常见问题解答(FAQ)

Q1: Colab免费吗?

A1: 免费!但GPU资源有限,建议及时保存结果。

Q2: 代码运行超时怎么办?

A2: 点击“Runtime → Change runtime type”选择GPU,或分步运行代码。

Q3: 如何分享我的魔法城堡?

A3: 点击“File → Save and checkpoint”,然后复制链接分享给朋友!

现在,打开Colab,开始你的NLP魔法之旅吧!🧙♂️