- 配置JAVA环境

- 准备jdk包(注意命名,后面配置的环境变量可能会有影响),也可以从我给的链接下

通过百度网盘分享的文件:jdk-8u37…

链接:https://pan.baidu.com/s/1F4QG_-I_e2ETUjlcFc9aZQ?pwd=z9t2

提取码:z9t2

复制这段内容打开「百度网盘APP 即可获取」

- 上传jdk-linux的包到虚拟机,并使用

tar -zxvf <jdk地址> -C /usr/lib/jvm将其解压到/usr/lib/jvm目录(需要自己创建jvm目录)

- 要是不放心可以

cd /usr/lib/jvm看一下是否多了一个jdk文件夹 - 修改环境变量

vim ~/.bashrc

# 添加下面内容

export JAVA\_HOME=/usr/lib/jvm/jdk1.8.0_371

export JRE\_HOME=${JAVA\_HOME}/jre

export CLASSPATH=.:${JAVA\_HOME}/lib:${JRE\_HOME}/lib

export PATH=${JAVA\_HOME}/bin:$PATH

- 保存退出.bashrc,使用

source ~/.bashrc让我们刚刚的配置生效。使用java -version查看是否配置java成功

二、 安装Hadoop伪分布式

Hadoop下载地址:https://dlcdn.apache.org/hadoop/common/,我下的是hadoop-3.3.6.tar.gz 696M的那个

- 使用tar命令解压Hadoop包到/usr/local目录

- 使用chown修改Hadoop权限,查看相关版本信息

- 修改配置文件

/usr/local/hadoop(这个hadoop是我们解压后重命名的文件夹名)/etc/hadoop/目录下

- core-site.xml

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/local/hadoop/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>

- hdfs-site.xml

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/data</value>

</property>

</configuration>

-

格式化NameNode名称节点

cd /usr/local/hadoop

./bin/hdfs namenode -format

5. 启动Hadoop,开启守护进程,通过JPS查看进程数目应该是4个

cd /usr/local/hadoop

./sbin/start-dfs.sh

6. 浏览器查看localhost:9870(或者ip:9870)

三、安装Spark Local模式

下载地址:https://archive.apache.org/dist/spark/,我这里下的是spark-3.4.2-bin-without-hadoop.tgz

-

使用tar命令解压spark包到/usr/local目录

-

修改解压后的文件夹为spark,并修改内容所有者和所属组为hadoop

-

修改./conf/spark-env.sh配置文件(需要使用cp复制模板文件再进行修改)

cd /usr/local/spark

cp ./conf/spark-env.sh.template ./conf/spark-env.sh

export SPARK_DIST_CLASSPATH=$(/usr/local/hadoop/bin/hadoop classpath)

4. 看spark是否安装成功

cd /usr/local/spark

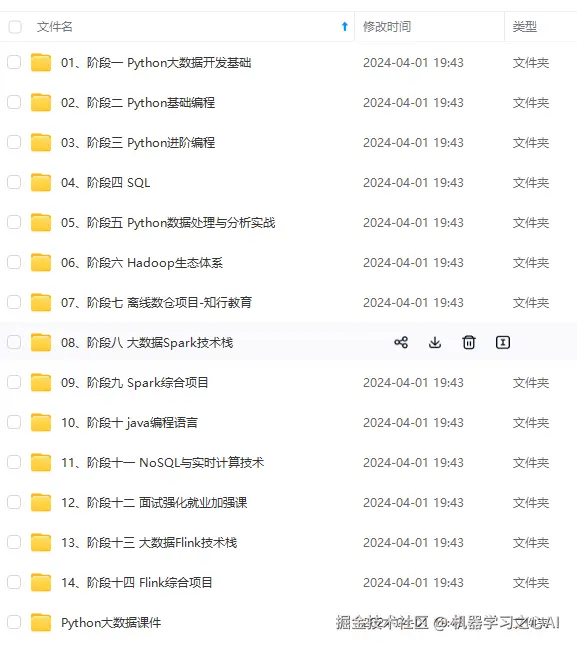

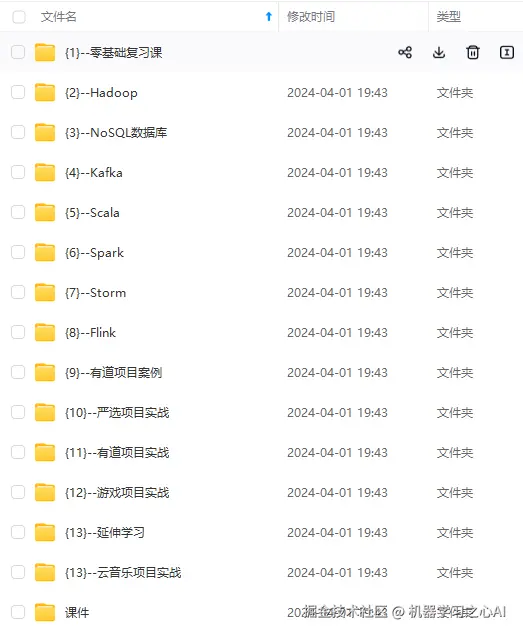

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化资料的朋友,可以戳这里获取](https://gitee.com/vip204888)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**