案例实施

1、环境配置

环境要求:如图所示配置IP地址,所有主机桥接到vmnet1,并关闭防火墙和Selinux。GFS两台服务器分别添加两块20G的磁盘,客户端使用宿主机。

1.1、配置IP地址

关于IP的配置这里以web1为例,只有web1和web2添加两块网卡,相对比其他服务器的配置只是多一块需要配置的网卡,其他服务器正常配置IP即可。

[root@web1 ~]# systemctl stop firewalld

[root@web1 ~]# systemctl disable firewalld

[root@web1 ~]# setenforce 0

[root@web1 ~]# cd /etc/sysconfig/network-scripts/

[root@web1 network-scripts]# vim ifcfg-ens33

......省略部分内容

BOOTPROTO=static

NAME=ens33

DEVICE=ens33

ONBOOT=yes

IPADDR=192.168.1.3

NETMASK=255.255.255.0

[root@web1 network-scripts]# cp ifcfg-ens33 ifcfg-ens36

[root@web1 network-scripts]# vim ifcfg-ens36

......省略部分内容

BOOTPROTO=static

NAME=ens36

DEVICE=ens36

ONBOOT=yes

IPADDR=200.0.0.3

NETMASK=255.255.255.0

[root@web1 network-scripts]# systemctl restart network

1.2、GFS添加磁盘

关于磁盘可以开机前添加,会自动识别磁盘。若开机后添加可以执行以下命令识别磁盘。

echo "- - -" >> /sys/class/scsi_host/host0/scan

echo "- - -" >> /sys/class/scsi_host/host1/scan

echo "- - -" >> /sys/class/scsi_host/host2/scan

到目前的配置,web1和web2可以ping通全网,而公网和私网则不能相互ping通。GFS1和GFS2每台服务器上都有一块sdb磁盘。

2、Keepalived

搭建Keepalived实现Lvs的双机热备。本次使用yum方式安装keepalived和ipvsadm管理工具。LVS1和LVS2都需要那种,这里以LVS1为例。

[root@lvs1 ~]# yum -y install keepalived ipvsadm

[root@lvs1 ~]# systemctl enable keepalived

2.1、配置主调度器

[root@lvs1 ~]# cd /etc/keepalived/

[root@lvs1 keepalived]# cp keepalived.conf keepalived.conf.back

[root@lvs1 keepalived]# vim keepalived.conf

! Configuration File for keepalived

global_defs {

......省略部分内容

router_id LVS1 //主调度器名称

}

vrrp_instance VI_1 {

state MASTER //主调度器的热备状态

interface ens33 //修改接口网卡

virtual_router_id 51

priority 100

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

200.0.0.100 //配置漂移地址

}

}

[root@lvs1 keepalived]# systemctl start keepalived

[root@lvs1 keepalived]# ip addr show dev ens33 //查看漂移地址

2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP qlen 1000

link/ether 00:0c:29:16:da:97 brd ff:ff:ff:ff:ff:ff

inet 200.0.0.1/24 brd 200.0.0.255 scope global ens33

valid_lft forever preferred_lft forever

inet 200.0.0.100/32 scope global ens33 //此时漂移地址在主调度器上

valid_lft forever preferred_lft forever

inet6 fe80::c3cf:e745:3647:394a/64 scope link

valid_lft forever preferred_lft forever

2.2、配置备份调度器

[root@lvs2 ~]# cd /etc/keepalived/

[root@lvs2 keepalived]# cp keepalived.conf keepalived.conf.bak

[root@lvs2 keepalived]# vim keepalived.conf

! Configuration File for keepalived

global_defs {

......省略部分内容

router_id LVS2 //备份调度器名称

}

vrrp_instance VI_1 {

state BACKUP //备份调度器的热备状态

interface ens33 //修改接口网卡

virtual_router_id 51

priority 99 //修改优先级别

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

200.0.0.100 //配置漂移地址

}

}

[root@lvs2 keepalived]# systemctl start keepalived

[root@lvs2 keepalived]# ip addr show dev ens33 //查看漂移地址

2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP qlen 1000

link/ether 00:0c:29:55:f7:8d brd ff:ff:ff:ff:ff:ff

inet 200.0.0.2/24 brd 200.0.0.255 scope global ens33

valid_lft forever preferred_lft forever

inet6 fe80::15ae:efbc:5794:874b/64 scope link

valid_lft forever preferred_lft forever

备份服务器仍处于备份状态,因此备份服务器不会为ens33接口添加VIP地址。当主服务器失效时,VIP地址才会过来,达到了双机热备的功能。

3、LVS-DR

3.1、负载均衡

两台LVS都需要配置选项3.1中的内容(关闭ICMP重定向,配置策略)。

3.1.1、关闭icmp重定向

[root@lvs1 ~]# vim /etc/sysctl.conf

net.ipv4.conf.all.send_redirects = 0

net.ipv4.conf.default.send_redirects = 0

net.ipv4.conf.ens33.send_redirects = 0

[root@lvs1 ~]# sysctl -p

3.1.2、配置负载分配策略

[root@lvs1 ~]# ipvsadm -C //清除原有策略

[root@lvs1 ~]# ipvsadm -A -t 200.0.0.100:80 -s rr

[root@lvs1 ~]# ipvsadm -a -t 200.0.0.100:80 -r 200.0.0.3 -g -w 1

[root@lvs1 ~]# ipvsadm -a -t 200.0.0.100:80 -r 200.0.0.4 -g -w 1

[root@lvs1 ~]# ipvsadm-save //保存策略

-A -t lvs1:http -s rr

-a -t lvs1:http -r 200.0.0.3:http -g -w 1

-a -t lvs1:http -r 200.0.0.4:http -g -w 1

[root@lvs1 ~]# systemctl enable ipvsadm

3.2、配置主调度器

通过配置文件添加两台web节点。

[root@lvs1 ~]# vim /etc/keepalived/keepalived.conf

vrrp_instance VI_1 { //在vrrp配置模块下面添加节点

......省略部分内容

virtual_ipaddress {

200.0.0.100

}

}

......省略部分内容

virtual_server 200.0.0.100 80 { //以下内容需要修改添加节点信息

delay_loop 15

lb_algo rr

lb_kind DR

protocol TCP

real_server 200.0.0.3 80 {

weight 1

TCP_CHECK {

connect_port 80

connect_timeout 3

nb_get_retry 3

delay_before_retry 4

}

}

real_server 200.0.0.4 80 {

weight 1

TCP_CHECK {

connect_port 80

connect_timeout 3

nb_get_retry 3

delay_before_retry 4

}

}

}

[root@lvs1 ~]# systemctl restart keepalived

3.3、配置备份调度器

相同的方法配置完主调度器后,接着配置备份调度器。

[root@lvs2 ~]# vim /etc/keepalived/keepalived.conf

vrrp_instance VI_1 { //在vrrp配置模块下面添加节点

......省略部分内容

virtual_ipaddress {

200.0.0.100

}

}

......省略部分内容

virtual_server 200.0.0.100 80 { //以下内容需要修改添加节点信息

delay_loop 15

lb_algo rr

lb_kind DR

protocol TCP

real_server 200.0.0.3 80 {

weight 1

TCP_CHECK {

connect_port 80

connect_timeout 3

nb_get_retry 3

delay_before_retry 4

}

}

real_server 200.0.0.4 80 {

weight 1

TCP_CHECK {

connect_port 80

connect_timeout 3

nb_get_retry 3

delay_before_retry 4

}

}

}

[root@lvs2 ~]# systemctl restart keepalived

4、GFS

4.1、web端

GFS的配置如下表所示,两台服务器实现复制卷,复制卷的名称为share。

在两个web服务器将share复制卷挂载到web服务器的/var/www/html下。

| IP | 主机名 | 挂载盘 | 挂载目录 |

|---|---|---|---|

| 192.168.1.1 | gfs1 | /dev/sdb(20G) | /b3 |

| 192.168.1.2 | gfs2 | /dev/sdb(20G) | /b3 |

4.1.1、web配置VIP

每个web服务器上都需要配置漂移地址(VIP)。

[root@web1 ~]# cd /etc/sysconfig/network-scripts/

[root@web1 network-scripts]# cp ifcfg-lo ifcfg-lo:0

[root@web1 network-scripts]# vim ifcfg-lo:0

DEVICE=lo:0

IPADDR=200.0.0.100

NETMASK=255.255.255.255

ONBOOT=yes

[root@web1 network-scripts]# ifup lo:0

[root@web1 network-scripts]# ifconfig lo:0

lo:0: flags=73<UP,LOOPBACK,RUNNING> mtu 65536

inet 200.0.0.100 netmask 255.255.255.255

loop txqueuelen 1 (Local Loopback)

[root@web1 network-scripts]# vim /etc/rc.local

......省略部分内容

/sbin/route add -host 200.0.0.100 dev lo:0 //添加一条路由

[root@web1 network-scripts]# route add -host 200.0.0.100 dev lo:0

4.1.2、关闭部分arp应答

[root@web1 ~]# vim /etc/sysctl.conf

net.ipv4.conf.all.arp_ignore = 1

net.ipv4.conf.all.arp_announce = 2

net.ipv4.conf.default.arp_ignore = 1

net.ipv4.conf.default.arp_announce = 2

net.ipv4.conf.lo.arp_ignore = 1

net.ipv4.conf.lo.arp_announce = 2

[root@web1 ~]# sysctl -p

4.1.3、配置httpd

[root@web1 ~]# yum -y install httpd

[root@web1 ~]# echo "111" > /var/www/html/index.html

[root@web1 ~]# systemctl start httpd

[root@web1 ~]# systemctl enable httpd

4.2、配置GFS端

两台GFS服务器都需要配置,以下gfs1和gfs2配置相同,我以gfs1为例,gfs2相反配置即可。

[root@gfs1 ~]# vim /etc/hosts //GFS本地节点解析

192.168.1.1 node1

192.168.1.2 node2

[root@gfs1 ~]# yum -y install glusterfs glusterfs-server glusterfs-fuse glusterfs-rdma

[root@gfs1 ~]# systemctl start glusterd

[root@gfs1 ~]# systemctl enable glusterd

[root@gfs1 ~]# gluster peer probe node1 //本身在gfs1上操作,所以node1也可以不执行

peer probe: success. Probe on localhost not needed

[root@gfs1 ~]# gluster peer probe node2

peer probe: success.

[root@gfs1 ~]# gluster peer status //查看GFS群集状态

Number of Peers: 1

Hostname: node2

Uuid: 16bc8386-0168-4c21-8ed3-e762f1bd8c77

State: Peer in Cluster (Connected)

4.2.1、创建复制卷

使用fdisk命令创建一个20G的磁盘空间为sdb1并格式化。两台GFS服务器创建成复制卷,卷名为share。

[root@gfs1 ~]# fdisk /dev/sdb

n→p→回车→回车→回车→w保存退出

[root@gfs1 ~]# mkfs.xfs /dev/sdb1

[root@gfs1 ~]# gluster volume create share replica 2 node1:/b1 node2:/b1 force

volume create: share: success: please start the volume to access data

[root@gfs1 ~]# gluster volume start share

volume start: share: success

4.2.2、web挂载复制卷

web1配置如下:

[root@web1 ~]# yum -y install glusterfs glusterfs-fuse

[root@web1 ~]# vim /etc/hosts

192.168.1.1 node1

192.168.1.2 node2

[root@web1 ~]# mount -t glusterfs node1:share /var/www/html/

[root@web1 ~]# df -h

文件系统 容量 已用 可用 已用% 挂载点

/dev/mapper/cl-root 17G 3.8G 14G 23% /

devtmpfs 473M 0 473M 0% /dev

tmpfs 489M 144K 489M 1% /dev/shm

tmpfs 489M 7.1M 482M 2% /run

tmpfs 489M 0 489M 0% /sys/fs/cgroup

/dev/sda1 1014M 173M 842M 18% /boot

tmpfs 98M 12K 98M 1% /run/user/0

/dev/sr0 53M 53M 0 100% /media

node1:share 17G 3.8G 14G 23% /var/www/html

web2配置如下:

[root@web2 ~]# yum -y install glusterfs glusterfs-fuse

[root@web2 ~]# vim /etc/hosts

192.168.1.1 node1

192.168.1.2 node2

[root@web2 ~]# mount -t glusterfs node1:share /var/www/html/

[root@web2 ~]# df -hT

文件系统 类型 容量 已用 可用 已用% 挂载点

/dev/mapper/cl-root xfs 17G 3.9G 14G 23% /

devtmpfs devtmpfs 473M 0 473M 0% /dev

tmpfs tmpfs 489M 144K 489M 1% /dev/shm

tmpfs tmpfs 489M 7.1M 482M 2% /run

tmpfs tmpfs 489M 0 489M 0% /sys/fs/cgroup

/dev/sda1 xfs 1014M 173M 842M 18% /boot

tmpfs tmpfs 98M 12K 98M 1% /run/user/0

/dev/sr0 iso9660 53M 53M 0 100% /media

node1:share fuse.glusterfs 17G 3.8G 14G 23% /var/www/html

到目前为止,复制卷就已经创建完了。下一步需要测试了,在挂载盘中创建文件,查看网页内容。

4.2.3、测试

在上面挂了盘以后,之前的内容就已经消失了,所以还得从新创建一个新的网页内容。在web1上创建一个内容,内容会同步到web2上,客户端查看的内容就会是后面创建的内容。

[root@web1 ~]# echo "666" > /var/www/html/index.html

......web2查看网页内容

[root@web2 ~]# cat /var/www/html/index.html

666

5、zabbix

无监控不运维,最后搭建Zabbix服务器分别监控LVS服务器和web服务器的性能。

5.1、安装

5.1.1、创建zabbix源

挂盘后将文件复制到创建的目录中,yum仓库目录指向zabbix。

[root@zabbix ~]# mkdir /zabbix

[root@zabbix ~]# cp /media/* /zabbix

[root@zabbix ~]# cd /zabbix

[root@zabbix zabbix]# createrepo .

[root@zabbix ~]# rm -rf /etc/yum.repos.d/*

[root@zabbix ~]# vim /etc/yum.repos.d/a.repo

[a]

name=a

baseurl=file:///zabbix

gpgcheck=0

5.1.2、安装MariaDB

[root@zabbix ~]# yum -y install mariadb-server mariadb

[root@zabbix ~]# systemctl start mariadb

[root@zabbix ~]# systemctl enable mariadb

[root@zabbix ~]# mysqladmin -u root password "123"

5.1.3、安装Zabbix

[root@zabbix ~]# yum -y install zabbix-server-mysql zabbix-web-mysql zabbix-agent

[root@zabbix ~]# mysql -u root -p

Enter password: //输入密码

MariaDB [(none)]> create database zabbix character set utf8 collate utf8_bin;

Query OK, 1 row affected (0.00 sec)

MariaDB [(none)]> grant all privileges on zabbix.* to zabbix@localhost identified by "456";

Query OK, 0 rows affected (0.00 sec)

5.1.4、配置zabbix

[root@zabbix ~]# zcat /usr/share/doc/zabbix-server-mysql-3.4.1/create.sql.gz | mysql -uzabbix -p zabbix

Enter password:

[root@zabbix ~]# cp /etc/zabbix/zabbix_server.conf /etc/zabbix/zabbix_server.conf.bak

[root@zabbix ~]# vim /etc/zabbix/zabbix_server.conf

DBHost=localhost

DBPassword=456

[root@zabbix ~]# cp /etc/zabbix/zabbix_agentd.conf /etc/zabbix/.zabbix_agent.conf.bak

[root@zabbix ~]# vim /etc/zabbix/zabbix_agentd.conf

Server=200.0.0.10 //客户端被动等待指定服务器来查询数据

ServerActive=200.0.0.10 //客户端主动提交数据到指定的服务器

Hostname=Zabbix server //主机名称

[root@zabbix ~]# systemctl start zabbix-server

[root@zabbix ~]# systemctl enable zabbix-server

Created symlink from /etc/systemd/system/multi-user.target.wants/zabbix-server.service to /usr/lib/systemd/system/zabbix-server.service.

[root@zabbix ~]# systemctl start zabbix-agent

[root@zabbix ~]# systemctl enable zabbix-agent

Created symlink from /etc/systemd/system/multi-user.target.wants/zabbix-agent.service to /usr/lib/systemd/system/zabbix-agent.service.

[root@zabbix ~]# systemctl start httpd

[root@zabbix ~]# systemctl enable httpd

Created symlink from /etc/systemd/system/multi-user.target.wants/httpd.service to /usr/lib/systemd/system/httpd.service.

[root@zabbix ~]# vim /etc/httpd/conf.d/zabbix.conf

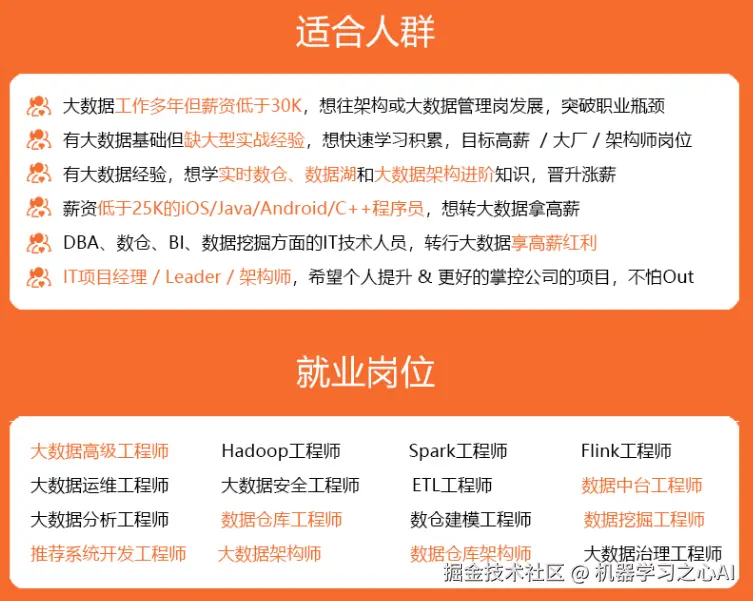

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

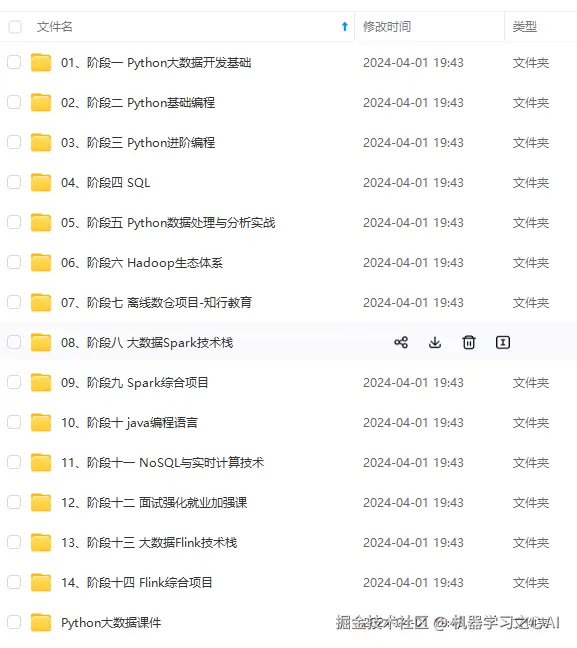

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://gitee.com/vip204888)**