系列前言:本系列笔记内容主要来自于shuhuai008大佬的白板推导系列课程, 参考了酷酷的群大佬的机器学习推导系列笔记(已取得许可), 其制作目的是制作一份自己的笔记方便以后巩固知识点,那现在就开始吧!

本系列课程可能需要具备以下前置知识:

白板学前补习班概率:概率论与数理统计知识详解【小元老师】【考研数学】_哔哩哔哩_bilibili

白板学前补习班代数一:-UP主汉语配音-【线性代数的本质】合集-转载于3Blue1Brown官方双语】_哔哩哔哩_bilibili

白板学前补习班代数二:线性代数基础课程【小元老师】【超级0基础入门】【考研数学】_哔哩哔哩_bilibili

如果上述知识都学过,我觉得可以直接开始入坑该系列了!

频率派

统计机器学习

统计学习方法:

感 K 朴 决 逻 支 提 E 隐 条

感:感知机

K:K近邻

朴:朴素贝叶斯

决:决策树

逻:逻辑回归[最大熵原理]

支:支持向量机

提:提升树

E:EM算法

隐:隐马尔科夫模型

条:条件随机场

贝叶斯派

概率图模型

PRML:

回 分 神 核 稀 图 混 近 采 连 顺 组

回:线性模型的回归算法

分:线性模型的分类算法

神:神经网络

核:核方法

稀:稀疏核机

图:概率图模型

混:混合模型

近:近似算法

采:采样

连:连续型随机变量

顺:顺序数据

组:组合模型[boost、bagging、随机森林..]

其他资料

书籍:

周志华-西瓜书、MLAPP:百科全书

ESL:侧重统计机器模型

Deep Learning:侧重深度学习

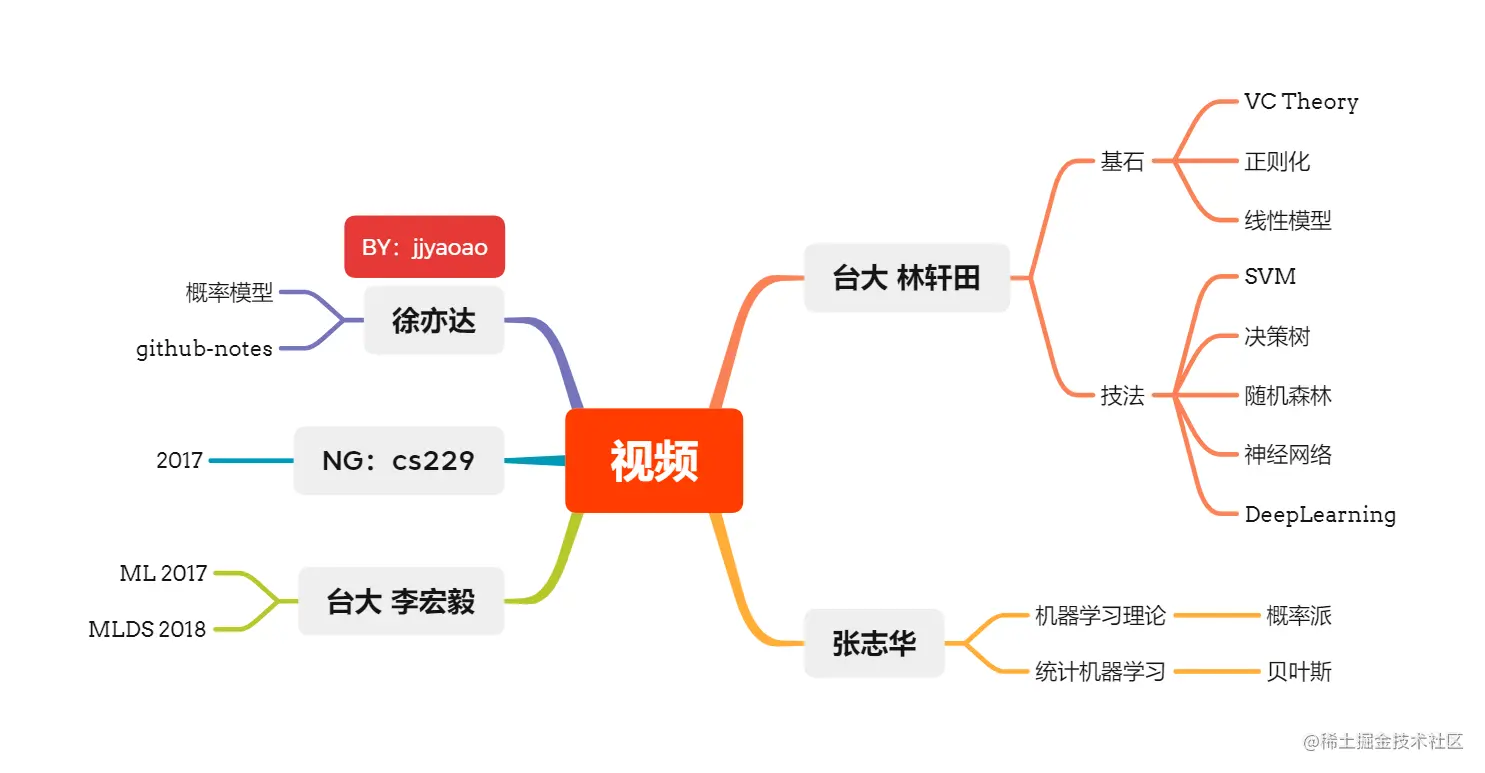

视频:

Introduction

对概率的诠释有两大学派,一种是频率派,另一种是贝叶斯派。后面我们对观测集采用下面记号:

XN×p=(x1,x2,⋯,xN)T,xi=(xi1,xi2,⋯,xip)T

这个记号表示有 N 个样本,每个样本都是 p 维向量。其中每个观测都是由 p(x∣θ) 生成的。

频率派的观点

p(x∣θ)中的 θ 是一个未知的常量(constant)。对于 N 个观测来说观测集的概率为 p(X∣θ)iid=i=1∏Np(xi∣θ)) 。为了求 θ 的大小,我们采用最大对数似然MLE的方法:

加 log 是为了将概率p的累乘(每一个i样本有p个维度的向量)变成累加

logp(xi∣θ)可以简写为L(θ)

θMLE=θargmaxlogp(X∣θ)iid=θargmaxi=1∑Nlogp(xi∣θ)

频率派的求解步骤为:

-

建立模型;

-

定义损失函数;

-

最优化损失函数。

贝叶斯派的观点

贝叶斯派认为 p(x∣θ) 中的 θ 不是一个常量。这个 θ 满足一个预设的先验的分布 θ∼p(θ),是随机变量(random variable)。于是根据贝叶斯定理依赖观测集参数的后验可以写成:

p(θ∣X)=p(X)p(X∣θ)⋅p(θ)=θ∫p(X∣θ)⋅p(θ)dθp(X∣θ)⋅p(θ)

为了求 θ 的值,我们要最大化这个参数后验MAP:

θMAP=θargmaxp(θ∣X)=θargmaxp(X∣θ)⋅p(θ)

其中第二个等号是由于分母和 θ 没有关系。求解这个 θ 值后计算θ∫p(X∣θ)⋅p(θ)dθp(X∣θ)⋅p(θ) ,就得到了参数的后验概率。其中 p(X∣θ) 叫似然(likelihood),是我们的模型分布。得到了参数的后验分布后,我们可以将这个分布用于预测贝叶斯预测:

p(xnew∣X)=θ∫p(xnew∣θ)⋅p(θ∣X)dθ

其中积分中的被乘数是模型,乘数是后验分布。(在前面的因数是被乘数,写在后面的因数是乘数, 乘数是数学术语,指四则运算的乘法中乘以其他数字的数字)

小结

频率派和贝叶斯派分别给出了一系列的机器学习算法。频率派的观点导出了一系列的统计机器学习算法,而贝叶斯派导出了概率图理论。在应用频率派的 MLE 方法时最优化理论占有重要地位。而贝叶斯派的算法无论是后验概率的建模还是应用这个后验进行推断时积分占有重要地位。 因此采样积分方法如 MCMC 有很多应用。