Swin Transformer 一种旨在设计通用的backbone,却在应用了屡屡刷屏

自从2017年Google Brain 提出了 Transformer之后,便掀起了一股研究transformer的热潮,随着BERT在NLP领域的频繁刷屏,Transformer也开始在CV领域大展身手,从ViTa到DETR,卷积和Transformer之间的结合应用变得越来越紧密。有关以Transformer为backbone的研究也在如火如潮的进行当中。

Swin Transformer提出了Transformer应用在CV领域中的最需要克服的两点区别:

- 1: scale,图像中的内容不像NLP中是一个一个的词向量,里面的内容是有不同的大小的。目前大部分的序列转换都是以某个特定大小的图像块或者图像特征块作为一个序列的基本单元,这容易导致Transformer不能够很好的适应各种大小不一的物体。

- 2 higher resolution 和计算成本的扩张一个256*256的照片维度就高达65536维度,Transformer的原版处理的序列也就是几百几千维,即使通过卷积的方式进行了降维,由于Transformer的二次方计算复杂度那也是一个特别需要时间和内存的任务。

Swin Transformer用下列的方式解决了上述的问题:

下面我会用程序运行流程中各种输入维度和操作的详细信息来讲解Transformer的执行过程和各种维度变化

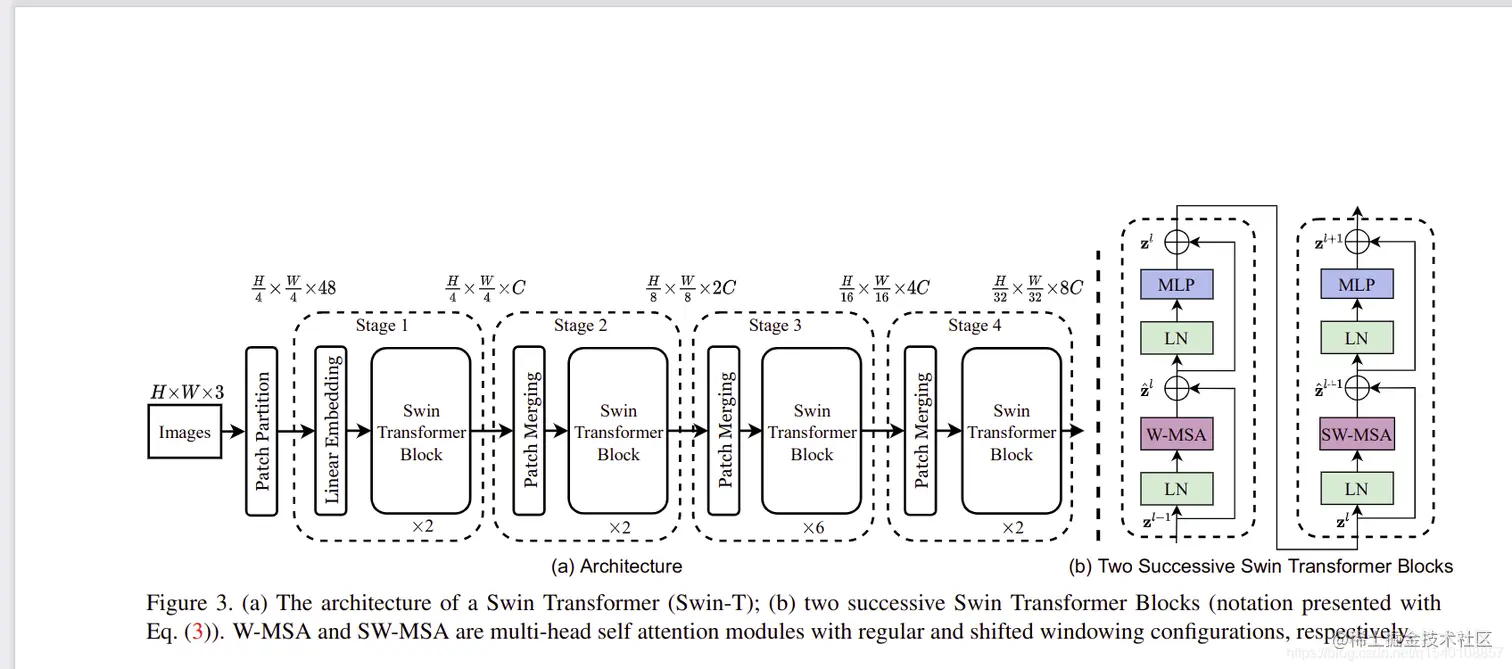

SwinTransformer整体的框架:

in:(B,C,H,W)out:(B,embed_dim∗2stage−1)

- 1.首先输入一个批量的图片数据:(B,C,H,W)

- 2.进行块嵌入维度变为(B,p_s2HW,embed_dim)其中p_s表示块大小,块是这个图像处理中的最小单位

- 3.进行ape(绝对位置嵌入)+Dropout

- 4.进行basic_layer的循环也就是上图中的四个stage阶段,注意每一个stage的输入为(B,p_s2HW,embed_dim)输出为(B,p_s2HW/4,embed_dim∗2),这里为了统一处理,假设每一个stage的输入都是(B,L,C)

- 5.(B,L,C)−>(B,C,L)−>AdaptivePool1d(B,C,1)−>(B,C)主要是通过池化消除掉了L维度,形成最终的C个特征,这C个特征就是最终提出出来的特征。C=embed_dim∗2stage−1

Basic_Layer(也就是图中的state的框架):

in:(B,L,C)out:(B,L/4,2C)

- 循环depth次SwinTransformerBlock,这个过程保持维度

- 进行一次patch_merging(即down_sample) 。(−>(B,L/4,2∗C)

SwinTransformerBlock:

in:(B,L,C)out:(B,L,C)每一个Block包括两个连续的Block,一个带SW,一个不带

-

- 第一个带滑动窗口的SwinTransformerBlock,包含超参数窗口尺寸window_size=7

- 记录点:out1=x

- (B,L,C)−>norm−>(B,H,W,C)

- 进行斜上方循环Roll(shiftsize)操作,其中shift、size=win_size//2

- window_partition操作−>(w_s2BHW,w_s,w_s,C)−>(B∗nW,w_s2,C)

- 进行一次WindowAttention操作

- (−>B,H,W,C)−>反向Roll(shiftsize)

- 记录点:out2=x=x+out1

- −>LayerNorm(out2)−>MLP

- out=x+out2

-

- 第二个不带滑动窗口的SwinTransformerBlock

- 待续

WindowAttention:

in:(B∗nW,w_s2,C)out:(B∗nW,w_s2,C)

- −>QKV操作Linear(B∗nW,w_s2,3C)−>(3,B∗nW,nh,w_s2,C/n_h)

- Q,K,V瓜分第一个维度即dimQ=dimK=dimV:(B∗nW,n_h,w_s2,C/n_h)

- Q**scale*,scale是一个放缩系数

- atten=Q@Katten:(B∗nW,n_h,w_s2,w_h2

- atten=atten+mask+rps(relativepositionbias)

- x=softmax(atten,−1)@Vx:(B∗nW,nh,w_2,C/n_h)

- −>(B∗nW,w_s2,C)

- drop(project(x))维度不变

PatchEmbedding:

in:标准图像输入(B,C,H,W)out:(B,HW/p_s2,embed_dim)=(B,nP,embed_dim)

- 首先−>Conv2d(C,embeddim,k=patch_size,stride=patchsize):(B,embeddim,H/p_s,w/p_s)

- −>(B,HW/p_s2,embed_dim)−>Drouout:(B,n_P,embed_dim)

window_partion

in:(B,H,W,C)out:(BHW/w_s2,ws,ws,C)=(B∗nW,w_s2,w_s2,C)

aps (absolute position embedding)

用来和PatchEmbedding相加,P_E后的维度为(B,n_P,C),aps的维度为(1,n_P,C)是一个可学习的Param

relative_pos_bias

用来和注意力矩阵相加,注意力矩阵的维度是(nW∗B,n_h,w_s2,w_s2),rpb的维度是(n_head,w_s2,w_s2)。

- 作者注册了一个维度为((2∗wH−1)(2∗wW−1),n_heads)的可学习张量rpb,还注册了一个buff:rpi(relative_pos_index)(Wh∗Ww,Wh∗Ww)并且这个buff张量中的数字大小都在0−(2∗wH−1)(2∗wW−1)之间,然后调用的时候rpb[rpi.flatten(),:]−>(n_head,w_s2,w_s2)

mask

作者通过使用滑动窗口来实现了全局注意力,但是之前不是一个window中的后来和其它窗口混在一起,相互直接就别算注意力了,那么就应该注意力矩阵中把这些窗口中之前不在一个窗口的patch相互注意力填充的很小。

一般的对于注意力的计算流程

首先说明一下自注意力对于向量来说,这里计为(N,C)其输出应该是和输入是一样的。

- 首先需要计算一个q,k,v*,假设对于每一个向量的q,k,v维度都是d**,因此需要进行一次线性变换让(N,C)* (C,3d) ->3 个(N,d)。

- 然后得到了q:(N,d)和k(N,d),v(N,d)对一个需要qi需要和所有的kj做点积得到关于因此一共有N*N的式子:oi,j=∑kqi,k∗kj,k用 爱因斯坦表法就是

einsum("i k , j k -> i j",q,k)

- 刚刚得到的注意力矩阵**attn:(N,Ni)*表示了第i个向量关于所有的向量的注意力大小,可式子oi=∑kvk∗attni,k.第二个位置不变即oi,j=∑kvk,j∗attni,k,即einsum(k j , i k -> i,j)