docker的资源控制和数据管理

Docker资源管理

一.CPU资源控制

1.1 cgroups概述

cgroups,是一个非常强大的linux内核工具,他不仅可以限制被 namespace 隔离起来的资源,还可以为资源设置权重、计算使用量、操控进程启停等等。所以 cgroups(Control groups)实现了对资源的配额和度量。

cgroups有四大功能:

- 资源限制:可以对任务使用的资源总额进行限制

- 优先级分配:通过分配的cpu时间时数量以及磁盘IO带宽大小,实际上相当于控制了任务运行优先级

- 资源统计:可以统计系统的资源使用量,如cpu时长,内存用量等

- 任务控制:cgroup可以对任务执行挂起、恢复等操作

1.2 设置cpu的使用率上限(重点)

- Linux通过CFS(Completely Fair Scheduler,完全公平调度器) 来调度各个进程对CPU的使用。CFS默认的调度周期是100ms。

- 我们可以设置每个容器进程的调度周期,以及在这个周期内各个容器最多能使用多少CPU时间。

- 使用**--cpu-period**即可设置调度周期,使用--cpu-quota即可设置在每个周期内容器能使用的cpu时间。两者可以配合使用。

- CFS周期的有效范围是1ms

1s,对应的--cpu-period的数值范围是10001000000(--cpu-period的 单位为:微秒)。 - 而容器的CPU配额必须不小于1ms,即--cpu-quota的值必须>=1000。

##(1)运行一个容器

[root@localhost ~]# docker run -itd --name c1 centos:7 /bin/bash

[root@localhost ~]# docker ps -a

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

18f71b9394b5 centos:7 "/bin/bash" 14 seconds ago Up 14 seconds

-------------------------------------------------------------------------------------------------------------------

##(2)查看容器默认cpu使用率(主要要知道路径,方便以后查看),默认的容器cpu是没有限额的

1. cd /sys/fs/cgroup/cpu/docker/

#cpu使用率的两个文件--cpu-quota和--cpu-period都此文件夹内

2. cd 18f71b9394b508d5ac3499a01f31bed96a33a94e09a112935f9f5af1cc39a98c/

#进入容器id号文件夹

3. cat cpu.cfs_quota_us

-1

#cpu.cfs_ _quota_ us:表示该cgroups限制占用的时间(微秒),默认为-1,表示不限制。如果 设为50000,表示5占用0000100000-508的CPU。

4. cat cpu.cfs_period_us

100000

#cpu.cfs_period_us:表示该cpu分配的周期(微秒,所以文件中用us表示),默认为100000

-------------------------------------------------------------------------------------------------------------------

##(3)进行cpu压力测试

[root@localhost ~]# docker ps -a

[root@localhost ~]# docker exec -it c1 bash

[root@18f71b9394b5 /]# vi /cpu.sh

#脚本内容:

#!/bin/bash

i=0

while true

do

let i++

done

#切换设备,用top命令查看容器cpu使用率

chmod +x /cpu.sh

./ cpu.sh

-------------------------------------------------------------------------------------------------------------------

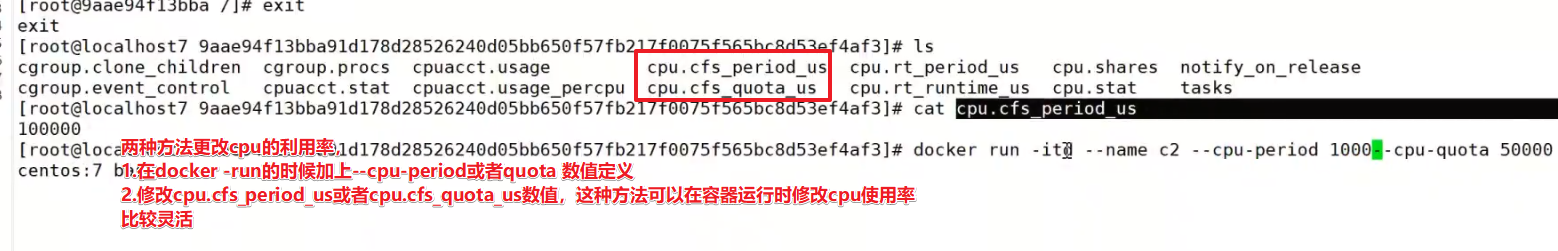

## (4) 修改cpu使用率

[root@localhost ~]# docker run -itd --name c2 --cpu-quota 50000 centos:7

[root@localhost ~]# docker ps -a

[root@localhost ~]# cd /sys/fs/cgroup/cpu/docker/db7d3daa7617bd7b8d13aebf61dd8fec32f8b2738a69f845828cf657fc2490d4/

[root@localhost db7d3daa7617bd7b8d13aebf61dd8fec32f8b2738a69f845828cf657fc2490d4]# ls

cgroup.clone_children cpuacct.usage cpu.rt_period_us notify_on_release

cgroup.event_control cpuacct.usage_percpu cpu.rt_runtime_us tasks

cgroup.procs cpu.cfs_period_us cpu.shares

cpuacct.stat cpu.cfs_quota_us cpu.stat

1.运行一个新的容器

2.查看容器默认cpu使用率

3.进行cpu压力测试

两种方法更改cpu的利用率:

1.在docker -run的时候加上--cpu-period或者quota 数值定义

2.修改cpu.cfs_period_us或者cpu.cfs_quota_us数值,这种方法可以在容器运行时修改cpu使用率比较灵活

1.3 设置cpu资源占用比(--cpu shares)

设置多个容器时才有效

1.3.1 启动时定义两个容器的cpu资源占用比

主机名:192.168.10.10

#(1)启动容器时定义两台主机的资源占用比

docker run -itd --name c1 --cpu shares 1024 centos:7(主机1设置)

docker run -itd --name c2 --cpu shares 2048 centos:7(主机2设置)

#(2)使用stress在两个容器上进行压测

c1容器

docker ps -a #查看容器运行状态

docker exec -it c1 bash #进入容器操作

yum install -y epel-release #安装epel在线源

yum install -y stress #安装压测工具

stress -c 4 #4核压测,服务器有几核开几核

--------------------------------------------------------------------

c2容器

docker ps -a #查看容器运行状态

docker exec -it c2 bash #进入容器操作

yum intall -y epel-release #安装epel在线源

yum install -y stress #安装压测工具

stress -c 4 #4核压测,服务器有几核开几核

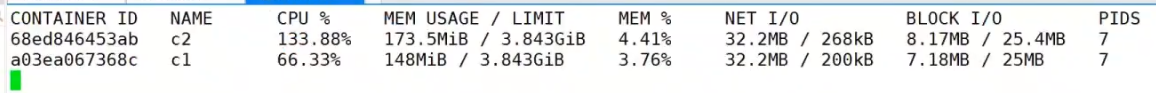

#使用top查看只能查看到那个程序在运行,资源占比是多少,这里我们使用docker stats

docker stats #查看容器使用资源

cd /sys/fd/cgroup/cpu/docker/

cat cpu.shares

2048 #这里反馈2048,就是我们前面设置的cpu运行占有比的份额

1.4 设置容器绑定指定的cpu(--cpuset-cpus)

#本次实例已经设置虚拟机为4核cpu,--cpuset-cpus的cpu核数为0、1、2、3

docker run -itd --name c3 --cpuset-cpus 1,3 centos:7 bash

docker ps -a #查看是否容器是否成功运行

docker exec -it c3 bash #进入容器

yum install -y epel-release #yum安装epel源

yum install -y stress #安装stress压测软件

stress -c 4 #测试cpu

#开启另一个终端

top #这时候可以看到时1号cpu和3号cpu在使用

总结:

总结:

docker run --cpu-period #表示的是设置CPU调度周期周期,默认值是100-100000,单位是us,即0.1s

•--cpu-quota #设置容器可以使用的最大的CPU时间,配合--cpu-period值使用。如果—cpu-quota=200000,即0.2s。那就是说在0.1s周期内改容器可以使用0.2s的CPU时间,显然1个CPU是无法满足要求的,需要至少2个CPU才能满足。要与调度周期时间成比例。

•--cpu-shares #容器使用CPU的权重,默认值是1024,数值越大权重越大。该参数仅当有多个容器竞争同一个CPU时生效。对于单核CPU,如果容器A设置为--cpu-shares=2048,容器B设置为--cpus-shres=1024,仅当两个容器需要使用的CPU时间超过整个CPU周期的时候,容器A会被分配66%的CPU时间,容器B被分配33%的CPU时间,大约是2:1;对于多核CPU,仅当多个容器竞争同一个CPU的时候该值生效

--cpuset-cpus #绑核 (第一个cpu从0开始)

二.对内存使用的限制

-m (--memory=) 选项用于限制容器可以使用的最大内存

--memory-swap 和 --memory 一起使用可以限制swap 的大小。

正常情况下,--memory-swap 的值包含容器的可用内存和可用swap。

所以,-m 300m --memory-swap=1g 的含义为: 容器可以使用300M的物理内存,并且可以使用 700M(1G-300M)的swap

- 如果 --memory-swap 设置为0或者 不设置,则容器可以使用swap 大小为 -m 值的两倍

- 如果 --memory-swap 的值和 -m 值相同,则容器不能使用 swap

- 如果 --memory-swap 的值为 -1 ,它表示容器程序使用的内存受限,而可以使用的swap空间不受限制(宿主机有多少swap,容器就可以使用多少)

MIB 2为的底数

MB 10为底数的值

1KiB = 2^10 1024 1MiB = 2^20 1048576 1024Ki 1GiB = 1,073,741,824

1KB = 10^3 1000 1MB=10^6 1000000 1GB=10^9 1TB

TiB 2^40 - 10^12

三.对磁盘IO的限制

#(1)

--device-read-bps: 限制某个设备上的读速度 bps(数据量),单位可以是kb,mb(M)或者gb。

例: docker run -itd --name test --device-read-bps /dev/sda:1M centos:7 /bin/bash

#(2)

--device-write-bps: 限制某个设备上的写速度(数据量),单位可以是kb,mb(M)或者gb。

例: docker run -itd --name test --device-write-bps /dev/sda:1M centos:7 /bin/bash

#(3)

--device-read-iops : 限制读某个设备的iops(次数)

#(4)

--device-write-iops: 限制写入某个设备iops(次数)

#(5)

#清理dockers占用的磁盘空间

docker system prune -a

实例:

#创建容器,并限制写速度

[root@host103 ~]# docker run -itd --name test4 --device-write-bps /dev/sda:1mb centos:7 bash

#通过dd来验证写速度,oflag=direct可以规避文件系统的地址,防止文件系统卸载缓存当中

[root@98dbd982b24c /]# dd if=/dev/zero of=/opt/test.out bs=10M count=10 oflag=direct

10+0 records in

10+0 records out

10485760 bytes (10 MB) copied, 10.0035 s, 1.0 MB/s

Docker数据卷管理

管理Docker 容器中数据主要有两种方式:数据卷(Data Volumes) 和数据卷容器(DataVolumes Containers) 。容器都是有生命周期的,如果要保证容器内的数据内容能够持久化,那么就需要做数据卷

2.1 创建数据卷与数据卷与宿主机的同步

数据卷是一个供容器使用的特殊目录,位于容器中,可将宿主机的目录挂载到数据卷上,对数据卷的修改操作立即可见 ,并且更新数据不会影响镜像,从而实现数据在宿主机与容器之间的迁移。数据卷使用类似于Linux下对目录进行的mount操作。

2.1.1 命令格式

#创建数据卷

docker run -v 数据卷名称

#创建数据卷并挂在到宿主机目录

docker run -v 宿主机目录:数据卷目录

2.1.2 实例

(1)创建数据卷

#当前宿主机没有/var/www目录

[root@localhost ~]# ls /var/www

ls: 无法访问/var/www: 没有那个文件或目录

#宿主机目录/var/www 挂载到容器中/data1.

#注意:宿主机本地目录的路径必须是使用绝对路径。如果路径不存在,Docker 会自动创建相应的路径.

#-v 选项可以在容器内创建数据卷

[root@localhost ~]# docker run -v /var/www:/data1 --name c3 -itd centos:7 bash

b3b40d48802b9cefe23868b52f081c25ab56eeee0290fd4a647f99edfcef059d

#目录已经创建成功

[root@localhost ~]# ls /var/www -d

/var/www

#进入容器c3,查看容器内容,已经新增了一个data1目录,说明数据卷创建成功

[root@localhost ~]# docker exec -it c3 bash

[root@b3b40d48802b /]# ls

anaconda-post.log data1 etc lib media opt root sbin sys usr

bin dev home lib64 mnt proc run srv tmp var

(2)验证数据卷与宿主机的同步性

#宿主机复制文件到同步文件夹/var/www

[root@localhost ~]# cp /etc/passwd /etc/shadow /opt

[root@localhost opt]# mv passwd shadow /var/www/

#进入容器c3查看文件是否同步成功

[root@localhost ~]# docker exec -it c3 bash

[root@b3b40d48802b /]# ll data1/

total 8

-rw-r--r-- 1 root root 2122 Jun 26 11:53 passwd

---------- 1 root root 1202 Jun 26 11:53 shadow

创建数据并挂在一个主机目录到数据卷中

验证数据卷与宿主机的同步性

2.2 数据卷容器-子容器继承父容器

如果需要在容器之间共享一些数据,最简单的方法就是使用数据卷容器。数据卷容器是一个普通的容器,专门提供数据卷给其他容器挂载使用

2.2.1 命令格式

docker run -v --volumes-from 数据卷容器

2.2.2 实例

#在一个容器c3上创建两个数据卷

[root@localhost ~]# docker run --name c4 -v /data1 -v /data2 -itd centos:7 bash

6cda24d983a5934e1395eae025e0286020212e467ebe054c5055fa648a1a113b

#在data1和data2上各创建一个txt文件

[root@6cda24d983a5 /]# echo "this is data1" > /data1/abc.txt

[root@6cda24d983a5 /]# echo "this is data2" > /data2/123.txt

[root@6cda24d983a5 /]# exit

exit

#使用 --volumes-from 挂载 c4 容器中的数据卷到新容器c5中

[root@localhost ~]# docker run -itd --name c5 --volumes-from c4 centos:7 bash

c40c7bf75b9f206c68b03f6929af1b91e530fbb09018cc39d1c822ca355cc612

[root@c40c7bf75b9f /]# cat data1/abc.txt

this is data1

[root@c40c7bf75b9f /]# cat data2/123.txt

this is data2

2.3 容器互联

容器互联是通过容器的名称在容器间建立一条专门的网络通信隧道。简单点说,就是会在源容器和接收器之间建立一条隧道,接收容器可以看到源容器指定的信息

2.3.1 命令格式

docker run -v --link 原容器名:容器别名

#别名可以自定义,建议和容器名一样

ping 容器名或容器id

#在第一次ping过后,会显示连接容器ip地址

2.3.2 实例

#创建或用已经创建好的容器,这里使用已经创建好的容器c5

[root@localhost ~]# docker ps -a

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

c40c7bf75b9f centos:7 "bash" 56 minutes ago Up 56 minutes c5

#创建并运行容器,取名为c6. --link 容器名:连接的别名

[root@localhost ~]# docker run -itd --name c6 --link c5:c5 centos:7 bash

ca635030890a9dbd1f559dd2eb6046f321f829fbcb45f84e68cda8c56f2b9261

#exec进入容器c6,连接容器容器c5(ping)

[root@ca635030890a /]# ping c5

PING c5 (172.17.0.6) 56(84) bytes of data.

64 bytes from c5 (172.17.0.6): icmp_seq=1 ttl=64 time=0.155 ms

64 bytes from c5 (172.17.0.6): icmp_seq=2 ttl=64 time=0.050 ms

64 bytes from c5 (172.17.0.6): icmp_seq=3 ttl=64 time=0.050 ms

^C

##这时c5的ip地址显示了

\