鸣叫 分享 分享

在文献中,_Jacobian_这个词经常被交替使用,指的是Jacobian矩阵或其行列式。

矩阵和行列式都有有用的重要应用:在机器学习中,雅各布矩阵聚合了反向传播所需的偏导数;行列式在变量之间的变化过程中很有用。

在本教程中,你将回顾一下对雅各布矩阵的温和介绍。

完成本教程后,你将知道。

- 雅各布矩阵收集了可用于反向传播的多变量函数的所有一阶偏导数。

- 雅各布行列式在变量之间的变化中很有用,它在一个坐标空间和另一个坐标空间之间充当缩放因子。

让我们开始吧。

雅各布系数的温和介绍

照片由西蒙-伯杰拍摄,保留部分权利。

教程概述

本教程分为三个部分;它们是:。

- 机器学习中的部分导数

- 雅各布矩阵

- 雅各布矩阵的其他用途

机器学习中的部分导数

到目前为止,我们已经提到梯度和偏导对于优化算法的重要性,例如,更新神经网络的模型权重以达到最佳权重集。使用偏导允许每个权重独立于其他权重进行更新,方法是依次计算与每个权重有关的误差曲线的梯度。

我们在机器学习中通常使用的许多函数都是多变量、向量值函数,这意味着它们将多个真实的输入(n) 到多个真实输出(m)。

例如,考虑一个将灰度图像划分为若干类的神经网络。这种分类器实现的函数将把每个单通道输入图像的_n个_像素值映射到属于每个不同类别的_m_个输出概率上。

在训练神经网络时,反向传播算法负责在输出层计算的误差,在构成神经网络不同隐藏层的神经元之间进行分享,直到它到达输入。

逆向传播算法在调整网络中权重的基本原则是,网络中的每个权重都应该按照网络整体误差对该权重变化的敏感度进行更新。

- 第222页,深度学习,2019年。

网络的整体误差对任何一个特定权重的变化的这种敏感性是以变化率来衡量的,而变化率又是通过对同一权重的误差的偏导来计算。

为了简单起见,假设某个特定网络的一个隐藏层只由一个神经元_k_组成,我们可以用一个简单的计算图来表示。

一个具有单一输入和单一输出的神经元

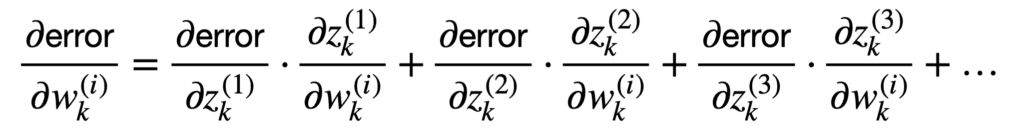

同样,为了简单起见,我们假设一个权重,w__k_被应用于这个神经元的输入,以产生一个输出,z__k,根据该神经元实现的功能(包括非线性)。然后,这个神经元的权重可以与网络输出端的误差联系起来,如下所示(以下公式在形式上被称为_微积分的连锁规则,但在后面的单独教程中会有更多内容)。

这里,导数_dz__k_/_dw__k_首先连接权重_w__k_到输出,z__k,而导数,derror /dz__k,随后将输出,_z__k_到网络误差。

更常见的情况是,我们会有许多连接的神经元组成网络,每个神经元都被赋予不同的权重。由于我们对这种情况更感兴趣,那么我们可以超越标量的情况,考虑多输入和多输出。

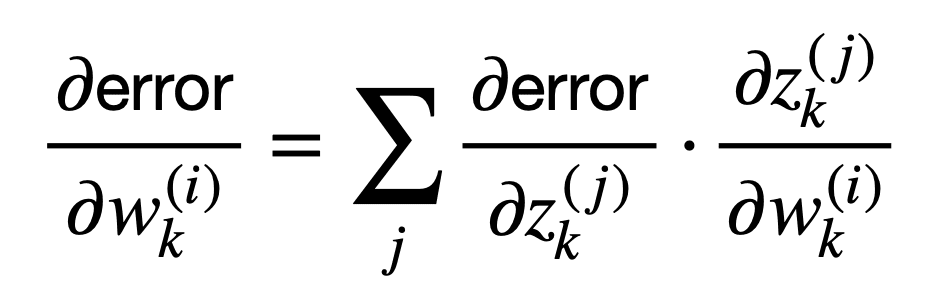

这个项的总和可以更紧凑地表示如下。

或者说,在矢量符号中,使用德尔运算符∇来表示误差的梯度,相对于权重,w_k_或输出,zk:

反传播算法包括对图中的每个操作进行这样的雅各布梯度乘积。

- 第207页,深度学习,2017。

这意味着反向传播算法可以通过与_雅各布矩阵_相乘,将网络错误的敏感性与权重的变化联系起来,(∂zk/ ∂wk)T.

因此,这个雅各布矩阵包含什么?

雅各布矩阵

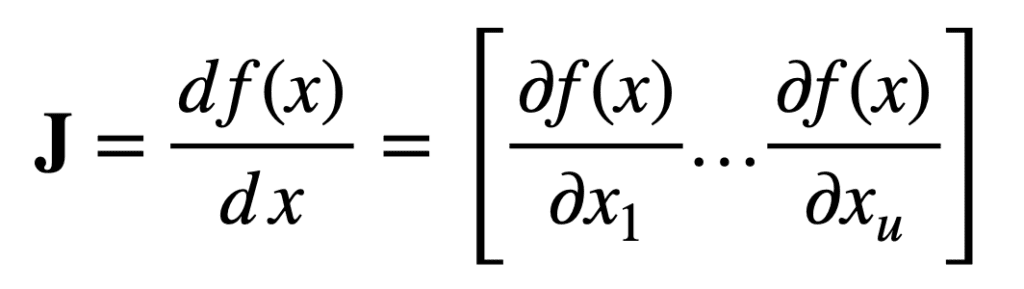

雅各布矩阵收集了一个多变量函数的所有一阶偏导数。

具体来说,首先考虑一个将_u个_真实输入映射到一个真实输出的函数。

然后,对于一个长度为_u_的输入向量x,大小为_u_×1的雅各布向量可以定义如下。

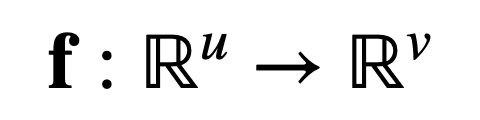

现在,考虑另一个将_u_实数输入映射到_v_实数输出的函数。

然后,对于相同的输入矢量x,长度为_u_,雅各布系数现在是一个_u_×_v_矩阵,J∈ℝ。u×__v,其定义如下。

在保留相同数量的_u_实数输入和_v_实数输出的情况下,将雅各布矩阵重构为前面考虑的机器学习问题,我们发现这个矩阵将包含以下偏导数。

雅各布矩阵的其他用途

在处理积分时,一个重要的技术涉及到_变量的改变_(也被称为_替代积分_ 或_u-替代_),即一个积分被简化为另一个更容易计算的积分。

在单变量的情况下,用另一个变量_u_代替某个变量_x_,可以将原函数转化为一个更简单的函数,从而更容易找到反导数。在双变量的情况下,还有一个原因是我们也希望把我们要积分的项的区域变成不同的形状。

在单变量的情况下,通常只有一个原因要改变变量:使函数 "更漂亮",以便我们能找到反导数。在双变量的情况下,还有一个潜在的原因:我们需要积分的二维区域在某种程度上是不愉快的,我们希望u和v的区域更漂亮,比如说,是一个矩形。

- 第412页,单变量和多变量微积分,2020。

当在两个(或可能更多)变量之间进行置换时,这个过程首先要对置换的变量进行定义。例如,x=f_(u_,v)和_y_=g_(u_,v)。然后,根据函数_f_和_g_如何将_u_-v平面转化为x_-y_平面,进行积分极限的转换。最后,计算并包括_雅各布行列式_的绝对值,以作为一个坐标空间和另一个坐标空间之间的缩放系数。

进一步阅读

如果你想深入了解,本节提供了更多关于该主题的资源。

书籍

- 深度学习》,2017。

- 机器学习的数学》,2020年。

- 单变量和多变量微积分, 2020.

- 深度学习, 2019.

文章

总结

在本教程中,你发现了一个关于雅各布式的温和介绍。

具体来说,你学到了。

- 雅各布矩阵收集了可用于反向传播的多变量函数的所有一阶偏导数。

- 雅各布行列式在变量之间的变化中很有用,它在一个坐标空间和另一个坐标空间之间充当缩放因子。

你有什么问题吗?

在下面的评论中提出你的问题,我将尽我所能回答。

鸣叫 分享 分享

The postA Gentle Introduction to the Jacobianappeared first onMachine Learning Mastery.