最小二乘法在回归问题中的应用

线性回归基础知识

假设我们有样本D={(x1,y1),(x2,y2),.....(xn,yn)},其中 xi 是 n 维向量,也就是第i个样本的n个特征,而 yi 就是第 i 个样本的取值。我们需要根据已知的 D 来构建模型,之后当我们有新的 xn 输入时,根据模型就可以得出 yn 的预测值。

我们将信息表示的更完整一些:

xi=⎣⎡xi0xi1⋮xin⎦⎤ 某一个样本的 n 个特征,

我们把 p 个样本的集合写作: X=[x1x2x3⋯xp]T=⎣⎡x11x21⋮xp1x12x22xp2x13x23xp3⋯⋯⋯x1nx2nxpn⎦⎤

我们的目标就是找到一组参数 w=⎣⎡w1w2w3⋮wn⎦⎤和一个偏置 b (数)

可以得:⎣⎡x11∗w1x21∗w1⋮xp1∗w1x12∗w2x22∗w2xp2∗w2x13∗w3x23∗w3xp3∗w3⋯⋯⋯x1n∗wnx2n∗wnxpn∗wn⎦⎤+b=⎣⎡y1−y2−y3−⋮yn−⎦⎤

w参数的计算--最小二乘法

最小二乘规定损失函数L(w)=i=1∑n∣wTxi−yi∣2,我们的目标就是找到 w 使得 L(w) 最小。

那为什么是最小二乘法,而不是三乘法,四乘法呢?

具体的我们可以从几何和概率两个角度来解释。

几何角度

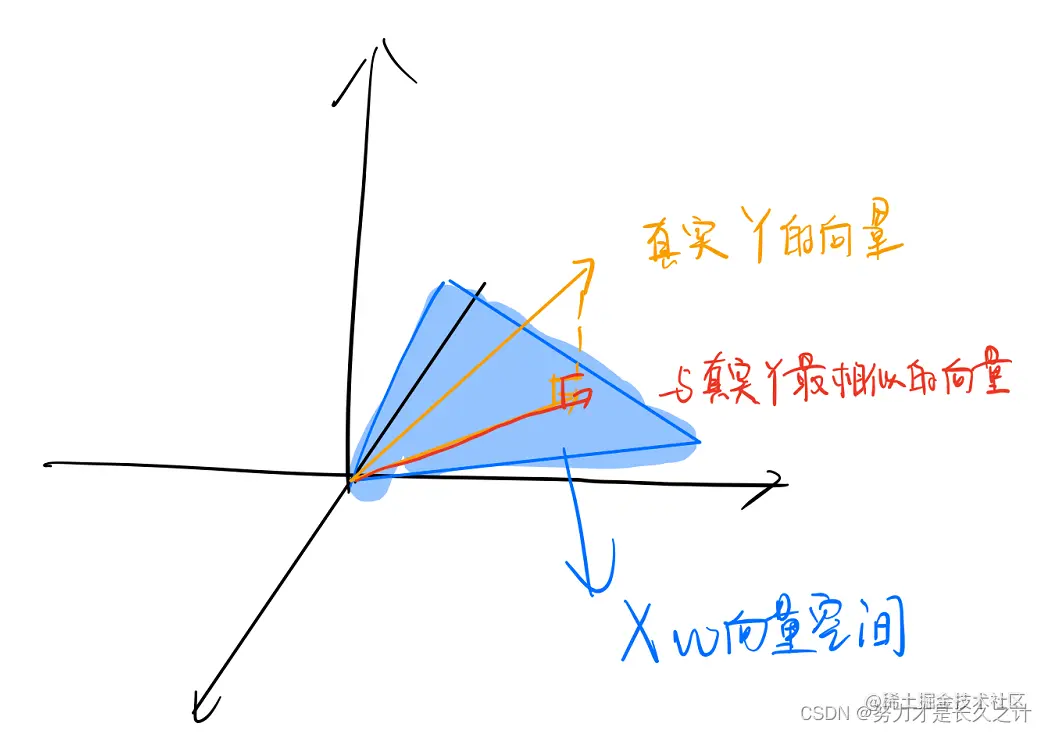

我们来看 Xw,是一个向量空间,真实的 Y 向量不在蓝色的向量空间内,我们需要在蓝色的向量空间内找到一个与 Y 最相似的向量,而这个向量的 w 就是我们要求的参数。

两个向量的欧式距离越近,说明两个向量越相似,而欧式距离的公式为:i=1∑n∣wTxi−yi∣2 ,为了简化计算,我们算最小距离就是最小平方。

概率角度

我们知道 ϵ=yi−yi− ,误差 ϵ 是符合高斯分布的,我们从中心极限定理可知。

∵ϵ∼N(0,σ2),ϵ=yi−yi−

∴yi∼N(y^i,σ2)

∴yi∼N(wTxi,σ2)

我们利用极大似然估计求w

最后可得argmin∑i=1N(yi−wTxi)2

计算w

我们要计算argminL(w),对 w 求导即可,具体过程建议看b站的www.bilibili.com/video/BV1aE… 过程非常详细。

如有错误,欢迎指教~