本文已参与「新人创作礼」活动,一起开启掘金创作之路

随机变量的自信息

X、Y、Z:随机变量

x、y、z:随机变量的具体取值

x、y、z:集合

∣x∣、∣y∣、∣z∣:集合的势(集合中元素的个数)

PX(x)=P(X=x):随机变量的概率分布

PXY(x,y)=P(X=x,Y=y):联合概率(随机过程)

Xn=X1,X2...Xn:长度为n的随机变量序列

xn=x1,x2...xn:长度为n的数值序列

Xij=Xi,Xi+1...Xj:长度为(j−i+1)的随机变量序列

Xn=(X1,X2...Xn):维度为n的随机矢量

xn=(x1,x2...xn):维度为n的数值矢量

Xij=(Xi,Xi+1...Xj):维度为(j−i+1)的随机矢量

信息是对不确定性的消除

随机变量的自信息

四个基本问题:

- 随机性与概率的关系:概率越低,随机事件所提供的自信息越大;反之,随机事件所提供的自信息越小。

- 概率为1的事件的信息量:概率为1的事件为确定性事件,它所能够提供的信息量为0,因为没有任何的不确定性被消除。

- 概率为0的事件的信息量:随着概率变得越来越小,它所能够提供的信息量越来越大,概率为0的事件的信息量→∞。

- 两个独立事件的联合信息量:为它们各自自信息量的代数和。

↓

设a1,a2为两个随机事件,

(1)若P(a1)>P(a2),则f(a1)<f(a2)

(2)若P(a1)=1,则f(a1)=0

(3)若Pa=0,则f(a1)=∞

(4)如果a1,a2为独立事件,则f(a1,a2)=f(a1)+f(a2)

自信息

I(ai)=logP(ai)1

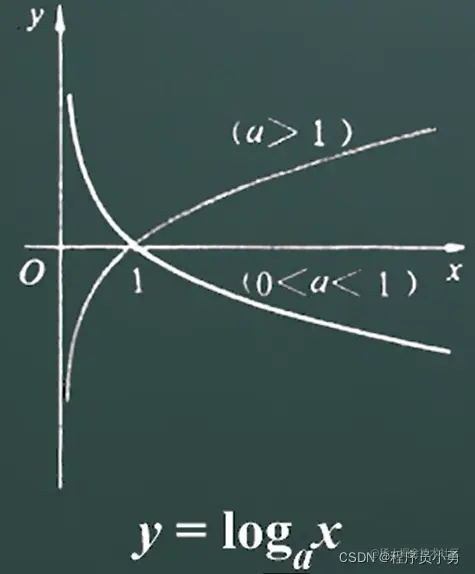

这是一个减函数,当P(ai)=0时,I(ai)=∞;当P(ai)=1时,I(ai)=0。

对数底与信息的单位

以2为底: bit (binary unit)

以e为底: nat (nature unit)

以10为底:Hart (Hartley)

换算关系:

1 nat =1.44bit

1 Hart=3.32bit

一般不加说明,取以2为底。