神经网络正向传播

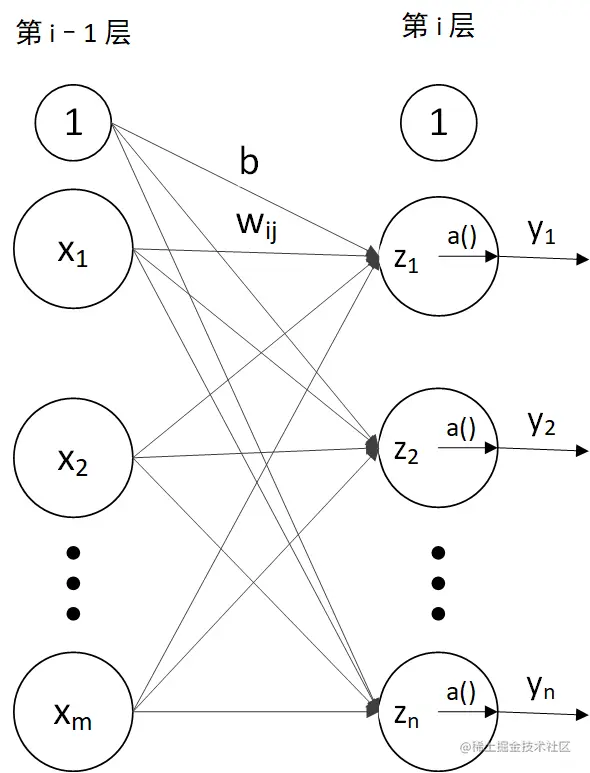

单层神经网络

结构图

公式

⎣⎡z1z2⋮zn⎦⎤=⎣⎡w11(i)w21(i)⋮wn1(i)w12(i)w22(i)⋮wn2(i)⋯⋯⋯w1m(i)w2m(i)⋮wnm(i)⎦⎤⎣⎡x1x2⋮xn⎦⎤+⎣⎡b1(i)b2(i)⋮bn(i)⎦⎤

z(i)=W(i)⋅x+b(i)

⎣⎡y1y2⋮yn⎦⎤=a⎝⎛⎣⎡z1z2⋮zn⎦⎤⎠⎞

y(i)=a(z(i))

术语

偏置 b

控制神经元被激活的容易程度

权重 wijl

- l 指第 l 层

- i 指第 l 层的第 i 个神经元

- j 指第 l−1 层的第 j 个神经元

z(i)

第 i 层的中间结果

y(i)

第 i 层的输出

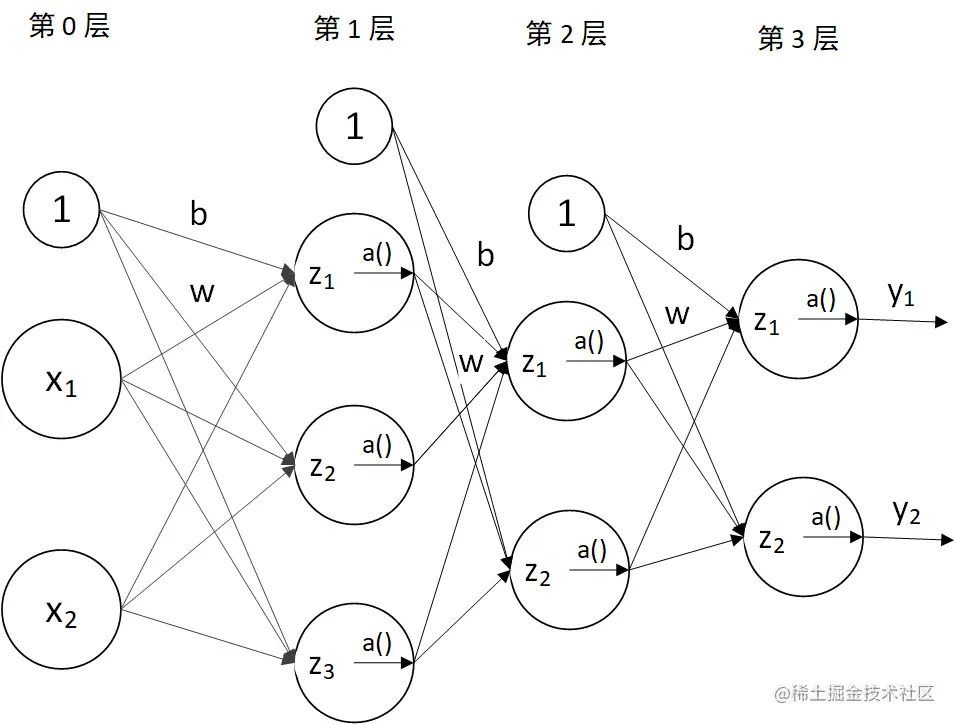

三层神经网络

结构图

术语

one-hot

正解为 1, 其余为 0

normalize

正规化, 标准化, 归一化

将数据弄到 0∼1 之间

批处理

一次处理一批数据, 矩阵计算

激活函数

sigmoid

f(x)=1+e−x1

阶跃函数

f(x)={10x>0x≤0

relu

f(x)={x0x>0x≤0

输出层的激活函数

恒等函数(回归)

softmax(分类)

f(x)=ex1+⋯+exnexi

处理数据溢出, 防止 exi 很大

f(x)=ex1−c+⋯+exn−cexi−cc=max{x1,⋯,xn}