论文链接

度量的定义及一些基本性质见链接

简介

许多学习和数据挖掘算法的性能都依赖于他们的输入是否有一个好的度量,例如K-means,近邻分类器和核算法(如SVM)都需要一个好的度量来很好地反映数据间的重要关系。这个问题在无监督的环境(如聚类)中尤其严重,而且与聚类经常没有“正确”答案这一长期存在的问题有关:如果使用三种算法对一组文档进行聚类,一种算法根据作者身份聚类,另一种算法根据主题聚类,第三种算法根据写作风格聚类,那么哪个是“正确”答案呢?进一步思考,如果一个算法是按主题聚类的,而我们想要它按写作风格聚类,但很少有系统机制能够将其传递给聚类算法,因此我们经常需要手动调整距离度量。

这篇论文中的主要问题是:假如一个用户指定输入空间中的一些点(Rn)认为它们是相似的,我们能否自动学到这些点间的距离来表示它们的关系。例如,在文档示例中,我们可能希望通过给它几对被判断为相似的文档,让它学会识别某种风格的关键特征。

学习距离度量

假设有一些点集{xi}i=1m⊆Rn,其中某些对是相似的,即:

S: (xi,xj)∈S

如何学习一个距离度量d(x,y)来表示x和y的关系呢?并且相似对的距离应该相对更近。

考虑一个距离度量公式为:

d(x,y)=dA(x,y)=∣∣x−y∣∣A=(x−y)TA(x−y)

为保证这个度量满足非负性和三角不等式(为什么要满足三角不等式),需要另A为正的半正定矩阵,即A⪰0(此处的⪰表示半正定,关于正定和半正定矩阵),令A=I时就变成了欧氏距离的计算公式。若严格限制A为对角矩阵,这就相当于学习一个度量,该度量在不同的坐标轴被给予了不同的“权重”。更具体的说,A参数化了Rn内一组马氏距离。学习这么一个距离等价于找到数据的一个缩放,用A1/2x替换每个点x,使用标准化欧氏距离来缩放数据,这有助于之后的度量学习可视化。

用一个简单方法来定义S中样本对(xi,xj)的所需度量,即:

minimizeA(xi,xj)∈S∑∣∣xi−xj∣∣A2

添加限制∑(xi,xj)∈D∣∣xi−xj∣∣A≥1来保证A不会将数据集压缩成一个点。若信息是明确可得的,此处的D可以是一组“不相似”的样本点对,否则将其取为不在S中的所有样本点对。综上所述,优化问题为:

Amin (xi,xj)∈S∑∣∣xi−xj∣∣A2s.t. (xi,xj)∈D∑∣∣xi−xj∣∣A≥1,A⪰0

上式中的≥1是随意的并不重要,将其取为任意正常数c只会导致A被c2A取代。并且这个问题的目标在参数A下是线性的,两个限制很容易证明是凸的,因此优化问题也是凸的,确保我们可以推导出一个有效的局部最优算法来求解它。

对角矩阵A的情景

在想要学习一个对角矩阵A=diag(A11,A22,...,Ann)的情况下,通过Newton-Raphson方法可以得到一个有效的算法,定义:

g(A)=g(A11,...,Ann)=(xi,xj)∈S∑∣∣xi=xj∣∣A2−log((xi,xj)∈D∑∣∣xi−xj∣∣A)

很容易证明这和最小化g(限制于A⪰0)是恒成立的,A通过乘以一个正常数来更新,然后求解之前的公式。(对于对角矩阵,只要对角线元素Aii非负则能保证A⪰0)

完整矩阵A的情景

当A为一个完整矩阵时,限制A⪰0变得有些棘手,Nerwton方法求解成本会变得很昂贵(需要O(n6)的时间来在n2个参数下求黑塞矩阵的逆)。因此本文使用梯度下降和迭代投影的思想来对这种情况求导出一个不同的算法,基于此提出了一个等价的问题:

Amax g(A)=(xi,xj)∈D∑∣∣xi,xj∣∣A(1)

s.t. f(A)=(xi,xj)∈S∑∣∣xi,xj∣∣A2≤1,A⪰0(2)

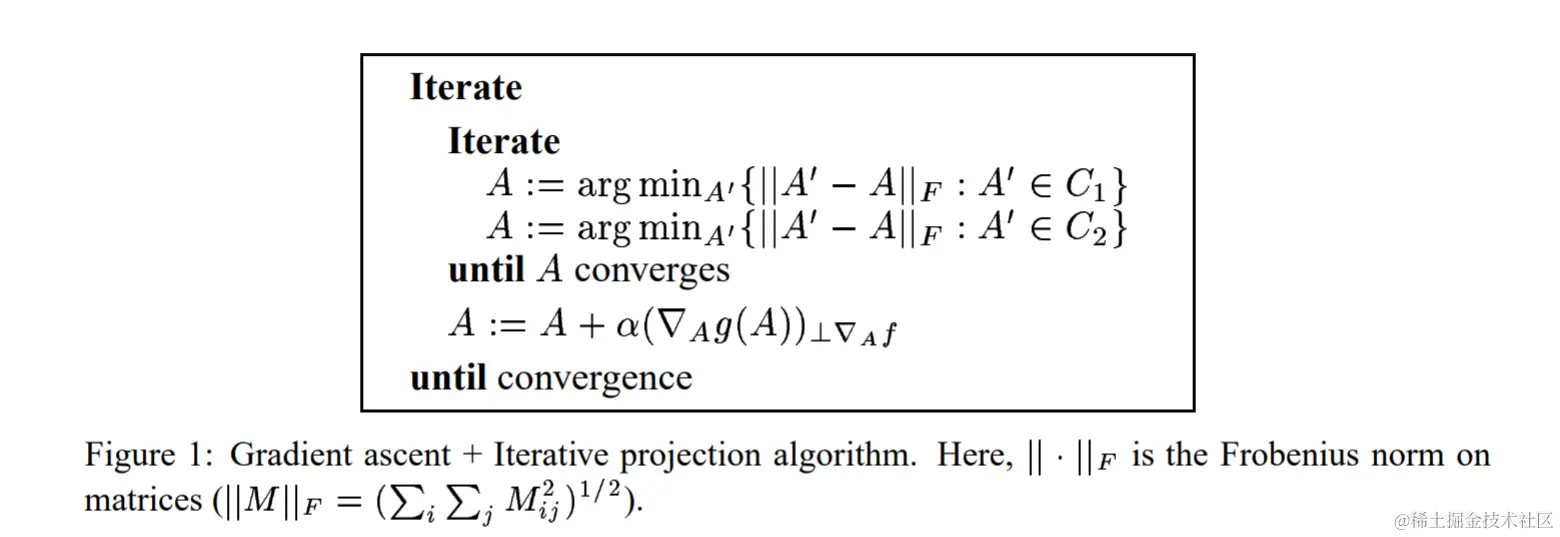

使用梯度上升的方法来求解(1),使用迭代投用来保证约束(2)。特别的一个梯度步长设置为:A:=A+α∇Ag(A),然后反复映射A到集合C1={A:∑(xi,xj)∈S∣∣xi,xj∣∣A2≤1}和C2={A:A⪰0},上述步骤得到的算法如下图所示: