1.2 Probability Theory(概率论)

模式识别领域的一个关键概念是不确定性。它是通过测量中的噪声以及数据集的有限大小产生的。概率论为不确定性的量化和处理提供了一个一致的框架,并形成了模式识别的核心基础之一。党羽第1.5节讨论的决策相结合时,它允许我们在所有可用信息的情况下做出最佳预测,即使这些信息可能不完整或不明确。

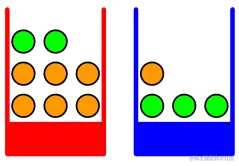

我们将通过一个简单的例子介绍概率论的基本概念。假设我们有两个盒子,一个红色和一个蓝色,在红色盒子里我们有2个苹果和6个桔子,在蓝色盒子里我们有3个苹果和一个桔子。这如图1.9所示。现在假设我们随机挑选其中一个盒子,然后从盒子中随机选择一种水果,观察他是哪种水果后,我们将其替换到它来自的盒子中。我们可以想象多次重复这个过程。让我们假设这样做,我们40%的时间选择红色盒子,60%的时间选择蓝色盒子,当我们从盒子里取出一个水果时,我们同样可能选择盒子里的任何一块水果。

figure 1.9 我们用一个简单的例子来介绍概率的基本概念,即两个颜色的盒子,每个盒子里都有水果(苹果显示为绿色,橙子显示为橙色)

在本例中,将选择的框的标识是一个随机变量,我们将用B表示。该随机变量可以取两个可能值中的一个,即r(对应于红色框)或b(对应于蓝色框)。同样,水果的同一性也是一个随机变量,用F表示。他可以采用a(苹果)或o(橙色)中的任意一个值。

在本例中,将选择的框的标识是一个随机变量,我们将用B表示。该随机变量可以取两个可能值中的一个,即r(对应于红色框)或b(对应于蓝色框)。同样,水果的同一性也是一个随机变量,用F表示。他可以采用a(苹果)或o(橙色)中的任意一个值。

首先,我们将事件发生的概率定义为事件发生的次数占总试验次数的分数,在总试验次数无限的限制下。因此,选择红色的概率为4/10,选择蓝色框的概率为6/10。我们将这些概率写成p(B=r)=4/10和p(B=b)=6/10。注意,根据定义,概率必须在区间[0,1]内。此外,如果事件是互斥的,并且如果它们包括所有可能的结果(例如,在本例中,框必须是红色或蓝色),那么我们看到这些事件的概率总必须为1。

我们现在可以问这样的问题:”选择程序选择一个苹果的总概率是多少?“或者”如果我们选择一个橙色,那么我们选择的盒子是蓝色的概率是多少?“。一旦我们掌握了概率的两个基本规则,即总和规则和乘积规则,我们就可以回答这样的问题,甚至可以回答与模式识别问题相关的更复杂的问题。获得这些规则后,我们将回到我们的水果盒示例。

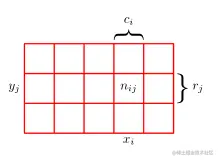

为了推导概率的规则,考虑图1.10中涉及两个随机变量X和Y的更一般的例子(例如,可以是上面提到的方块和水果变量)。我们假设X可以取任意一个值xi,其中i=1,...,M,Y可以取值yj,其中j=1,...,L。考虑总的N个实验,我们对变量X和Y进行取样,并让X=xi和Y=yj为nij这样的实验的数目。同样,让X取值xi(与Y取值无关)的实验次数用ci表示,同样,让Y取值yj的试验次数用rj表示。

figure 1.10 我们可以同故宫考虑两个随机变量X来推导概率的和积规则,X取值{xi},其中i=1,...,M,Y取值{yj},其中j=1,...,L在这个图解中,我们有M=5和L=3。如果我们考虑这些变量的实例的总数N,则我们表示X=xi和Y=yj通过nij的实例的数目,这是数组中对应单元中的点的数目。列i中的点的数目,对应于X=xi,由ci表示,并且行j中的点的数目,对应于Y=yj,由Rj表示。

X取值xi和Y取值yj写的p(X=xi,Y=yj)的值,成为X=xi和Y=yi的联合概率。它是由在i,j的点数作为点的总数的一部分,因此

p(X=xi,Y=yj)=Nnij(1.5)

这里我们隐式地考虑极限N→∞。类似的,不管Y的值如何,X取值xi的概率写为p(X=xi),并由第i列中总点数的分数给出,所以

p(X=xi)=Nci(1.6)

因为图1.10中第i列中的实例数只是该列每个单元格中实例数的总和,所以我们有ci=∑jnij,因此从(1.5)和(1.6),我们有

p(X=xi)=j=1∑Lp(X=xi,Y=yj)(1.7)

这是概率的和规则。注意,p(X=xi)有时被称为边际概率,因为他是通过边缘化或求和其他变量(在本例中为Y)得到的。

如果我们只考虑X=xi的实例,则这样的实例的分数为Y=yj写为p(Y=yj∣X=xi),并且称为Y=yj给定X=xi的条件概率。他是通过查找第i列中属于单元格i,j的点的分数获得的,因此由

p(X=xi∣Y=yj)=cinij(1.8)

给出(1.5),(1.6),(1.8),然后我们可以得到以下关系

p(X=xi,Y=yj)=Nnij=cinij⋅Nci=p(Y=yj∣X=xi)p(X=xi)(1.9)

这是概率乘积法则。

到目前为止,我们已经非常小心地区分了随机变量,例如水果实例中盒子B,以及随机变量可以采用的值,例如,如果框里是红色的,则r。因此,B取值r的概率表示为p(B=r)。虽然这有助于避免歧义,但它会导致一种相当麻烦的符号,在许多情况下,不需要这种迂腐。相反,我们可以简单的写p(B)来表示随机变量B上的分布,或p(r)来表示为特定值r计算的分布,前提是上下文中的解释是清楚的。

有了这个更紧凑的符号,我们可以用下面的形式写出概率论的两条基本规则。

The Rules of Probability

求和规则 p(X)=∑Yp(X,Y) (1.10)

乘积规则 p(X,Y)=p(Y∣X)p(X) (1.11)

这里p(X,Y)是一个联合概率,用"X和Y的概率"表示。类似的,数量p(Y∣X)是一个条件概率,表示为"给定X的Y的概率",而数量p(X)是一个边际概率,只是"X的概率"。这两条简单的规则构成了我们在本书中使用的所有概率机制的基础。

根据乘积规则,结合对称性p(X,Y)=p(Y,X),我们立即得到条件概率

p(Y∣X)=p(X)p(X∣Y)p(Y)(1.12)

之间的关系,成为贝叶斯定理,在模式识别和机器学习中起着核心作用。使用求和公式,贝叶斯定理中的分母可以用分子

p(X)=Y∑p(X∣Y)p(Y)(1.13)

中出现的量来表示。我们可以将贝叶斯定理中的分母视为标准化常数,以确保(1.12)左侧的条件概率与Y的所有值之和等于1。

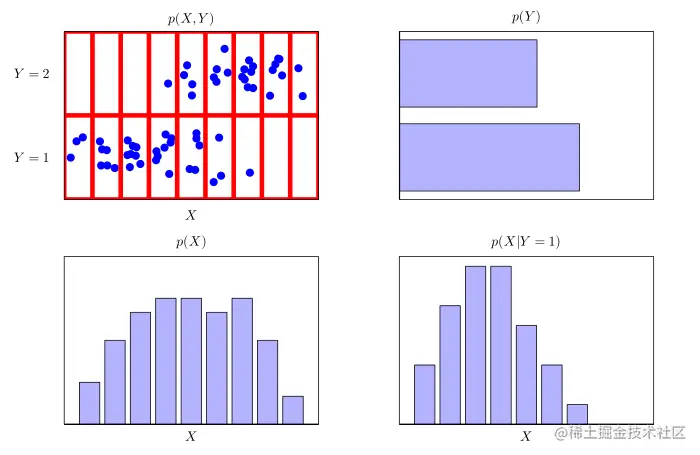

在图1.11中,我们展示了一个简单的例子,涉及到两个变量的联合分布,以说明边际分布和条件分布的概念。此外,从节理分布中提取了N=60个数据点的有限样本,如左下角所示。右上角时两个Y值各有一个的数据点分数的直方图。根据概率的定义,这些分数等于极限N中相应的概率p(Y)→∞。我们可以将柱状图视为一种简单的建模概率分布的方法,只要从该分布中提取有限数量的点。从数据建模分布是统计模式识别的核心,本书将详细探讨。图1.11中剩下的两个图显示了p(X)和p(X∣Y=1)的相应直方图估计。

figure 1.11 两个变量的分布图,X取9个可能值,Y取两个可能值。左上图显示了从这些变量的联合概率分布中得出的60个点的样本。其余的图显示了边缘分布p(X)和p(Y)的直方图估计,以及与左上角图中第行对应的条件分布p(X∣Y=1)。

现在让我们回到我们的例子,涉及到水果盒。目前,我们将再次明确区分随机变量及其实例化。我们已经看到,选择红色或蓝色框的概率分别由

p(B=r)=4/10(1.14)

p(B=b)=6/10(1.15)

给出。注意,这些满足p(B=r)+p(B=b)=1。

现在假设我们随机选取一个盒子,结果是蓝色的盒子。那么选择一个苹果的概率就是蓝色框中苹果的分数,是3/4。因此p(F=a∣B=b)=3/4。事实上,我们可以写出水果类型的所有四个条件概率,再次给定所选框

p(F=a∣B=r)=1/4(1.16)

p(F=o∣B=r)=3/4(1.17)

p(F=a∣B=b)=3/4(1.18)

p(F=o∣B=b)=1/4(1.19)

注意,这些概率是标准化的,因此

p(F=a∣B=r)+p(F=o∣B=r)=1(1.20)

和类似的

p(F=a∣B=b)+p(F=o∣B=b)=1(1.21)

我们现在可以使用概率的和积规则来评估选择苹果的总体概率

p(F=a)=p(F=a∣B=r)p(B=r)+p(F=a∣B=b)p(B=b)=41×104+43×106=2011(1.22)

根据求和规则,p(F=o)=1−11/20=9/20。

相反,假设我们被告已知已选择了一块水果,它是一个橘子,我们想知道它来自哪个盒子。这要求我们评估以水果身份为条件的盒子上的概率分布,而(1.16)-(1.19)中的概率给出了以盒子身份为条件的水果上的概率分布。我们可以通过使用贝叶斯定理来解决条件概率的反转问题,给出

p(B=r∣F=o)=p(F=o)p(F=o∣B=r)p(B=r)=43×104×920=32(1.23)

根据求和规则,p(B=b∣F=o)=1−2/3=1/3。

我们可以对贝叶斯定理进行如下重要解释。如果我们在被告知所选水果的身份之前被问到选择了哪个盒子,那么我们所能得到的最完整的信息就是概率p(B)。我们称之为先验概率,因为它是在我们观察水果的特性之前可用的概率。一旦我们被告知水果是橘子,我们就可以使用贝叶斯定理来计算概率p(B∣F),我们将其称为后验概率。请注意,在本例中,选择红色框的先验概率为4/10,因此我们更可能选择蓝色框而不是红色框。然而,一旦我们观察到所选的水果是橙色的,我们发现红色盒子的后验概率现在是2/3,因此我们现在更可能选择的盒子实际上是红色的。这一结果符合我们的直觉,因为红色盒子里的橙子比例比蓝色盒子里的高很多,因此观察到的水果是橙子提供了支持盒子的重要证据,是的选择红色框而不是蓝色框的可能性更大。

最后,我们注意到,如果两个变量的联合分布分解成边缘的乘积,使得p(X,Y)=p(X)p(Y),那么X和Y称为独立的。从乘积规则中,我们看到p(Y∣X)=p(Y),因此给定X的Y的条件分布确实与X的值无关。例如,在我们的水果和实例中,如果每个盒子包含相同比例的苹果和橙子,那么p(F∣B)=P(F),因此选择(比如)苹果的概率与选择哪个盒子无关。

在本例中,将选择的框的标识是一个随机变量,我们将用表示。该随机变量可以取两个可能值中的一个,即(对应于红色框)或(对应于蓝色框)。同样,水果的同一性也是一个随机变量,用表示。他可以采用(苹果)或(橙色)中的任意一个值。