1. 函数

1.1 函数的定义

量和量之间的关系如:

其中 x 是自变量,y 是因变量

函数在 处取得的函数值

符号只是一种表示,也可以

1.2 函数的分类

分段函数

反函数

相当于把自变量和因变量调换位置,其中右边的函数表示形式就是左边的反函数。

显函数与隐函数

像 这种的我们就称之为显函数。

如果它的表达式是 或者

这样需要我们去推导出 y=? 的,我们称为隐函数。

1.3 函数的特性

奇偶性

偶函数 ,比如

奇函数 ,比如

周期性

单调性

在变量的取值区间上如果一直是递增或者递减,就是单调函数。

2. 极限

2.1 极限的符号表示

当

无限增大时(负无穷是向左增大)

当 x 无限增大时

当 x 无限减小时

当 x 从

的左右两侧无限接近

时

当 x 从

的右侧无限接近

时

当 x 从

的左侧无限接近

时

2.2 数列

按照一定次数排列的一组数: 其中

叫做通项。

如果数列 当 n 无限增大时,其通项无限接近于一个常数 A 时,我们称该数列收敛于 A,否则称该数列为发散。

举例:

当 n 趋近于无穷大时收敛于 A

当 n 趋近于无穷大时收敛于 0

当 n 趋近于无穷大时,极限不存在,是发散的

=

= 2

如果一个函数,在左右邻域都有定义时,那求极限时需要考虑左右极限的问题:

显然,它的左右极限都是存在的,但是不相等,所以 不存在。

2.3 无穷小与无穷大

以 0 为极限, 可以看出当 x 趋近于无穷大时收敛于 0,我们可以称

是

时的无穷小。

这里有些基本性质需要记住:

- 有限个无穷小的代数和仍是无穷小。

- 有限个无穷小的积仍是无穷小。

- 有界变量与无穷小的积仍是无穷小

- 无限个无穷小之和不一定是无穷小。

- 无穷小的商不一定是无穷小。

以 为极限,

注意:无穷大并不是指一个很大的值,而是针对变量的变换过程而言的;如果在一组变换中, 为无穷大,那么

是无穷小。

2.4 函数的连续性

设函数 在点

的某邻域内有定义时,那么当

变化趋近于 0 时,

也为 0,我们称函数

在点

处连续。

连续需要满足的条件:

- 函数在该点处有定义

- 函数在该点处极限

存在

- 极限值等于函数值

有连续就有间断,我们称之为间断点(了解概念就行)。

3. 导数

3.1 导数的定义

假设汽车运动的速度为 v,路程为 s,耗费的时间为 t,那么在单位时间内它的平均速度可以表示为

当 时,也就是求极限可以得到它的瞬时速度表示

这个其实也称为平均变化率的极限,如果这个值它是存在的,那么我们称此极限是函数 在点

处的导数

,也可以表示为

导数的实质:增量比的极限。

3.2 偏导数

上面导数的定义中只有一个自变量,如果我们的自变量不再是一个,而是有多个 x,y,z..呢,也就是多元函数?一般而言,固定其中一个变量(假设这个变量在求导过程中方向不会变),而求另外一个自变量的导数,这种操作就叫做求偏导。举个栗子:

求函数 在点(1,2)处的偏导数?

思路:因为有两个自变量,所以会求出两个偏导数,当然前提是它们在邻域内都是可导的。

先固定 y,得到

固定 x,得到

所以:

可以看出,偏导数只是沿着 x 轴或者 y 轴的变化。

3.3 方向导数

方向导数的定义

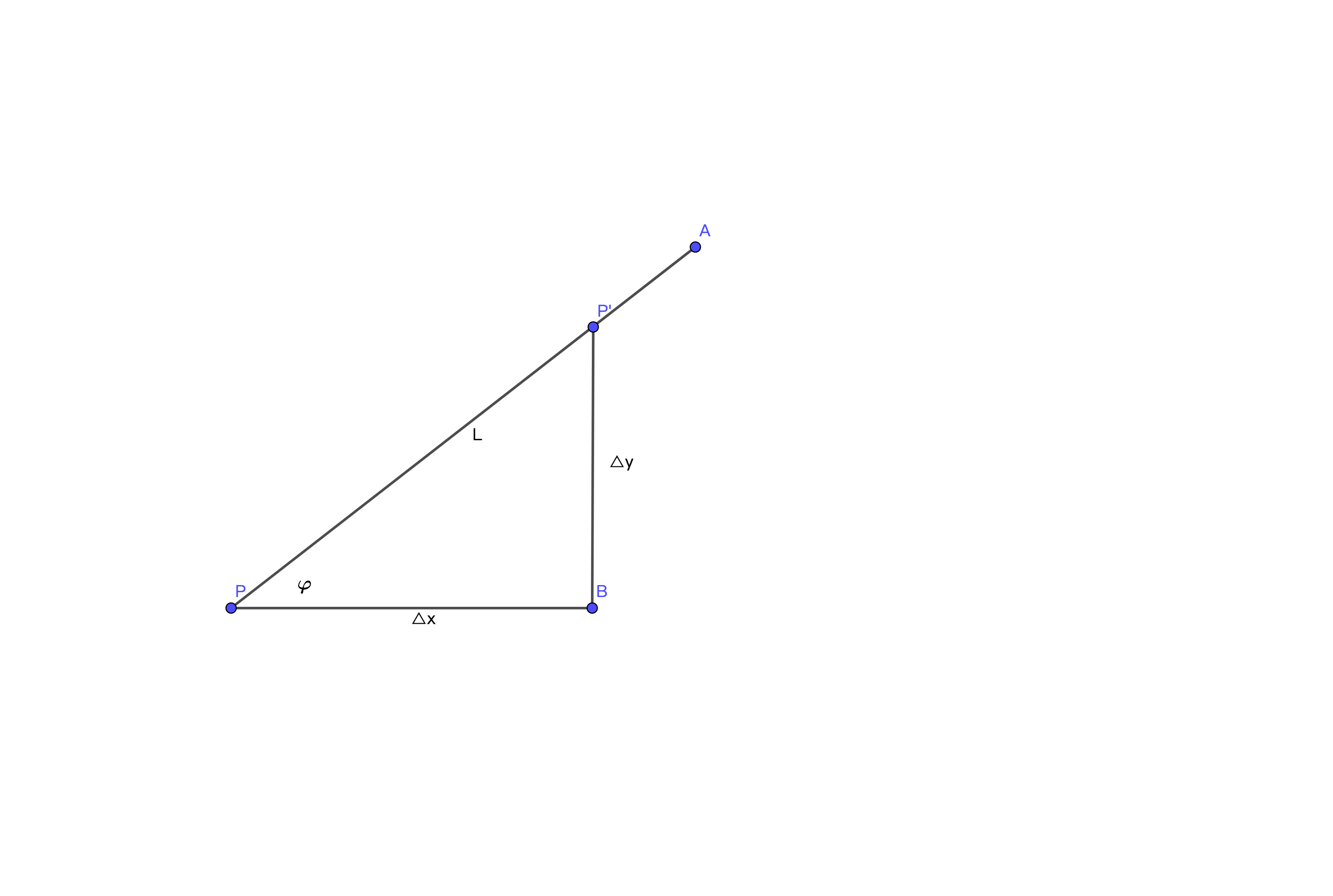

如上图示,先定义一个函数 ,两点之间的距离(模),

,如果函数的增量

与这两点的距离比例存在,则称此为 P 点沿着 L 方向的方向导数

其实:一个点在一个平面上(这个平面就是这个点的切面)是有无数个方向的,并不是一定沿着坐标轴的。

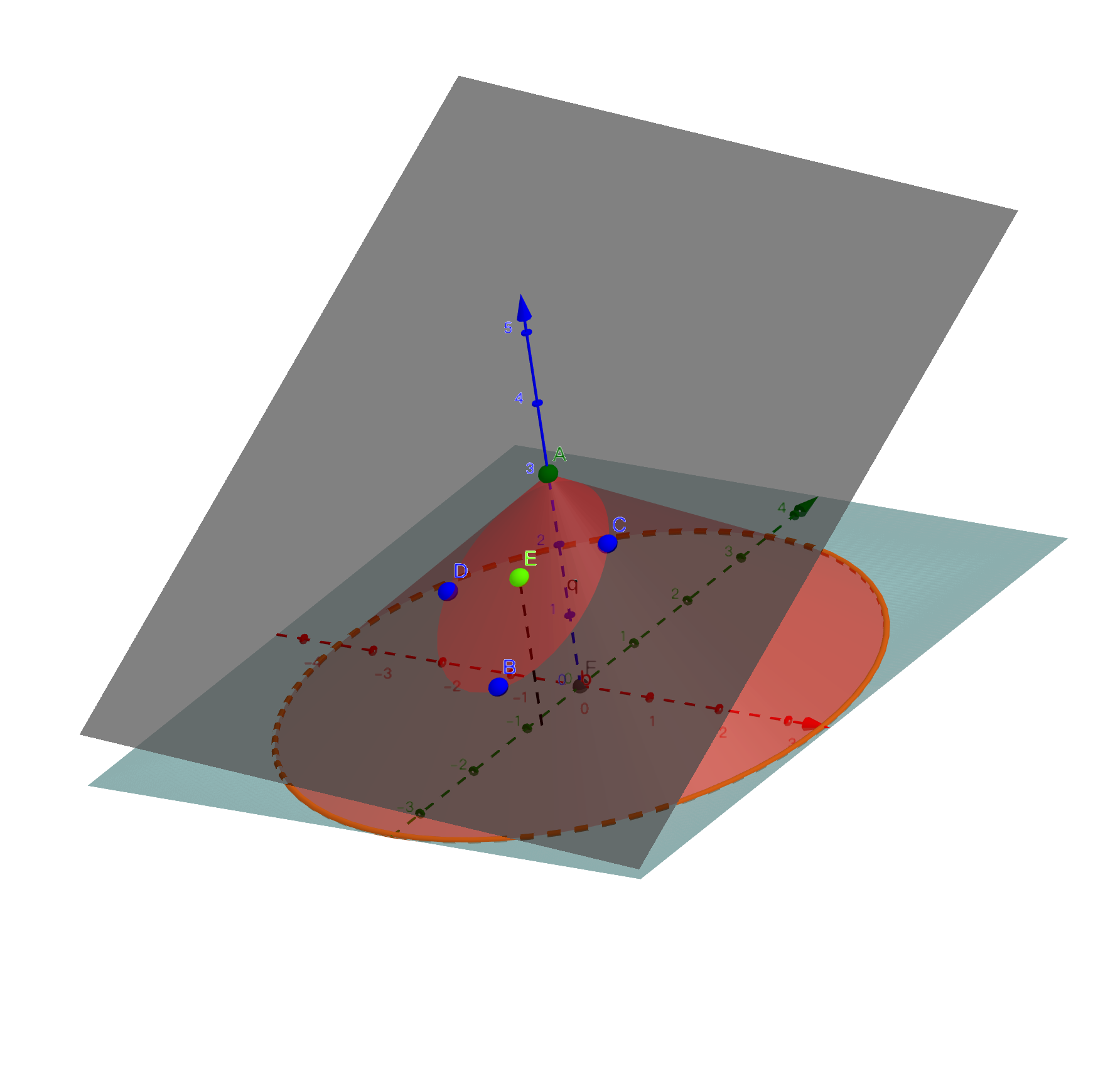

可以看到图中由 BCD 构建的平面切于函数,在此切面上有一点 E,E 点在此切面 q 上是有无数(360°)个方向(L),即对于一个点方向导数是很多的。

(二维里一个点确定一条切线,三维里一条线确定一个切面,这个线上随便取一个点,沿着这个点在平面上又能画出无数个线)

方向导数与偏导数的关系

如果函数 在点

是可微分的,那么该点沿任意方向 L 的方向导数都是存在的。同时,我们可以得出它与偏导数的关系,其中

为 X 轴到 L 的角度。

3.4 梯度

直白的解释一下:在下山过程中怎么样下山是最有效率,肯定是沿着你所在位置求一个切线的方向,切线有两个方向,一个是向上一个是向下。那么梯度就是向上的方向(只要记住梯度本身是上升的)。在机器学习中,通常我们优化的方向是梯度下降,其实就是沿着梯度反方向就行了。

梯度和方向导数的关系:方向导数是随意的,梯度是方向导数中值取得最大的那个方向。

参考资料

1)曲线切线的定义和导数

2)方向导数与梯度