object SparkPi{

def main(args:Array[String]){

val conf = new SparkConf().setAppName("Spark Pi")

val spark = new SparkContext(conf)

val slices = if(args.length > 0) args(0).toInt else 2

val n = math.min(100000L * slices,Int.MaxValue).toInt//avoid overflow

val count = spark.parallelize(1 until n,slices).map{ i =>

val x = random*2-1

val y = random*2-1

if (x*x +y*y<1) 1 else 0

}.reduce(_ + _)

println("Pi is roughly" + 4.0*count/n)

spark.stop()

}

}

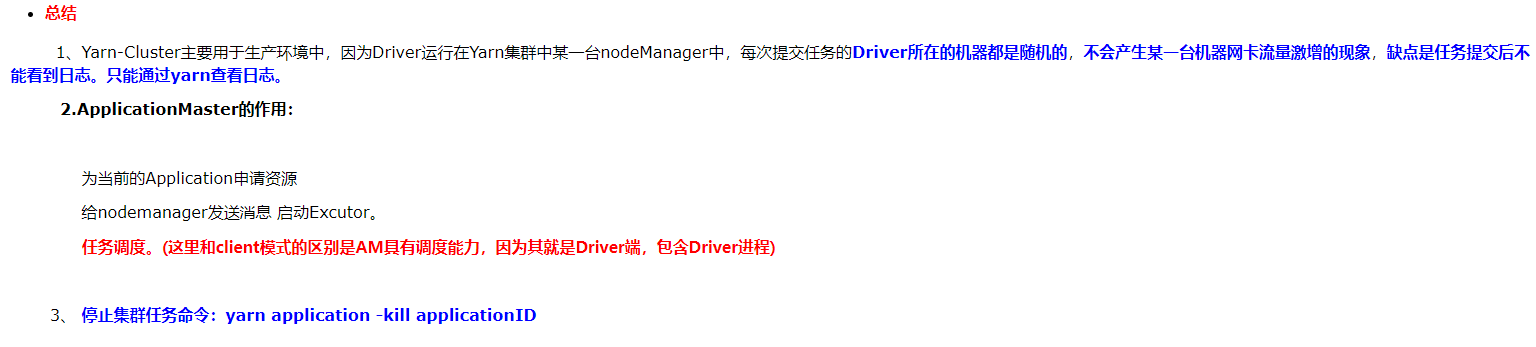

基于Standalone的两种提交方式

转到bin目录

1.client

1、client模式提交任务后,会在客户端启动Driver进程

2、Driver会向Master申请启动Application启动的资源

3、资源申请成功,Driver端将task发送到worker端执行

4、worker将task执行结果返回到Driver端

./spark-submit --master spark://[主机名]:[端口号] --class [class名].[object名] [jar路径] [参数] ./spark-submit --master spark://[ht-1]:[7077] --class [class名].[object名] [jar路径] [参数]

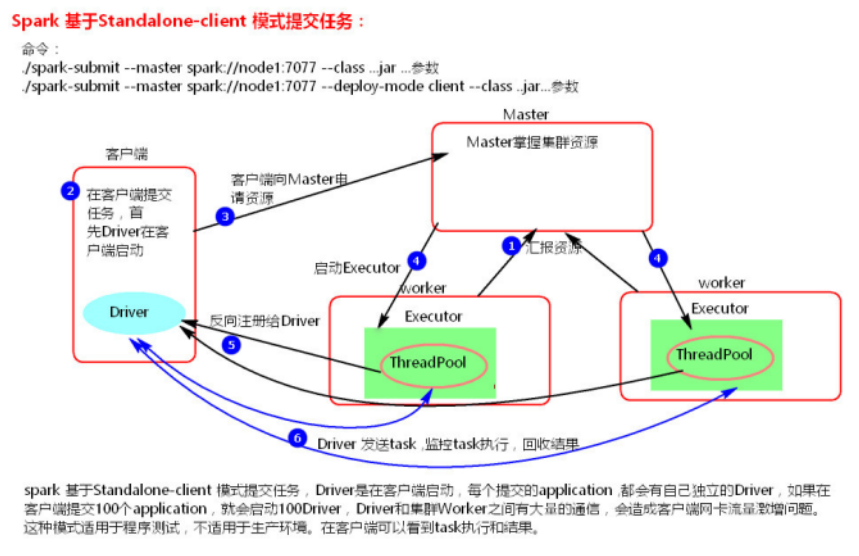

2.cluster

1、cluster模式提交应用程序后,会向Master请求启动Driver.(而不是启动application)

2、Master接受请求,随机在集群一台节点启动Driver进程

3、Driver启动后为当前的应用程序申请资源。Master返回资源,并在对应的worker节点上发送消息启动Worker中的executor进程

4、Driver端发送task到worker节点上执行

5、worker将执行情况和执行结果返回给Driver端。Driver监控task任务,并回收结果

./spark-submit --master spark://[主机名]:[端口号] --deploy-mode cluster --class [class名].[object名] [jar路径] [参数]

./spark-submit --master spark://[ht-1]:[7077] --deploy-mode cluster --class [class名].[object名] [jar路径] [参数]

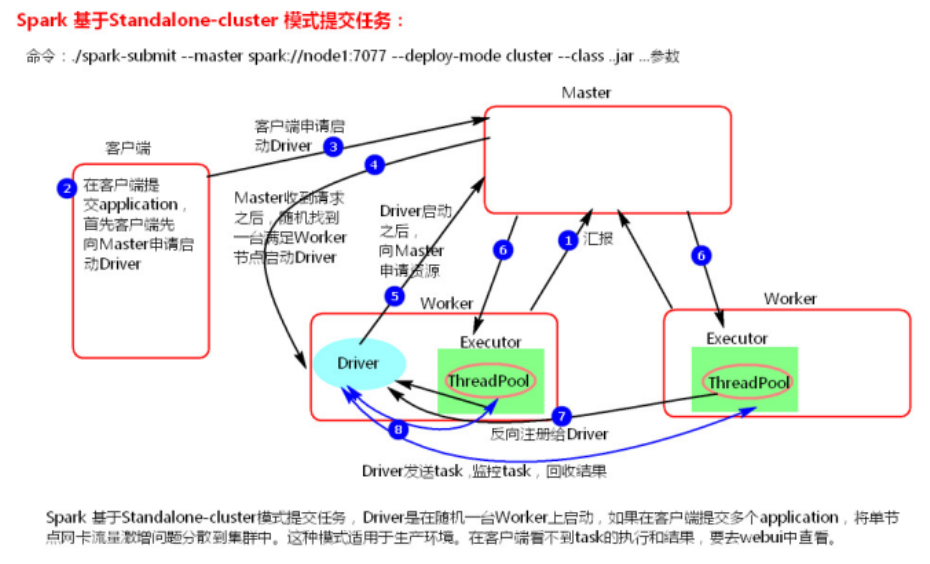

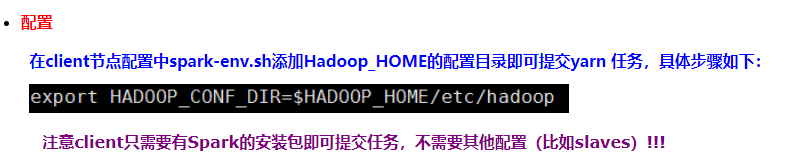

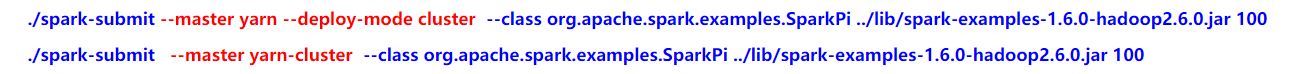

基于Yarn的两种提交方式

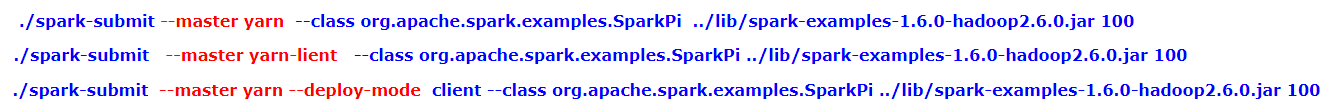

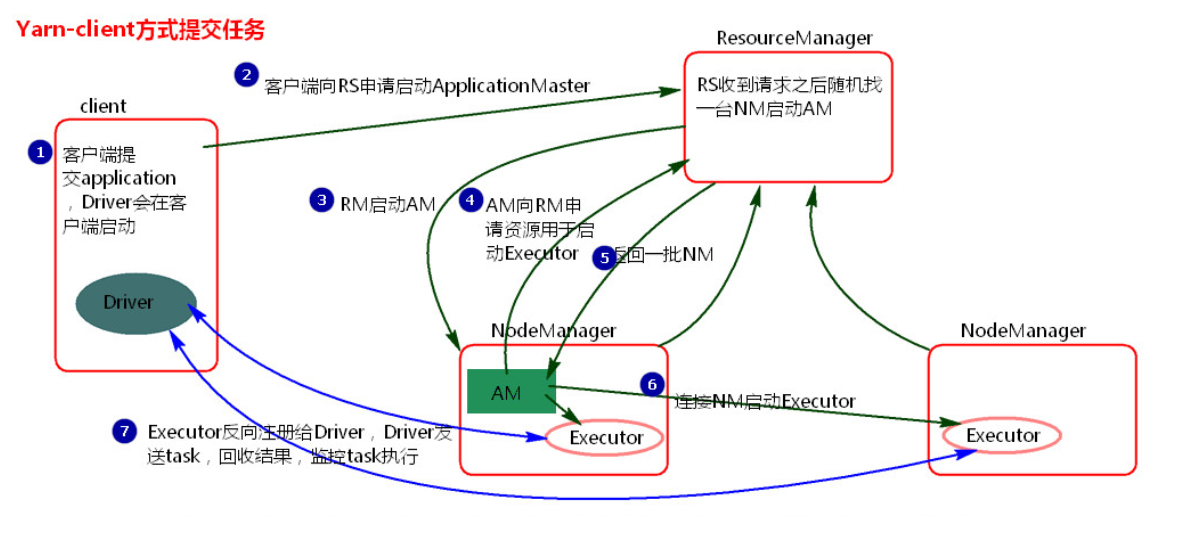

1.yarn-client

1.客户端提交一个Application,在客户端启动一个Driver进程。

2.Driver进程会向RS(ResourceManager)发送请求,启动AM(ApplicationMaster)的资源。

3.RS收到请求,随机选择一台NM(NodeManager)启动AM。这里的NM相当于Standalone中的Worker节点。

4.AM启动后,会向RS请求一批container资源,用于启动Executor.

5.RS会找到一批NM返回给AM,用于启动Executor。

6.AM会向NM发送命令启动Executor。

7.Executor启动后,会反向注册给Driver,Driver发送task到Executor,执行情况和结果返回给Driver端

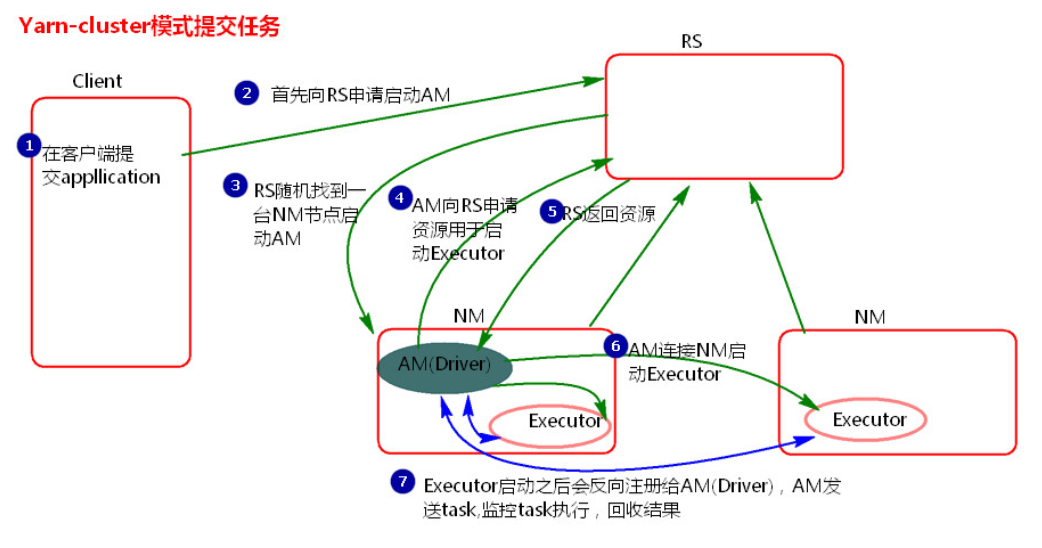

2.yarn-cluster

1.客户机提交Application应用程序,发送请求到RS(ResourceManager),请求启动AM(ApplicationMaster)。

2.RS收到请求后随机在一台NM(NodeManager)上启动AM(相当于Driver端)。

3.AM启动,AM发送请求到RS,请求一批container用于启动Executor。

4.RS返回一批NM节点给AM。

5.AM连接到NM,发送请求到NM启动Executor。

6.Executor反向注册到AM所在的节点的Driver。Driver发送task到Executor。