这两年GAN和VAE等生成网络在图片生成任务上面取得了突破。我的一个研究方向是人工智能模型的可解释性,那么对于一个可以生成逼真场景图片的深度网络,内部到底学到了怎样的表征呢?今天给大家分享一个我们最近解析生成模型的内部表征的工作。

几年前我在MIT的一个早期工作,发表在ICLR’15的论文Object detectors emerge from deep scene CNNs (https://arxiv.org/pdf/1412.6856.pdf), 分析了对于一个场景分类的CNN网络,内部的卷积单元(简称为神经元)在训练完成后自发形成了各种具有语义的检测器。而且,这些神经元表征的特征具有Hierarchical关联,比如底层靠近输入图片的神经元主要做线段和纹理的检测,高层靠近输出的神经元主要在检测物体和物体的组成部分,如电视,沙发等。其实这也make sense,跟人在识别场景的时候类似,人也是在检测到场景里面有沙发电视等特征物体时候,才判断这个场景是客厅。训练过程中,在给予网络监督场景分类的监督信号时候,网络内部自发做knowledge discovery,去寻找到跟分类任务最相关的语义概念,然后去表征它们。

所以,我们可以把场景分类网路的预测过程看做是一个图片抽象的过程:输入一张图,输出一个具体的场景标签,而分类网络内部在逐层执行hierarchical abstraction过程。分类网络的可视化和可解释性已经有挺多工作了,感兴趣的同学可以参见我跟David Bau合作的这篇Network Dissection (http://netdissect.csail.mit.edu/),PAMI杂志上发表的论文有比较详实的实验,网站上也有其他比较有代表性的相关工作。

但是,生成网络在合成图片时,是在执行一个相反过程:输入是一个随机向量,然后经过逐层卷积(部分生成网络在每层有新的随机向量加入,如StyleGAN),最后输出合成图片。输入和输出之间的转换过程,并不是这么直观,也几乎没有之前的工作去分析这个问题。我在这里倾向于把这种转换看成一个语义组合的过程,是从整体到局部的实现。回想人在画画时候,我们会先决定场景的整体视角,然后勾勒出场景的透视结构,然后决定物体的摆放,然后实际去勾勒每个物体再加上具体的纹理和上色。那对于能“画出”接近于真实图片的生成网络,内部的画图过程是不是也遵循跟人类似的画画规律呢?

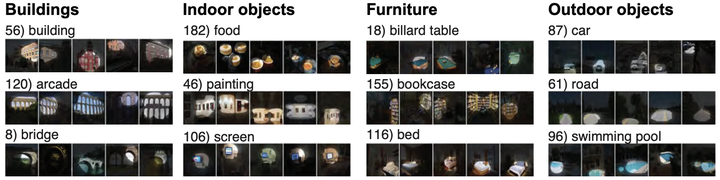

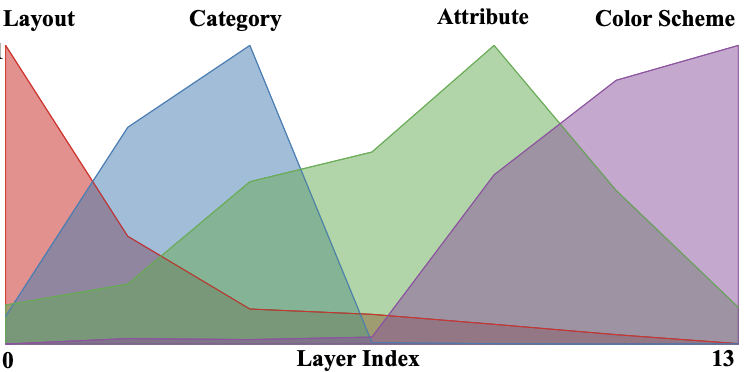

我跟mmlab实验室两位同学杨策元和沈宇军合作的一个最新工作,Semantic Hierarchy Emerges in Deep Generative Representations for Scene Synthesis(https://ceyuan.me/SemanticHierarchyEmerge/),就是在探索这个问题。如题目所示,我们的确证实了对于每层都有随机向量输入的一大类主流生成网络,如StyleGAN, BigGAN等,不同层在专注于合成不同的语义概念,而且也具有hierarchical的关联。下图显示了对于这个场景合成生成网络的这13层,每一层对不同语义概念有截然不同的重要性。比如说靠近输入的层数是在负责layout,中间层主要在合成跟场景相关的物体(Categorical objects,决定了图片的场景类别),接近输出的层数才是在决定场景的整体属性,如光照,风格,颜色等等。这些不同的语义概念可以称为场景的variation factor。生成网络在训练过程中努力生成图片的过程,可以看成是在对这些不同的variation factor的概念进行逐层表征,成功过后才能采样组合出逼真的场景图片。

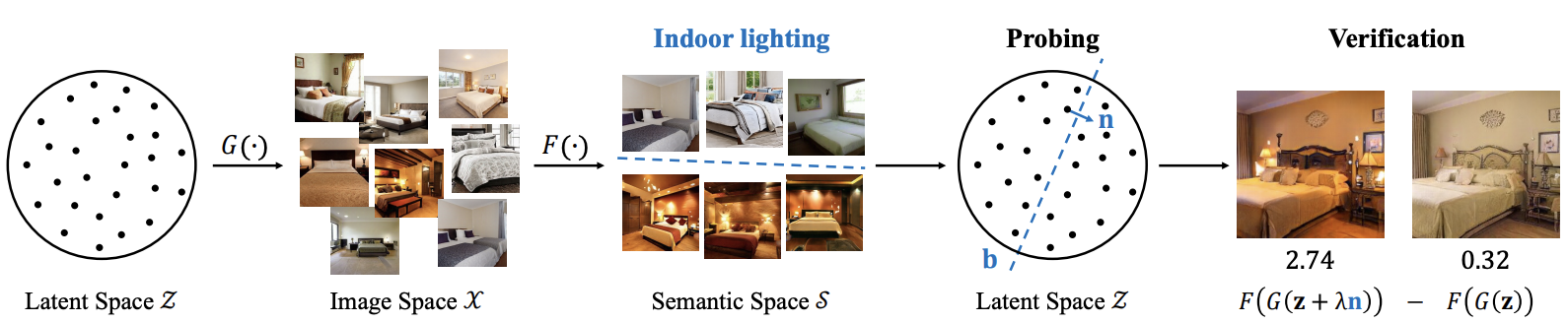

如下图所示,论文中我们提出了简单有效的验证方法,利用已有的语料库去解析不同层激活相应的子空间所对应的语义概念,得到线性分界面过后,我们就可以自由改变图片的语义属性了。

对生成网络内部表征进行解析的直接和重要的应用是,我们可以利用发掘出的这些可控的variation factor,更真实地进行语义图片编辑。比如,我们只需要选定需要改变的语义属性,如光照,layout,白云等,就可以加入和减去相关属性,如下面这个动画所示。效果比我跟MIT合作者在今年SIGGRAPH'19提出的GANPaint (http://ganpaint.io/)还要好。

更多内容和demo video请参见下面的链接。在webpage里面,我们也放入了一些最近的相关工作和concurrent work, 比如说改变人脸特征的InterFaceGAN (https://shenyujun.github.io/InterFaceGAN/)等。应该这个系列还有后续,大家请期待。

Webpage: https://ceyuan.me/SemanticHierarchyEmerge/

论文:https://arxiv.org/pdf/1911.09267.pdf

----------------------------------------------------------------------------

Bonus, 再致敬一下StyleGAN的作者。有幸在今年CVPR’19 Uber party的时候跟两位大神喝了个酒,左边是Tero, 右边是Timo,两个芬兰人太自由散漫了,看着像搞北欧重金属的\m/。也许真是自由的灵魂和思想才能搞出自由而开脑洞的工作, peace。