由于标题字数限制,论文完整标题如下: DeeptransMap: a considerably deep transmission estimation network for single image dehazing

Multimedia Tools and Applications 2019

Jing Huang, Wen Jiang, Lin Li, Yuanqiao Wen, Gaojing Zhou

简介

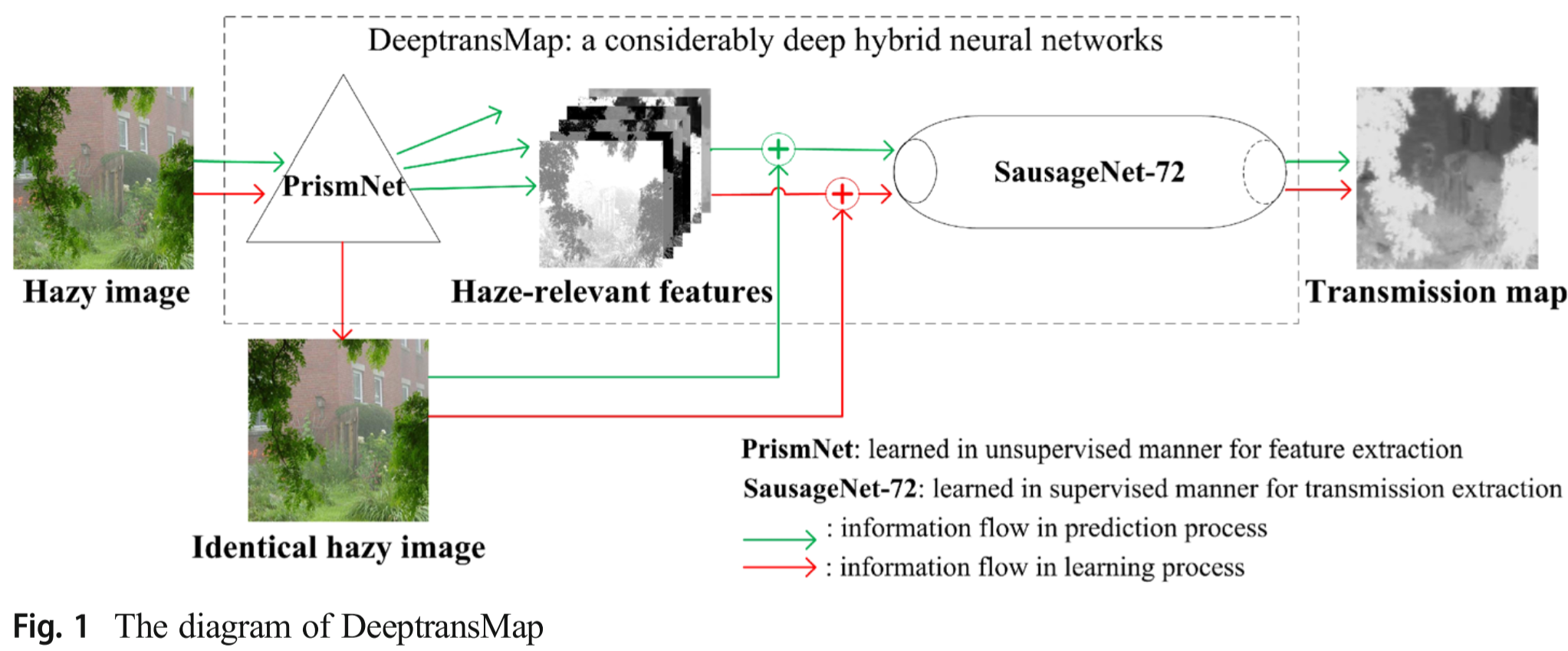

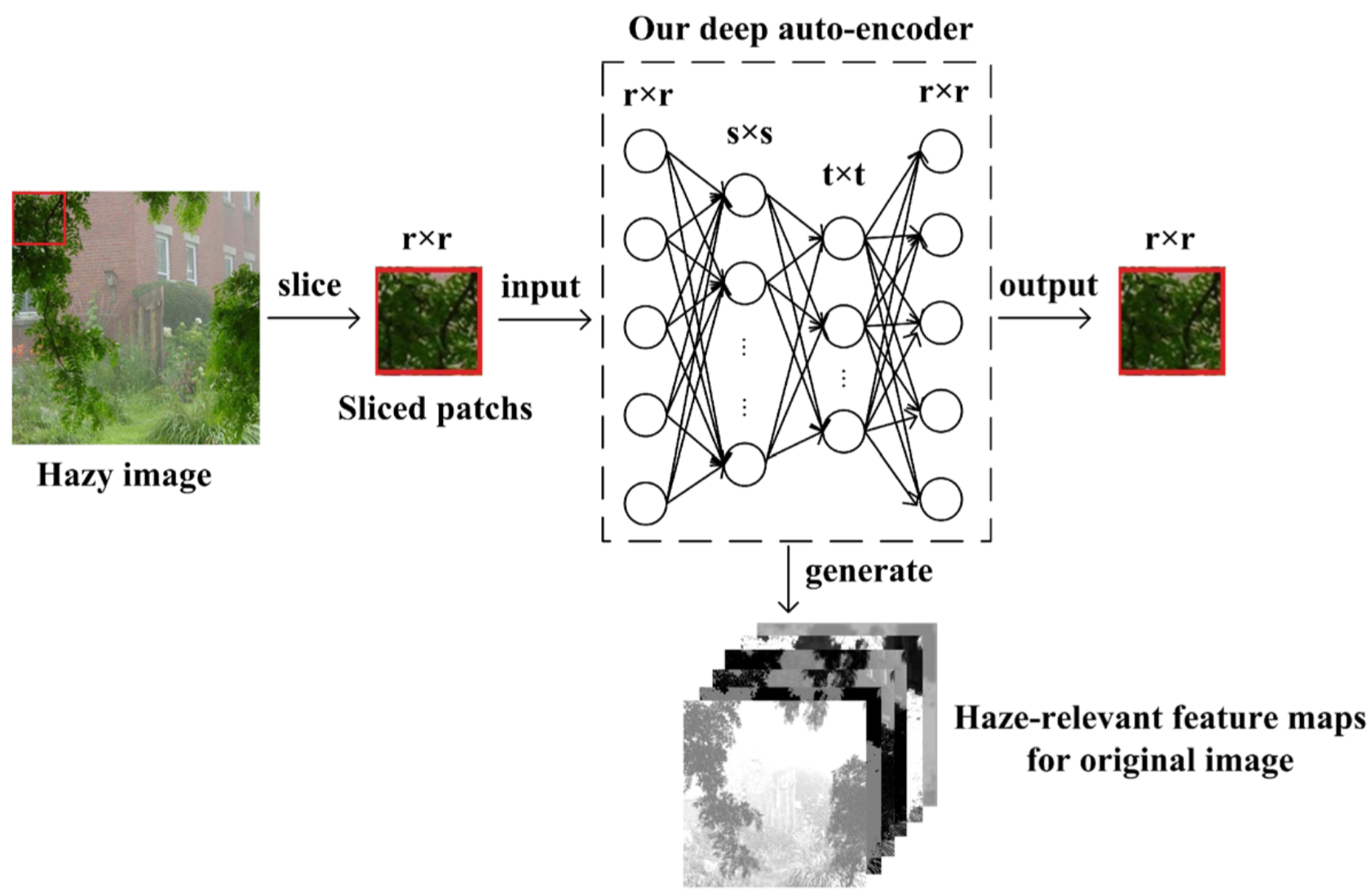

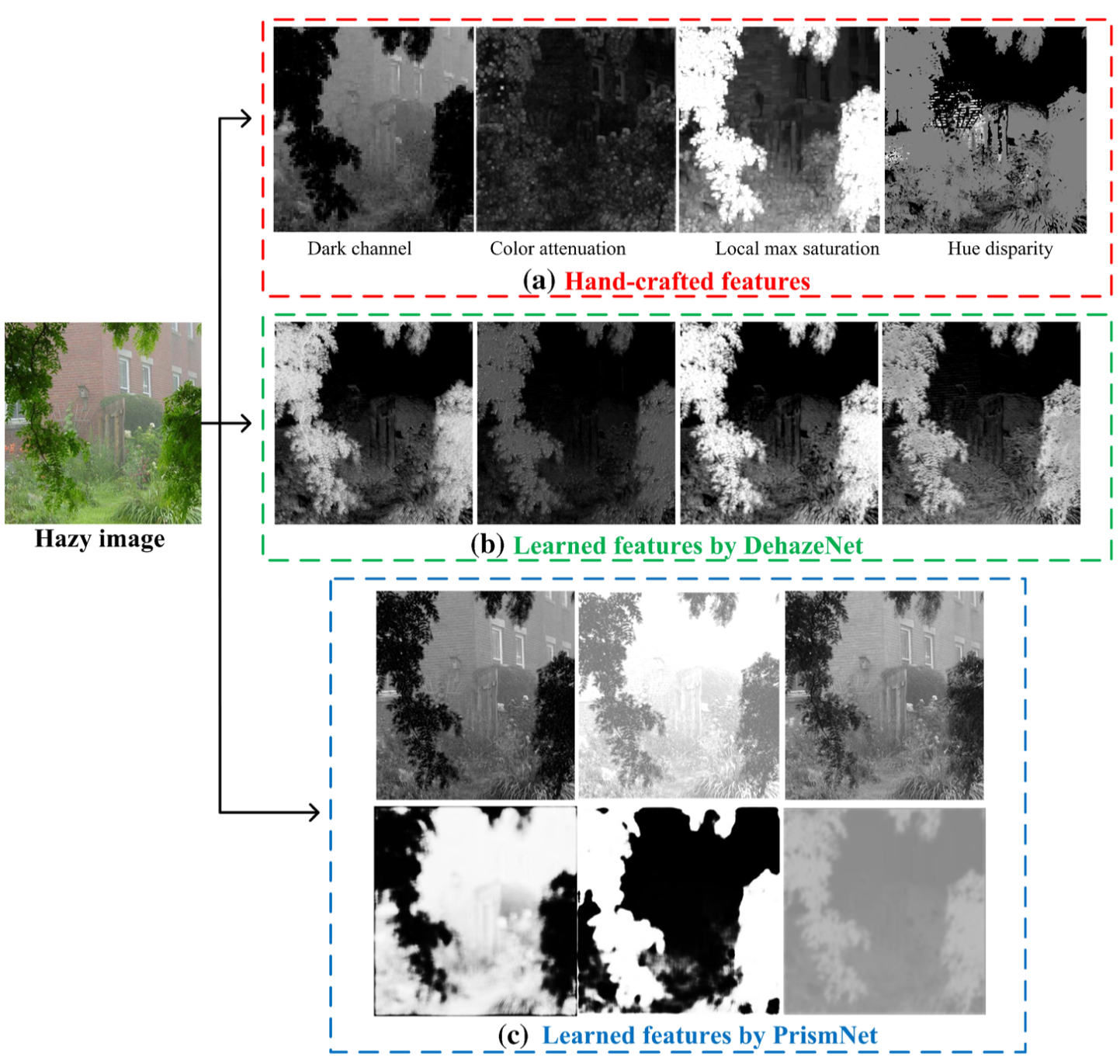

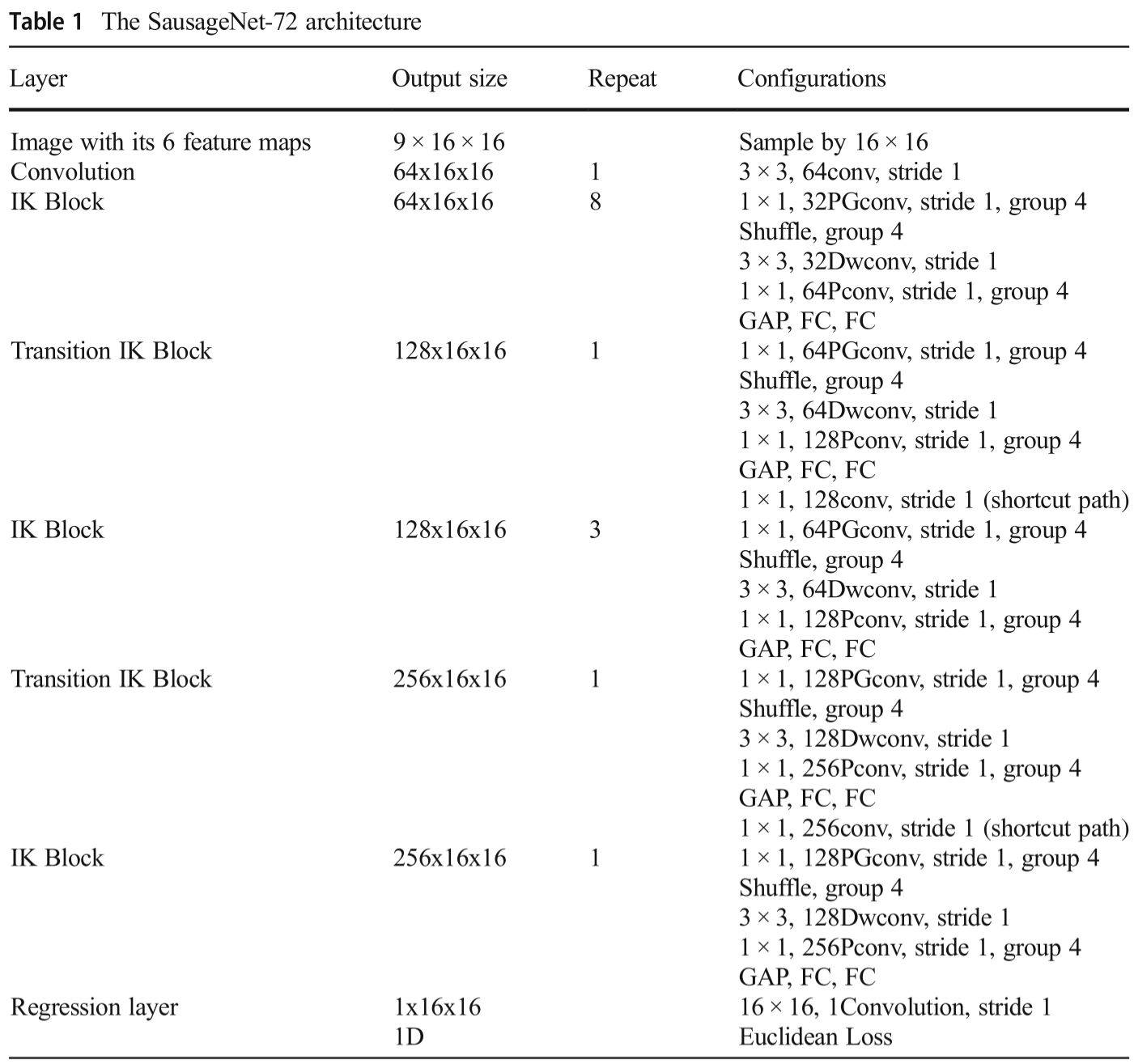

文章提出了一个DeeptransMap网络结果,其分为两个子网络PrismNet和SausageNet-72。其中PrismNet是一个自编码器,使用一个无监督loss来提取有雾图像的信息。SausageNet-72由文章自己设计的模块组成,文中给出了相关网络结构。文章使用了损失。

Motivation

文章指出了过去的算法中存在的两个问题:

- 人工设计的雾相关特征可能不能够适应所有的场景,即雾相关先验不能适应所有场景。例如DCP不能对白色天空区域或者白色物体适用。

- 合成雾的数据集训练后的网络不能很好的迁移到真实世界的有雾数据集中,即去雾算法缺乏一定的鲁棒性。

文章给出了部分设计理由:

- 原始数据的基础信息可以通过无监督的表示学习来精确挖掘。

- 深度学习模型的表示能力可以通过增加网络大小来提高,从而进一步增强鲁棒性和准确性。

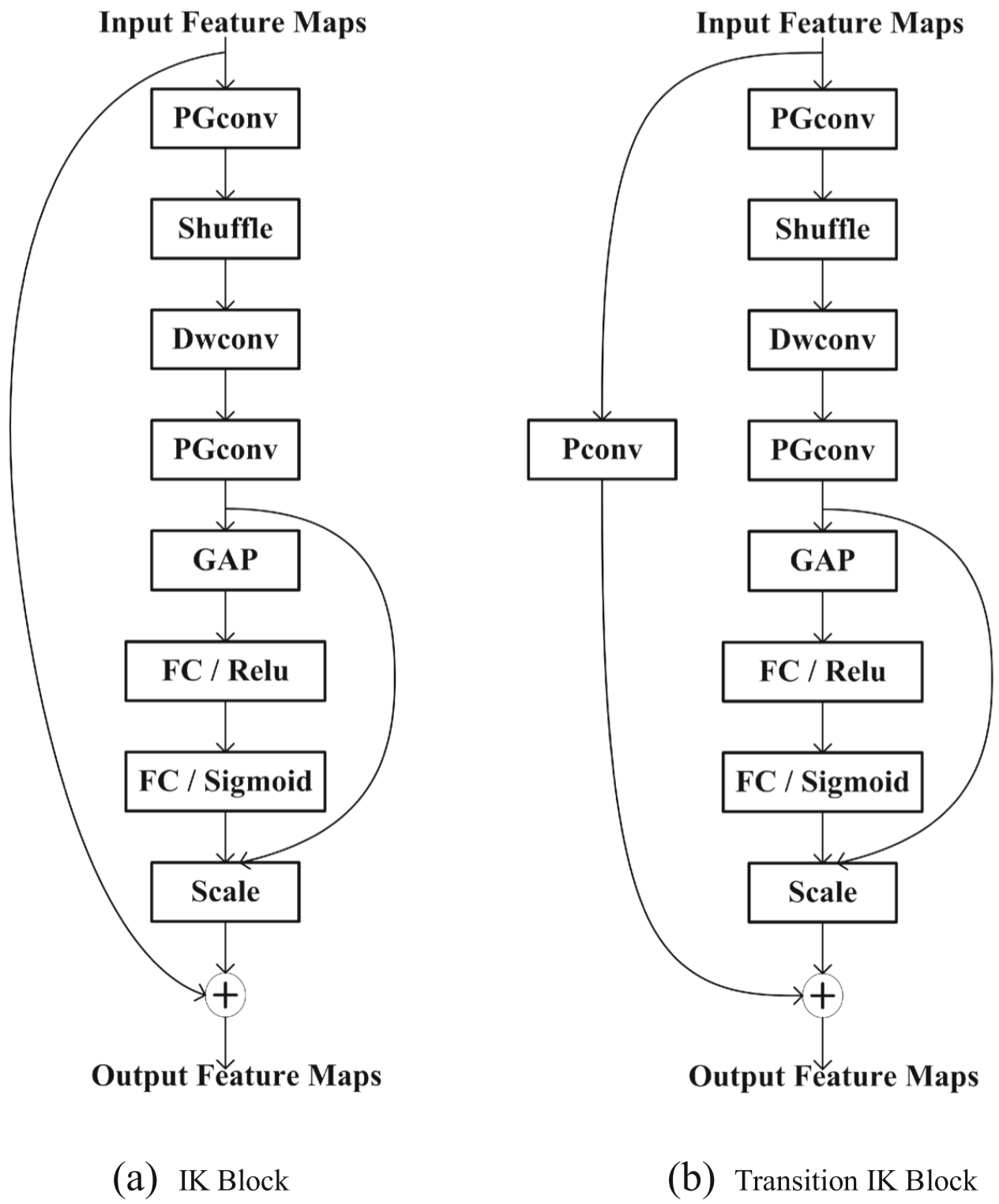

Model

PrismNet

文章认为采取这种自编码器网络能够有效的自动提取图像的重要信息,提高后续去雾算法的效率和精度,这种特征比以往人工设计的特征更加有效和更自适应。

SausageNet-72

文章采用和MSCNN中相同的方法来估计大气光值A,最终通过以下公式恢复去雾结果:

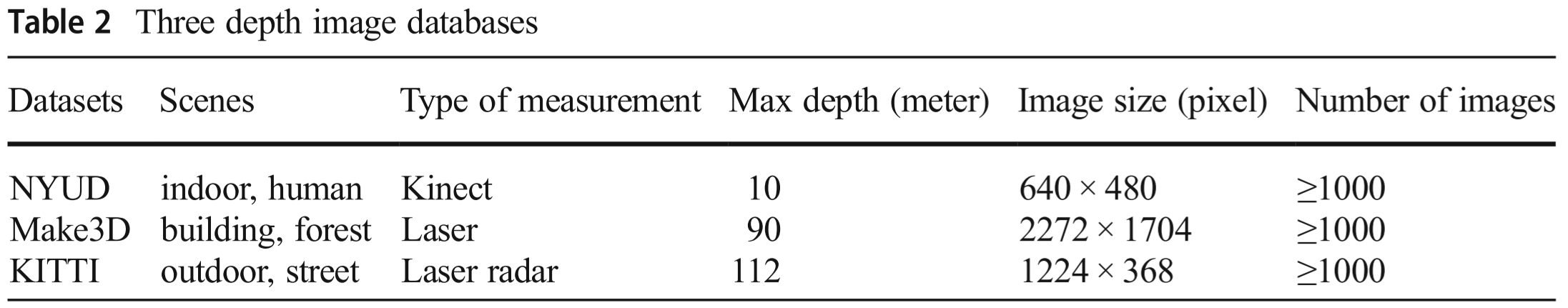

数据和训练

NYUD [28],Make3D [26]和KITT 我们从[0.8,1.0]范围内随机生成三个相同的大气光值,并随机采样每个图像的三个散射系数在[0.0,0.5]范围内,此外,我们使用引导滤镜[11]平滑合成的透射图以获得更精细的效果

数据集

-

训练集

-

测试集

训练设置

- 共训练100轮

- SausageNet-72使用了Nesterov方法,以0.9的动量,训练的,其初始学习率是0.0001,每33轮乘以0.1。

- PrismNet,隐藏层的数量为2,尺度分别设置为13×13和11×11,图像块为15×15。

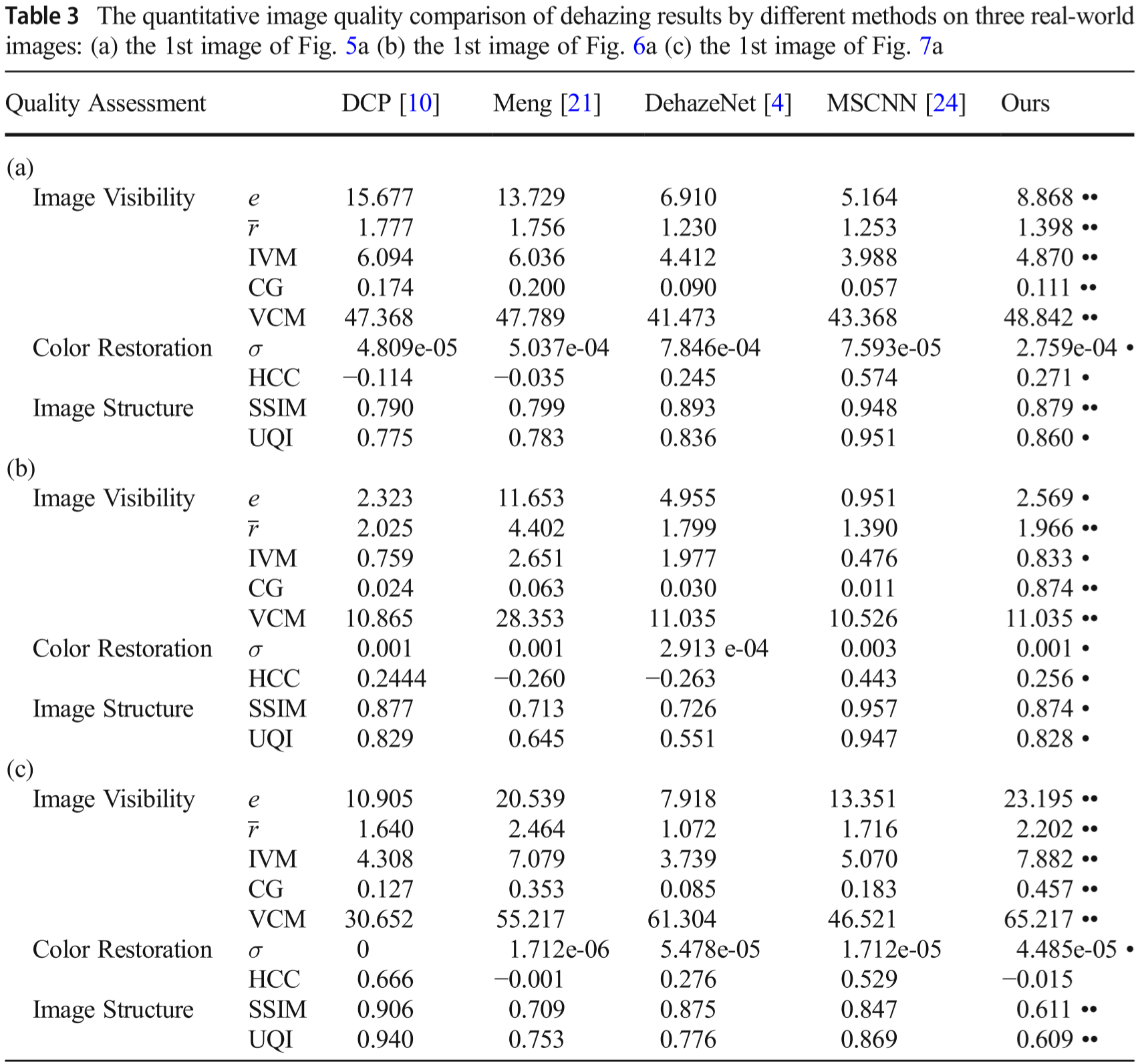

对比和测试

测试指标

文章从图像可见性,色彩还原和图像结构三个方面给出了9个指标:

image visibility:

[9]

[9]

- IVM [44]

- CG [6]

- VCM [16]

color restoration:

- σ [9]

- HCC [43]

image structure:

- SSIM [34]

- UQI [34]

指标对比

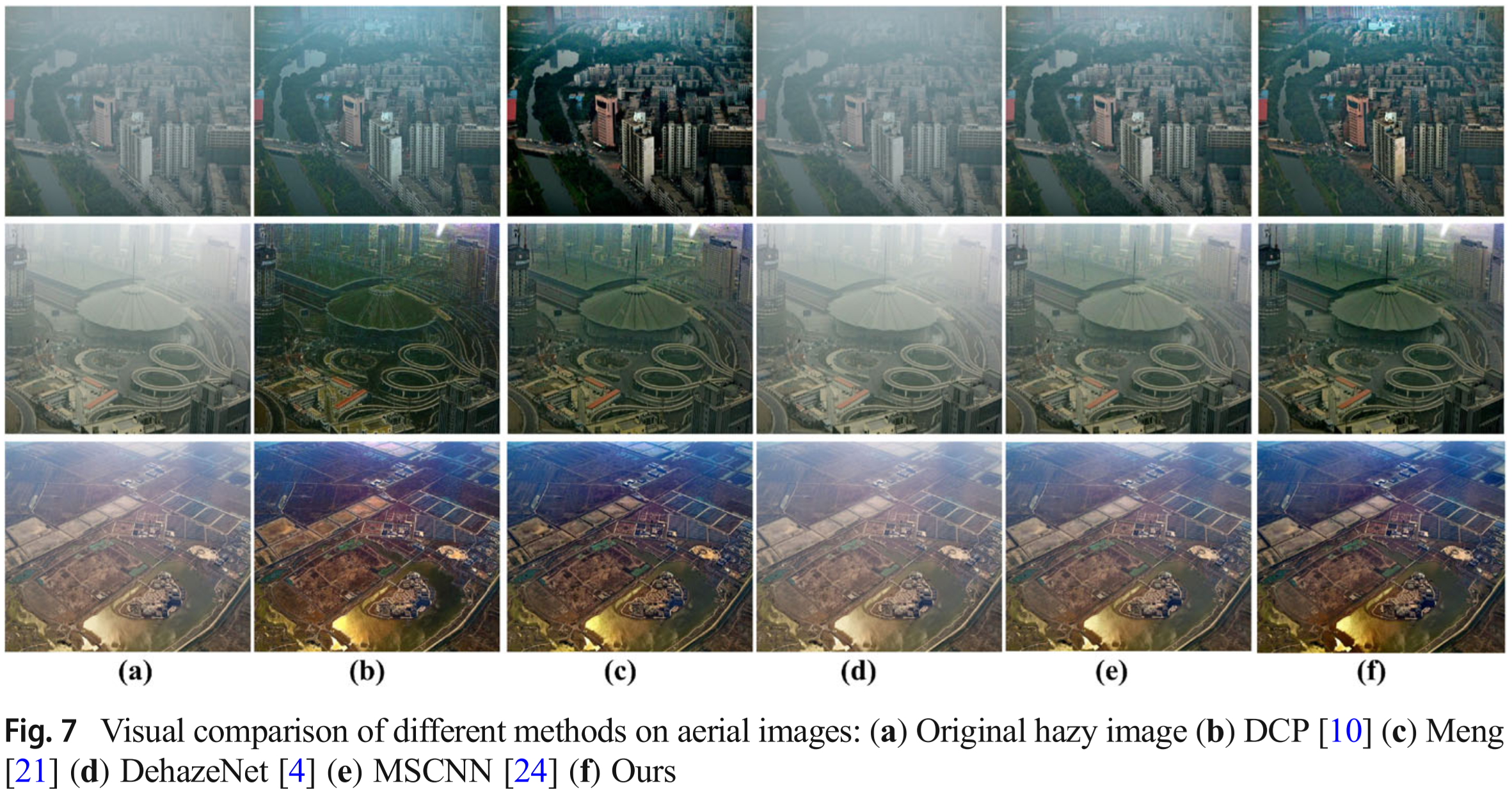

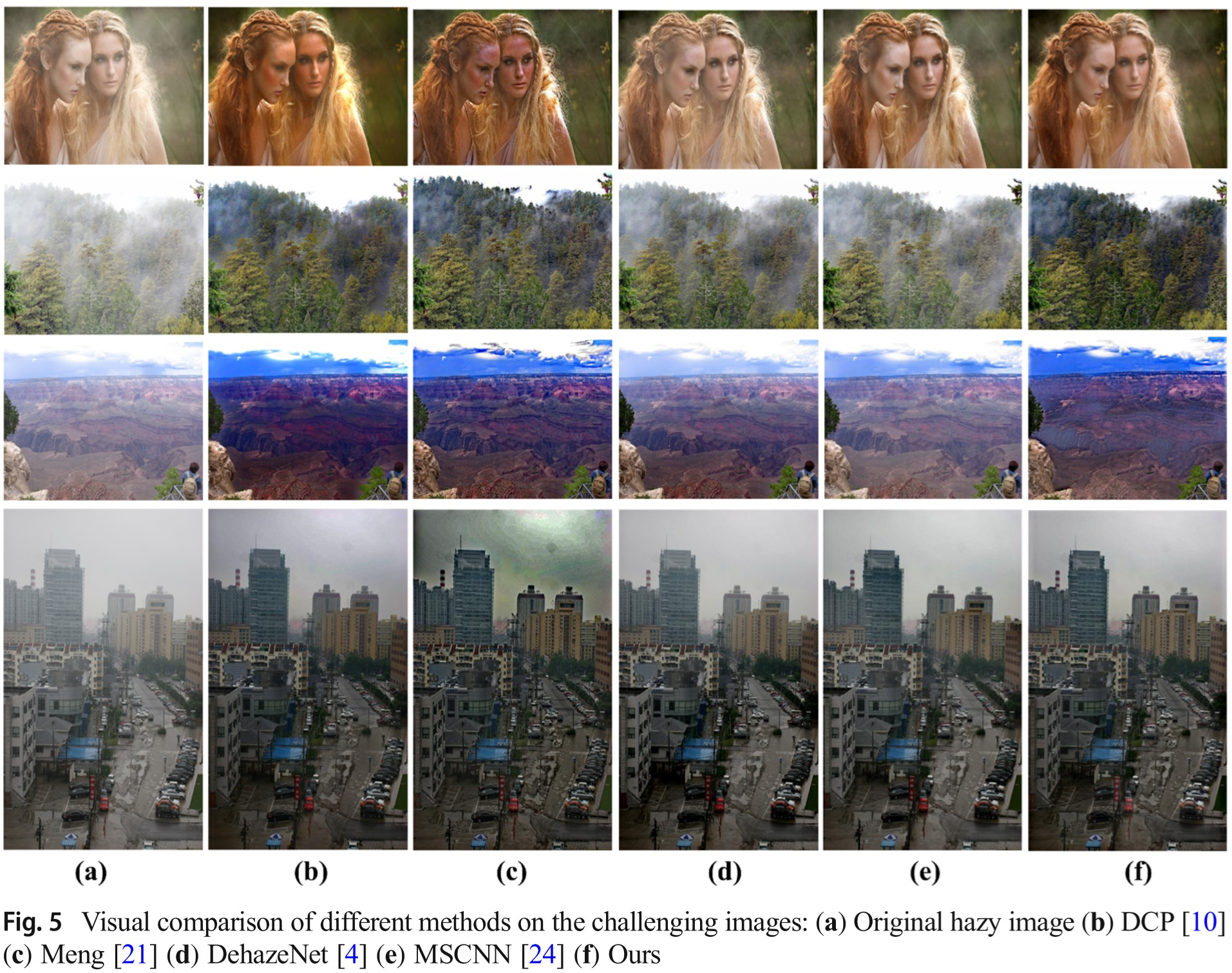

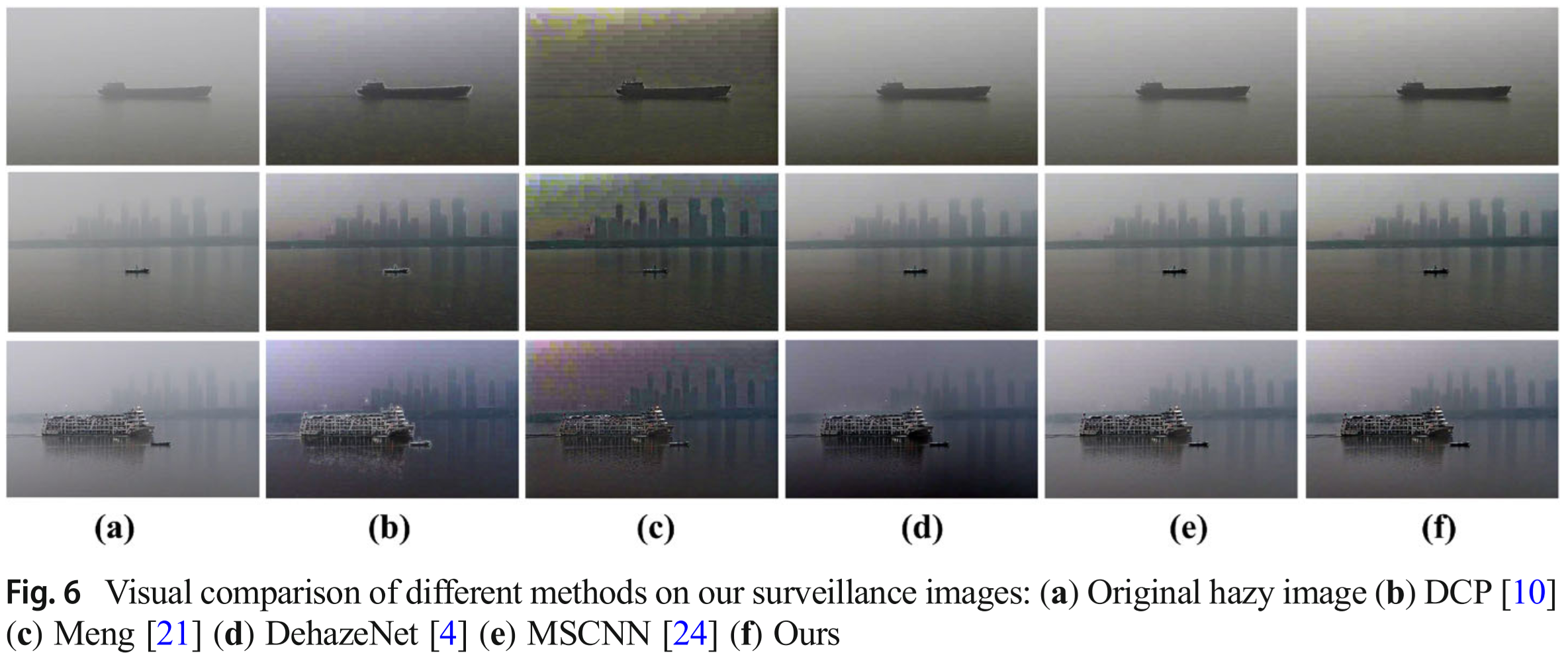

结果展示

总结和分析

文章总结了一些自己的问题:

- 文章提出的方法不适用于夜间模糊图像或雾分布不均匀的图像,这是因为物理模型过于简单,并且不包含复杂场景的有雾图像。

- 对于网络中的一些超参数,例如PrismNet的隐藏层的大小,这些参数对于去雾的影响很大程度上取决于人的经验,而并非出于自适应。

- 缺乏对大气散射模型的其他参数的估计,如A。