首先之前我写过一篇关于boosting原理的文章,可以关注头条号查看的,那篇文章对于adaboost的介绍不是很清楚,所以有了本文。

adaboost原理

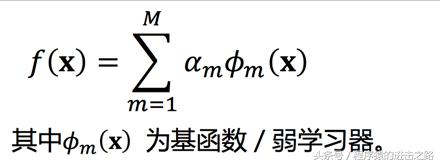

首先我们需要知道:Boosting是将弱学习器组合成强分类器,其主要公式:

我们的目标是去学习每个分类器以及分类器的权重。

-

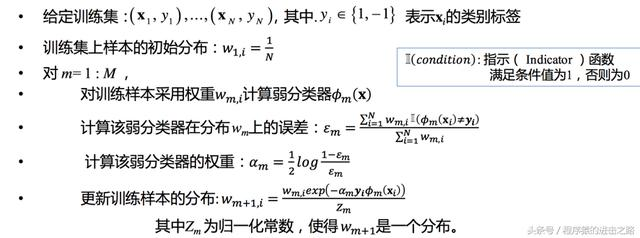

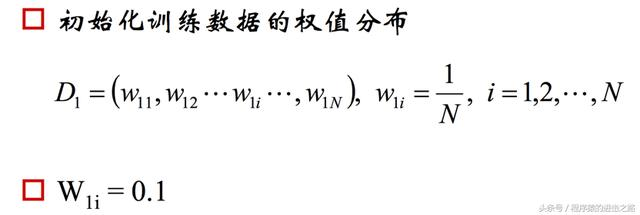

在没有先验知识的情况下,初始的权重分布为等概分布,即1/N

-

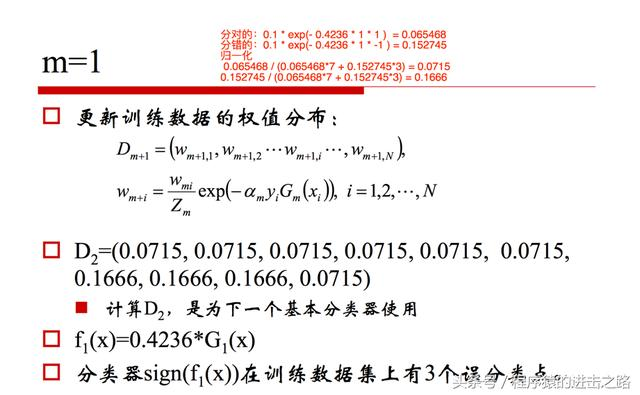

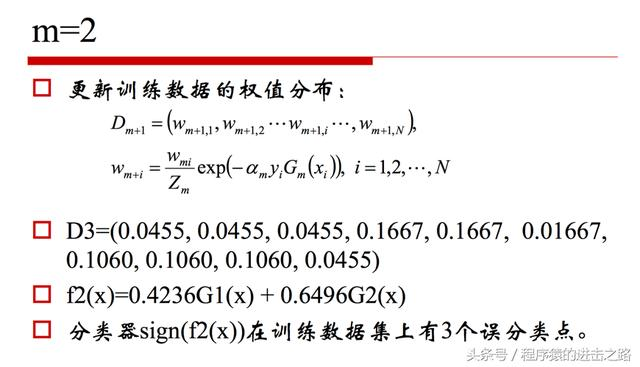

每次循环后,我们将提高错误样本的分布概率,在下一轮中让分类器重点关注这些样本

上面的话总结为数学描述如下:

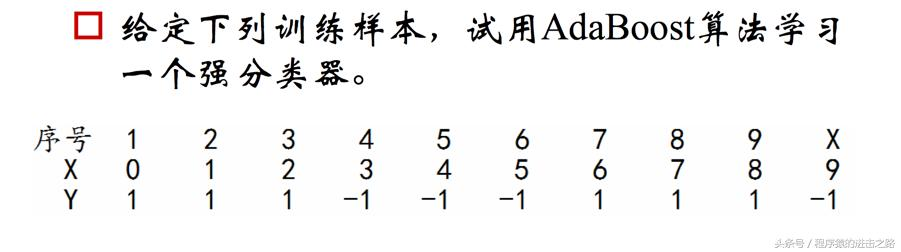

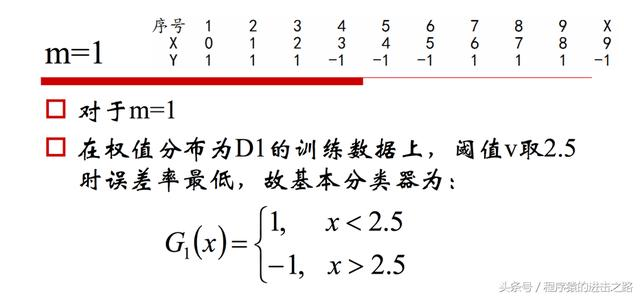

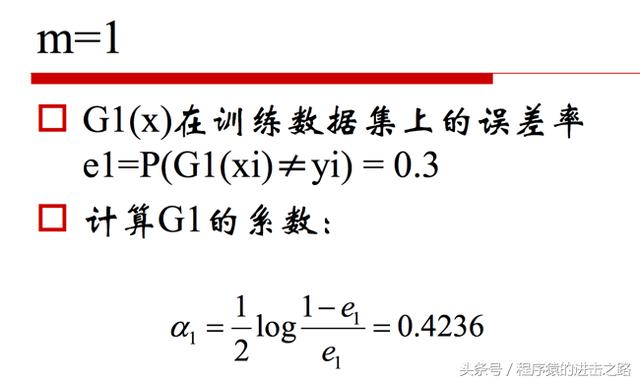

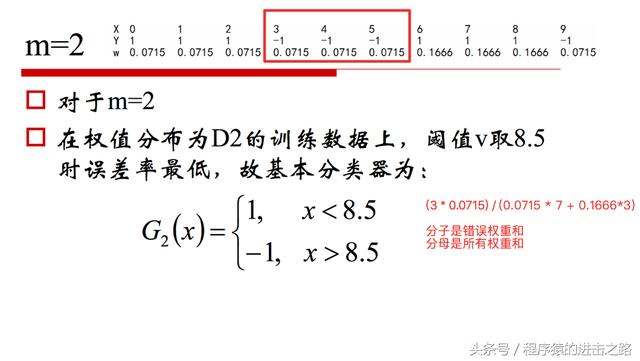

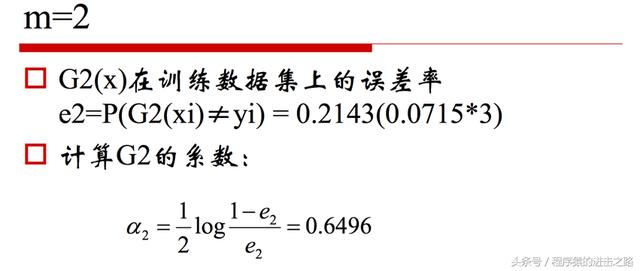

上面关于分类器的权重以及每轮样本分布更新的策略,我们稍后再介绍,先来看下一个例子:

上面的步骤重复计算,最终的分类器即为每个分类器输出的权重和。

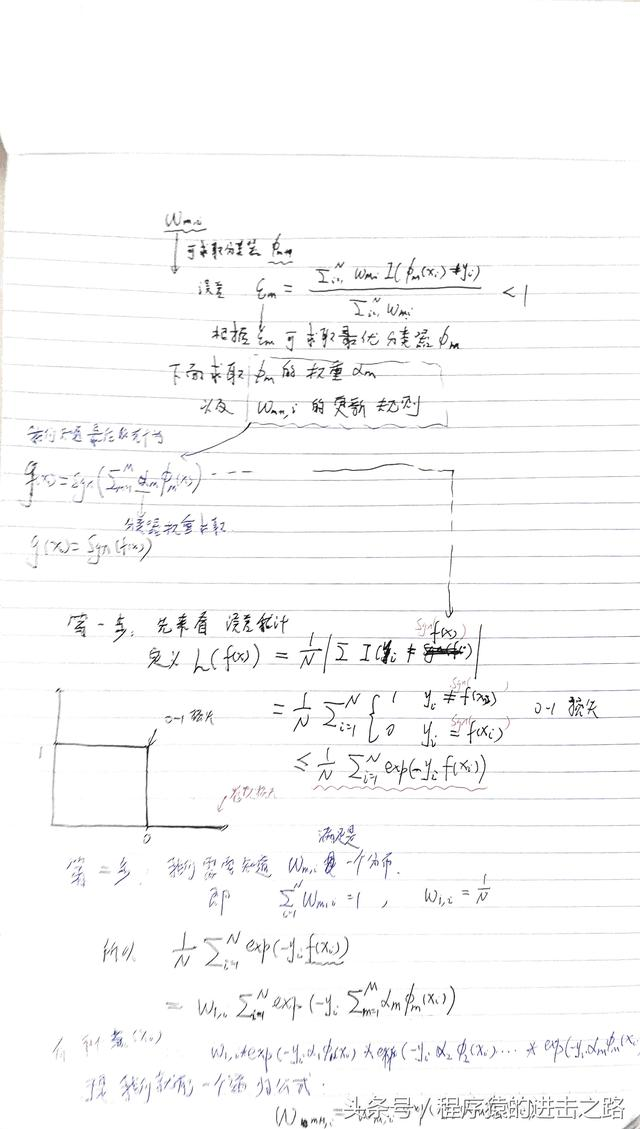

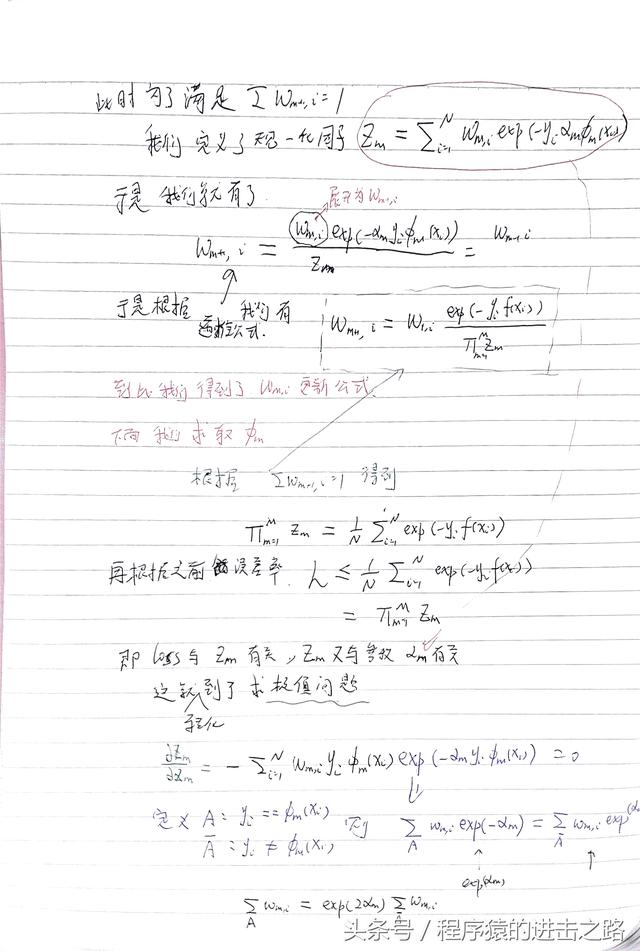

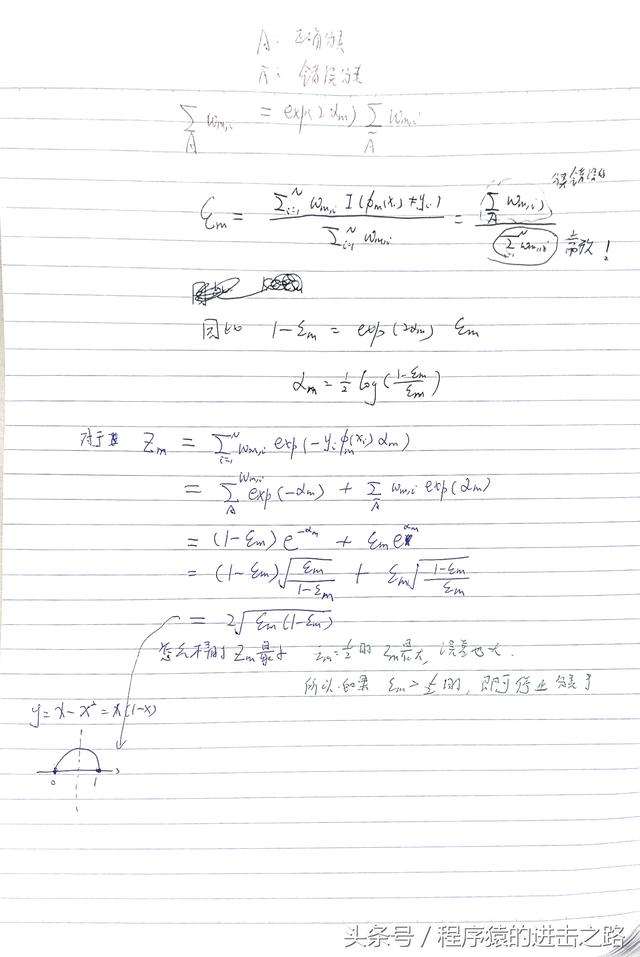

上面的步骤中,我们需要去证明两个事情,权重为何如此更新,已经每个分类器的权重为何是这么多。

上面介绍了adaboost其误差估计是0-1的,但是通过缩放可以变为指数误差,然后通过变化指数误差,我们可以得到一个关于wm的递推公式

根据wm的递推公式,我们可以知道误差是跟分类器的权值有关,可以转化为极值问题。

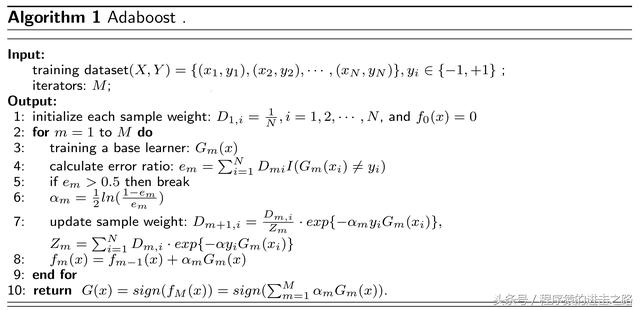

最后通过求导数的方法,求到每个分类器的权值,下面总结下整个算法过程:

通过本文你应该知道了每个样本权值w的更新规则是如何来的,以及每个弱分类器的权重是怎么决定的。

你的鼓励是我继续写下去的动力,期待我们共同进步。