文章分享至我的个人技术博客:https://cainluo.github.io/14976719349322.html

语音识别

之前在看锤子的发布会的时候, 看到了一个很屌的事情就是讯飞的语音识别杠杠的, 可以根据人说的语句来输入文字, 而且错别率很低, 业界都说666.

好在苹果爸爸也不认输, 也有个原生的语音识别框架Speech, 废话少说了, 我们直接来看看Speech框架.

我这里是Objective-C版本, 如果想看Swift版本的话, 可以到这里去看.

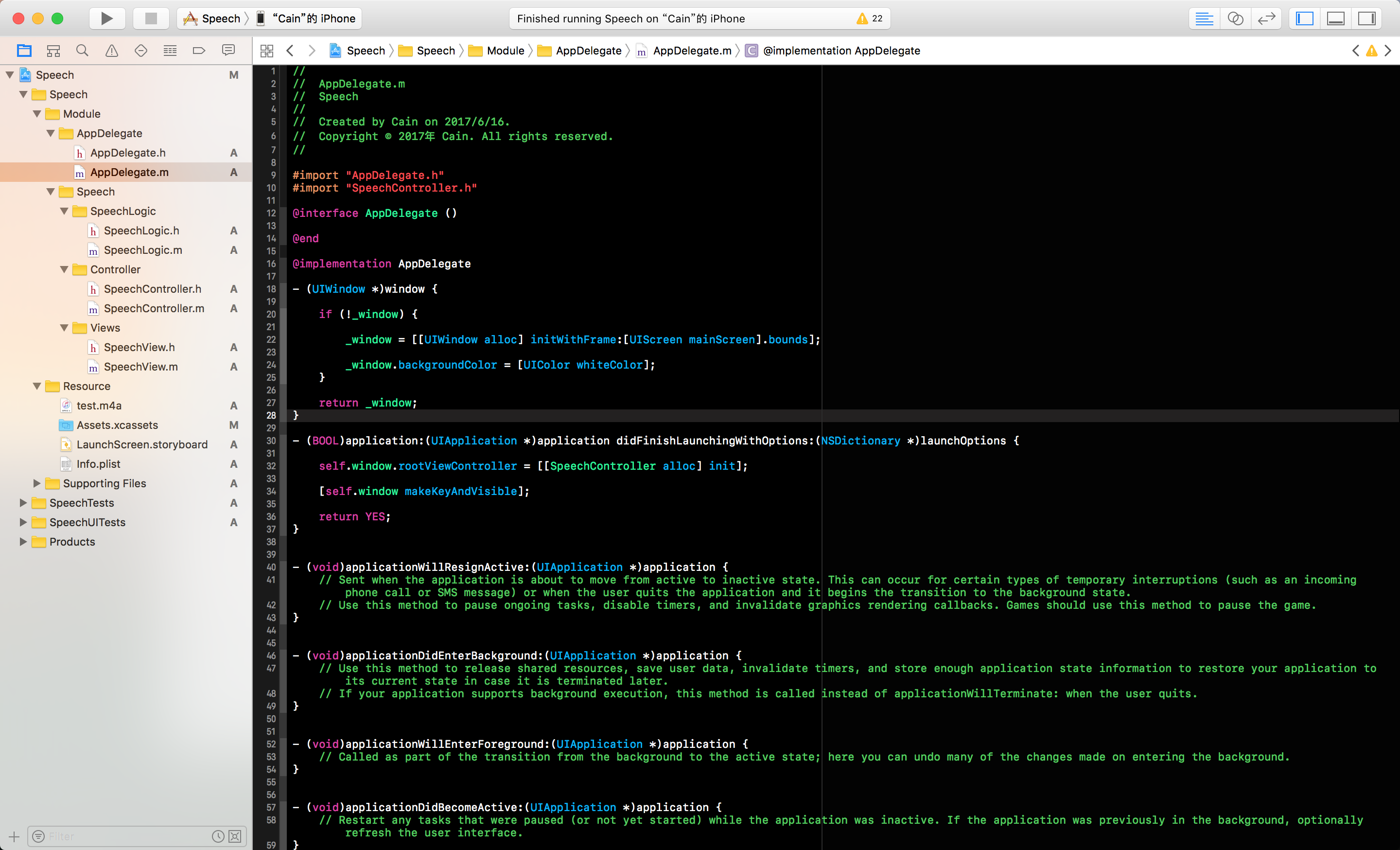

New Project

怎么创建新项目这里就不多说了, 直接上项目架构图:

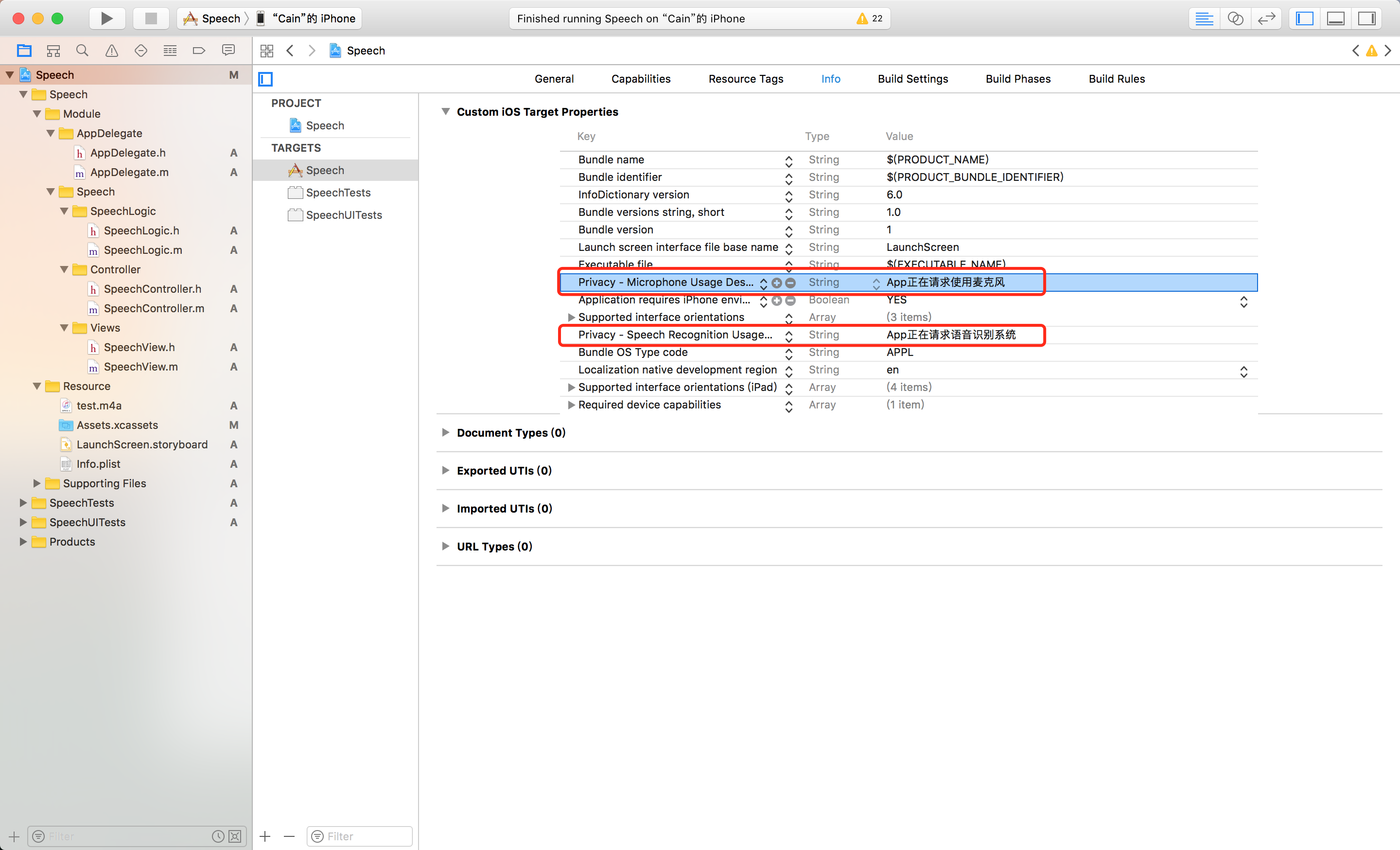

配置项目

由于现在苹果越来越注重用户的隐私, 就连最简单的请求使用麦克风, 摄像头都需要经过用户的允许, 这里我们就需要配置一下这些请求:

请求麦克风

- Privacy - Microphone Usage Description

请求语音识别系统

- Privacy - Speech Recognition Usage Description

里面的提示文字就根据大家的喜爱来自行编写吧, 还有更多的请求这里就不写了, 有需要的朋友可以自行去查资料把.

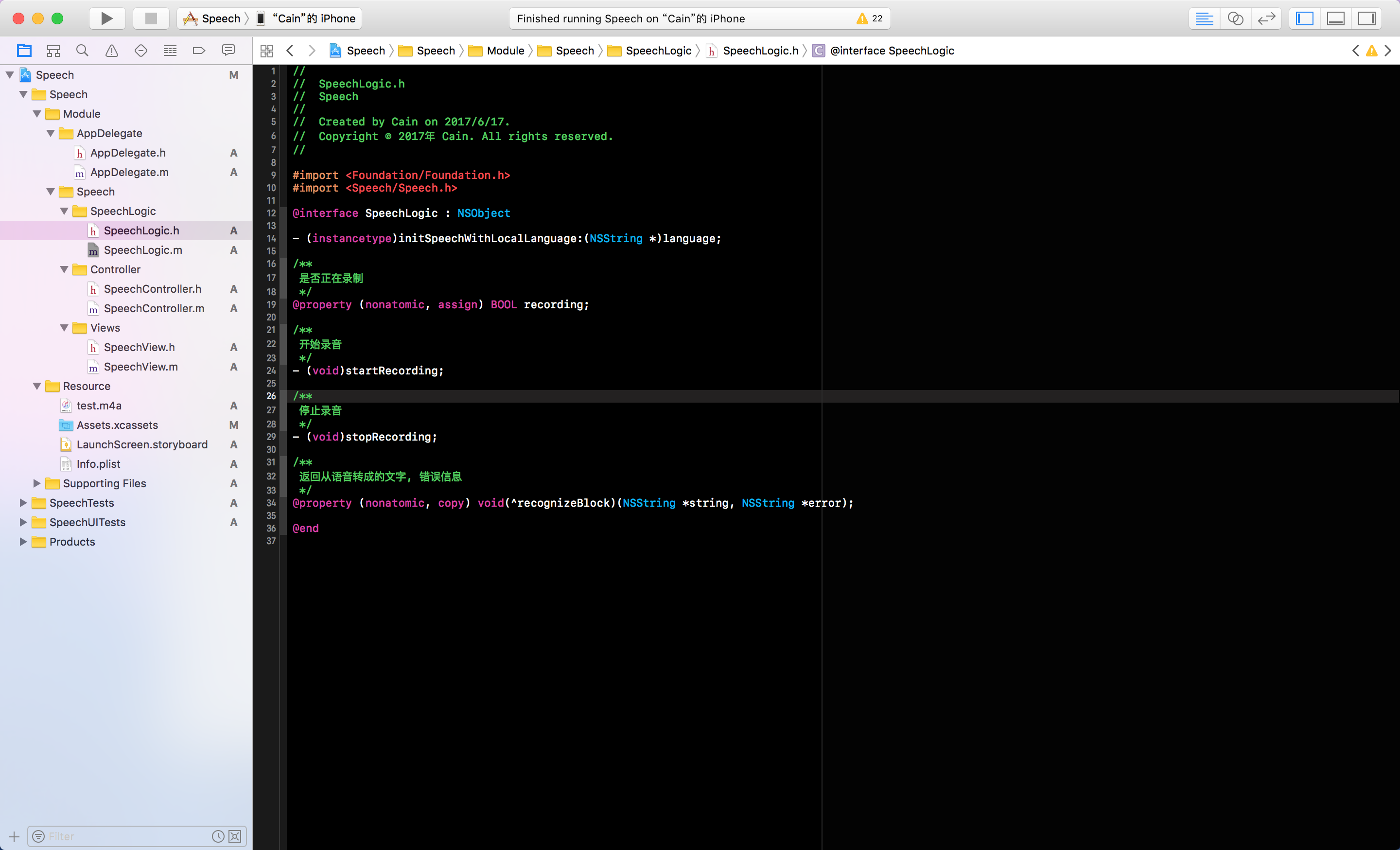

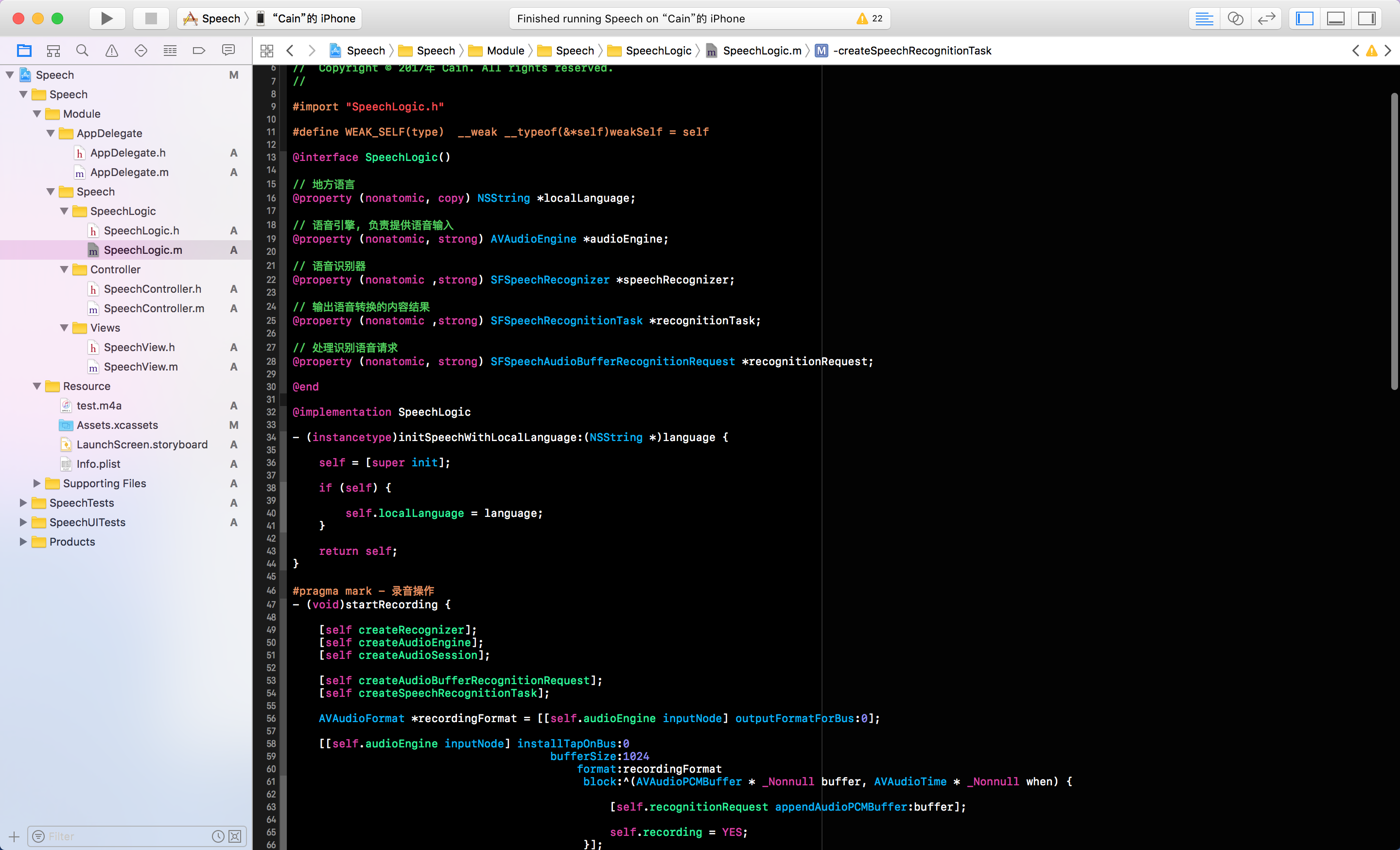

SpeechLogic

我这里新建了一个类, 专门用来管理Speech, 由于我用不上Speech这个框架, 这里我就随便封装了, 用到上的朋友可以自行另外封装哈.

方法, 属性都已经在文件里备注好了, 自行查看就好了.

UI界面也很简单, 这里就更加不用去解释了

开始语音识别

由于我没能在模拟器上面实现, 这里我就用了另外的方法, 有些蛋疼:

苹果爸爸的语音识别, 不只是能够识别人的语音, 还可以读取音频文件:

总结

我这里讲的东西比较少, 有兴趣的朋友可以去看看Speech框架API解释, 或者是苹果爸爸的官方文档, WWDC 2016 Speech十分钟视频以及我在Github上看到的iOS 10 Speech项目, 这些都是挺不错的资料, 方便大家去学习.

工程地址

项目地址: https://github.com/CainRun/iOS-10-Characteristic/tree/master/8.Speech

最后

码字很费脑, 看官赏点饭钱可好