微信公众号:「Python读财」

如有问题或建议,请公众号留言

谈及Pandas的read.xxx系列的函数,大家的第一反应会想到比较常用的pd.read_csv()和pd.read_excel(),大多数人估计没用过pd.read_html()这个函数。虽然它低调,但功能非常强大,用于抓取Table表格型数据时,简直是个神器。下面来详细介绍一下。

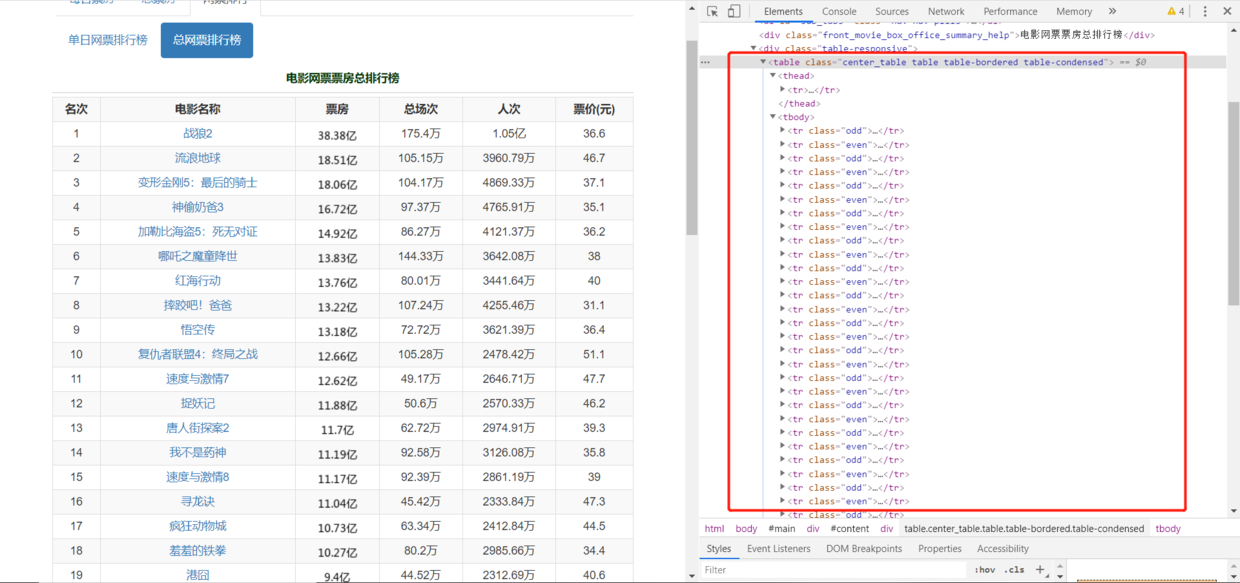

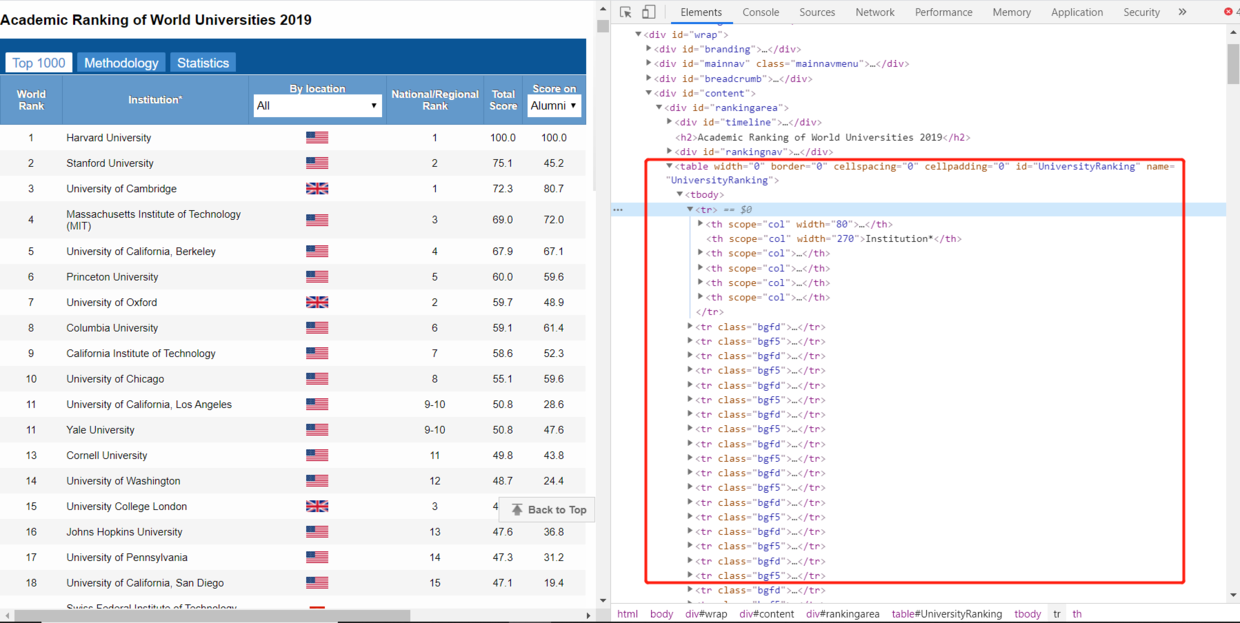

大家逛网页时,经常会看到这样一些数据表格,比如

电影票房数据

世界大学排行榜数据

财经数据

如果查看一下网页的HTML结构(Chrome浏览器F12),会发现它们有个共同的特点,不仅是表格,还是以Table结构展示的表格数据,大致的网页结构如下

<table class="..." id="...">

<thead>

<tr>

<th>...</th>

</tr>

</thead>

<tbody>

<tr>

<td>...</td>

</tr>

<tr>...</tr>

<tr>...</tr>

...

<tr>...</tr>

<tr>...</tr>

</tbody>

</table>

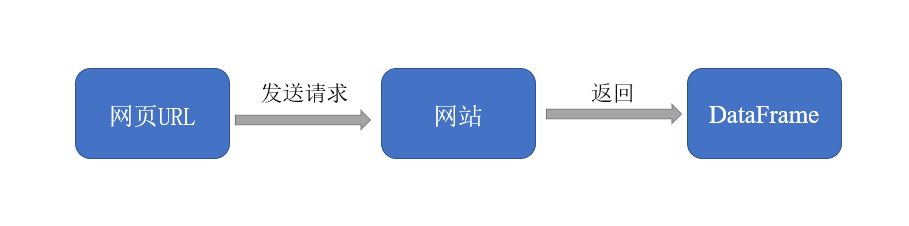

针对网页结构类似的表格类型数据,pd.read_html()就派上了大用场了,它可以将网页上的表格都抓取下来,并以DataFrame的形式装在一个列表中返回。具体是这么个流程:

先介绍一下read_html的一些主要的参数

read_html

-

io:str or file-like接收网址、文件、字符串。网址不接受

https,尝试去掉s后爬去 -

header:int or list-like or None指定列标题所在的行

-

attrs: dict or None, optional传递一个字典,用其中的属性筛选出特定的表格

-

parse_dates:bool解析日期

接下来以爬取新浪财经的基金重仓股为例演示一下,URL为:http://vip.stock.finance.sina.com.cn/q/go.php/vComStockHold/kind/jjzc/index.phtml?p=1

这部分有6页,点击不同的页数可以发现,请求URL主要是p参数在变动,p=n代表了第n页,所以一个for循环就可以遍历所有网址啦。URL的变动规律了解之后,就可以愉快的爬数据了,上代码

import pandas as pd

df = pd.DataFrame()

for i in range(6):

url = 'http://vip.stock.finance.sina.com.cn/q/go.php/vComStockHold/kind/jjzc/index.phtml?p={page}'.format(page=i+1)

df = pd.concat([df,pd.read_html(url)[0]])

print("第{page}页完成~".format(page=i+1))

df.to_csv('./data.csv', encoding='utf-8', index=0)

整个过程不需要用到正则表达式或者xpath等工具,短短的几行代码就可以将数据嗖嗖地爬下来了,是不是超级无敌方便?赶紧动手操作一波吧!

日后在爬一些小型数据时,只要遇到这种Table类型的表格,就可以直接祭出read_html这个神器啦,别人还在琢磨正则、xpath怎么写的时候,你已经把数据爬完了,想想就很舒服!

扫码关注公众号 「Python读财」,第一时间获取干货!