一、准备

hive下载地址:mirror.bit.edu.cn/apache/hive…

二、Hadoop环境搭建

Hadoop安装和配置,请看Hadoop单机版安装

三、mysql安装

因为Hive的默认元数据是Mysql,所以先要安装Mysql。

首先查看mysql 是否已经安装

rpm -qa | grep mysql

如果已经安装,想删除的话

普通删除命令:

rpm -e mysql

强力删除命令,依赖文件也会删除:

rpm -e --nodeps mysql

通过wget命令下载rpm安装mysql

wget http://repo.mysql.com/mysql57-community-release-el7.rpm

下载完成后,输入

yum install mysql-server

安装成功后,systemctl start mariadb.service启动服务

设置密码,因为默认没有密码,直接回车即可

mysqladmin -u root -p password '123456'

然后连接mysql

mysql -u root -p

通过授权法更改远程连接权限

grant all privileges on *.* to 'root'@'%' identified by '123456';

# 刷新

flush privileges;

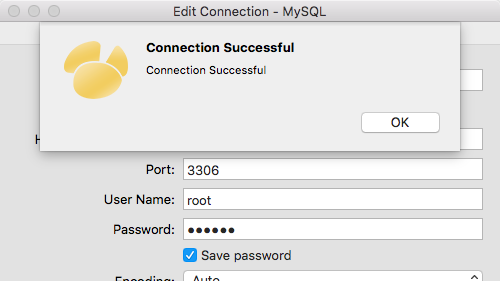

然后使用Navicat测试连接

四、Hive环境安装和配置

1、下载

下载安装包

wget http://mirror.bit.edu.cn/apache/hive/hive-3.1.0/apache-hive-3.1.0-bin.tar.gz

解压安装包

tar -xvf apache-hive-3.1.0-bin.tar.gz

然后移动到/opt/hive 里面,将文件夹重命名为 hive3.1

mkdir /home/hive

mv apache-hive-3.1.0-bin /home/hive

mv apache-hive-3.1.0-bin hive3.1

2、环境配置

编辑 /etc/profile 文件

vim /etc/profile

输入

export HIVE_HOME=/home/hive/hive3.1

export HIVE_CONF_DIR=${HIVE_HOME}/conf

export PATH=.:${JAVA_HOME}/bin:${HADOOP_HOME}/bin:${HIVE_HOME}/bin:$PATH

注:实际配置以自己的为准!

source /etc/profile

3、配置更改

4.3.1 新建文件夹

在修改配置文件之前,需要先在root目录下建立一些文件夹。

mkdir /root/hive

mkdir /root/hive/warehouse

新建完该文件之后,需要让hadoop新建/root/hive/warehouse 和 /root/hive/ 目录。 执行命令:

$HADOOP_HOME/bin/hadoop fs -mkdir -p /root/hive/

$HADOOP_HOME/bin/hadoop fs -mkdir -p /root/hive/warehouse

给刚才新建的目录赋予读写权限,执行命令:

$HADOOP_HOME/bin/hadoop fs -chmod 777 /root/hive/

$HADOOP_HOME/bin/hadoop fs -chmod 777 /root/hive/warehouse

检查这两个目录是否成功创建 输入:

$HADOOP_HOME/bin/hadoop fs -ls /root/

$HADOOP_HOME/bin/hadoop fs -ls /root/hive/

4.3.2 修改hive-site.xml

切换到 /home/hive/hive3.1/conf 目录下

将hive-default.xml.template 拷贝一份,并重命名为hive-site.xml 然后编辑hive-site.xml文件

cp hive-default.xml.template hive-site.xml

vim hive-site.xml

编辑hive-site.xml文件,在 中修改:

<!-- 指定HDFS中的hive仓库地址 -->

<property>

<name>hive.metastore.warehouse.dir</name>

<value>/root/hive/warehouse</value>

</property>

<property>

<name>hive.exec.scratchdir</name>

<value>/root/hive</value>

</property>

<!-- 该属性为空表示嵌入模式或本地模式,否则为远程模式 -->

<property>

<name>hive.metastore.uris</name>

<value></value>

</property>

<!-- 指定mysql的连接 -->

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://master:3306/hive?createDatabaseIfNotExist=true</value>

</property>

<!-- 指定驱动类 -->

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

</property>

<!-- 指定用户名 -->

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

</property>

<!-- 指定密码 -->

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>123456</value>

</property>

<property>

<name>hive.metastore.schema.verification</name>

<value>false</value>

<description>

</description>

</property>

然后将配置文件中所有的${system:java.io.tmpdir}更改为 /home/hive/tmp (如果没有该文件则创建),将 ${system:user.name}更改为 root

注:MySQL的连接地址中的master是主机的别名,可以换成ip。

4.3.3 修改 hive-env.sh

修改 hive-env.sh 文件,没有就复制 hive-env.sh.template ,并重命名为 hive-env.sh

在配置文件中添加

export HADOOP_HOME=/home/hadoop/hadoop3.1

export HIVE_CONF_DIR=/home/hive/hive3.1/conf

export HIVE_AUX_JARS_PATH=/home/hive/hive3.1/lib

4.3.4 添加 数据驱动包

由于Hive 默认自带的数据库是使用mysql,所以这块就是用mysql

将mysql 的驱动包 上传到 /home/hive/hive3.1/lib

wget https://cdn.mysql.com//Downloads/Connector-J/mysql-connector-java-5.1.47.tar.gz

tar -xvf mysql-connector-java-5.1.47.tar.gz

cd mysql-connector-java-5.1.47

ls

build.xml CHANGES COPYING mysql-connector-java-5.1.47-bin.jar mysql-connector-java-5.1.47.jar README README.txt src

将mysql-connector-java-5.1.47.jar拷贝到/home/hive/hive3.1/lib目录下

cp mysql-connector-java-5.1.47.jar /home/hive/hive3.1/lib

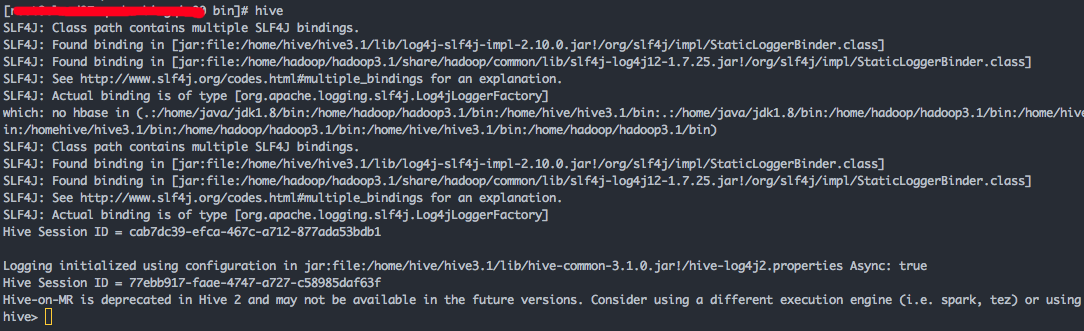

五、Hive Shell 测试

在成功启动Hadoop之后, 切换到Hive目录下

cd /home/hive/hive3.1/bin

首先初始化数据库, 初始化的时候注意要将mysql启动

schematool -dbType mysql -initSchema

这时就启动成功了

进入hive (确保hadoop以及成功启动)

hive

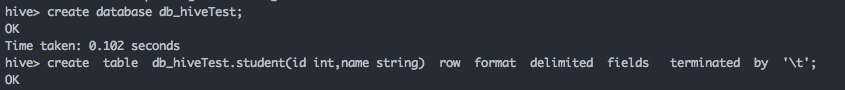

做一些简单的操作

新建一个库,然后在建一张表

基本操作和普通的关系型数据库差不多

# 创建数据库

create database db_hiveTest;

# 创建表

create table db_hiveTest.student(id int,name string) row format delimited fields terminated by '\t';

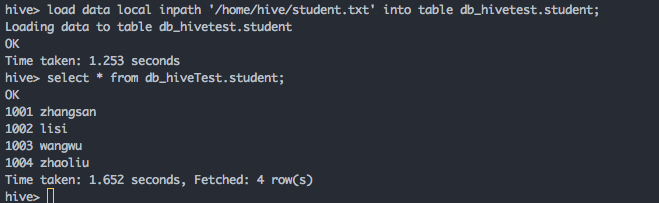

新打开一个窗口, 因为hive 不支持写,所以添加数据使用load加载文本获取。

touch /home/hive/student.txt

vim /home/hive/student.txt

添加数据

1001 zhangsan

1002 lisi

1003 wangwu

1004 zhaoliu

切换到hive shell

# 加载数据

load data local inpath '/home/hive/student.txt' into table db_hivetest.student;

# 查询数据

select * from db_hiveTest.student;

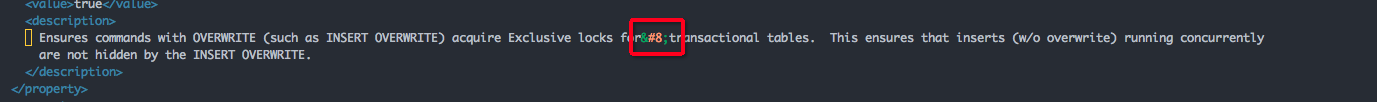

启动时遇到的错误

- 非法字符

Exception in thread "main" java.lang.RuntimeException: com.ctc.wstx.exc.WstxParsingException: Illegal character entity: expansion character (code 0x8

at [row,col,system-id]: [3254,96,"file:/home/hive/hive3.1/conf/hive-site.xml"]

at org.apache.hadoop.conf.Configuration.loadResource(Configuration.java:3003)

at org.apache.hadoop.conf.Configuration.loadResources(Configuration.java:2931)

at org.apache.hadoop.conf.Configuration.getProps(Configuration.java:2806)

at org.apache.hadoop.conf.Configuration.get(Configuration.java:1460)

at org.apache.hadoop.hive.conf.HiveConf.getVar(HiveConf.java:4990)

at org.apache.hadoop.hive.conf.HiveConf.getVar(HiveConf.java:5063)

at org.apache.hadoop.hive.conf.HiveConf.initialize(HiveConf.java:5150)

原因是3254,96,"file:/home/hive/hive3.1/conf/hive-site.xml"位置有非法字符

即可

- 密码错误

[root@hive bin]# schematool -dbType mysql -initSchema

SLF4J: Class path contains multiple SLF4J bindings.

SLF4J: Found binding in [jar:file:/opt/hive/hive3.1/lib/log4j-slf4j-impl-2.10.0.jar!/org/slf4j/impl/StaticLoggerBinder.class]

SLF4J: Found binding in [jar:file:/home/hadoop/hadoop-3.0.2/share/hadoop/common/lib/slf4j-log4j12-1.7.25.jar!/org/slf4j/impl/StaticLoggerBinder.class]

SLF4J: See http://www.slf4j.org/codes.html#multiple_bindings for an explanation.

SLF4J: Actual binding is of type [org.apache.logging.slf4j.Log4jLoggerFactory]

Metastore connection URL: jdbc:mysql://10.2.18.91:3306/hive?createDatabaseIfNotExist=true

Metastore Connection Driver : com.mysql.jdbc.Driver

Metastore connection User: root

org.apache.hadoop.hive.metastore.HiveMetaException: Failed to get schema version.

Underlying cause: java.sql.SQLException : Access denied for user 'root'@'hive' (using password: YES)

SQL Error code: 1045

Use --verbose for detailed stacktrace.

*** schemaTool failed ***

这个错误是因为mysql连接不上,其实就是密码错误了,查看mysql.user表

select * from mysql.user;

发现host=hive的账号没有设置密码,只要给这个host设置我们配置的密码就ok了

set password for root@hive = password('123456');

设置好密码后,再启动schematool -dbType mysql -initSchema